LLM API가 표준화되지 않은 이유

LLM API 단편화 문제(및 "OpenAI-Compatible"이 충분하지 않은 이유)

LLM API가 표준화되지 않은 이유를 찾고 있다면 아마도 이미 어려움을 겪고 있을 것입니다.

소위 "OpenAI 호환" API의 급속한 증가에도 불구하고 실제 LLM 통합은 여전히 미묘하지만 비용이 많이 드는 방식으로 중단됩니다. 특히 단순한 텍스트 생성을 넘어서면 더욱 그렇습니다.

이 가이드에서는 다음을 설명합니다.

- LLM API 조각화 문제가 실제로 무엇인지

- OpenAI 호환 API가 프로덕션에서 충분하지 않은 이유

- 그리고 2026년 팀이 끊임없는 모델 이탈에서 살아남는 시스템을 설계하는 방법

TL;DR(너무 길어서 읽지 않음)

- 공급자가 호환성이 아닌 다양한 기능을 최적화하기 때문에 LLM API는 표준화되지 않았습니다.

- "OpenAI-호환"은 일반적으로 동작 호환이 아닌 요청 형태 호환을 의미합니다.

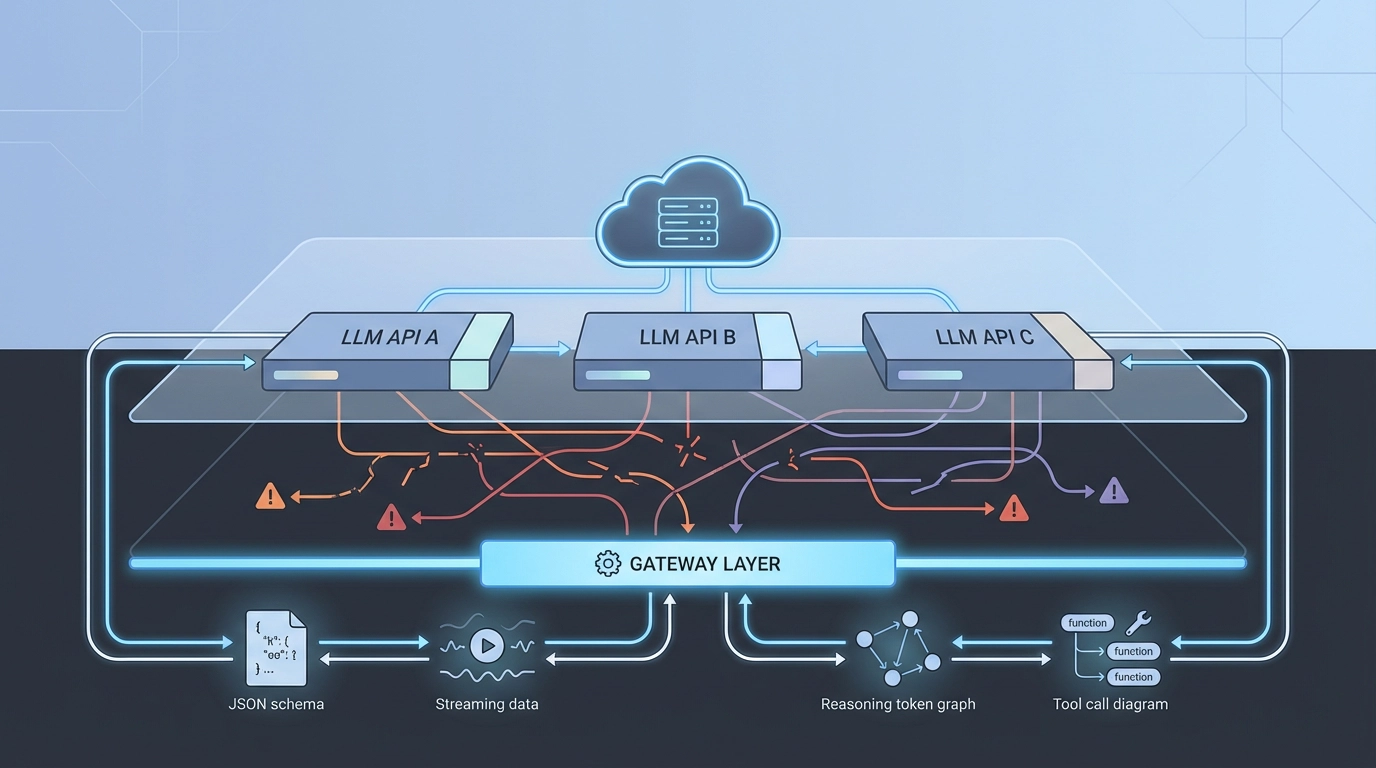

- 조각화는 도구 호출, 토큰 계산 추론, 스트리밍 및 오류 처리에서 가장 명확하게 나타납니다.

- 표준을 기다리는 대신 팀은 전용 게이트웨이 계층 뒤에서 API 동작을 표준화합니다.

LLM API 조각화 문제란 무엇입니까?

LLM API 단편화는 서로 다른 언어 모델 제공자가 비슷해 보이지만 실제 워크로드에서 다르게 동작하는 API를 노출할 때 발생합니다.

API가 공유하는 경우에도:

- 비슷한 끝점

- 유사한 JSON 요청 스키마

- 유사한 매개변수 이름

그들은 종종 다음과 같은 점에서 갈라집니다:

- 도구 호출 의미론

- 추론/사고 토큰 회계

- 스트리밍 동작

- 오류 코드 및 재시도 신호

- 구조화된 출력 보장

시간이 지남에 따라 애플리케이션 논리는 공급자별 예외로 채워집니다.

LLM API가 표준화되지 않은 이유

1. 공급자는 다양한 기본 요소에 맞게 최적화합니다.

최신 LLM은 더 이상 단순한 텍스트 입력/텍스트 출력 시스템이 아닙니다.

다양한 공급자는 다양한 기본 요소의 우선순위를 지정합니다.

- 추론 깊이와 지연 시간

- 긴 컨텍스트 검색과 처리량 비교

- 기본 다중 양식(이미지, 비디오, 오디오)

- 안전 및 정책 집행

단일 엄격한 표준은 다음 중 하나입니다.

- 고급 기능 숨기기

- 또는 가장 낮은 공통 분모로의 느린 혁신

경쟁이 치열한 시장에서는 두 가지 결과 모두 현실적이지 않습니다.

2. "OpenAI-Compatible"은 Happy Path만 포함합니다.

대부분의 "OpenAI 호환" API는 기본 연기 테스트를 통과하도록 설계되었습니다.

client.chat.completions.create(

model="model-name",

messages=[{"role": "user", "content": "Hello"}]

)이는 데모에서는 작동하지만 프로덕션 시스템은 이보다 훨씬 더 많은 것에 의존합니다.

2026년에 "OpenAI-Compatible"만으로는 충분하지 않은 이유

실제 중단은 구문뿐만 아니라 동작에 의존할 때 나타납니다.

🔽 표: "OpenAI-Compatible" API가 프로덕션에 중단되는 이유

| 차원 | "OpenAI-호환"이 약속하는 것 | 생산 과정에서 자주 발생하는 일 |

|---|---|---|

| 형태 요청 | 유사한 JSON 스키마(메시지, 모델, 도구) | 가장자리 매개변수가 자동으로 무시되거나 재해석됨 |

| 도구 호출 | 호환 가능한 기능 정의 | 다른 위치나 모양으로 반환된 도구 호출 |

| 도구 인수 | 안정적으로 구문 분석할 수 있는 JSON 문자열 | 평면화, 문자열화 또는 부분적으로 삭제된 인수 |

| 추론 토큰 | 투명한 사용량 보고 | 일관되지 않은 토큰 회계 및 청구 의미 |

| 구조화된 출력 | 유효한 JSON 응답 | 스키마 보장을 위반하는 "최선의 노력" JSON |

| 스트리밍 | 안정적인 델타 청크 | 일관성 없는 청크 순서 또는 누락된 완료 신호 |

| 오류 처리 | 명확한 속도 제한 및 재시도 신호 | 500 오류, 모호한 실패 또는 자동 시간 초과 |

| 마이그레이션 | 간편한 공급자 전환 | 신속한 재작성 및 글루 코드 확산 |

이러한 차이점은 데모에서는 거의 나타나지 않습니다.

실제 부하, 복잡한 도구 사용 또는 비용에 민감한 생산 시스템에서만 나타납니다.

예 1: 도구 호출이 비슷해 보이지만 의미가 깨짐

OpenAI 스타일 기대(간체):

{

"tool_calls": [{

"id": "call_1",

"type": "function",

"function": {

"name": "search",

"arguments": "{\"query\":\"LLM API fragmentation\",\"filters\":{\"year\":2026}}"

}

}]

}일반적인 "호환" 현실:

{

"tool_call": {

"name": "search",

"arguments": "{\"query\":\"LLM API fragmentation\"}"

}

}두 응답 모두 "성공"할 수 있습니다. 애플리케이션이 중첩된 인수, 도구 호출 배열 또는 안정적인 응답 경로에 의존하면 동작이 호환되지 않습니다.

예시 2: 추론 토큰 — 2026년 문제점

추론 중심 모델은 추가적인 추론/사고 토큰을 도입합니다.

"OpenAI 호환" API를 사용하더라도 다음 위치에서 조각화가 나타납니다.

-

토큰 회계(추론 토큰이 계산되고 가격이 책정되는 방식)

-

사용 보고(추론 토큰이 표시되는 위치)

-

컨트롤 노브(추론 노력을 위한 다른 이름과 의미)

-

관찰 가능성(공급업체 간 비용을 비교하기 어려움) 결과:

-

비용 대시보드가 표류합니다.

-

평가 기준선이 깨졌습니다.

-

공급자 간 최적화가 불안정해짐 추론 행위는 비슷할 수 있지만 추론 회계는 거의 그렇지 않습니다.

LLM API 단편화의 숨겨진 비용

1. Glue 코드가 조용히 축적됩니다.

def get_reasoning_usage(resp: dict) -> int | None:

details = resp.get("usage", {}).get("output_tokens_details", {})

if "reasoning_tokens" in details:

return details["reasoning_tokens"]

if "reasoning_tokens" in resp.get("usage", {}):

return resp["usage"]["reasoning_tokens"]

return None이 패턴은 도구, 재시도, 스트리밍 및 사용량 추적 전반에 걸쳐 반복됩니다.

글루 코드는 기능을 제공하지 않습니다. 파손만 방지합니다.

2. LLM 제공업체 간 마이그레이션이 예상보다 어렵습니다.

팀이 기대하는 것:

"나중에 모델을 바꾸겠습니다."

실제로 일어나는 일:

-

신속한 드리프트

-

호환되지 않는 도구 스키마

-

다른 속도 제한 의미

-

일치하지 않는 사용량 측정항목

3. 다중 모드 API로 조각화 증가

텍스트 너머:

-

비디오 API는 기간 단위와 안전 규칙이 다릅니다.

-

이미지 API는 마스크 형식과 참조가 다양합니다.

현재는 공유된 다중 모드 계약이 없습니다.

팀이 자체 래퍼를 구축하려고(그리고 애쓰는) 이유

처음에는 사용자 정의 추상화가 합리적이라고 느껴집니다.

시간이 지나면 다음과 같이 됩니다.

-

두 번째 제품

-

유지관리 부담

-

실험의 병목 현상

많은 팀이 독립적으로 동일한 결론을 재발견합니다.

실용적인 표준화 체크리스트

"호환 가능한" API 또는 내부 래퍼를 신뢰하기 전에 다음 사항을 질문하십시오.

- 도구 호출 동작은 호환됩니까, 아니면 스키마 전용입니까?

-

추론토큰은 지속적으로 노출되나요?

-

공급자 간에 사용량을 비교할 수 있습니까?

- 오류코드는 정규화되어 있나요?

- 부하가 걸려도 스트리밍이 안정적인가요?

- 프롬프트를 다시 작성하지 않고도 공급자를 전환할 수 있습니까?

- 트래픽을 동적으로 다시 라우팅할 수 있습니까?

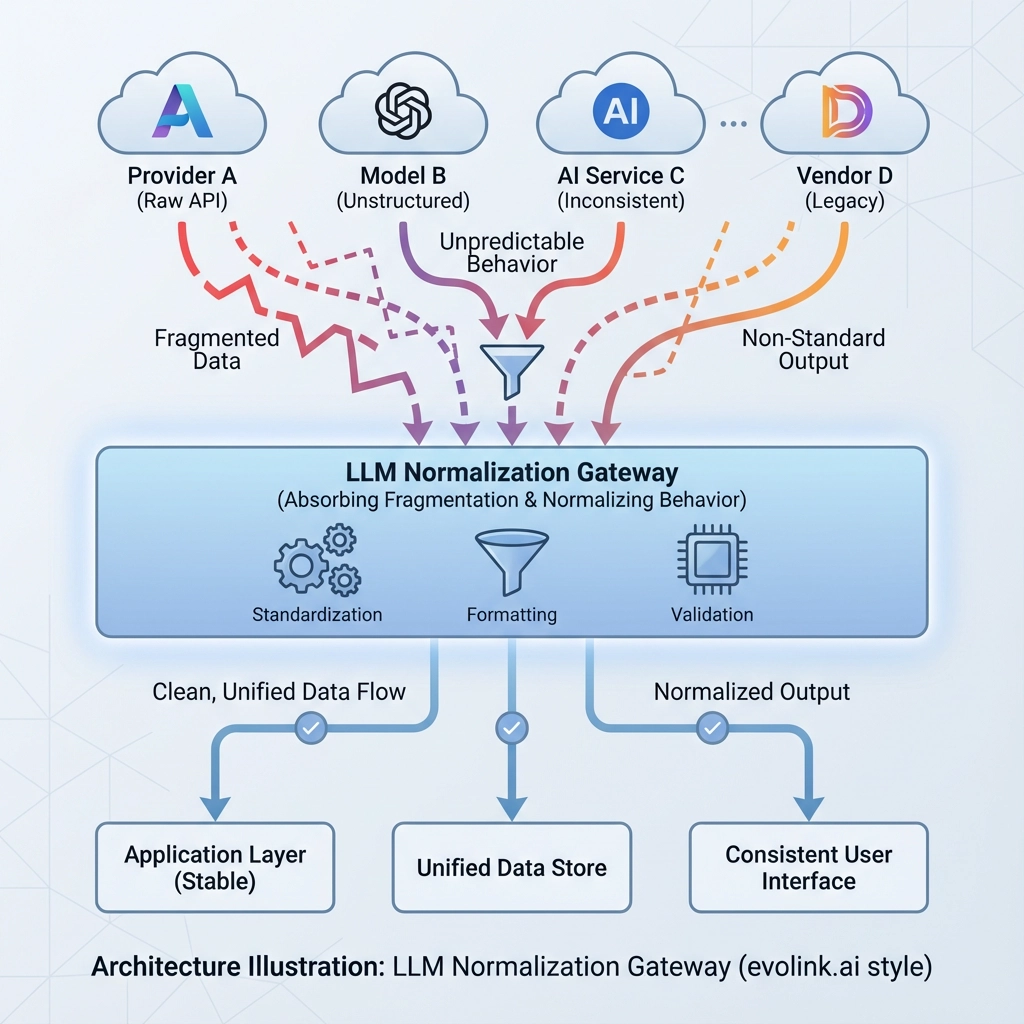

표준화에서 정규화로

LLM API는 생태계가 너무 빨리 움직여서 수렴할 수 없기 때문에 표준화되지 않았습니다. 성숙한 팀은 기다리는 대신 아키텍처를 발전시킵니다.

-

비즈니스 로직은 모델에 구애받지 않습니다.

-

API 문제는 정규화된 게이트웨이 계층에 의해 흡수됩니다.

최종 테이크아웃

LLM API는 표준화되어 있지 않으며 조만간 표준화되지도 않을 것입니다.

"OpenAI 호환" API는 온보딩 마찰을 줄이지만 생산 위험을 제거하지는 않습니다.

조각화를 위해 설계된 시스템은 더 오래 지속됩니다.

FAQ(AI 개요 및 특집 내용)

LLM API가 표준화되지 않은 이유는 무엇인가요?

LLM API는 공급자가 추론 깊이, 대기 시간, 다중 양식 및 안전성과 같은 다양한 기능을 최적화하기 때문에 표준화되지 않았습니다.엄격한 표준은 혁신을 지연시키거나 고급 기능을 숨길 수 있습니다.

OpenAI 호환 API만으로는 충분하지 않은 이유는 무엇인가요?

"OpenAI-호환"은 일반적으로 요청 형태의 유사성만 보장합니다.프로덕션에서는 도구 호출, 추론 토큰 계산, 스트리밍 및 오류 처리의 차이로 인해 호환성이 손상됩니다.

LLM API 조각화 문제란 무엇인가요?

LLM API 단편화 문제는 유사해 보이는 API가 실제 작업 부하에서 다르게 동작하여 개발자가 글루 코드를 작성하고 마이그레이션을 복잡하게 만드는 문제를 의미합니다.

팀에서는 LLM API 단편화를 어떻게 처리하나요?

대부분의 성숙한 팀은 공급자 차이를 흡수하는 게이트웨이 계층 뒤에서 API 동작을 표준화하여 비즈니스 논리를 안정적으로 유지합니다.