GPT-5.4 vs Claude Opus 4.6 vs Gemini 3.1 Pro: 2026 플래그십 모델 비교

마지막 업데이트: 2026년 3월 6일 · 가격 기준 2026년 3월

아래는 상세 분석입니다.

TL;DR

- Gemini 3.1 Pro: $2.00/$12.00(1M tokens), 1M 컨텍스트, SWE‑bench 80.6%.

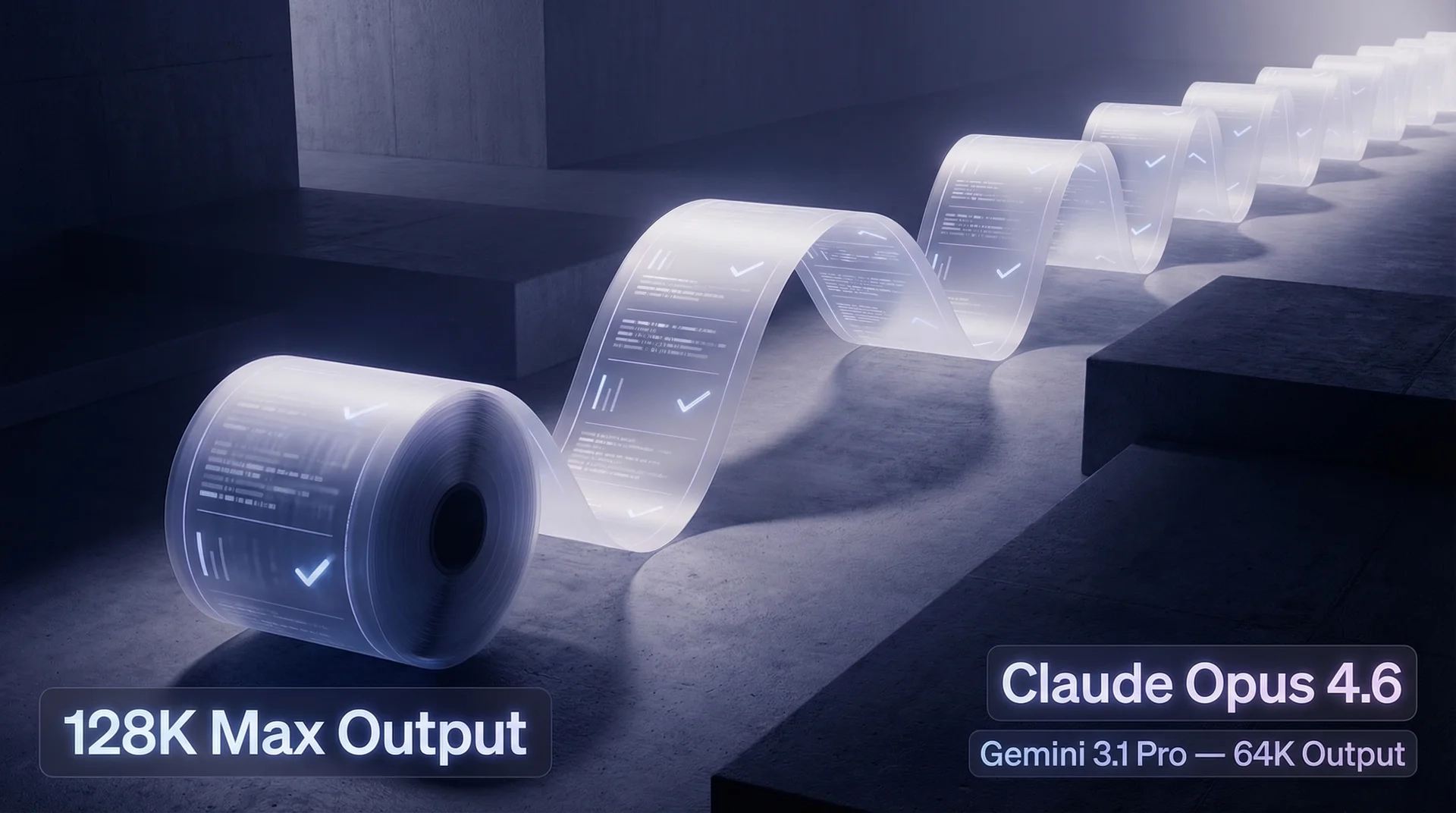

- Claude Opus 4.6: SWE‑bench 80.8%(single attempt)/81.42%(prompt mod), 최대 출력 128K, Agent Teams. 단 >200K는 프리미엄 가격($10/$37.50/1M).

- GPT‑5.4: OpenRouter 기준 $2.50/$20(1M tokens), 캐시 입력 $0.625, 1M 컨텍스트, 128K 최대 출력. 독립 벤치마크 커버리지는 아직 제한적.

- 예산 민감 팀: GPT‑5.2는 $1.75/$14, 400K, SWE‑bench 80.0%로 여전히 경쟁력.

- GPT‑5.4 때문에 출시를 미루지 말고, Gemini/Opus로 구축하면서 GPT‑5.4를 병행 평가하세요.

빠른 비교

| Claude Opus 4.6 | Gemini 3.1 Pro | GPT-5.4 (OpenRouter) | GPT-5.2 | |

|---|---|---|---|---|

| 제공사 | Anthropic | Google DeepMind | OpenAI | OpenAI |

| 상태 | ✅ 사용 가능 | ✅ 사용 가능 | ✅ OpenRouter 통해 사용 가능 | ✅ 사용 가능 |

| 컨텍스트 | 200K (1M beta, tier 4/custom limits) | 1M | 1M | 400K |

| 최대 출력 | 128K tokens | 64K tokens | 128K tokens | 128K tokens |

| 입력 (/1M) | $5.00 (≤200K) / $10.00 (>200K) | $2.00 (≤200K) / $4.00 (>200K) | $2.50 (캐시 입력: $0.625) | $1.75 |

| 출력 (/1M) | $25.00 (≤200K) / $37.50 (>200K) | $12.00 (≤200K) / $18.00 (>200K) | $20.00 | $14.00 |

| 추론 | 확장 사고 | 표준 | 공개 모드 명칭은 아직 제한적 | 표준 + 심화 사고 |

| SWE-bench | 80.8% (single) / 81.42% (prompt mod.) | 80.6% (single) | 널리 합의된 공개 수치는 아직 없음 | 80.0% |

| 적합한 용도 | 복잡한 코딩, 에이전트 오케스트레이션 | 긴 컨텍스트, 멀티모달, 가성비 | 미정 | 예산형 코딩, 일반 용도 |

출처: anthropic.com/pricing · anthropic.com/docs/models/claude-opus-4-6 · ai.google.dev pricing · deepmind.google model card · platform.openai.com/docs/models/gpt-5.2 · openrouter.ai/openai/gpt-5.4

모델 선택 가이드

최고의 코드 품질이 필요하면 Claude Opus 4.6

DeepMind 비교표 기준 Opus 4.6은 SWE‑bench 80.8%(single attempt). Anthropic은 prompt modification으로 81.42%를 보고(25회 평균)합니다. 최대 출력 128K.

Agent Teams는 멀티 에이전트에 유용.

비용은 ≤200K $5/$25, >200K $10/$37.50. Gemini 대비 비율은 거의 동일(입력 2.5×, 출력 ~2.08×).

가성비 우선이라면 Gemini 3.1 Pro

1M 컨텍스트와 낮은 가격을 동시에 제공. $2.00/$12.00(≤200K)로 Opus의 절반 이하, SWE‑bench 차이는 0.2포인트.

강점: GPQA Diamond 94.3%, ARC‑AGI‑2 77.1%, HLE 44.4%, Terminal‑Bench 2.0 68.5%, 네이티브 멀티모달.

제약: 최대 출력 64K.

GPT‑5.4는 기다리기보다 통제된 롤아웃으로 평가

OpenRouter 공개 기준:

- 1M 컨텍스트

- 128K 최대 출력

- $2.50 / 1M 입력, $0.625 / 1M 캐시 입력, $20.00 / 1M 출력

아직 부족한 것은 실제 프로덕션 워크로드 전반의 독립 벤치마크 커버리지입니다.

실무적으로는 Gemini/Opus를 주 경로로 유지하고 GPT‑5.4를 소량 트래픽으로 라우팅 평가한 뒤 단계적으로 확대하는 것이 안전합니다.

컨텍스트 창 심화

| 모델 | 컨텍스트 윈도우 | 비고 |

|---|---|---|

| Gemini 3.1 Pro | 1M tokens | 프로덕션 사용 가능한 1M 컨텍스트 |

| GPT-5.4 | 1M tokens | OpenRouter 등재 |

| GPT-5.2 | 400K tokens | 현재 사용 가능 |

| Claude Opus 4.6 | 200K (1M beta) | 1M beta는 tier 4/custom limits 제한 |

Opus 1M beta는 usage tier 4/custom limits 제한.

추론 능력 심화

| 모델 | 추론 모드 | 핵심 강점 |

|---|---|---|

| Claude Opus 4.6 | 확장 사고 | 다단계 디버깅, 아키텍처 설계 |

| Gemini 3.1 Pro | 표준(사고 지원 포함) | GPQA Diamond 94.3%, ARC-AGI-2 77.1% |

| GPT-5.4 | 공개 모드 명칭은 아직 제한적 | 자체 평가 세트로 검증 권장 |

Opus는 구조적 추론에, Gemini는 과학 추론에 강함.

가격/비용 심화

작업별 비용(추정)

| 작업 | 토큰(입력/출력) | GPT-5.2 | Gemini 3.1 Pro | Claude Opus 4.6 |

|---|---|---|---|---|

| 단순 채팅 | 1K / 500 | $0.009 | $0.008 | $0.018 |

| 코드 리뷰(단일 파일) | 5K / 2K | $0.037 | $0.034 | $0.075 |

| 장문서 분석 | 100K / 5K | $0.245 | $0.260 | $0.625 |

| 전체 코드베이스(200K+ 컨텍스트) | 300K / 10K | $0.665 | $1.380* | $3.375** |

*Gemini 3.1 Pro >200K: $4.00/$18.00 per 1M

**Claude Opus 4.6 >200K: $10.00/$37.50 per 1M

고컨텍스트에서는 가격이 함께 상승하지만 비율은 비슷. 절대 격차는 확대.

EvoLink(evolink.ai/models)로 할인된 단일 API 사용 가능.

코딩 성능 심화

| 모델 | SWE-bench | 조건 | 출처 |

|---|---|---|---|

| Claude Opus 4.6 | 80.8% (single) / 81.42% (prompt mod.) | 혼합 출처 | deepmind.google model card / anthropic.com/news/claude-opus-4-6 |

| Gemini 3.1 Pro | 80.6% (single) | Google 평가 | deepmind.google model card |

| GPT-5.2 | 80.0% | OpenAI 평가 | platform.openai.com |

| GPT-5.4 | 널리 합의된 공개 수치는 아직 없음 | — | OpenRouter 사용 가능 |

0.2% 차이는 평가 조건 차이일 수 있음.

실무 차이: Opus 128K 출력, Gemini 1M 컨텍스트, GPT‑5.2 최저가.

의사결정 프레임워크

예산?

→ GPT‑5.2 또는 Gemini 3.1 Pro

200K 초과 컨텍스트가 필요?

→ Gemini 3.1 Pro 또는 GPT‑5.4를 라우팅 트래픽으로 파일럿

최고의 코드 품질?

→ Claude Opus 4.6

멀티모달?

→ Gemini 3.1 Pro

멀티 에이전트?

→ Claude Opus 4.6

과학적 추론?

→ Gemini 3.1 Pro (GPQA Diamond 94.3%)

하나의 API로 여러 모델 사용?

→ EvoLink(evolink.ai)가 통합 OpenAI 호환 엔드포인트를 제공합니다. 코드 변경 없이 모델을 전환하세요.

FAQ

GPT‑5.4가 Opus 4.6보다 좋나요?

아직 미정. Opus 4.6은 80.8%(single attempt), 81.42%(prompt mod).

어느 쪽이 더 저렴한가요?

Gemini 3.1 Pro. ≤200K $2/$12, >200K $4/$18. Opus는 $5/$25, $10/$37.50.

컨텍스트는?

Gemini 3.1 Pro는 1M.

GPT‑5.4는 지금 사용 가능한가요?

openai/gpt-5.4)에서 가격/한도 정보와 함께 사용 가능합니다. 공급 채널과 계약에 따라 실제 가용성/과금은 달라질 수 있습니다.Opus 4.6에서 1M 사용 가능?

기본 200K, 1M beta는 tier 4/custom limits 제한.

코딩 최강?

single attempt: Opus 80.8%, Gemini 80.6%, GPT‑5.2 80.0%.

멀티모달은?

Gemini 3.1 Pro가 네이티브 지원.

마지막 확인: 2026‑03‑06.