Plongée approfondie dans GPT-5.2 : Benchmarks de production, migration d'API et analyse des coûts

L'arrivée de GPT-5.2 en décembre 2025 marque un changement de paradigme significatif dans le développement de l'IA. Nous passons de modèles qui génèrent simplement du texte plausible à des systèmes capables d'un raisonnement fiable. Pour les ingénieurs et les CTO, il ne s'agit pas seulement d'une mise à niveau incrémentielle ; c'est un changement fondamental dans la façon dont nous pouvons concevoir et déployer des applications critiques. GPT-5.2 n'est pas seulement « plus intelligent », il est optimisé pour les flux de travail complexes et à haute simultanéité qui définissent les logiciels d'entreprise modernes.

Points clés à retenir

- Raisonnement avancé : GPT-5.2 démontre un bond significatif dans le raisonnement logique « Système 2 », réduisant les hallucinations et permettant la résolution de problèmes plus complexes en une seule passe.

- Prêt pour la production ? : Bien qu'immensément puissant, le modèle introduit un compromis critique entre intelligence, latence et coût. Ce n'est pas un remplacement universel pour GPT-4o.

- Capacités agentiques : L'appel de fonctions et le respect du mode JSON, considérablement améliorés, en font un choix supérieur pour construire des agents autonomes fiables et des pipelines d'extraction de données structurées.

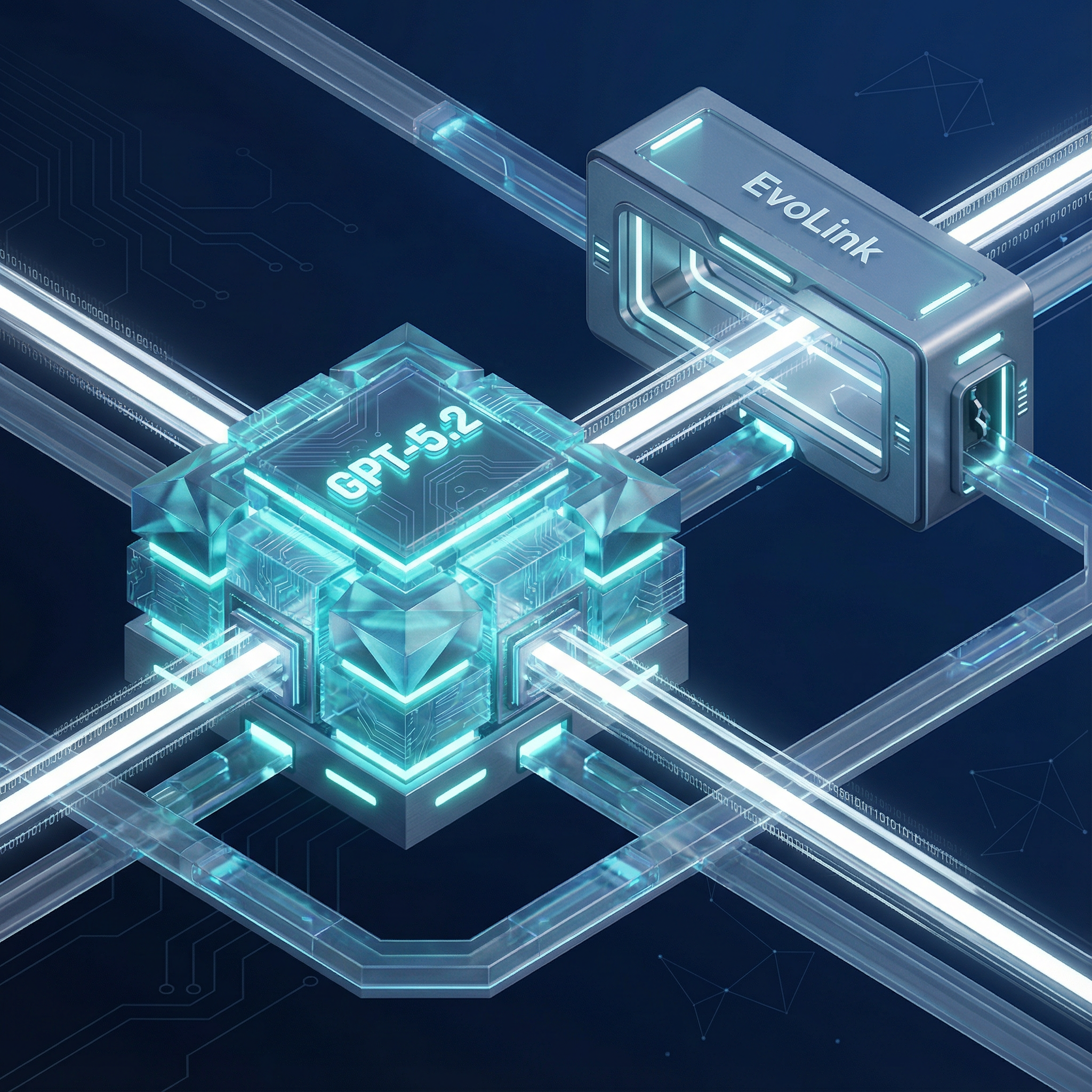

- Intégration & Coût : L'accès direct est limité et coûteux. Une couche API unifiée comme EvoLink est essentielle pour gérer les coûts, assurer la fiabilité avec des replis de modèles et simplifier l'intégration.

Qu'est-ce que GPT-5.2 : Aperçu de l'architecture

GPT-5.2 représente une évolution architecturale majeure. Bien qu'OpenAI reste discret sur l'implémentation exacte, les gains de performance indiquent des avancées clés :

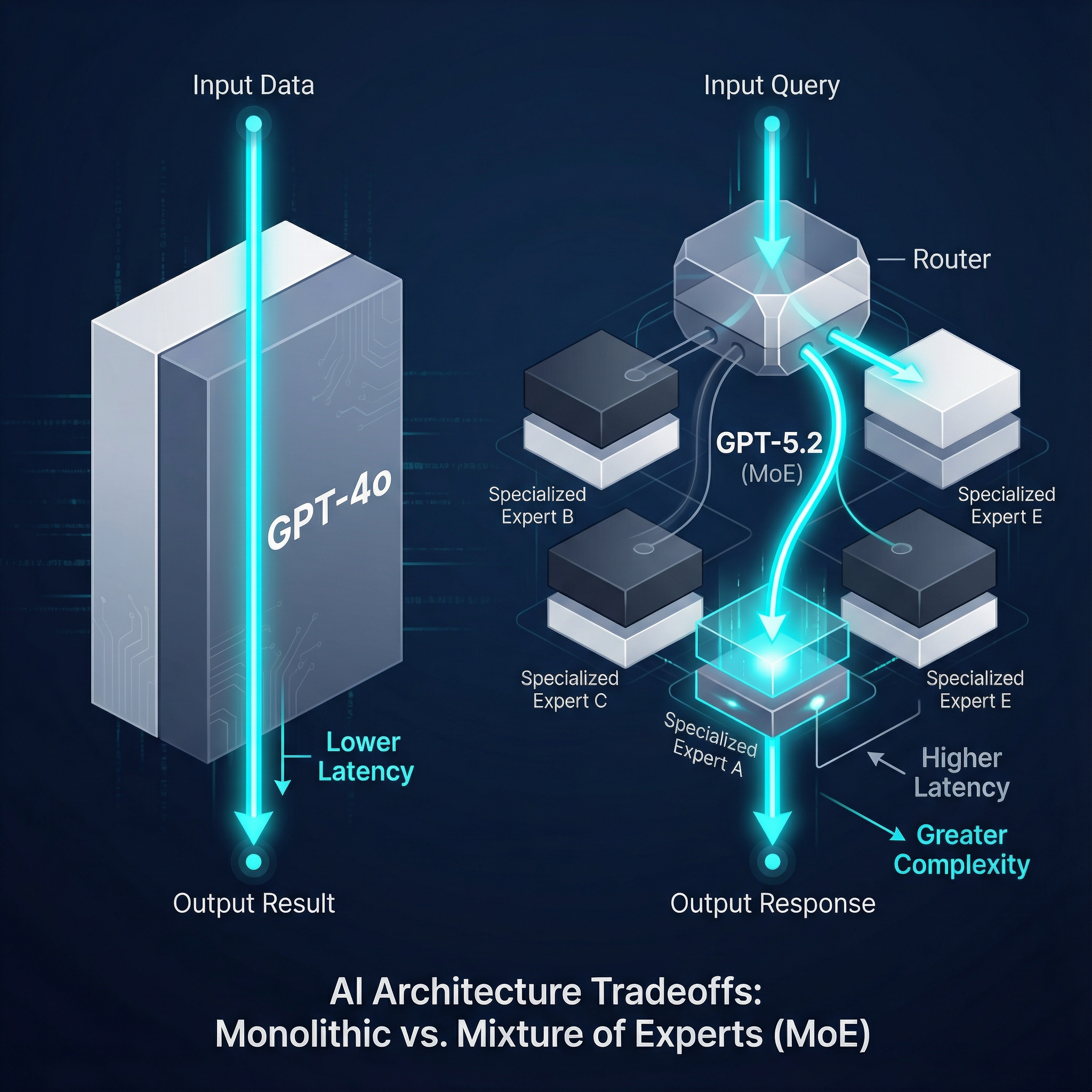

- Architecture : Largement considéré comme un modèle sophistiqué de mélange d'experts (Mixture of Experts - MoE). Contrairement à ses prédécesseurs, il route probablement les requêtes vers des sous-réseaux spécialisés, améliorant l'efficacité et la capacité sur des tâches spécifiques au domaine (par exemple, le codage vs l'écriture créative).

- Fenêtre contextuelle : Étendue à un robuste 400K jetons, permettant une analyse plus approfondie de grands documents, de bases de code ou d'historiques de conversation complexes.

- Multimodalité : GPT-5.2 est nativement multimodal, traitant les entrées texte, image et audio avec une compréhension plus unifiée. Cela lui permet d'interpréter instantanément des visualisations de données complexes, des interfaces utilisateur et des signaux audio, sans enchaîner des modèles séparés.

- Jetons de raisonnement : Les spéculations pointent vers un nouveau mécanisme, peut-être des « jetons de raisonnement », qui permet au modèle d'effectuer une réflexion « Système 2 » plus explicite avant de générer une réponse finale, améliorant ses performances sur des problèmes logiques et mathématiques complexes.

Pourquoi GPT-5.2 compte pour les systèmes de production

Pour ceux qui construisent des produits du monde réel, la valeur d'un nouveau modèle se mesure en fiabilité et en performance, pas seulement en scores de benchmark.

1. Fiabilité

L'avancée la plus significative est la réduction spectaculaire des taux d'hallucination. Pour les applications critiques dans l'analyse juridique, médicale ou financière, cette fiabilité accrue fait passer le curseur de « expérimental » à « fiable ».

2. Profondeur de raisonnement

Là où GPT-4 nécessitait souvent des chaînes d'invites (prompt chains) complexes pour déconstruire un problème, GPT-5.2 peut gérer une logique multi-étapes en une seule inférence. Cela simplifie l'architecture de l'application et réduit les points de défaillance.

3. Capacité agentique

L'appel de fonctions et le mode JSON sont désormais « solides comme le roc », selon les premiers retours des développeurs. La capacité du modèle à respecter de manière fiable les formats de données structurées en fait le nouveau standard pour propulser des agents autonomes et des flux de travail pilotés par API prévisibles.

Le compromis

Ce saut en intelligence a un coût. GPT-5.2 a une latence plus élevée et un prix par jeton plus élevé que ses prédécesseurs. Le défi d'ingénierie central n'est plus « Le modèle est-il assez intelligent ? » mais « L'intelligence ajoutée vaut-elle la latence et le coût pour ce cas d'utilisation spécifique ? »

Débloquez GPT-5.2 pour votre environnement de production

Fatigué des listes d'attente et des coûts imprévisibles ? Obtenez un accès immédiat et évolutif à l'API GPT-5.2 sans friction. EvoLink fournit une API unifiée avec des prix de gros et une fiabilité de niveau entreprise.

Capacités principales et forces

Les forces de GPT-5.2 sont les plus apparentes dans les tâches nécessitant une expertise approfondie et de la précision.

-

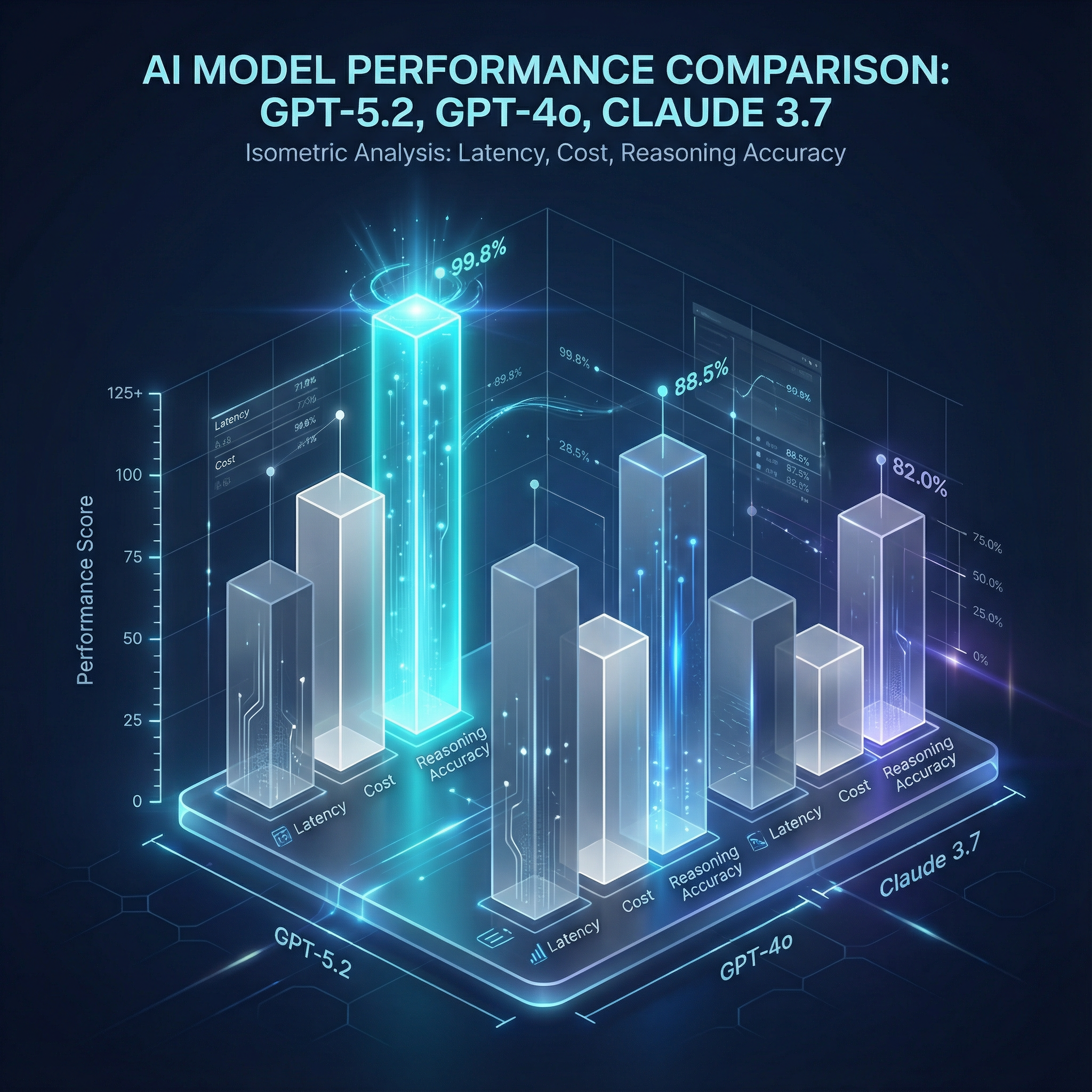

Raisonnement avancé : Surpasse GPT-4o et Claude 3.7 sur des benchmarks clés comme MATH et GSM8K, démontrant sa capacité à résoudre des problèmes mathématiques et logiques de niveau universitaire.

-

Compétence en codage : Montre des améliorations significatives sur HumanEval et SWE-bench. Il peut non seulement générer du code mais aussi comprendre et déboguer des dépôts complexes, ce qui en fait un puissant programmeur en binôme.

-

Fluidité multimodale : Peut analyser instantanément des graphiques financiers, expliquer des captures d'écran d'interface utilisateur à un script d'automatisation, ou transcrire et résumer de l'audio — le tout via un seul appel API.

-

Rappel de contexte long : excelle dans les tests « Aiguille dans une botte de foin », rappelant avec précision des faits spécifiques enfouis profondément dans sa fenêtre contextuelle de 400K jetons. C'est critique pour les systèmes RAG analysant des documents de recherche denses ou des documents juridiques.

Benchmarks & Compromis (Les "vrais" chiffres)

Bien que les benchmarks racontent une partie de l'histoire, les métriques de production comptent davantage. Voici une comparaison pragmatique basée sur les premières données et les rapports de la communauté.

| Modèle | Coût d'entrée ($/1M jetons) | Coût de sortie ($/1M jetons) | Fenêtre contextuelle |

|---|---|---|---|

| GPT-5.2 | 1,75 $ | 14,00 $ | 400K |

| GPT-4o | 1,25 $ | 10,00 $ | 128K |

| Claude 3.7 | 1,50 $ | 12,00 $ | 200K |

| Llama 4 (Open) | 0,50 $ | 4,00 $ | 100K |

Métriques clés

-

Latence (TTFT) : Le temps jusqu'au premier jeton (Time To First Token) de GPT-5.2 est nettement plus élevé que celui de GPT-4o. Pour les chatbots conversationnels en temps réel, cela peut dégrader l'expérience utilisateur. Il est mieux adapté aux tâches asynchrones où quelques secondes de temps de traitement sont acceptables.

-

Coût par jeton : À 1,75 $ (entrée) et 14,00 $ (sortie) par million de jetons, c'est l'option premium. Une tâche complexe qui est moins chère sur GPT-5.2 (en raison de moins de nouvelles tentatives) pourrait toujours coûter plus cher en termes absolus qu'une approche par invite chaînée sur GPT-4o.

-

Débit (TPS) : Les fournisseurs officiels imposent souvent des limites de débit strictes (accès « Tier 5 »), ce qui rend la mise à l'échelle difficile. Les systèmes de production nécessitent une solution capable de gérer un nombre élevé de jetons par seconde (TPS) et de gérer la simultanéité, un avantage clé de l'utilisation d'une passerelle API comme EvoLink.

Sentiment des développeurs et aperçus de la communauté

La réaction de la communauté des ingénieurs a été pragmatique et perspicace, coupant court au battage médiatique.

Éloges

« Résout enfin des tâches logiques complexes avec moins d'hallucinations. Nous avons remplacé une chaîne d'invites de 5 étapes par un seul appel à GPT-5.2. »

« Le mode JSON est solide comme le roc pour les réponses API. Nous voyons une conformité de 99,9 %, ce qui était inouï avec les modèles précédents. »

Plaintes

« Une latence plus élevée pour des sorties plus intelligentes. C'est difficile à vendre pour nos fonctionnalités interactives. »

« La migration s'est bien passée, mais le coût par jeton s'accumule rapidement. Vous devez être très délibéré sur les tâches que vous lui confiez. »

Un thème récurrent sur les forums de développeurs est le calcul « coût vs capacité ». Un utilisateur de Reddit a noté :

« La fonctionnalité de repli d'EvoLink nous a sauvés pendant les pics de charge. Nous routons les requêtes simples vers 4o et n'utilisons 5.2 que pour le gros travail. C'est la seule façon de rendre l'économie viable. »

Tarification et efficacité des coûts

Exécuter GPT-5.2 à grande échelle est un engagement financier important. Le problème de l'accès « Tier 5 » via les fournisseurs officiels signifie que de nombreuses entreprises se heurtent à un mur en raison de limites de débit strictes et de listes d'attente. De plus, la gestion de la facturation entre plusieurs modèles et fournisseurs crée des frais généraux opérationnels inutiles. C'est là qu'une couche d'infrastructure API devient critique. EvoLink répond directement à ces défis :

-

Tarification de gros en volume : En agrégeant la demande, EvoLink offre un accès à des modèles comme GPT-5.2 à des tarifs réduits par volume qui sont généralement indisponibles pour les entreprises individuelles.

-

Facturation unifiée : Consolidez les dépenses entre GPT-5.2, GPT-4o, Claude et d'autres modèles en une seule facture. Cela simplifie le suivi des coûts et la gestion budgétaire pour l'ensemble de votre pile IA.

-

Routage intelligent et replis : Ne payez pas des prix premium pour des tâches simples. Utilisez EvoLink pour router dynamiquement les requêtes vers le modèle le plus rentable capable de gérer le travail, avec des replis automatiques pour assurer la disponibilité.

Comment intégrer GPT-5.2 via API

base_url vers le point de terminaison EvoLink. Ce seul changement débloque le routage indépendant du modèle, les replis et l'optimisation des coûts sans altérer la logique principale de votre application.Voici un extrait Python propre démontrant un appel en streaming vers GPT-5.2 via la passerelle API EvoLink.

import requests

url = "https://api.evolink.ai/v1/chat/completions"

payload = {

"model": "gpt-5.2",

"messages": [

{

"role": "user",

"content": "Please introduce yourself"

}

],

"temperature": 1,

"stream": False,

"top_p": 1,

"frequency_penalty": 0,

"presence_penalty": 0

}

headers = {

"Authorization": "Bearer <token>",

"Content-Type": "application/json"

}

response = requests.post(url, json=payload, headers=headers)

print(response.text)Liste de contrôle de migration : Votre application est-elle prête pour GPT-5.2 ?

- Identifier les cas d'utilisation à haute valeur : Repérez les tâches où un raisonnement profond et une faible hallucination sont critiques (par exemple, analyse de contrats juridiques, génération de code complexe).

- Évaluer la tolérance à la latence : Votre expérience utilisateur peut-elle tolérer un temps de réponse légèrement plus long pour une réponse beaucoup plus intelligente ?

- Implémenter un routeur/passerelle : Utilisez un service comme EvoLink pour éviter le verrouillage fournisseur et permettre une commutation dynamique entre GPT-5.2 et des modèles plus économiques comme GPT-4o.

- Réécrire les invites critiques : Bien que de nombreuses invites fonctionnent telles quelles, affinez vos invites système les plus importantes pour tirer parti des capacités de raisonnement avancées de GPT-5.2.

- Surveiller les coûts de près : Configurez des tableaux de bord pour suivre la consommation de jetons. Le coût de GPT-5.2 peut augmenter rapidement s'il est utilisé pour chaque requête unique.

Cas d'utilisation et guide de décision

Choisir le bon modèle est une décision architecturale critique.

Quand utiliser GPT-5.2

-

Agents autonomes : Lors de la construction d'agents qui doivent effectuer des tâches multi-étapes avec une haute fiabilité et utiliser des outils (appels de fonctions) correctement à chaque fois.

-

RAG complexe : Pour les systèmes de questions-réponses qui doivent synthétiser des informations à partir de plusieurs documents techniques denses avec une haute fidélité.

-

Assistants de codage avancés : Pour les outils qui doivent comprendre des bases de code entières, générer une logique complexe et identifier des bugs subtils.

-

Analyse juridique et médicale : Dans les domaines où la précision n'est pas négociable et les hallucinations sont inacceptables.

Quand rester sur GPT-4o / Mini

-

Classifieurs à fort volume : Pour la classification de texte simple, l'analyse de sentiment ou l'extraction de données où la vitesse et le faible coût sont primordiaux.

-

Chatbots simples : Lorsque l'objectif est la fluidité conversationnelle et des réponses rapides plutôt qu'une résolution de problèmes approfondie.

-

Flux critiques en latence : Pour les applications en temps réel comme la transcription en direct ou les suggestions de recherche interactives où chaque milliseconde compte.

Conclusion : Le chemin de mise à niveau stratégique

GPT-5.2 est plus qu'un nouveau modèle puissant ; c'est un outil spécialisé pour des tâches de raisonnement à enjeux élevés. Une mise à niveau générale de tous vos flux de travail d'IA vers GPT-5.2 n'est pas seulement impraticable en raison du coût et de la latence — c'est une mauvaise ingénierie.

L'avenir de l'IA de production ne consiste pas à trouver le seul « meilleur » modèle, mais à construire un système flexible, intelligent et conscient des coûts.

Foire aux questions (FAQ)

1. Comment la tarification de GPT-5.2 se compare-t-elle à celle de GPT-4o ?

GPT-5.2 est nettement plus cher par jeton. En moyenne, vous pouvez vous attendre à des coûts d'entrée environ 40 % plus élevés et des coûts de sortie environ 40 % plus élevés que GPT-4o. Cela rend les stratégies de gestion des coûts essentielles.

2. L'ingénierie des invites (prompt engineering) est-elle différente pour GPT-5.2 ?

Bien que de nombreuses invites fonctionnent telles quelles, vous n'exploitez peut-être pas toute sa puissance. Les invites peuvent être simplifiées, avec moins besoin de « chaîne de pensée » (chain-of-thought) ou d'exemples few-shot, car le raisonnement inhérent du modèle est plus fort.

3. Quelle est la fiabilité du mode JSON de GPT-5.2 ?

Extrêmement fiable. Les retours des développeurs indiquent que c'est l'une des fonctionnalités les plus remarquables du modèle, le rendant parfait pour l'extraction de données structurées et la construction de flux de travail agentiques fiables.

4. Quels sont les principaux avantages de l'utilisation d'EvoLink pour GPT-5.2 ?

EvoLink fournit une API unifiée pour accéder à GPT-5.2 aux côtés d'autres modèles, une facturation consolidée, des remises sur les prix de gros, un routage intelligent pour optimiser les coûts et des capacités de repli pour améliorer la fiabilité.

5. Comment la fenêtre contextuelle de GPT-5.2 se compare-t-elle à celle de Claude 3.7 ?

GPT-5.2 dispose d'une fenêtre contextuelle de 400K jetons, ce qui est le double de la fenêtre contextuelle de 200K de Claude 3.7. Cela lui permet de traiter et d'analyser des volumes d'informations beaucoup plus importants en une seule passe.