2026 年の LLM TCO: トークンコストが実際の価格の一部にすぎない理由

2026 年の LLM TCO: トークンコストが実際の価格の一部にすぎない理由

ほとんどのチームは、100 万トークンあたりの価格という単一の指標を使用して LLM 機能のコストを見積もります。

この指標は重要ですが、それは紙の上でのみです。

実際の運用システムでは、LLM の総所有コスト (TCO) は、多くの場合、トークンの支出だけでなく、統合作業、信頼性の修正、迅速なメンテナンス、時間の経過とともに AI ROI を静かに侵食する評価ギャップなどのエンジニアリングのオーバーヘッドによって左右されます。

このガイドでは、LLM 統合の隠れたコストについて説明し、資金とエンジニアリング時間が実際にどこに費やされているかを特定するための実践的なフレームワークを提供します。

- Glue Code — 現在進行中の統合税

- 負債の評価 — 不確実性のコスト

- プロンプト ドリフト — 終わりのない移行

10 分間の LLM TCO 自己監査

さらに詳しく説明する前に、次の 5 つの質問に答えてください。

- 現在、システムはいくつのモデルまたはプロバイダーをサポートしていますか (計画中のものを含む)。

- プロバイダー固有のアダプターまたは条件分岐を保守していますか?

- モデルが変更されるたびに自動評価を実行しますか?

- プロンプトやビジネス ロジックを書き換えずにトラフィックを別のモデルに再ルーティングできますか?

- コスト、レイテンシー、障害率を一元的に把握できますか?

隠れたコスト #1 — グルー コード: 統合税

グルー コードは、ユーザー向けの価値を生み出すことのないエンジニアリング作業ですが、プロバイダー間の差異を正規化するために必要です。

それは 3 つの予測可能な領域で成長します。

1) 使用状況とコンテキストの管理

複数のモデルが関係すると、使用量のアカウンティングは均一ではなくなります。

グルー コードの一般的なソースには次のものがあります。

- コンテキストウィンドウの計算と切り捨て

- 「安全な最大出力」ガード

- 使用法フィールドが矛盾しているか欠落している

コンテキスト オーバーフローは、エラーだけでなく、再試行、部分的な出力、予期せぬ支出を引き起こすことがよくあります。

2) 信頼性と障害の正規化

異なる API は根本的に異なる方法で失敗します。

- 構造化 API エラーとトランスポート レベルのエラー

- スロットル タイムアウトとサイレント タイムアウト

- 部分的なストリーミングと突然の切断

これにより、「再試行を追加するだけ」が成長する意思決定ツリーに変わります。

# 例示的な例: プロバイダーに依存しない障害の正規化

def should_retry(err) -> bool:

if getattr(err, "status", None) in (408, 429, 500, 502, 503, 504):

return True

if "timeout" in str(err).lower() or "connection" in str(err).lower():

return True

return Falseこのコードはシステムを存続させますが、製品の差別化には何も追加しません。

3) ツールの呼び出しと構造化された出力

ツールや厳密な JSON 出力に依存した瞬間、チャット API ではなくプロトコルが統合されます。

同様のリクエスト形式を受け入れる API であっても、次の点で異なる場合があります。

- 応答にツール呼び出しが現れる場所

- 引数のエンコード方法

- 厳密に構造化された出力がどのように適用されるか

これは、LLM API の断片化の直接的な結果です。

接着剤コードの臭いテスト

次の場合、統合税を支払うことになります。

- プロバイダーによるフォークのプロンプト

- ストリーミング パーサーはモデルごとに異なります

- アダプターは時間の経過とともに増加します

- オブザーバビリティは機能中心ではなくプロバイダ中心です

隠れたコスト #2 — 負債の評価: 不確実性のコスト

チームが実際のワークフローに関連付けられた自動評価を行わずにモデルをデプロイすると、評価負債が蓄積します。

結果は予測可能です。

- 移住は危険だと感じる

- 安価または高速なモデルは使用されなくなります

- チームは高価なデフォルトに固執する

- AI の ROI は時間の経過とともに低下します

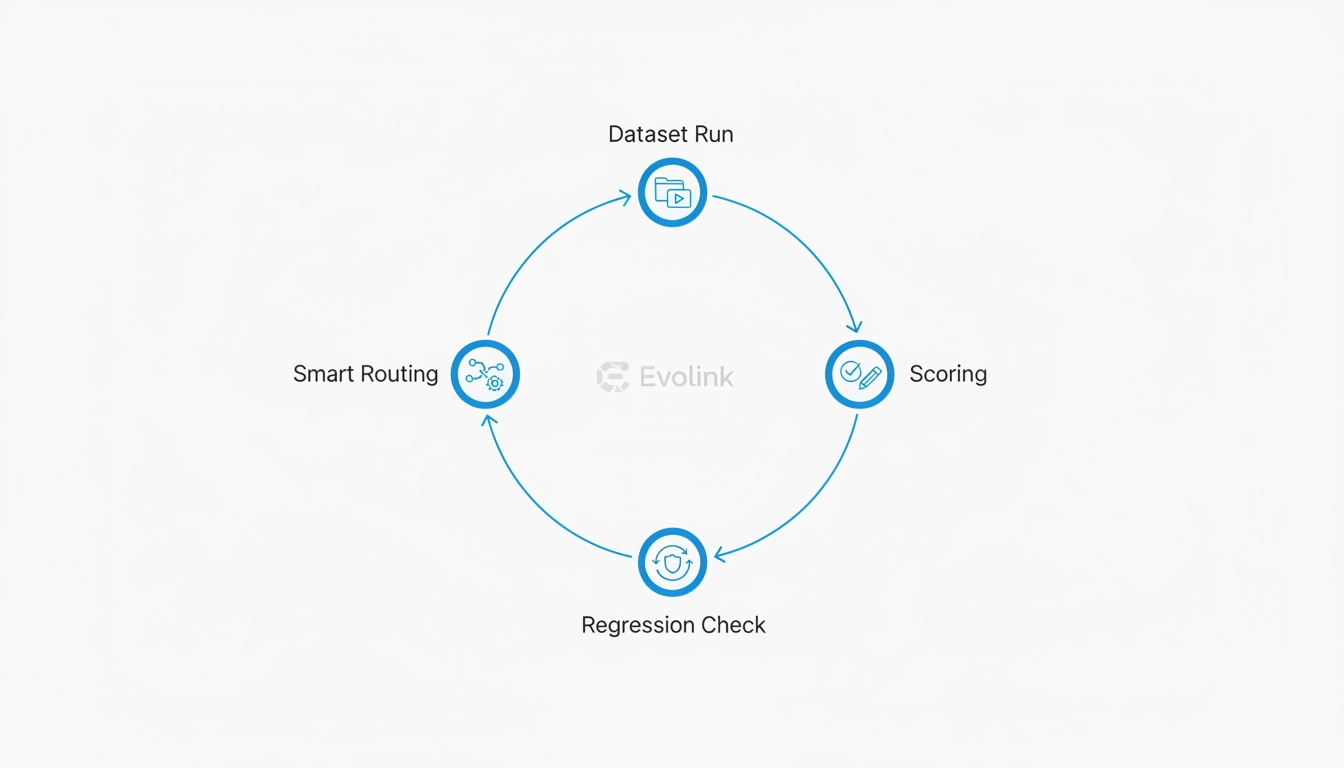

実行可能な最小評価ループ (MVEL)

評価負債を削減するために完全な MLOps プラットフォームは必要ありません。

1 つの質問に答えるループが必要です。

モデルを変更した場合、ユーザーは気づきますか?

多くのチームが 1 ~ 2 日で実装できる実用的なベースライン:

1) 小規模でバージョン管理されたデータセット (50 ~ 300 件)

実際の運用例を使用します。

- 一般的なユーザーフロー

- エッジケース

- 歴史的な失敗

eval/

├── datasets/

│ ├── v1_core.jsonl

│ ├── v1_edges.jsonl

│ └── v1_failures.jsonl

2) 反復可能なバッチ ランナー

1 つのスクリプトでは次のことが可能です。

- モデル間で同じデータセットを実行します

- 出力、レイテンシ、コストを記録します

- ローカルまたはCIで実行

3) 軽量スコアリング (回帰重視)

少なくとも以下を追跡します。

- 形式の有効性

- 必須フィールドが存在します

- レイテンシとコストのしきい値

4) 単純な評価構成

dataset: datasets/v1_core.jsonl

model_targets:

- primary

- candidate

metrics:

- format_validity

- required_fields

thresholds:

format_validity: 0.98

latency_p95_ms: 1200

report:

output: reports/diff.htmlこの構造だけで、移行リスクが劇的に低下します。

隠れたコスト #3 — プロンプト ドリフト: 終わりのない移行

LLM エンジニアリングにおける最も一般的な誤解は次のとおりです。

「後でモデル ID を交換します。」

実際には、モデルには次の点が異なるため、プロンプトは変動します。

- フォーマットの規律

- ツールの使用行動

- 拒否閾値

- 指示に従うスタイル

一般的な障害パターン (プロバイダーに依存しない)

- プロンプトには厳密な JSON 出力が必要です

- モデル A は一貫して準拠しています

- モデル B は短い説明または拒否文を追加します。

- ダウンストリーム解析が失敗する

- エンジニアはプロンプト、パーサー、またはその両方にパッチを適用します

LLM TCO 氷山: コストの実際の発生源

- 目に見えるコスト: トークンの価格

- 隠れたコスト:

- グルーコードのメンテナンス

- 迅速なドリフト修正

- インフラストラクチャの評価

- デバッグ、再試行、ロールバック

マルチモーダル システムに関する注意事項 (画像とビデオ)

この記事では LLM の統合に焦点を当てていますが、同じ TCO フレームワークが画像やビデオの生成などのマルチモーダル システムにさらに強力に適用されます。

テキストを超えて移行すると、エンジニアリングのオーバーヘッドは、非同期ジョブ オーケストレーション、Webhook またはポーリング、一時的な資産ストレージ、帯域幅コスト、タイムアウト処理、非決定的出力の品質評価などにまで拡大します。実際には、これらの要素が、トークン、画像、数秒間のビデオなど、ユニットごとの価格設定を上回ることがよくあります。

このため、実稼働グレードの画像またはビデオのワークフローを構築するチームでは、モデルの価格が机上では安く見えても、純粋なテキスト システムよりもグルー コードと評価のコストが高くなることがよくあります。

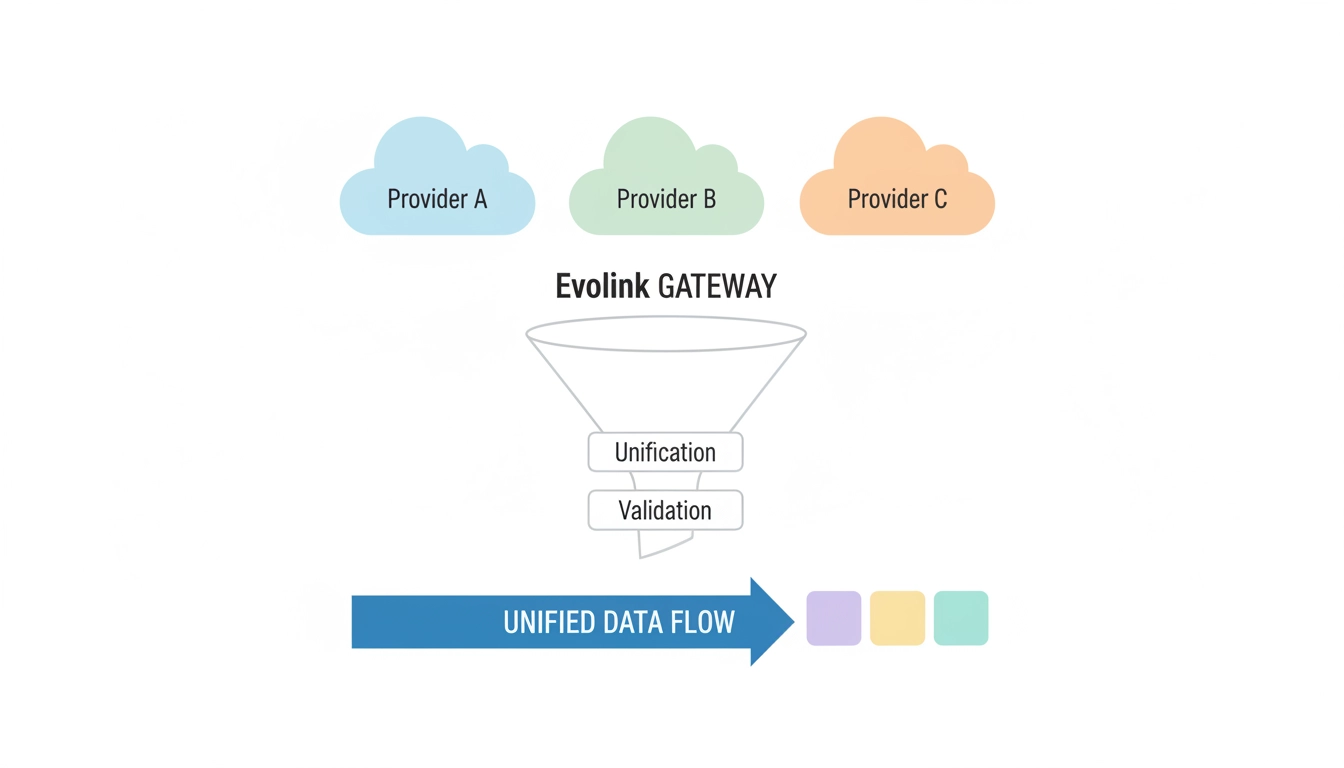

直接統合と正規化されたゲートウェイ

| コストエリア | 直接統合 | 正規化されたゲートウェイ |

|---|---|---|

| トークンコスト | 低変動 | 低変動 |

| 統合の取り組み | 高 | 下 |

| メンテナンス | 連続 | 集中型 |

| 移行速度 | 遅い | より速く |

| 可観測性 | 断片化された | 統合 |

| エンジニアリングのオーバーヘッド | 繰り返し | 連結 |

この段階での本当の決定は、どのモデルを使用するかではなく、この複雑さをどこに配置するかです。

主要なチームは、断片化、ルーティング、可観測性をアプリケーション コードから専用のゲートウェイ層に移行します。

このアーキテクチャの変化こそが Evolink.ai の存在理由です。

FAQ (検索最適化)

LLM 統合の隠れたコストはどのように計算しますか?

トークンの支出だけでなく、統合、評価、迅速なメンテナンス、信頼性の修正、移行に費やしたエンジニアリング時間を考慮します。

マルチ LLM 戦略のエンジニアリング オーバーヘッドはどれくらいですか?

これには、グルー コード、プロンプト ドリフト処理、評価インフラストラクチャ、およびクロスプロバイダーの可観測性が含まれます。

LLM システムにおける評価負債とは何ですか?

評価負債は、自動評価を行わずにモデルを導入することによって引き起こされる蓄積されたリスクであり、将来の変更が遅くなり、コストが高くなります。

LLM ゲートウェイは AI ROI をどのように改善しますか?

正規化、ルーティング、可観測性を一元化することで、チームは機能レベルの統合コードを書き直すことなくモデルを最適化または切り替えることができます。