Ce que le Gala du Nouvel An chinois 2026 a révélé sur la stack IA de ByteDance

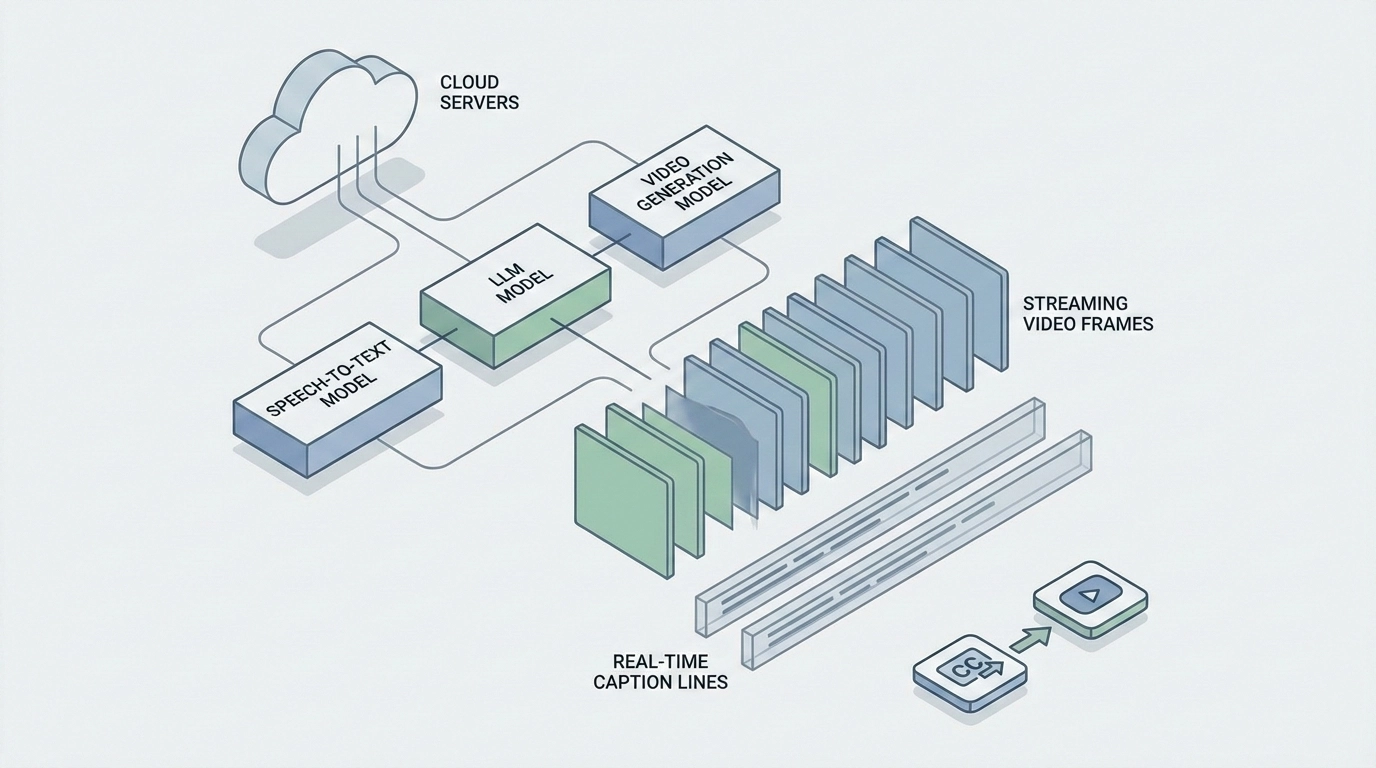

Le gala a montré comment ByteDance positionnait plusieurs couches IA ensemble :

- génération vidéo

- langage et interaction

- infrastructure de production en direct

Pourquoi le gala comptait

| Signal | Pourquoi c'est important |

|---|---|

| L'IA était visible dans une émission nationale grand public | Cela a déplacé la conversation au-delà des démos de laboratoire |

| Plusieurs surfaces IA de ByteDance sont apparues ensemble | Cela suggérait une stack produit coordonnée, pas des expériences isolées |

| Le contexte était en direct, sous haute pression et public | Cela impliquait une confiance dans un déploiement de niveau production |

| Portée vérifiée massive | CMG a rapporté 677 millions de portée en direct tous médias confondus ; l'audience simultanée maximale a dépassé 400 millions |

Seedance 2.0 : ce que cela représentait

L'angle Seedance le plus intéressant n'était pas simplement que des visuels générés par IA sont apparus dans une grande émission.

C'est important parce que Seedance 2.0 est plus facile à comprendre quand on arrête de le considérer comme un générateur de nouveautés et qu'on commence à le voir comme un outil pour :

- la direction visuelle

- le mouvement structuré

- le façonnage de scènes

- le spectacle stylisé à grande échelle

Le contexte du gala a exactement renforcé ce positionnement.

Le moment IA le plus marquant a été He Hua Shen (《贺花神》, « Ode aux divinités des fleurs »), un spectacle de danse où des visuels générés par IA — fleurs en éclosion, eau qui s'écoule et transitions saisonnières — étaient intégrés de manière transparente avec les danseurs en direct. Ce qui rendait cela techniquement remarquable :

- Les gros plans nécessitaient une génération au pixel près — la moindre saccade ou distorsion serait visible par des centaines de millions de téléspectateurs

- Les micro-changements comme l'éclosion lente d'une fleur exigeaient un contrôle temporel précis sur la texture, les couches, la lumière et les ombres

- ByteDance a décrit cela comme un passage du « contenu généré par IA » au « contenu dirigé par IA »

Doubao et la stack ByteDance plus large

Seedance n'était qu'une couche.

| Couche | Ce que le gala a suggéré |

|---|---|

| Génération vidéo | Création visuelle et support de scène de type Seedance |

| Langage / interaction | Surfaces de raisonnement et de communication de type Doubao |

| Infrastructure | Une couche cloud et de production capable de supporter un événement à l'échelle publique |

L'envergure du déploiement était significative :

- Plus de 800 milliards de tokens traités quotidiennement sur la plateforme Volcengine

- Plus d'un million d'entreprises utilisant les services IA de Volcengine dans plus de 100 secteurs d'activité

Cette combinaison est stratégiquement importante. Elle suggère que ByteDance ne cherche pas seulement à améliorer la qualité de modèles isolés. L'entreprise construit un écosystème où différentes composantes IA se renforcent mutuellement.

Pourquoi c'était plus grand qu'une seule performance

Des événements comme le Gala du Nouvel An chinois comptent parce qu'ils changent la perception.

Avant une émission publique comme celle-ci, beaucoup de discussions sur les modèles restent confinées dans :

- les benchmarks

- les démos sur les réseaux sociaux

- les cercles de développeurs

Après une émission comme celle-ci, la conversation devient :

- ces systèmes peuvent-ils supporter une vraie production ?

- peuvent-ils gérer la pression et la montée en charge ?

- les médias générés par IA peuvent-ils s'intégrer dans les pipelines créatifs grand public ?

C'est le changement que ce gala a représenté.

La couche visible : la robotique

Les robots étaient la couche visible d'une stack IA plus profonde. Quatre entreprises de robotique ont offert des performances :

- Les robots G1 d'Unitree ont fait des saltos arrière de Kung Fu

- Les robots Bumi de Noetix ont joué un sketch comique avec l'actrice vétérane Cai Ming, avec un double robotique bionique ultra-réaliste équipé de 32 moteurs faciaux

- Les robots de MagicLab ont dansé sur « We Are Made in China »

- Galbot a contribué à d'autres performances robotiques

Sans les modèles de langage de Doubao, les robots n'auraient pas pu interagir avec les artistes humains. Sans Seedance, les spectacles visuels n'auraient pas existé. Sans l'infrastructure de Volcengine, les interactions en temps réel se seraient effondrées sous la charge.

Ce que le gala a suggéré sur la stratégie de ByteDance

La lecture stratégique la plus claire est que ByteDance veut être pris au sérieux dans plus d'une catégorie d'IA.

L'événement a suggéré une histoire produit construite autour de :

- la génération de médias

- l'intelligence de type assistant

- le support d'infrastructure

- une pertinence grand public et entreprise à haute visibilité

C'est une ambition bien plus large que « nous avons un bon modèle vidéo ».

Pourquoi les développeurs et les équipes produit devraient s'en soucier

Même si vous ne construisez jamais pour un événement à l'échelle d'un gala, cela compte parce que cela donne des indications sur la façon dont ByteDance veut que sa stack IA soit perçue sur le marché plus large.

Pour les développeurs et les équipes produit, le point à retenir n'est pas « copiez le gala ».

C'est :

ByteDance essaie de positionner ses produits IA comme des parties d'une seule stack, pas comme des outils déconnectés.

Cela affecte la façon dont les équipes devraient interpréter les futurs lancements de modèles, les changements d'écosystème et les décisions de plateforme de l'entreprise.

Modèles IA chinois disponibles via API

Beaucoup des modèles qui ont alimenté ou sont liés à la technologie du gala sont accessibles via API :

| Modèle | Type | Lien avec le gala |

|---|---|---|

| Seedance | Génération vidéo | A alimenté les effets visuels du Gala du Nouvel An chinois |

| Seedream | Génération d'images | Modèle d'image de ByteDance (mis à jour en même temps que Seedance 2.0) |

| Kling | Génération vidéo | Système de text-to-video leader de Kuaishou |

| Wan 2.6 | Génération vidéo | Modèle de génération vidéo d'Alibaba |

| DeepSeek | Modèle de langage | Premier modèle de raisonnement open-source chinois |

| Doubao | Modèle de langage | Le cerveau derrière les interactions IA du gala |

Pourquoi c'est important sur EvoLink

Pour EvoLink, la valeur d'une histoire comme celle-ci n'est pas qu'elle fait de la publicité pour ByteDance.

C'est qu'elle donne aux équipes une raison de comparer et de router à travers des familles de modèles depuis un seul endroit :

- routes vidéo de la famille ByteDance

- autres modèles vidéo chinois

- alternatives non-ByteDance

Point de vue final

Le Gala du Nouvel An chinois 2026 n'était pas seulement un événement culturel avec une décoration IA.

C'était une démonstration à haute visibilité de la façon dont ByteDance veut présenter sa stack IA :

- Seedance pour la génération visuelle

- Doubao pour l'intelligence et l'interaction

- une couche d'infrastructure plus large pour le déploiement à l'échelle publique

C'est pourquoi le gala comptait. Il a transformé l'histoire IA de ByteDance d'un ensemble de pages produit en un récit d'écosystème visible.

FAQ

Pourquoi Seedance 2.0 était-il pertinent dans l'histoire du gala ?

Parce que l'événement a mis en lumière le spectacle visuel généré par IA, ce qui correspond au positionnement plus large de Seedance 2.0 comme couche de génération vidéo au sein de la stack ByteDance.

Le gala était-il principalement une histoire de robots ?

Non. La lecture la plus importante est qu'il a présenté une stack IA plus large fonctionnant à travers les médias, l'interaction et l'infrastructure de production.

Pourquoi Doubao compte-t-il dans ce contexte ?

Parce qu'il représente la couche de langage et d'interaction dans la stratégie IA plus large de ByteDance.

Qu'a suggéré le gala sur la direction IA de ByteDance ?

Il a suggéré que ByteDance veut être perçu comme construisant un écosystème IA intégré plutôt que des modèles ponctuels isolés.

Pourquoi les développeurs devraient-ils se soucier d'un événement télévisé comme celui-ci ?

Parce que les grands événements publics peuvent révéler l'ambition produit, le positionnement et la confiance dans la maturité de production à une échelle que les démos normales ne peuvent pas atteindre.

Cet article était-il censé expliquer l'accès API ?

Non. Cet article porte sur la signification de l'événement pour le marché, pas sur l'accès ou la tarification.