Alibaba Dévoile Qwen3-Max-Thinking : Un Géant au Billion de Paramètres Arrive Bientôt sur evolink.ai

Point Clé : L'équipe Qwen d'Alibaba Cloud a publié Qwen3-Max-Thinking, un modèle phare au billion de paramètres qui affronte directement GPT-5.2 et Claude Opus 4.5. evolink.ai fournira bientôt un accès API officiel stable et rentable.

Qwen3-Max-Thinking en un Coup d'Œil

Spécifications Techniques

- Total Paramètres : Plus d'un billion (1T)

- Données de Pré-entraînement : 36T tokens

- Variantes du Modèle : Éditions Base, Instruct et Thinking

- Positionnement Global : Parmi les plus grands modèles IA au monde

- Options d'Accès : Application Qwen (bureau/web) + appels API

- Site Officiel : https://chat.qwen.ai/

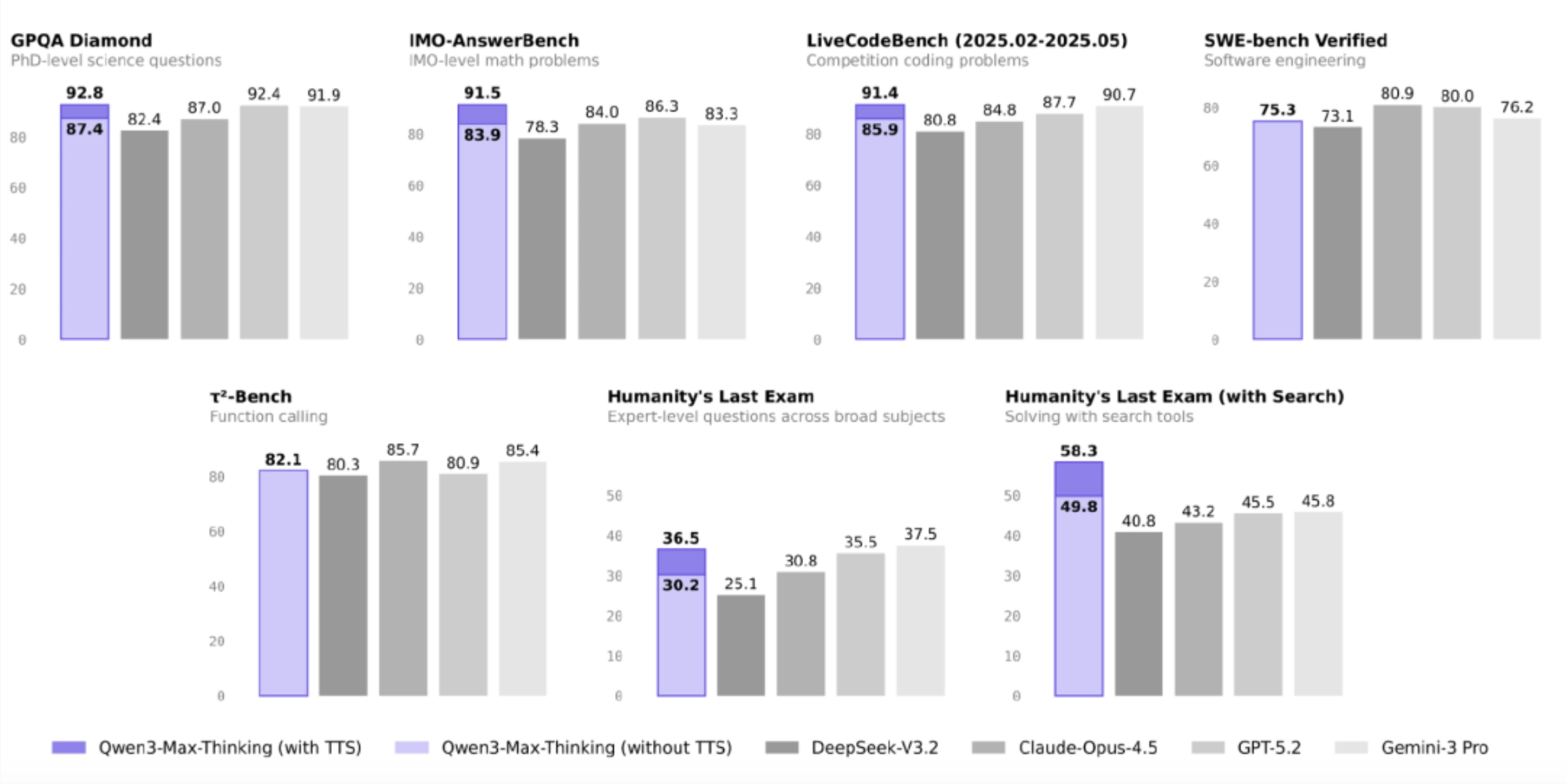

Duel de Performance sur les Benchmarks

Qwen3-Max-Thinking égale ou surpasse les principaux modèles à code source fermé (GPT-5.2-Thinking, Claude-Opus-4.5, Gemini-3 Pro) sur les principaux benchmarks IA :

| Benchmark | Qwen3-Max-Thinking | Comparé À | Domaine |

|---|---|---|---|

| GPQA Diamond | Niveau SOTA | GPT-5.2 / Claude | Q&R Scientifique |

| IMO Math Test | 91,5 | Gemini-3 Pro | Raisonnement Mathématique |

| LiveCodeBench v6 | 91,4 | Claude Opus 4.5 | Génération de Code |

| HLE (avec outils) | 58,3 | GPT-5.2 | Raisonnement Avancé + Utilisation d'Outils |

Une Puissance pour le Code

En ce qui concerne la génération de code et les tâches de programmation, Qwen3-Max-Thinking brille vraiment. Son score de 91,4 sur LiveCodeBench le place dans la même ligue que Gemini et Claude—un changement de donne pour les développeurs.

Deux Innovations Révolutionnaires

1. Appel d'Outil Adaptatif (Adaptive Tool Calling)

| Approche Traditionnelle | Qwen3-Max-Thinking |

|---|---|

| Les utilisateurs sélectionnent manuellement les outils | Le modèle décide et invoque de manière autonome |

| Exécution d'une seule fonction | Recherche + mémoire + interprète de code en synchro |

| Sujet aux hallucinations | La vérification en temps réel réduit les erreurs |

- ✅ Recherche Intelligente : Récupère automatiquement les informations à jour

- ✅ Système de Mémoire : Compréhension du contexte personnalisé

- ✅ Interprète de Code : Exécute des extraits de code à la volée

- ✅ Atténuation des Hallucinations : Validation multi-sources pour la précision

2. Mise à l'Échelle au Moment du Test (Test-Time Scaling)

- GPQA : 90,3 → 92,8 (+2,5)

- HLE : 34,1 → 36,5 (+2,4)

- LiveCodeBench v6 : 88,0 → 91,4 (+3,4)

- IMO-AnswerBench : 89,5 → 91,5 (+2,0)

- HLE (avec outils) : 55,8 → 58,3 (+2,5)

Avec le même budget de tokens, cette approche surpasse constamment l'échantillonnage parallèle standard, augmentant considérablement les performances sur les tâches complexes.

Pourquoi Choisir evolink.ai

Votre Passerelle vers Qwen3-Max-Thinking

🏆 Fiabilité de Niveau Entreprise

- Garantie de Disponibilité de 99,9 % : Disponibilité solide 24/7

- Équilibrage de Charge Intelligent : Pas de hoquets pendant les heures de pointe

- Reprise après Sinistre : Déploiement multi-nœuds avec basculement automatique

💰 Tarification Imbattable

- Paiement à l'Usage : Ne payez que pour les tokens que vous utilisez réellement

- Facturation Claire : Suivi de l'utilisation et des coûts en temps réel

- Remises sur Volume : Tarification par paliers pour les clients entreprises

🤝 Partenariat Officiel

- Connexion Directe Alibaba Cloud : Ressources API de première partie

- Qualité Soutenue par SLA : Accords de niveau de service sur lesquels vous pouvez compter

- Accès Anticipé : Soyez le premier à obtenir de nouvelles fonctionnalités

- Support Dédié : Assistance technique 24/7

🚀 Pour Qui

| Type d'Utilisateur | Plan Recommandé | Avantages Clés |

|---|---|---|

| Développeurs Individuels | Paiement à l'Usage | Expérimentation à faible risque, utilisation flexible |

| Startups | Forfait Standard | Coûts prévisibles, intégration rapide |

| Entreprises | Solutions Personnalisées | Déploiement dédié, souveraineté des données |

Ce Que Vous Obtiendrez

-

✅ Raisonnement au Billion de Paramètres

-

Abordez une logique métier complexe et des flux de travail en plusieurs étapes

-

✅ Génération de Code de Premier Ordre

-

Prise en charge de plus de 50 langages de programmation, productivité triplée

-

✅ Maîtrise des Maths & de la Logique

-

Résolvez la modélisation financière, le calcul scientifique et au-delà

-

✅ Sélection d'Outil Adaptative

-

Choisit automatiquement la chaîne d'outils optimale pour chaque tâche

-

✅ Informations en Temps Réel

-

L'intégration de la recherche Web garde les réponses fraîches et précises

Un Moment Historique pour l'IA Chinoise

Rejoindre l'Élite Mondiale

-

Échelle des Paramètres : Niveau billion, à égalité avec GPT-5

-

Performance dans le Monde Réel : Bat les leaders internationaux sur plusieurs benchmarks

-

Innovation Technique : Pionnier de l'appel d'outil adaptatif et de la mise à l'échelle au moment du test

-

Vitesse d'Itération : Les développeurs internationaux notent "qu'ils expédient plus vite qu'OpenAI"

Ce Que Disent les Développeurs

"Qwen dépasse constamment la concurrence." — Développeur International

"C'est exactement la version de Qwen que j'attendais." — Harriett Solid

"La cadence de mise à jour et les divulgations de capacités de Qwen ont dépassé OpenAI." — Membre de la Communauté Tech

FAQ

Q1 : Quand Qwen3-Max-Thinking sera-t-il disponible sur evolink.ai ?

Q2 : Vos prix sont-ils meilleurs que l'API officielle ?

- Des remises sur les achats en gros

- Zéro frais cachés

- Une meilleure valeur que les appels API directs

Q3 : Quelles méthodes d'intégration prenez-vous en charge ?

-

API RESTful

-

SDK Python

-

SDK JavaScript

-

Interface basée sur le Web

Q4 : Comment gérez-vous la sécurité des données ?

-

En Transit : Chiffrement TLS 1.3

-

Au Repos : Nous ne stockons pas les données de conversation

-

Conformité : Conforme au RGPD, certifié Niveau 3 Chine

-

Confidentialité : Respect strict des réglementations sur la protection des données

Q5 : Comment commencer ?

-

Inscrivez-vous sur evolink.ai

-

Récupérez votre clé API

-

Suivez nos docs—vous serez opérationnel en 5 minutes

Essayez Qwen3-Max-Thinking Aujourd'hui

Canaux Officiels

- App Qwen : https://chat.qwen.ai/

- Documentation API : https://qwen.ai/blog?id=qwen3-max-thinking

Lectures connexes

- Qwen Coder API pour agents de code : accès, coût et planification de fallback — évaluez Qwen Coder pour les workflows d'agents de code

- Meilleur LLM pour les agents de code : coût API, appels d'outils et fiabilité comparés — découvrez comment les modèles Qwen se comparent pour les charges de travail de code

À propos d'evolink.ai

evolink.ai est une plateforme d'intégration IA de premier plan, habilitant les développeurs et les entreprises avec :

-

🌐 Accès Multi-Modèles : GPT, Claude, Gemini, Qwen, et plus

-

💼 Prêt pour l'Entreprise : Stable, sécurisé et conforme

-

💰 Meilleure Valeur de sa Catégorie : Canaux officiels, tarification transparente

-

🛠️ Développeur d'Abord : Docs complètes, intégration rapide Suivez evolink.ai pour les dernières nouvelles sur les intégrations de modèles IA

- Blog officiel Alibaba Qwen: https://qwen.ai/blog?id=qwen3-max-thinking

- Qwen Chat: https://chat.qwen.ai/

- AI Frontier: Alibaba franchit la barre du billion de paramètres avec Qwen3-Max-Thinking