Comment utiliser GPT-5.4 dans OpenClaw : Guide de configuration (5 minutes)

Comment utiliser GPT-5.4 dans OpenClaw : Guide de configuration (5 minutes)

gpt-5.4. OpenClaw a fusionné le support GPT-5.4 le 6 mars 2026, donc les utilisateurs sur les builds actuels peuvent l'utiliser nativement. Si votre version installée est antérieure à ce changement, vous pouvez toujours utiliser GPT-5.4 via un fournisseur personnalisé compatible OpenAI comme EvoLink.Si vous avez essayé GPT-5.4 avec un ancien build OpenClaw et rencontré des erreurs de sélection de modèle, le problème est réel, mais le statut a changé rapidement. L'Issue GitHub #36817 a documenté l'échec sur les builds pré-fusion, et OpenClaw a fusionné le support GPT-5.4 dans le PR #36590 le 6 mars 2026.

Cela signifie que le bon guide n'est plus "OpenClaw ne supporte pas encore GPT-5.4". La version précise est :

- Si vous êtes sur un build actuel, vérifiez d'abord le support natif

- Si vous êtes sur un ancien build ou souhaitez router via une passerelle, ajoutez un fournisseur personnalisé

Pourquoi GPT-5.4 est important pour les utilisateurs d'OpenClaw

Utilisation native de l'ordinateur

OpenAI rapporte 75,0% sur OSWorld-Verified, au-dessus de la ligne de base humaine de 72,4%. Si votre workflow OpenClaw implique des actions de navigateur, une interaction de bureau ou une exécution d'outils multi-étapes, c'est l'une des mises à niveau les plus importantes de GPT-5.4.

Fenêtre de contexte de 1,05M tokens

La page officielle du modèle API GPT-5.4 liste une fenêtre de contexte de 1 050 000 tokens et 128 000 tokens de sortie maximum. Pour les grands dépôts, les docs et les longues exécutions d'agents, c'est une mise à niveau pratique par rapport aux modèles à contexte plus petit.

Meilleure sélection d'outils

OpenAI dit que GPT-5.4 peut réduire les tokens de 47% dans un benchmark d'outils volumineux tout en maintenant la même précision. Cela compte pour les configurations OpenClaw avec de nombreux outils, serveurs MCP ou longues descriptions d'outils.

Travail de connaissance du monde réel plus fort

OpenAI rapporte que GPT-5.4 atteint 83,0% sur GDPval contre 70,9% pour GPT-5.2. GDPval est un benchmark de travail de connaissance, pas un taux d'hallucination générique, il est donc plus précis de décrire cela comme un gain de performance sur les tâches à haute valeur plutôt qu'une métrique d'hallucination directe.

Le statut réel d'OpenClaw le 6 mars 2026

Voici l'état actuel :

- Le support GPT-5.4 a été fusionné dans OpenClaw le 6 mars 2026

- L'Issue #36817 a documenté que certains builds rejetaient

openai-codex/gpt-5.4comme "non autorisé" - Parce que le correctif est déjà fusionné, il n'est plus exact de dire qu'OpenClaw "ne supporte pas encore GPT-5.4" de manière générale

Donc, avant d'éditer les fichiers de configuration, faites ceci d'abord :

- Mettez à jour OpenClaw si vous n'êtes pas sur le dernier build

- Exécutez

openclaw models list - Sélectionnez la référence du modèle GPT-5.4 affichée par votre installation

Si GPT-5.4 apparaît dans votre liste de modèles, utilisez le support natif et arrêtez-vous là.

Quand un fournisseur personnalisé a encore du sens

Vous pouvez toujours vouloir un fournisseur personnalisé si :

- votre build OpenClaw installé est antérieur à la fusion GPT-5.4

- vous voulez router le trafic via EvoLink ou une autre passerelle compatible OpenAI

- vous voulez un compte ou une facture unique sur plusieurs fournisseurs upstream

Comment ajouter EvoLink comme fournisseur personnalisé

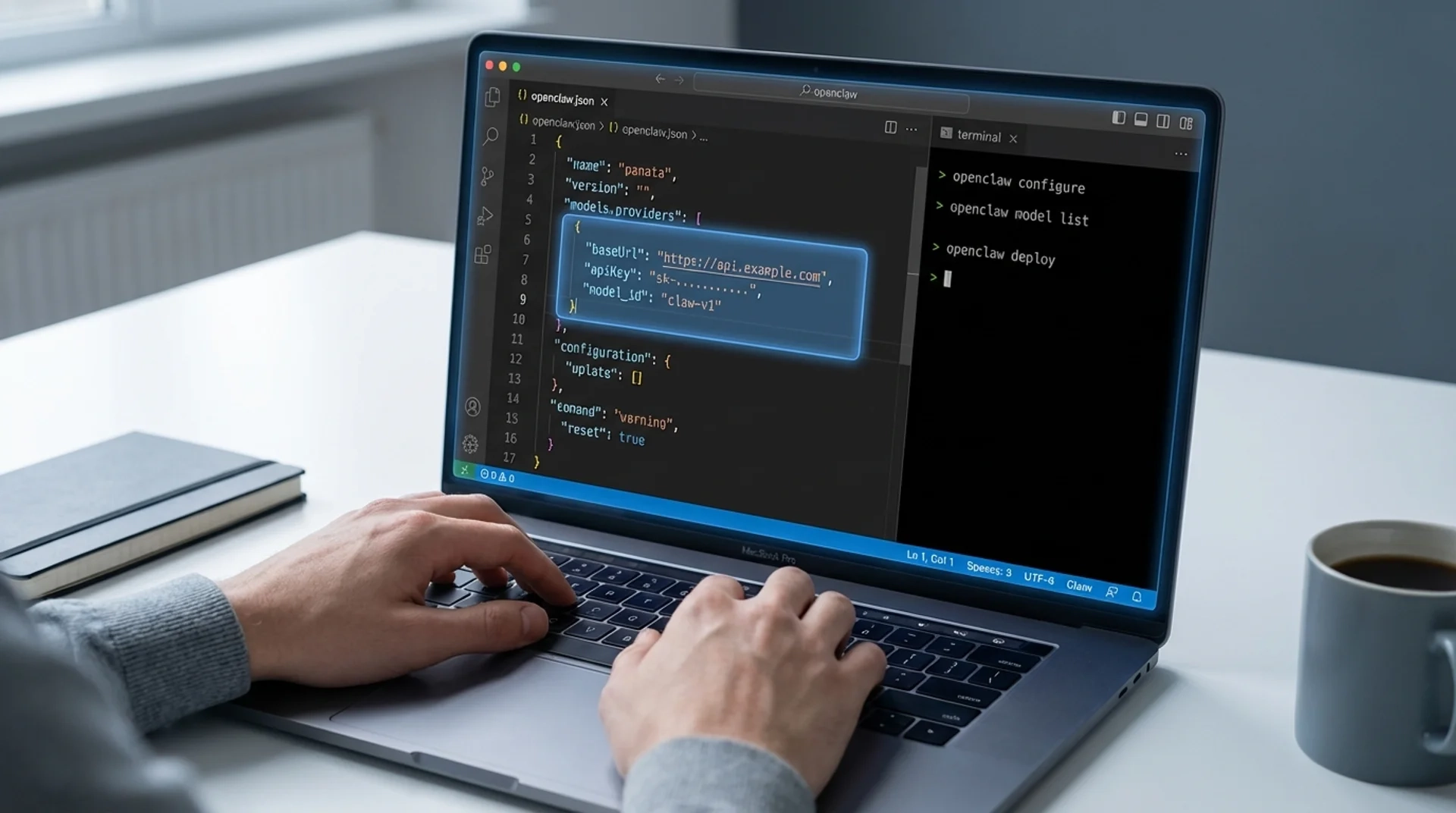

models.providers, pas un bloc providers de niveau supérieur.openclaw.json et ajoutez un fournisseur en utilisant les valeurs de votre tableau de bord EvoLink ou docs d'intégration :{

"models": {

"mode": "merge",

"providers": {

"evolink-openai": {

"api": "openai-completions",

"baseUrl": "https://YOUR_EVOLINK_OPENAI_BASE_URL",

"apiKey": "${EVOLINK_API_KEY}",

"models": [

{

"id": "gpt-5.4",

"name": "GPT-5.4"

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "evolink-openai/gpt-5.4"

}

}

}

}Notes importantes :

- Remplacez l'URL de base du placeholder par le endpoint affiché dans votre compte ou docs EvoLink

- Utilisez l'ID de modèle exact que votre fournisseur expose

- Si votre fournisseur n'a pas encore activé GPT-5.4 pour votre compte, la configuration ne fonctionnera pas tant que le déploiement n'est pas terminé

Définir le modèle

Après avoir enregistré le fichier, exécutez :

openclaw models list

openclaw models set evolink-openai/gpt-5.4

openclaw models statusopenclaw chat, il est donc préférable de ne pas s'y fier dans les instructions de configuration.Tarification : Ce qui est réellement confirmé

Les affirmations de tarification dans le brouillon précédent étaient trop agressives et, dans certains cas, incorrectes.

Tarification publique confirmée :

- OpenAI

gpt-5.4: $2.50 / 1M entrée, $0.25 / 1M entrée en cache, $15.00 / 1M sortie - OpenAI

gpt-5.4-pro: $30.00 / 1M entrée, $180.00 / 1M sortie - OpenRouter

openai/gpt-5.4: $2.50 / 1M entrée, $15.00 / 1M sortie

gpt-5.4-beta.

FAQ

1. OpenClaw supporte-t-il officiellement GPT-5.4 ?

Oui, le support a été fusionné le 6 mars 2026. Les anciens builds installés peuvent encore nécessiter un fournisseur personnalisé ou une mise à jour.

2. Puis-je utiliser GPT-5.4 via l'API OpenAI aujourd'hui ?

gpt-5.4 et gpt-5.4-pro dans les docs API.3. Quel paramètre de raisonnement dois-je utiliser ?

reasoning.effort, pas reasoning_effort.4. Dois-je toujours utiliser un fournisseur personnalisé ?

Non. Le support natif est plus simple si votre build OpenClaw inclut déjà GPT-5.4. Un fournisseur personnalisé est principalement utile pour les anciens builds ou le routage de passerelle.

5. Pourquoi est-ce que j'obtiens l'erreur "modèle non autorisé" ?

models.providers.6. Combien coûte GPT-5.4 par rapport aux autres modèles ?

GPT-5.4 coûte $2.50/1M entrée et $15.00/1M sortie. C'est le même prix que GPT-4 Turbo mais avec une fenêtre de contexte plus grande (1,05M tokens vs 128K). GPT-5.4 Pro coûte $30.00/1M entrée et $180.00/1M sortie.

7. Quelle est la différence entre gpt-5.4 et gpt-5.4-pro ?

GPT-5.4 Pro offre des performances supérieures sur les tâches de raisonnement complexes et un temps de réflexion étendu. Utilisez GPT-5.4 standard pour la plupart des workflows d'agents sauf si vous avez besoin d'une capacité de raisonnement maximale.

8. Comment migrer de GPT-4 à GPT-5.4 dans OpenClaw ?

openclaw models set openai-codex/gpt-5.4. Si vous utilisez un fournisseur personnalisé, mettez à jour l'ID du modèle dans votre configuration openclaw.json et redémarrez la passerelle.Conclusion

La réponse pratique est simple : GPT-5.4 est réel, le support OpenClaw a déjà atterri, et le bon chemin de configuration dépend de votre build installé.

openclaw models list, utilisez le support natif. Sinon, ajoutez un fournisseur personnalisé sous models.providers et utilisez le endpoint exact et l'ID de modèle exposé par votre passerelle.Essayez EvoLink pour le routage OpenClaw

response.model.Sources vérifiées pour cette révision

- Annonce de lancement OpenAI GPT-5.4

- Pages de modèle API OpenAI GPT-5.4 et GPT-5.4 Pro

- Page de tarification API OpenAI

- Docs OpenClaw pour les modèles et fournisseurs personnalisés

- OpenClaw Issue #36817 et PR #36590

- Liste OpenRouter

openai/gpt-5.4