Guide de production de l'API GPT Image 1.5 : Tarification, schémas de latence et architecture de mise à l'échelle

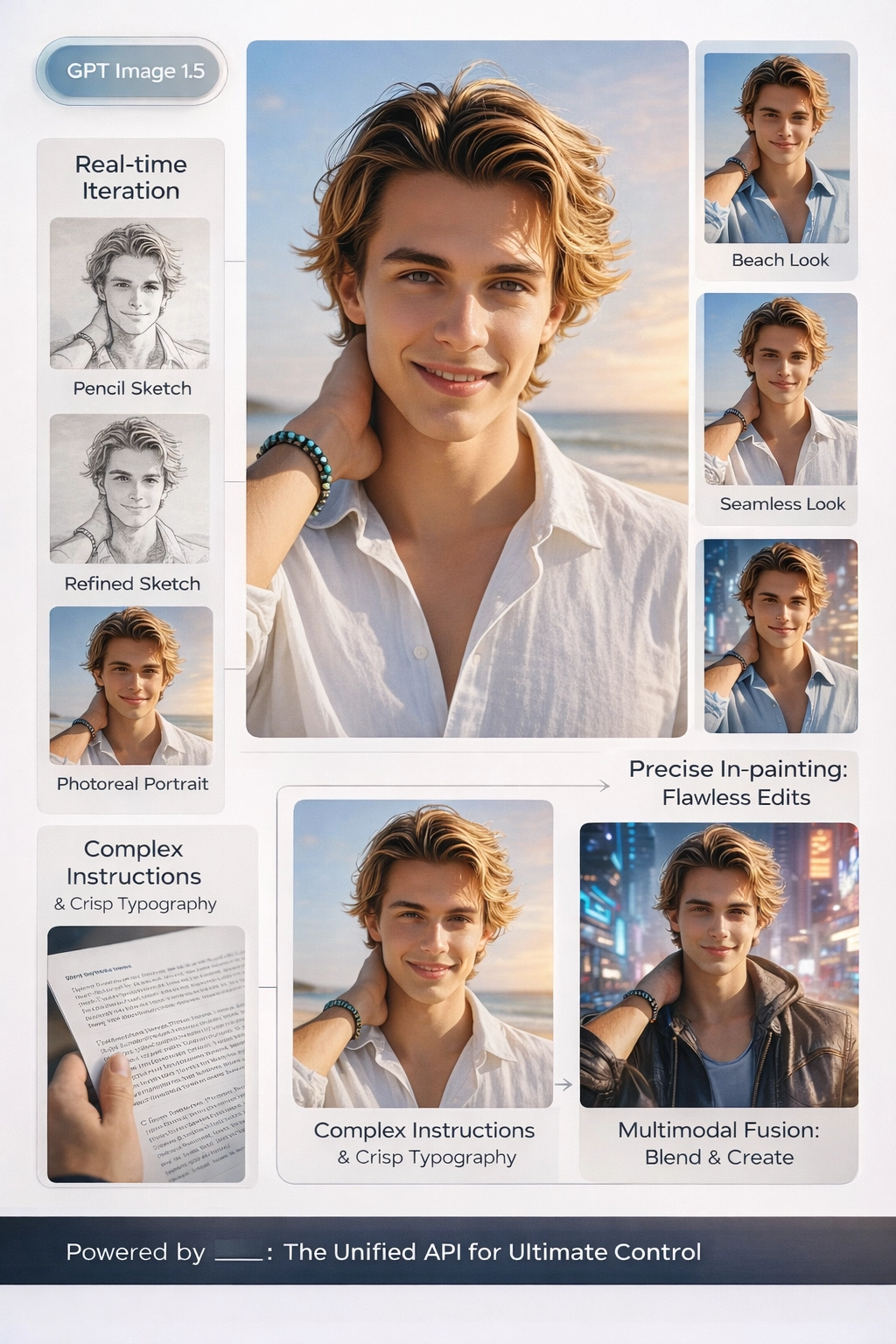

gpt-image-1.5). Cette version met l'accent sur un meilleur respect des instructions, une édition plus précise, un rendu amélioré du texte dense et des vitesses de génération d'images jusqu'à 4 fois plus rapides par rapport aux itérations précédentes.Résumé exécutif : Ce que GPT Image 1.5 change en production

GPT Image 1.5 se positionne comme le modèle texte-vers-image polyvalent le plus performant d'OpenAI au lancement, avec un accent particulier sur :

- Respect des instructions : des modifications plus fiables, "jusque dans les petits détails".

- Édition et préservation : meilleur pour appliquer des modifications tout en gardant les éléments clés cohérents (y compris la ressemblance faciale et les visuels de marque à travers les éditions).

- Rendu du texte : capacité améliorée à rendre du texte dense à l'intérieur des images.

- Vitesse : vitesses de génération jusqu'à 4 fois plus rapides (selon OpenAI).

Paysage concurrentiel : GPT Image 1.5 vs Nano Banana Pro vs FLUX

| Catégorie | GPT Image 1.5 (OpenAI) | Nano Banana Pro (Google DeepMind) | Famille FLUX (Black Forest Labs) |

|---|---|---|---|

| Positionnement | Génération d'images polyvalente + édition forte et respect des instructions | Basé sur Gemini 3 ; se concentre sur la « précision/contrôle de qualité studio » et un texte clair | Texte-vers-image + variantes d'édition (ex: Kontext / Fill) ; options pour l'utilisation de l'API et l'auto-hébergement |

| Texte dans les images | Rendu amélioré du texte dense | « Générer un texte clair » pour les affiches/diagrammes | Varie selon le modèle et le flux de travail ; gamme solide axée sur l'édition |

| Édition et préservation | Élevé sur les éditions précises préservant les détails importants à travers les éditions | Accent sur la précision/le contrôle pour les éditions | Catalogue d'édition complet (Kontext / Fill etc.) |

Performance en production : Schémas de latence et fiabilité

Facteurs de latence courants pour les modèles d'image :

- Résolution et rapport d'aspect (les sorties plus grandes prennent plus de temps)

- Complexité du prompt et éditions itératives

- Pics de trafic / mise en file d'attente

- Boucles de tentative après des rejets de sécurité ou des échecs transitoires

- Utilisez des délais d'expiration (timeouts) + des clés d'idempotence (ou vos propres identifiants de requête)

- Ajoutez des files d'attente de jobs asynchrones pour les générations de longue durée

- Implémentez des stratégies de repli (fallbacks) (qualité inférieure, taille réduite ou modèle alternatif)

Filtres de sécurité : Anticipez les rejets comme un résultat normal

Les API d'image d'OpenAI appliquent des politiques de sécurité ; les prompts ou les éditions peuvent être rejetés. En production, vous devez traiter le "rejet" comme un résultat normal :

- Affichez un retour UI exploitable aux utilisateurs

- Enregistrez les catégories de rejet (lorsqu'elles sont disponibles)

- Fournissez des suggestions de prompts de remplacement sûrs

- Évitez les tempêtes de tentatives (limitez le taux de tentatives)

Tarification : Coûts officiels de GPT Image 1.5 (Par image + Tokens)

OpenAI publie les deux :

- Prix par image selon la qualité et la taille

- Prix des tokens d'image (pour les entrées/sorties d'image dans la comptabilité par jetons)

Prix par image (officiel)

| Qualité | 1024×1024 | 1024×1536 | 1536×1024 |

|---|---|---|---|

| Basse | 0,009 $ | 0,013 $ | 0,013 $ |

| Moyenne | 0,034 $ | 0,05 $ | 0,05 $ |

| Haute | 0,133 $ | 0,2 $ | 0,2 $ |

Prix des tokens d'image (officiel)

gpt-image-1.5: tokens d'image Entrée 8 $ / Sortie 32 $ par million de tokensgpt-image-1: tokens d'image Entrée 10 $ / Sortie 40 $ par million de tokens

Expérience développeur : Ce sur quoi vous devez construire votre architecture

Même lorsque le modèle est performant, livrer un produit fiable nécessite une ingénierie pour :

- Limites de débit et contre-pression (prévoir les erreurs 429 et la mise en file d'attente des requêtes)

- Dérive des schémas entre les fournisseurs (différents paramètres, codes d'erreur, formats de réponse)

- Observabilité (coût par requête, centiles de latence, motifs d'échec, taux de repli)

L'angle EvoLink : Modèles d'API unifiés

Une approche de passerelle unifiée peut réduire la charge opérationnelle en :

- Standardisant les formats de requête/réponse entre les fournisseurs

- Ajoutant des règles de routage (ex : choisir GPT Image 1.5 pour les affiches riches en texte ; choisir un autre modèle pour les scènes photoréalistes quand c'est acceptable)

- Implémentant des stratégies de repli (fallback) lorsqu'un fournisseur rejette une demande ou produit une erreur

- Fournissant des analyses d'utilisation centralisées pour le suivi des coûts et des performances

Démarrage rapide : GPT Image 1.5 via EvoLink

EvoLink fournit un point de terminaison unifié pour GPT Image 1.5 qui prend en charge les modes texte-vers-image, image-vers-image et l'édition d'images avec un traitement asynchrone.

POST https://api.evolink.ai/v1/images/generations| Paramètre | Type | Requis | Description |

|---|---|---|---|

| model | string | Oui | Utilisez gpt-image-1.5-lite |

| prompt | string | Oui | Description de l'image, max 2000 tokens |

| size | enum | Non | 1:1, 3:4, 4:3, 1024x1024, 1024x1536, 1536x1024 |

| quality | enum | Non | low, medium, high, auto (par défaut) |

| image_urls | array | Non | 1-16 images de référence pour l'édition, max 50 Mo chacune |

| n | integer | Non | Nombre d'images (actuellement 1 pris en charge) |

Exemple : Texte-vers-image

curl --request POST \

--url https://api.evolink.ai/v1/images/generations \

--header 'Authorization: Bearer VOTRE_CLE_API' \

--header 'Content-Type: application/json' \

--data '{

"model": "gpt-image-1.5-lite",

"prompt": "A professional product photo of a sleek smartwatch on a marble surface, soft studio lighting, 4K quality",

"size": "1024x1024",

"quality": "high"

}'Exemple : Édition d'image

curl --request POST \

--url https://api.evolink.ai/v1/images/generations \

--header 'Authorization: Bearer VOTRE_CLE_API' \

--header 'Content-Type: application/json' \

--data '{

"model": "gpt-image-1.5-lite",

"prompt": "Change the background to a sunset beach scene, keep the product unchanged",

"image_urls": ["https://votre-cdn.exemple.com/photo-produit.jpg"],

"size": "1024x1024",

"quality": "high"

}'Format de réponse

L'API renvoie une tâche asynchrone. Interrogez le statut de la tâche en utilisant l'ID renvoyé :

{

"created": 1757156493,

"id": "task-unified-1757156493-imcg5zqt",

"model": "gpt-image-1.5-lite",

"status": "pending",

"progress": 0,

"task_info": {

"can_cancel": true,

"estimated_time": 100

},

"usage": {

"credits_reserved": 2.5

}

}Note : Les images générées expirent après 24 heures. Téléchargez-les et stockez-les rapidement.

Conclusion

gpt-image-1.5) est une étape majeure en 2025 pour les flux de travail d'image en production, OpenAI mettant explicitement l'accent sur un meilleur respect des instructions, des éditions plus précises préservant les détails importants, un rendu de texte amélioré et une génération jusqu'à 4 fois plus rapide.Pour livrer de manière fiable à grande échelle, traitez les images comme un problème d'infrastructure : mesurez les distributions de latence, budgétisez avec les prix officiels par image, gérez les rejets de sécurité avec élégance et concevez des schémas de routage/repli qui protègent l'expérience utilisateur et l'économie unitaire.