GPT-5.4 vs Claude Opus 4.6 vs Gemini 3.1 Pro : quel modèle phare gagne en 2026 ?

Dernière mise à jour : 6 mars 2026 · Prix vérifiés en mars 2026

Claude Opus 4.6 domine la qualité de code selon les résultats publics, Gemini 3.1 Pro offre 1M de contexte à $2/1M en entrée (source : tarifs ai.google.dev), et GPT-5.4 est désormais listé sur OpenRouter à $2.50/$20 avec 1M de contexte et 128K de sortie max. Si vous devez choisir aujourd’hui, Gemini 3.1 Pro reste le meilleur rapport qualité‑prix pour la plupart des usages ; Opus 4.6 reste fort pour le code complexe et les workflows agents ; GPT‑5.4 doit être évalué en parallèle via routing.

Voici l’analyse complète.

TL;DR

- Gemini 3.1 Pro est le roi du prix/perf : $2.00/$12.00 par 1M tokens, 1M de contexte et 80,6% SWE‑bench.

- Claude Opus 4.6 gagne en qualité de code : 80,8% SWE‑bench (table single‑attempt) et 81,42% avec prompt modification, 128K de sortie, Agent Teams — mais au‑delà de 200K tokens, la tarification premium s’applique ($10/$37.50 par 1M).

- GPT‑5.4 est listé sur OpenRouter : $2.50/$20 par 1M tokens, $0.625 d’entrée en cache, 1M de contexte, 128K de sortie max. La couverture de benchmarks indépendants reste limitée.

- Budget serré : GPT‑5.2 reste solide à $1.75/$14 par 1M, 400K de contexte, 80,0% SWE‑bench.

- Ne bloquez pas la livraison sur GPT‑5.4 : lancez avec Gemini 3.1 Pro ou Opus 4.6 et évaluez GPT‑5.4 en parallèle.

Tableau comparatif

Chaque cellule provient d’une source primaire. Prix à mars 2026.

| Claude Opus 4.6 | Gemini 3.1 Pro | GPT-5.4 (OpenRouter) | GPT-5.2 | |

|---|---|---|---|---|

| Fournisseur | Anthropic | Google DeepMind | OpenAI | OpenAI |

| Statut | ✅ Disponible | ✅ Disponible | ✅ Disponible via OpenRouter | ✅ Disponible |

| Contexte | 200K (1M beta, tier 4/custom limits) | 1M | 1M | 400K |

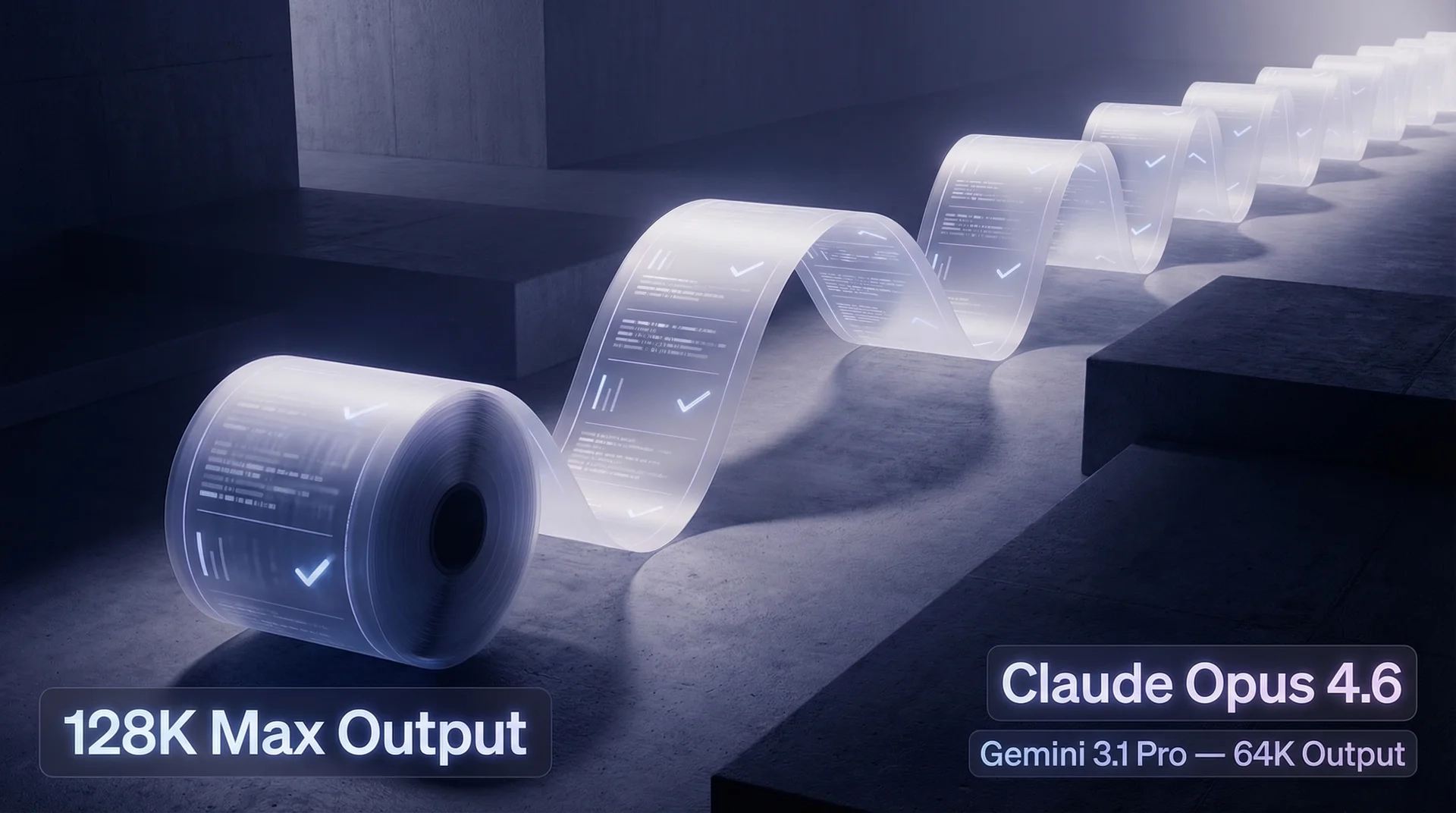

| Sortie max | 128K tokens | 64K tokens | 128K tokens | 128K tokens |

| Entrée (/1M) | $5.00 (≤200K) / $10.00 (>200K) | $2.00 (≤200K) / $4.00 (>200K) | $2.50 (entrée en cache : $0.625) | $1.75 |

| Sortie (/1M) | $25.00 (≤200K) / $37.50 (>200K) | $12.00 (≤200K) / $18.00 (>200K) | $20.00 | $14.00 |

| Raisonnement | Réflexion étendue | Standard | Nommage public des modes encore limité | Standard + réflexion approfondie |

| SWE-bench | 80.8% (single) / 81.42% (prompt mod.) | 80.6% (single) | Pas encore de valeur publique largement acceptée | 80.0% |

| Idéal pour | Code complexe, orchestration d'agents | Long contexte, multimodal, valeur | À définir | Code orienté budget, général |

Sources : anthropic.com/pricing · anthropic.com/docs/models/claude-opus-4-6 · ai.google.dev pricing · deepmind.google model card · platform.openai.com/docs/models/gpt-5.2 · openrouter.ai/openai/gpt-5.4

Quand choisir quel modèle

Choisissez Claude Opus 4.6 si vous voulez la meilleure qualité de code

Dans la table comparative DeepMind, Opus 4.6 est à 80,8% SWE‑bench (single attempt). Anthropic indique jusqu’à 81,42% avec prompt modification et une moyenne sur 25 essais (source : anthropic.com/news/claude-opus-4-6). La sortie max 128K est la meilleure de sa catégorie.

Agent Teams est utile pour les systèmes multi‑agents.

Le compromis est le coût : ≤200K à $5/$25 par 1M, >200K à $10/$37.50. Le ratio vs Gemini reste stable (2,5× en entrée, ~2,08× en sortie).

Meilleurs cas : réparation type SWE‑bench, orchestration multi‑agent, génération longue (>64K), applications critiques.

Choisissez Gemini 3.1 Pro pour le meilleur rapport qualité‑prix

Gemini 3.1 Pro combine 1M de contexte natif et des benchmarks compétitifs au prix le plus bas. À $2.00/$12.00 (≤200K), il coûte moins de la moitié d’Opus, pour seulement 0,2 point d’écart sur SWE‑bench.

Autres points forts :

- GPQA Diamond : 94,3%

- ARC‑AGI‑2 : 77,1%

- HLE : 44,4%

- Terminal‑Bench 2.0 : 68,5%

- Multimodal natif : texte + image + audio + vidéo

Limitation principale : sortie max 64K vs 128K pour Opus.

Meilleurs cas : analyse de documents longs, apps multimodales, APIs sensibles au coût, bases de code qui tiennent dans 1M de contexte.

GPT‑5.4 maintenant : évaluation en rollout contrôlé

Données publiques actuelles (OpenRouter) :

- 1M de contexte

- 128K de sortie max

- $2.50 / 1M entrée, $0.625 / 1M entrée en cache, $20.00 / 1M sortie

Ce qui manque encore : une couverture large de benchmarks indépendants sur des workloads réels.

Approche pragmatique : garder Gemini/Opus en production principale, router une part limitée de trafic sur GPT‑5.4, puis augmenter seulement après validation de vos gates d’évaluation.

Focus : fenêtre de contexte

| Modèle | Fenêtre de contexte | Notes |

|---|---|---|

| Gemini 3.1 Pro | 1M tokens | Contexte 1M prêt pour la production |

| GPT-5.4 | 1M tokens | Listé sur OpenRouter |

| GPT-5.2 | 400K tokens | Disponible maintenant |

| Claude Opus 4.6 | 200K (1M beta) | 1M beta limité à tier 4/custom limits |

Pour de grands codebases ou corpus, le 1M de Gemini est un avantage. Le 1M beta d’Opus est limité au usage tier 4 ou limites personnalisées.

Focus : capacités de raisonnement

| Modèle | Mode de raisonnement | Point fort clé |

|---|---|---|

| Claude Opus 4.6 | Réflexion étendue | Débogage multi-étapes, planification architecturale |

| Gemini 3.1 Pro | Standard (avec support de réflexion) | GPQA Diamond 94.3%, ARC-AGI-2 77.1% |

| GPT-5.4 | Nommage public des modes encore limité | À valider avec votre propre suite d’évaluation |

L’extended thinking d’Opus est meilleur pour le raisonnement structuré. Gemini excelle sur GPQA Diamond.

Focus : prix & coût

Coût par tâche (estimé)

Estimations par type de tâche.

| Tâche | Tokens (entrée/sortie) | GPT-5.2 | Gemini 3.1 Pro | Claude Opus 4.6 |

|---|---|---|---|---|

| Chat simple | 1K / 500 | $0.009 | $0.008 | $0.018 |

| Revue de code (fichier unique) | 5K / 2K | $0.037 | $0.034 | $0.075 |

| Analyse de document long | 100K / 5K | $0.245 | $0.260 | $0.625 |

| Base de code complète (contexte 200K+) | 300K / 10K | $0.665 | $1.380* | $3.375** |

*Gemini 3.1 Pro >200K : $4.00/$18.00 par 1M tokens.

**Claude Opus 4.6 >200K : $10.00/$37.50 par 1M tokens.

À haut contexte, Gemini et Opus montent en prix, mais le ratio reste stable ; l’écart en dollars augmente. Le changement de classement concerne surtout GPT‑5.2.

Avec EvoLink (evolink.ai/models), vous pouvez accéder à Opus 4.6 et Gemini 3.1 Pro avec des tarifs réduits via un endpoint compatible OpenAI.

Focus : performance code

| Modèle | SWE-bench | Conditions | Source |

|---|---|---|---|

| Claude Opus 4.6 | 80.8% (single) / 81.42% (prompt mod.) | Sources mixtes | deepmind.google model card / anthropic.com/news/claude-opus-4-6 |

| Gemini 3.1 Pro | 80.6% (single) | Évaluation Google | deepmind.google model card |

| GPT-5.2 | 80.0% | Évaluation OpenAI | platform.openai.com |

| GPT-5.4 | Pas encore de valeur publique largement acceptée | — | Disponible sur OpenRouter |

Note importante : les méthodologies diffèrent ; 0,2% d’écart peut être négligeable.

Ce qui compte en pratique :

- Opus 4.6 : sortie max 128K.

- Gemini 3.1 Pro : contexte 1M. Terminal‑Bench 2.0 : 68,5%.

- GPT‑5.2 : le moins cher à $1.75/1M, SWE‑bench 80,0%.

Cadre de décision

Selon votre contrainte principale :

Budget ?

→ GPT‑5.2 ($1.75/$14) ou Gemini 3.1 Pro ($2/$12)

Besoin de >200K de contexte ?

→ Gemini 3.1 Pro (1M natif) ou piloter GPT‑5.4 via trafic routé

Qualité de code maximale et sortie longue ?

→ Claude Opus 4.6 (80,8% SWE‑bench, sortie 128K)

Multimodal (vidéo/audio) ?

→ Gemini 3.1 Pro

Systèmes multi‑agents ?

→ Claude Opus 4.6 (Agent Teams)

Raisonnement scientifique ?

→ Gemini 3.1 Pro (GPQA Diamond 94,3%)

Un seul API pour plusieurs modèles ?

→ EvoLink (evolink.ai)

Faut‑il migrer tout de suite sur GPT‑5.4 ?

Réponse courte : pas en hard switch ; faites un rollout contrôlé.

GPT‑5.4 est disponible via OpenRouter, mais il faut valider qualité, latence et coût sur vos workloads avant migration large.

Approche pragmatique :

- Lancer maintenant avec Gemini 3.1 Pro ou Claude Opus 4.6

- Utiliser un gateway/API router pour changer de modèle par configuration

- Évaluer GPT‑5.4 immédiatement dans votre suite de benchmarks

- Migrer progressivement uniquement s’il gagne selon vos métriques

À surveiller : DeepSeek V4.

FAQ

GPT‑5.4 sera‑t‑il meilleur que Claude Opus 4.6 ?

Cela dépend de vos tâches. GPT‑5.4 est listé, mais il n’existe pas encore de consensus large sur des benchmarks indépendants. Opus 4.6 reste une référence solide à 80,8% (single) et 81,42% (prompt mod.).

Quel est le moins cher : Opus 4.6 ou Gemini 3.1 Pro ?

Gemini 3.1 Pro. ≤200K : $2.00/$12.00 vs Opus $5.00/$25.00. >200K : $4.00/$18.00 vs Opus $10.00/$37.50. Le ratio reste quasi identique.

Quelle fenêtre de contexte pour Gemini 3.1 Pro ?

1M tokens en production.

GPT‑5.4 est‑il disponible maintenant ?

openai/gpt-5.4) avec prix et limites publiés. La disponibilité et la facturation peuvent varier selon le fournisseur et le contrat.Puis‑je utiliser 1M de contexte avec Claude Opus 4.6 ?

Le standard est 200K ; le 1M beta est limité à usage tier 4 ou limites personnalisées.

Quel est le meilleur modèle pour le code ?

Table single‑attempt : Opus 4.6 80,8%, Gemini 3.1 Pro 80,6%, GPT‑5.2 80,0%. Anthropic mentionne 81,42% avec prompt modification.

Gemini 3.1 Pro est‑il bon en multimodal ?

Oui. C’est le seul ici avec texte, image, audio et vidéo en entrée native.

Cette page sera mise à jour. Dernière vérification : 2026‑03‑06.

Vous voulez GPT‑5.4 dès la sortie ? Créez un compte EvoLink (evolink.ai).