Claude Opus 4.6 – Guide de déploiement en entreprise

Claude Opus 4.6 : L'IA d'entreprise prête pour la production

En bref (Pour les CTO / Tech Leads pressés)

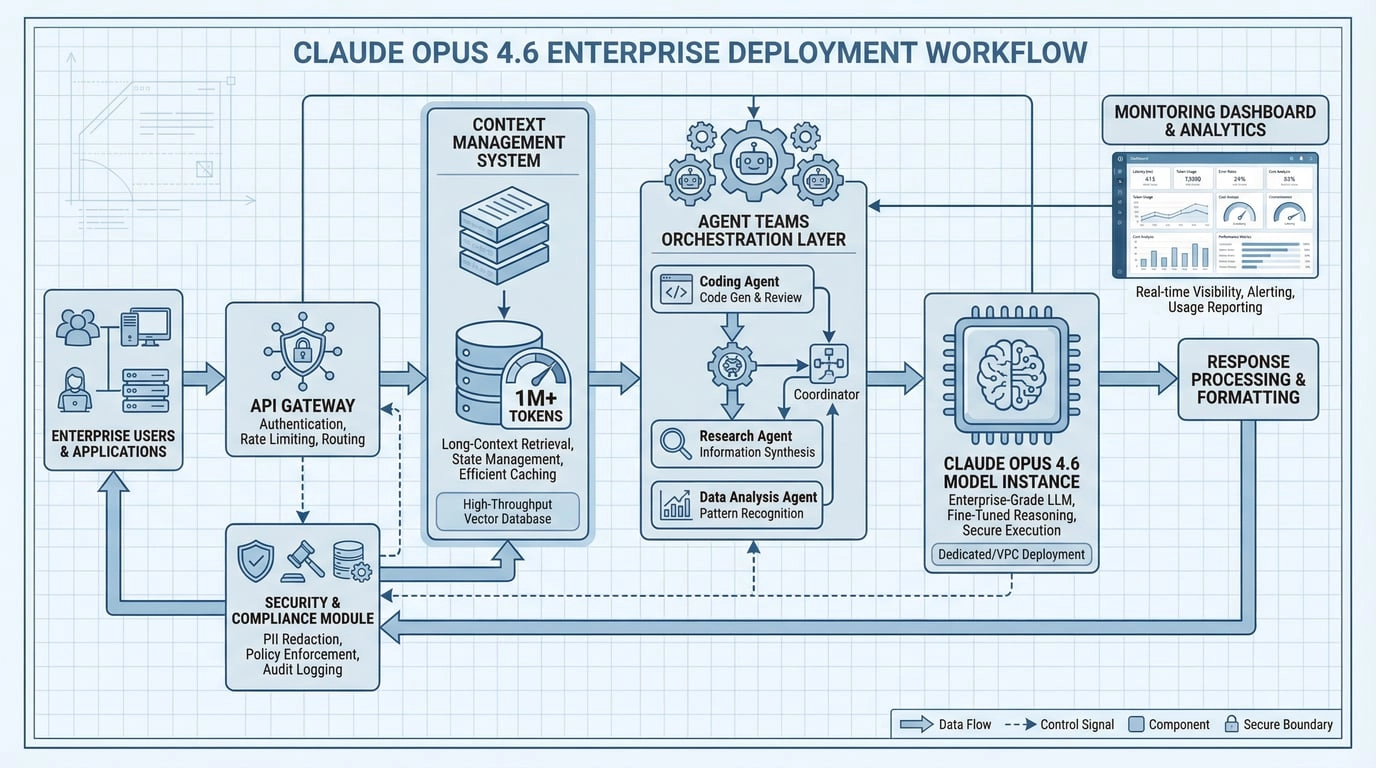

Si vous intégrez Opus 4.6 dans un produit B2B, « des réponses de démo impressionnantes » ne signifie pas prêt pour la production. Les critères de mise en production impliquent généralement 5 aspects :

- Fiabilité : Les sorties dérivent-elles avec des entrées identiques ? La qualité se dégrade-t-elle sous charge ?

- Contrôlabilité : Pouvez-vous contraindre le format, les refus, l'incertitude, les citations et le contenu sensible ?

- Observabilité : Pouvez-vous tracer et reproduire les prompts, preuves, appels d'outils, latence et coûts ?

- Capacité de rollback : Pouvez-vous rétrograder en un clic les modèles, prompts ou stratégies de récupération ?

- Sécurité et conformité : Pouvez-vous bloquer les PII, les attaques par injection et les appels d'outils non autorisés ?

1. Fiche de faits (Officiellement vérifiable)

1.1 Modèle et disponibilité

| Élément | Détails |

|---|---|

| Nom du modèle | Claude Opus 4.6 |

| ID du modèle API | claude-opus-4-6 |

| Plateformes 1M contexte bêta | Claude API, Microsoft Foundry, Amazon Bedrock, Google Vertex AI |

Note : Les fonctionnalités bêta nécessitent une éligibilité de niveau — voir ci-dessous.

1.2 Contexte et sortie

- Contexte standard : 200K tokens

- Contexte 1M tokens (Bêta) : Nécessite l'en-tête bêta

context-1m-2025-08-07et généralement Usage Tier 4 ou limites personnalisées - Limite de sortie : 128K tokens de sortie (utilisez le streaming pour les grandes valeurs de

max_tokensafin d'éviter les timeouts HTTP)

1.3 Tarification (Important : Le contexte long déclenche le tarif Premium)

| Scénario | Prix d'entrée | Prix de sortie |

|---|---|---|

| ≤ 200K entrée | 5 $ / MTok | 25 $ / MTok |

| > 200K entrée (Premium) | 10 $ / MTok | 37,50 $ / MTok |

Note : Dès que l'entrée dépasse 200K, tous les tokens de cette requête sont facturés au tarif Premium. Intégrez cela explicitement dans vos estimations de coûts.

1.4 Changements critiques API / comportement (Lecture obligatoire pour la migration)

- Adaptive thinking recommandé :

thinking: {type: "adaptive"} - Effort (4 niveaux) :

low / medium / high (par défaut) / max - API Compaction (Bêta) : Compression automatique du contexte côté serveur, en-tête bêta

compact-2026-01-12 - Breaking change : Prefill désactivé : Le prefill assistant dans le dernier message renvoie une erreur 400 sur Opus 4.6

output_formatmigré versoutput_config.format- L'échappement JSON des paramètres d'appel d'outils peut légèrement différer des anciens modèles : utilisez des parseurs JSON standards (

JSON.parse/json.loads), pas d'analyse manuelle de chaînes

2. Pourquoi les entreprises trouvent la version 4.6 « plus prête pour la production »

2.1 Contexte 1M (Bêta) : Pas un gadget, mais une percée dans l'information disponible

Les tâches d'entreprise les plus précieuses ne sont pas « rédiger de jolis textes » — mais plutôt :

- Lire des montagnes de documents (contrats, politiques, tickets, code, rapports)

- Trouver des preuves clés (avec citations)

- Transformer les preuves en conclusions actionnables (auditables, réversibles)

Le contexte long permet de « faire tenir plus de matériel brut dans un seul pipeline ». Mais vous devez encore :

- Filtrer par permissions (ACL) : Au moment de la récupération, pas via les prompts

- Citer les preuves : Les sorties doivent inclure

chunk_id/doc_id - Gérer les coûts et limites : >200K déclenche Premium + rate limits dédiés (pas de surprises en production)

2.2 Compaction (Bêta) : Transformer les tâches longues « qui doivent s'arrêter » en « qui peuvent continuer »

De nombreux workflows agentiques « explosent » autour de 200K. La valeur de Compaction : quand le contexte approche du seuil, l'API génère automatiquement des résumés compressés et continue — pour des tâches longues durables.

Note : Avec Compaction activé, suivez les coûts viausage.iterations(incluez les itérations de compression), sinon vous sous-estimerez la consommation réelle de tokens.

2.3 Agent Teams (Claude Code) : Exploration parallèle native

Conseil pratique : Avant la production, traitez Agent Teams comme un « accélérateur » et non une « automatisation complète » — combinez avec les permissions et l'audit pour limiter le rayon d'impact.

2.4 Adaptive Thinking + Effort : Des curseurs ajustables « Intelligence/Vitesse/Coût »

En entreprise, de nombreuses tâches n'ont pas besoin d'un « raisonnement à pleine puissance » :

- Routage client, classification légère, extraction de champs : low/medium est souvent moins cher et plus rapide

- Diagnostics complexes, synthèse de longs documents, migration de code : high/max offre une qualité plus stable

Traitez Effort comme un curseur unifié « coût-qualité », ajoutez la validation de schéma, et vous obtiendrez des SLA plus stables.

3. Intégration entreprise et disponibilité

3.1 Côté plateforme

- Claude API : Pour l'intégration produit et les workflows backend

- Microsoft Foundry / Bedrock / Vertex AI : Pour la gouvernance cloud entreprise et la conformité

- GitHub Copilot : Opus 4.6 est en cours de déploiement dans l'écosystème Copilot

3.2 Outils bureautiques (Plus proches du « quotidien entreprise »)

- Claude dans Excel : Lit les cellules, formules et structures d'onglets du classeur actuel pour assister (idéal pour le nettoyage de données, la validation de modèles, l'interprétation de rapports)

- Claude dans PowerPoint (Research Preview) : Génère ou modifie des diapositives dans des modèles existants (idéal pour « rendre les modèles d'entreprise plus professionnels »)

Rappel : Les fonctionnalités Office nécessitent généralement des plans spécifiques ou un accès preview ; adaptées aux scénarios « d'amélioration de l'efficacité » — les sorties critiques doivent toujours être vérifiées manuellement.

4. Migration et déploiement : 4 règles d'or

- Arrêtez d'utiliser le prefill Assistant : Opus 4.6 renvoie 400. Utilisez plutôt les instructions System, Structured Outputs ou

output_config.format - Migrez tous les output_format vers output_config.format : Les futures versions de l'API déprécieront l'ancien format

- Utilisez uniquement des parseurs JSON standards pour les paramètres d'appel d'outils : Pas d'analyse manuelle de chaînes

- Streamez toujours les grandes sorties : Les grandes valeurs de

max_tokenssans streaming sont plus sujettes aux timeouts

5. Modèles prêts à l'emploi

5.1 Exemple d'appel contexte 1M (Bêta)

curl https://api.anthropic.com/v1/messages \

-H "x-api-key: $ANTHROPIC_API_KEY" \

-H "anthropic-version: 2023-06-01" \

-H "anthropic-beta: context-1m-2025-08-07" \

-H "content-type: application/json" \

-d '{

"model": "claude-opus-4-6",

"max_tokens": 1024,

"messages": [{"role":"user","content":"Process this large document..."}]

}'5.2 Adaptive Thinking + Effort (Python)

import anthropic

client = anthropic.Anthropic()

resp = client.messages.create(

model="claude-opus-4-6",

max_tokens=4096,

thinking={"type": "adaptive"},

output_config={"effort": "medium"},

messages=[{

"role": "user",

"content": "Summarize the risks in this contract clause..."

}],

)

print(resp.content[0].text)5.3 Structured Outputs (JSON Schema) + Porte de preuves

resp = client.messages.create(

model="claude-opus-4-6",

max_tokens=2048,

thinking={"type": "adaptive"},

output_config={

"effort": "medium",

"format": {

"type": "json_schema",

"schema": {

"name": "kb_answer",

"schema": {

"type": "object",

"properties": {

"answer": {"type": "string"},

"evidence": {"type": "array", "items": {"type": "string"}},

"uncertainties": {"type": "array", "items": {"type": "string"}}

},

"required": ["answer", "evidence"]

}

}

}

},

messages=[{

"role": "user",

"content": """Only answer based on EVIDENCE blocks. Cite evidence IDs.

<evidence>

[#a1] Revenue grew 15% YoY in Q3 2025...

[#b7] Customer churn rate increased to 8.2%...

</evidence>

Question: What are the key business risks?"""

}],

)

print(resp.content[0].text) # JSON string (validate before downstream use)5.4 Exemple d'activation Compaction (Bêta)

curl https://api.anthropic.com/v1/messages \

--header "x-api-key: $ANTHROPIC_API_KEY" \

--header "anthropic-version: 2023-06-01" \

--header "anthropic-beta: compact-2026-01-12" \

--header "content-type: application/json" \

--data '{

"model": "claude-opus-4-6",

"max_tokens": 4096,

"messages": [{"role":"user","content":"Help me build a website"}],

"context_management": {

"edits": [{"type":"compact_20260112"}]

}

}'5.5 Configuration Agent Teams (Claude Code)

{

"env": {

"CLAUDE_CODE_EXPERIMENTAL_AGENT_TEAMS": "1"

}

}Une fois activé, utilisez le langage naturel dans Claude Code :

- « Create an agent team with roles A/B/C to review this codebase… »

- « Lead agent synthesizes findings; teammates focus on security/perf/tests… »

6. Estimation des coûts et gouvernance des limites

6.1 Comparaison des coûts par scénario type

| Scénario | Tokens d'entrée | Tokens de sortie | Coût (Standard) | Coût (Premium >200K) |

|---|---|---|---|---|

| Résumé court | 5K | 500 | 0,04 $ | - |

| Revue de code moyenne | 50K | 2K | 0,30 $ | - |

| Analyse de long document | 150K | 3K | 0,83 $ | - |

| Contexte étendu | 500K | 5K | - | 5,19 $ |

| Agent Teams (3 tours) | 200K × 3 | 10K | 3,25 $ | - |

Note : Agent Teams génère plusieurs sessions parallèles. Consommation totale de tokens = Lead + Coéquipiers combinés ; si une seule itération dépasse 200K, le tarif Premium peut s'appliquer.

6.2 Recommandations de gouvernance des limites

- Définir des rate limits indépendants par niveau d'Effort : high/max a un volume plus faible mais un coût plus élevé — surveiller séparément

- Exiger une approbation explicite pour >200K d'entrée : Éviter la facturation Premium accidentelle

- Prévoir un buffer de 2-3x pour les scénarios Compaction : Les itérations de compression augmentent la consommation réelle

- Tester Agent Teams en sandbox d'abord : Parallélisme × contexte peut dépasser les attentes

7. Sécurité et conformité

7.1 Exemple de configuration de sécurité

security_config = {

"content_filtering": {

"hate_speech": "strict",

"violence": "strict",

"sexual_content": "strict",

"self_harm": "strict"

},

"output_validation": {

"check_for_pii": True,

"check_for_credentials": True,

"check_for_malicious_code": True

},

"audit_logging": {

"enabled": True,

"log_level": "detailed",

"retention_days": 90

}

}7.2 Checklist entreprise

- Filtrage PII : Scanner les entrées et sorties pour les informations sensibles

- Liste blanche d'appels d'outils : N'autoriser que les appels de fonction prédéfinis

- Validation du format de sortie : Imposer des contraintes via JSON Schema

- Traçabilité des preuves : Chaque conclusion doit remonter aux documents sources

- Journalisation d'audit : Enregistrer tous les appels API, résumés d'entrée et de sortie

- Interrupteur de rétrogradation : Rollback en un clic vers des modèles plus anciens ou un Effort inférieur

- Disjoncteur de coûts : Arrêt automatique en cas de dépassement des limites par utilisateur/tâche

8. Benchmarks de performance (Données officielles)

| Benchmark | Score Claude Opus 4.6 | Description |

|---|---|---|

| Terminal-Bench 2.0 | 65,4 % | Évaluation de programmation agentique (record historique) |

| GDPval-AA | 1606 Elo | Tâches professionnelles finance et juridique |

| BigLaw Bench | 90,2 % | Capacité de raisonnement juridique |

| BrowseComp | N°1 du secteur | Récupération d'informations web |

Source : Publication officielle Anthropic

9. Conclusion : Traiter Opus 4.6 comme un « composant système », pas comme une « boîte magique »

La vraie valeur d'Opus 4.6 n'est pas d'être « meilleur en conversation » — mais d'être plus adapté à l'ingénierie :

- Contexte long + Compaction rend les tâches longues durables

- Agent Teams rend la collaboration parallèle native

- Adaptive Thinking + Effort rend le coût/qualité contrôlable

Ajoutez Schema, portes de preuves, audit et rollback — c'est le chemin vers la production entreprise.

Démarrage rapide

Références (Sources officielles / primaires)

- Anthropic: Introducing Claude Opus 4.6

- Claude API Docs: What's new in Claude 4.6

- Claude API Docs: Context windows

- Claude API Docs: Pricing

- Claude API Docs: Compaction

- Claude Code Docs: Agent Teams

- Microsoft Azure Blog: Claude Opus 4.6 on Foundry