Cuando un contenedor de API de LLM se convierte en infraestructura

Cuando un contenedor de API de LLM se convierte en infraestructura

La mayoría de los equipos de ingeniería no se proponen crear un contenedor de API LLM.

Por lo general, no hay un documento inicial, ni una hoja de ruta explícita, ni un momento en el que alguien diga: "Resumamos todos nuestros proveedores de modelos".En cambio, los envoltorios surgen silenciosamente, línea por línea, a medida que los equipos intentan mantener estables los sistemas de producción.

Este artículo explica por qué los contenedores suelen aparecer en los sistemas de producción, cómo reconocer cuándo uno ha cruzado la línea hacia la infraestructura y qué decisiones suelen enfrentar los equipos a continuación.

Qué es realmente un contenedor de API LLM (en la práctica)

En los sistemas de producción, un envoltorio rara vez es un solo componente.Es una capa cada vez mayor de lógica que se encuentra entre su aplicación y uno o más proveedores de LLM.

Las responsabilidades comunes incluyen:

- Normalizar esquemas de solicitud y respuesta.

- Manejo de reintentos, tiempos de espera y errores específicos del proveedor

- Gestionar la selección de modelos o la lógica alternativa.

- Inyección de avisos, mensajes del sistema o reglas de seguridad.

- Seguimiento del uso para atribución de costos, registro o auditorías

La mayoría de los envoltorios comienzan como un código de conveniencia.Muchos terminan convirtiéndose en caminos de misión crítica.

Por qué surgen los envoltorios (incluso cuando nadie los planifica)

Los equipos no crean contenedores porque quieran abstracción.Los construyen porque la integración directa a menudo deja de ser confiable bajo presión de producción.

A continuación se muestran las fuerzas más comunes que empujan a los equipos en esta dirección.

1. La inconsistencia del comportamiento es más difícil que la inconsistencia de la interfaz

Los esquemas API son relativamente fáciles de normalizar.El comportamiento en tiempo de ejecución no lo es.

Los equipos a menudo encuentran diferencias como:

- Transmisión de respuestas que pueden detenerse, fragmentarse de manera diferente o fallar silenciosamente

- Errores que pueden parecer similares pero requieren un manejo operativo diferente

- Tiempos de espera que pueden comportarse de forma impredecible bajo carga

- Diferencias sutiles en la interpretación rápida o el truncamiento.

Cuando estos problemas surgen en la producción, una respuesta común a corto plazo es agregar un manejo local específico del proveedor:

si proveedor == X:

reintentar de manera diferente

si la transmisión se detiene:

respaldo a no transmisiónCon el tiempo, estos condicionales se acumulan.Se forma un contenedor no para "limpiar la API", sino para contener la imprevisibilidad del comportamiento.

2. El control rápido comienza como una conveniencia y termina como una política

Al principio, las indicaciones son solo cadenas pasadas desde el código de la aplicación.

Posteriormente, pueden convertirse en:

- Activos versionados

- Compartido entre múltiples servicios

- Acoplado a líneas base de evaluación.

- A veces se revisan los estándares de seguridad, cumplimiento o calidad (según el producto y el perfil de riesgo)

En este punto, las indicaciones dejan de comportarse como detalles de la aplicación y comienzan a comportarse como configuración.

Pueden surgir envoltorios para:

- Centralizar la inyección rápida

- Hacer cumplir las instrucciones a nivel del sistema

- Reducir la deriva accidental entre servicios

Lo que parecen "ayudantes rápidos" es a menudo el primer signo de centralización de políticas.

3. Fracturas de visibilidad de costos sin una capa intermedia

El uso directo de API puede dispersar señales de costos entre proveedores:

- Diferentes unidades de precios

- Diferentes cadencias de facturación.

- Semántica de límite de velocidad diferente

Los equipos de ingeniería a menudo sienten este dolor temprano, a veces antes que Finanzas.

Los envoltorios pueden parecer:

- Seguimiento del uso de forma consistente

- Atribuir costo a funciones o equipos.

- Aplicar barandillas antes de que aumenten las facturas

Esto no es necesariamente madurez de FinOps. A menudo se trata de ingeniería defensiva.

4. Las garantías de confiabilidad no escalan dentro del código del producto

A medida que los LLM pasan de los experimentos a las dependencias, los equipos pueden comenzar a necesitar:

- Reservas

- Rotación de proveedores

- Degradación elegante

Incorporar esta lógica directamente en el código de la aplicación puede crear un acoplamiento estrecho y rutas frágiles.

Un contenedor se convierte en un lugar natural para expresar la intención de confiabilidad:

- "Si esto falla, intenta aquello".

- "Si la latencia excede un umbral, baje la versión".

- "Si se alcanza la cuota, cambie de modelo".

En esta etapa, el envoltorio ya no es pegamento opcional. Puede comenzar a hacer cumplir las expectativas de nivel de servicio.

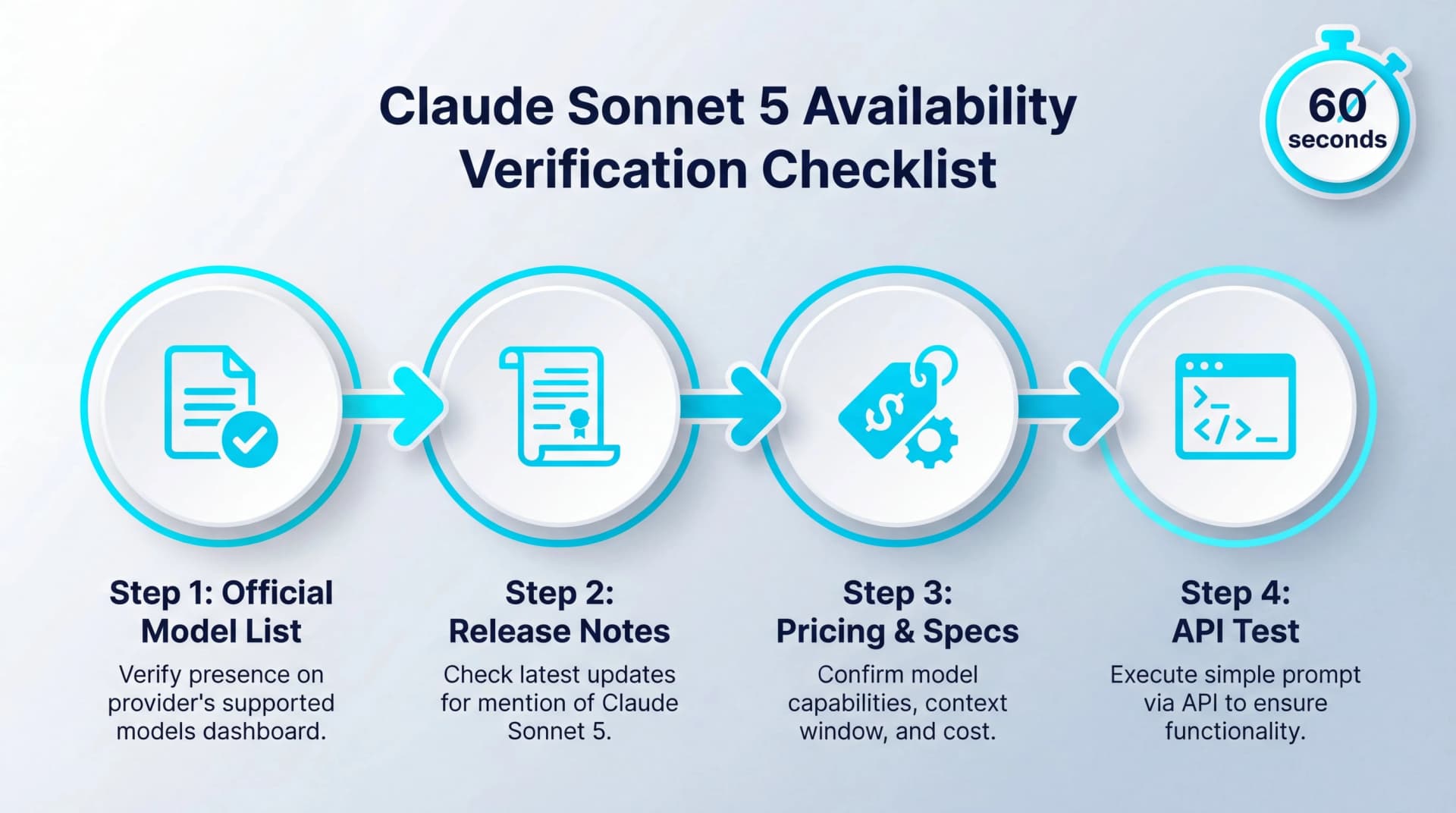

El modelo de madurez del contenedor

Muchos equipos subestiman hasta qué punto ha evolucionado ya su envoltorio.La siguiente tabla describe una progresión común.

| Etapa | Cómo se ve | Dolor común | Lo que suele venir después |

|---|---|---|---|

| Integración directa | La aplicación llama a los proveedores directamente | Excepciones dispersas | Adaptador mínimo |

| Adaptador | Esquema unificado, ayudantes ligeros | Deriva conductual | Reintentos centralizados |

| Envoltorio | Avisos, enrutamiento, seguimiento de costos | Cuellos de botella en la propiedad | Pensamiento infranivel |

| Puerta de enlace | Contratos explícitos y observabilidad | Surgieron compensaciones | Alineamiento organizacional |

Si su sistema está funcionando en la Etapa 2 o más allá, el contenedor a menudo deja de ser puramente temporal y comienza a asumir responsabilidades similares a las de la infraestructura.

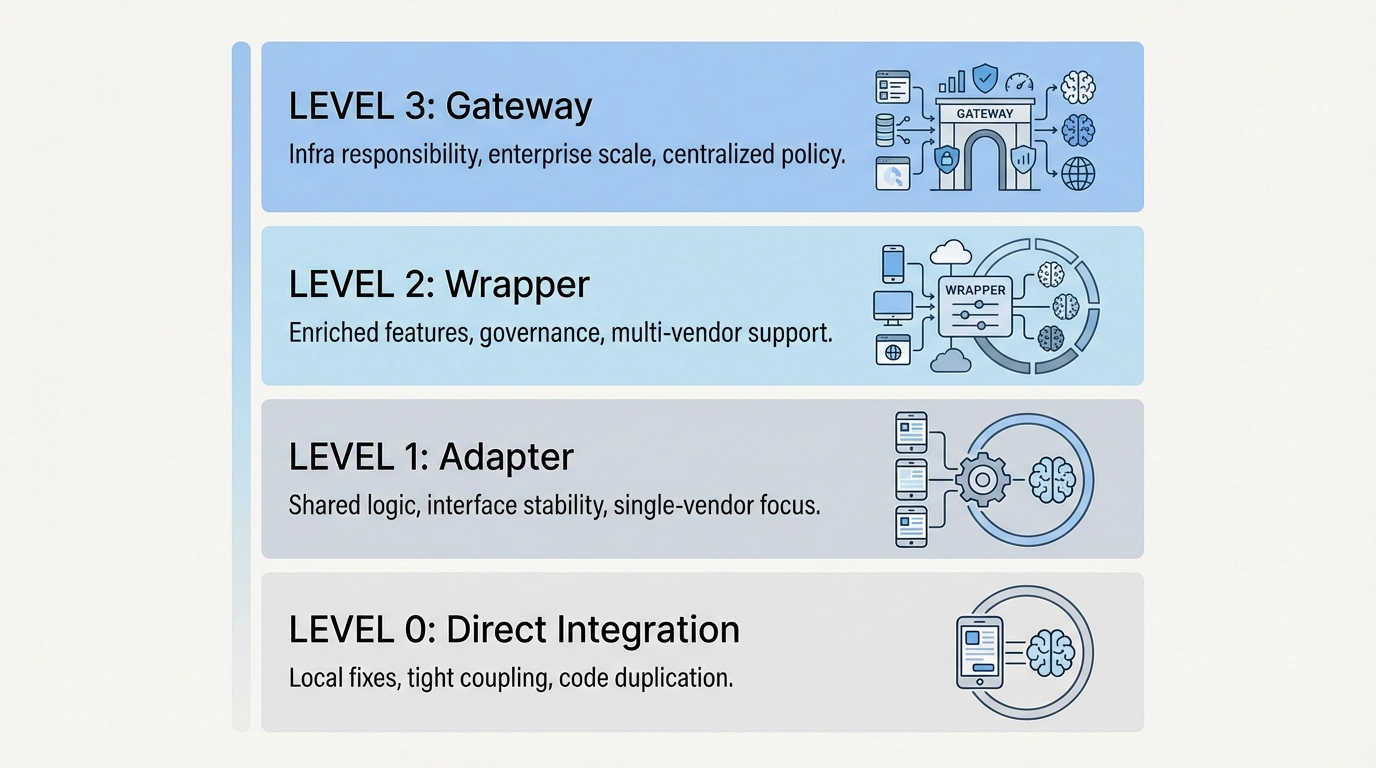

Cuando un contenedor se convierte silenciosamente en infraestructura

Los equipos a menudo se dan cuenta demasiado tarde de que se ha cruzado una línea.

Las señales comunes incluyen:

- Varios equipos dependen del mismo envoltorio.

- Los cambios requieren coordinación y planes de implementación.

- Las fallas afectan a servicios no relacionados.

- La capa necesita documentación, propiedad y seguimiento.

En este punto, el contenedor puede comenzar a funcionar como una capa de puerta de enlace, incluso si aún no tiene nombre ni funciona como tal.

La diferencia no es sólo la capacidad. Es intención y operación.

Los envoltorios suelen ser reactivos. Las puertas de enlace se diseñan.

Construir o evolucionar: las verdaderas decisiones que enfrentan los equipos

Rara vez la pregunta es "¿Deberíamos construir un contenedor?" A menudo esa decisión ya se ha tomado implícitamente.

La verdadera pregunta es:

La evolución ad hoc a menudo conduce a:

- Acoplamiento oculto

- Garantías inconsistentes

- Conocimiento concentrado en unos pocos ingenieros.

La infraestructura intencional tiende a traer:

- Contratos claros

- Comportamiento observable

- Compensaciones explícitas

Ninguno de los dos caminos es universalmente correcto. Pero no elegir sigue siendo una elección.

Antipatrones a tener en cuenta

Los equipos que luchan con los envoltorios suelen caer en trampas similares:

- La lógica específica del proveedor se filtra en el código del producto.

- Múltiples contenedores mantenidos por diferentes equipos.

- Lógica de enrutamiento sin líneas base de evaluación.

- Seguimiento de costos sin atribución de uso

- Rutas críticas sin telemetría ni alertas.

Estos patrones a menudo indican que el sistema ha superado la abstracción informal.

Una lista de verificación de autoevaluación simple

Si responde "sí" a tres o más, es probable que el contenedor ya sea parte de su arquitectura:

- ¿Aparecen condicionales específicos del proveedor en todos los servicios?

- ¿Se inyectan o modifican mensajes fuera del código del producto?

- ¿No existe una única fuente de verdad sobre el uso o el costo de LLM?

- ¿La lógica de reintento o de reserva está duplicada en varios lugares?

- ¿Una interrupción del proveedor requeriría cambios de código coordinados?

Si es así, el contenedor ya no es opcional.

👉 Siguiente paso

Pensamiento final

Los envoltorios no son un error.

Son un síntoma de escala, complejidad y presión de producción.

El riesgo real es tratar una capa de abstracción crítica como "simplemente ayudantes" mucho después de que se haya convertido en infraestructura.

Comprender cuándo un envoltorio ha cruzado ese límite es el primer paso para decidir en qué debería convertirse a continuación.

Preguntas frecuentes

¿Qué es un contenedor de API LLM?

Un contenedor es una capa intermediaria que puede normalizar el comportamiento, hacer cumplir políticas y gestionar la confiabilidad en uno o más proveedores de LLM.

¿Cuándo debería un equipo crear un contenedor LLM?

Muchos equipos terminan construyendo uno implícitamente tan pronto como la confiabilidad de la producción, el control de costos o la gestión rápida se convierten en preocupaciones recurrentes.

¿Cuál es la diferencia entre un contenedor y una puerta de enlace?

En la práctica, los contenedores suelen ser colecciones reactivas de correcciones, mientras que las puertas de enlace son infraestructuras diseñadas intencionalmente con contratos explícitos.

¿Cómo sé cuándo debo ir más allá de un contenedor?

Cuando varios equipos dependen de él, las interrupciones se propagan ampliamente y las garantías operativas son importantes, es probable que el contenedor se haya convertido en infraestructura y deba tratarse en consecuencia.