GPT-5.2 Análisis profundo: puntos de referencia de producción, migración de API y análisis de costos

La llegada de GPT-5.2 en diciembre de 2025 marca un cambio de paradigma significativo en el desarrollo de la IA.Estamos yendo más allá de los modelos que simplemente generan texto plausible hacia sistemas capaces de realizar un razonamiento confiable.Para los ingenieros y directores de tecnología, esto no es sólo una actualización incremental;es un cambio fundamental en la forma en que podemos diseñar e implementar aplicaciones de misión crítica.GPT-5.2 no sólo es "más inteligente": está optimizado para los flujos de trabajo complejos y de alta simultaneidad que definen el software empresarial moderno.

Conclusiones clave

- Razonamiento avanzado: GPT-5.2 demuestra un salto significativo en el razonamiento lógico del "Sistema 2", reduciendo las alucinaciones y permitiendo la resolución de problemas más complejos en una sola pasada.

- ¿Listo para producción?: Si bien es inmensamente poderoso, el modelo introduce un equilibrio crítico entre inteligencia, latencia y costo.No es un reemplazo universal para GPT-4o.

- Capacidades de Agentic: Las llamadas a funciones enormemente mejoradas y la adherencia al modo JSON lo convierten en una opción superior para crear agentes autónomos confiables y canales de extracción de datos estructurados.

- Integración y costo: El acceso directo es limitado y costoso.Una capa de API unificada como EvoLink es esencial para gestionar los costos, garantizar la confiabilidad con los modelos alternativos y simplificar la integración.

Qué es GPT-5.2: una mirada a la arquitectura

GPT-5.2 representa una importante evolución arquitectónica.Si bien OpenAI se mantiene reservado sobre la implementación exacta, las mejoras en el rendimiento apuntan a avances clave:

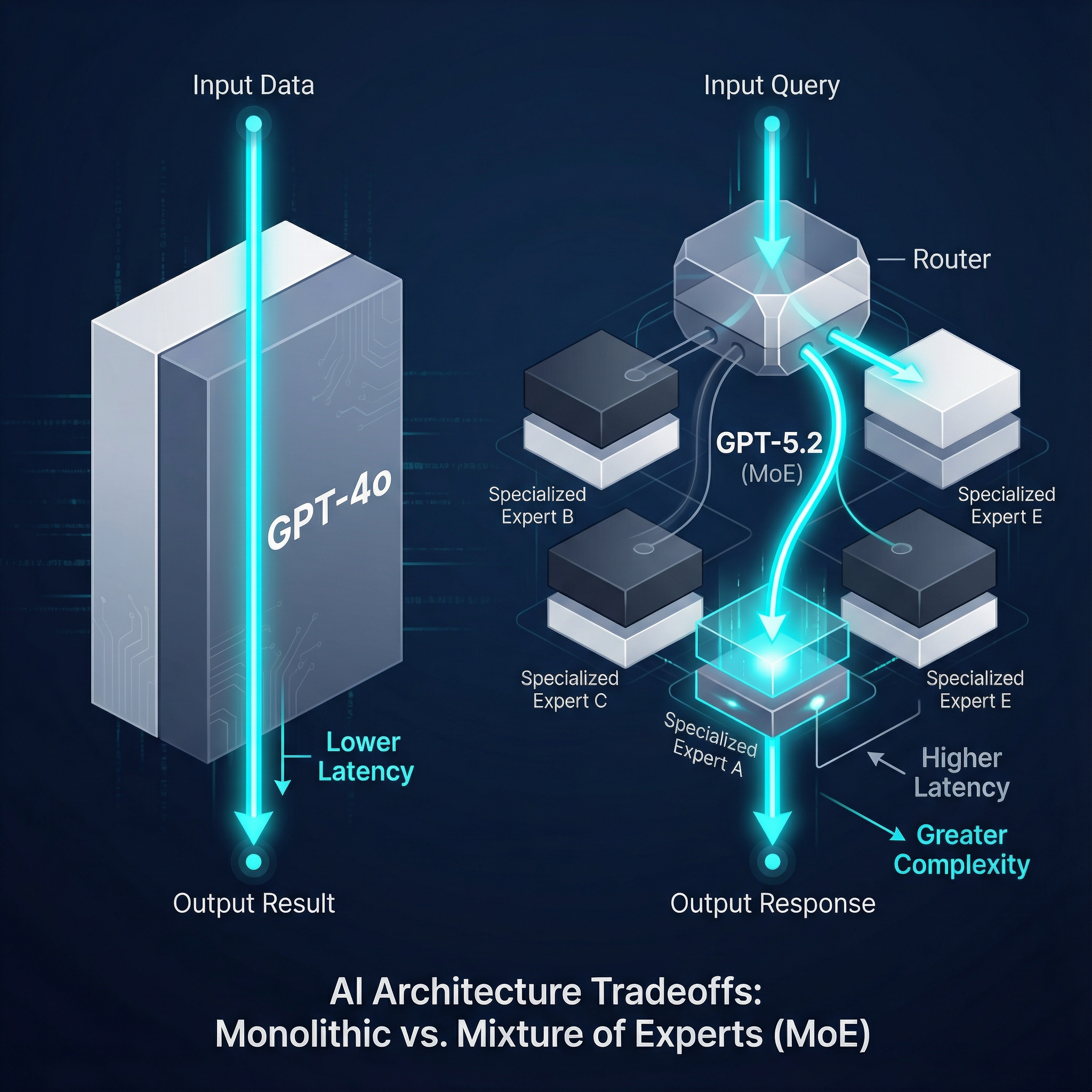

- Arquitectura: Se cree ampliamente que es un modelo sofisticado de Mezcla de Expertos (MoE).A diferencia de sus predecesores, probablemente dirige consultas a subredes especializadas, mejorando la eficiencia y la capacidad en tareas de dominios específicos (por ejemplo, codificación frente a escritura creativa).

- Ventana de contexto: ampliada a 400.000 tokens robustos, lo que permite un análisis más profundo de documentos grandes, bases de código o historiales de conversaciones complejos.

- Multimodalidad: GPT-5.2 es multimodal de forma nativa y procesa texto, imágenes y entradas de audio con una comprensión más unificada.Esto le permite interpretar visualizaciones de datos complejas, interfaces de usuario y señales de audio al instante, sin encadenar modelos separados.

- Fichas de razonamiento: La especulación apunta a un nuevo mecanismo, posiblemente "fichas de razonamiento", que permite al modelo realizar un pensamiento más explícito del "Sistema 2" antes de generar una respuesta final, mejorando su rendimiento en problemas lógicos y matemáticos complejos.

Por qué GPT-5.2 es importante para los sistemas de producción

Para quienes construyen productos del mundo real, el valor de un nuevo modelo se mide en confiabilidad y desempeño, no solo en puntajes de referencia.

1. Fiabilidad

El avance más significativo es la dramática reducción de las tasas de alucinaciones.Para aplicaciones de misión crítica en análisis legales, médicos o financieros, esta confiabilidad mejorada mueve la aguja de "experimental" a "confiable".

2. Profundidad del razonamientoMientras que GPT-4 a menudo requería cadenas de mensajes complejas para deconstruir un problema, GPT-5.2 puede manejar la lógica de varios pasos en una sola inferencia.Esto simplifica la arquitectura de la aplicación y reduce los puntos de falla.

3. Capacidad agente

La llamada a funciones y el modo JSON ahora son "sólidos", según los primeros comentarios de los desarrolladores.La capacidad del modelo para adherirse de manera confiable a formatos de datos estructurados lo convierte en el nuevo estándar de oro para impulsar agentes autónomos y flujos de trabajo predecibles impulsados por API.

La compensación

Este salto en inteligencia tiene un costo.GPT-5.2 tiene una latencia más alta y un precio por token más alto que sus predecesores.El desafío central de la ingeniería ya no es "¿Es el modelo lo suficientemente inteligente?"pero "¿Vale la pena la latencia y el costo de la inteligencia adicional para este caso de uso específico?"

Desbloquee GPT-5.2 para su entorno de producción

¿Estás cansado de las listas de espera y los costos impredecibles? Obtén acceso inmediato y escalable a la API GPT-5.2 sin fricciones.EvoLink proporciona una API unificada con precios por volumen al por mayor y confiabilidad de nivel empresarial.

Capacidades y fortalezas principales

Los puntos fuertes de GPT-5.2 son más evidentes en tareas que requieren gran experiencia y precisión.

-

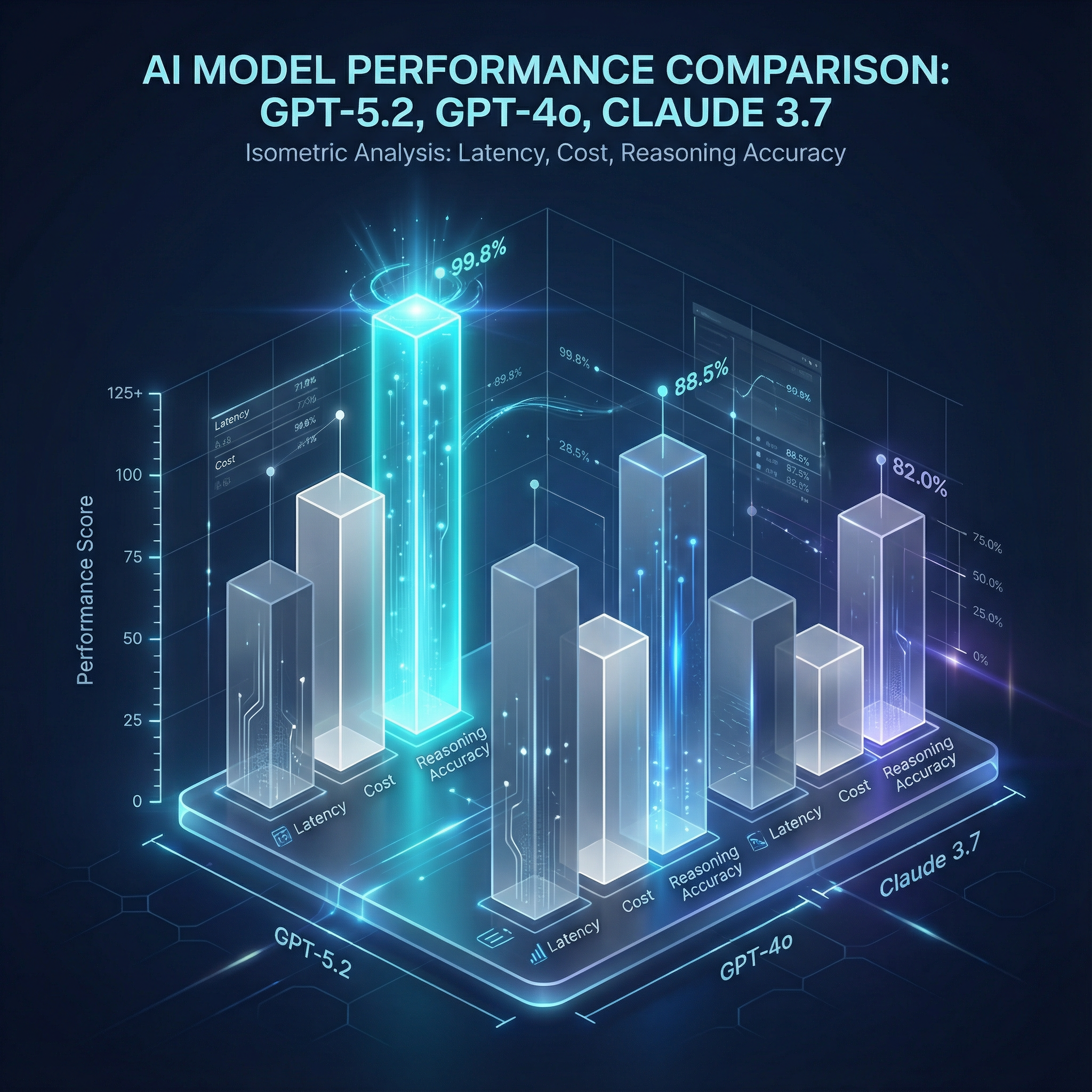

Razonamiento avanzado: supera a GPT-4o y Claude 3.7 en puntos de referencia clave como MATH y GSM8K, lo que demuestra su capacidad para resolver problemas matemáticos y lógicos de nivel de posgrado.

-

Competencia en codificación: Muestra mejoras significativas en HumanEval y SWE-bench.No sólo puede generar código sino también comprender y depurar repositorios complejos, lo que lo convierte en un potente programador de pares.

-

Fluidez multimodal: Puede analizar instantáneamente gráficos financieros, explicar capturas de pantalla de la interfaz de usuario en un script de automatización o transcribir y resumir audio, todo mediante una única llamada API.

-

Recuerdo de contexto largo: Sobresale en las pruebas de "Aguja en un pajar", recordando con precisión hechos específicos enterrados en lo profundo de su ventana de contexto de token de 400K.Esto es fundamental para los sistemas RAG que analizan trabajos de investigación o documentos legales densos.

Puntos de referencia y compensaciones (los números "reales")

Si bien los puntos de referencia cuentan parte de la historia, las métricas de producción importan más.Aquí hay una comparación pragmática basada en datos iniciales e informes comunitarios.

| Modelo | Costo de entrada ($/1 millón de tokens) | Costo de producción ($/1 millón de tokens) | Ventana contextual |

|---|---|---|---|

| GPT-5.2 | $1,75 | $14.00 | 400K |

| GPT-4o | $1,25 | $10.00 | 128K |

| Claude 3,7 | $1,50 | $12.00 | 200K |

| Llama 4 (Abierto) | $0,50 | $4.00 | 100K |

Métricas clave

-

Latencia (TTFT): El tiempo hasta el primer token de GPT-5.2 es notablemente mayor que el de GPT-4o.En el caso de los chatbots conversacionales en tiempo real, esto puede degradar la experiencia del usuario.Es más adecuado para tareas asincrónicas en las que unos pocos segundos de tiempo de procesamiento son aceptables.

-

Costo por token: A $1,75 (entrada) y $14,00 (salida) por millón de tokens, es la opción premium.Una tarea compleja que es más barata en GPT-5.2 (debido a que hay menos reintentos) aún podría costar más en términos absolutos que un enfoque de avisos encadenados en GPT-4o.

-

Rendimiento (TPS): Los proveedores oficiales a menudo imponen límites estrictos de tarifas (acceso de "Nivel 5"), lo que dificulta la ampliación.Los sistemas de producción requieren una solución que pueda manejar una gran cantidad de tokens por segundo (TPS) y gestionar la concurrencia, un beneficio fundamental de utilizar una puerta de enlace API como EvoLink.

Sentimiento de los desarrolladores e información de la comunidad

La reacción de la comunidad de ingenieros ha sido pragmática y perspicaz, superando las expectativas.

alabanza

"Finalmente resuelve tareas lógicas complejas con menos alucinaciones. Reemplazamos una cadena de indicaciones de 5 pasos con una sola llamada a GPT-5.2".

"El modo JSON es sólido para las respuestas API. Estamos viendo un cumplimiento del 99,9%, algo inaudito en modelos anteriores".

Quejas

"Mayor latencia para resultados más inteligentes. Es difícil vender nuestras funciones interactivas".

"La migración fue sencilla, pero el costo por token aumenta rápidamente. Tienes que ser muy deliberado sobre qué tareas le transfieres".

Un tema recurrente en los foros de desarrolladores es el cálculo del "coste frente a la capacidad".Un usuario de Reddit señaló:

"La función alternativa de EvoLink nos salvó durante los picos de carga. Dirigimos consultas simples a 4o y solo usamos 5.2 para el trabajo pesado. Es la única manera de hacer que la economía funcione".

Precios y rentabilidad

Ejecutar GPT-5.2 a escala supone un compromiso financiero importante.El problema de acceso al "Nivel 5" a través de proveedores oficiales significa que muchas empresas se topan con un muro debido a los estrictos límites de tarifas y las listas de espera.Además, gestionar la facturación a través de múltiples modelos y proveedores genera gastos operativos innecesarios.

Aquí es donde una capa de infraestructura API se vuelve crítica.EvoLink aborda estos desafíos directamente:

-

Precios por volumen al por mayor: Al agregar la demanda, EvoLink ofrece acceso a modelos como GPT-5.2 a precios con descuento por volumen que normalmente no están disponibles para empresas individuales.

-

Facturación unificada: Consolide gastos en GPT-5.2, GPT-4o, Claude y otros modelos en una sola factura.Esto simplifica el seguimiento de costos y la gestión del presupuesto para toda su pila de IA.

-

Enrutamiento inteligente y alternativas: No pague precios elevados por tareas sencillas.Utilice EvoLink para enrutar dinámicamente las solicitudes al modelo más rentable que pueda realizar el trabajo, con respaldos automáticos para garantizar el tiempo de actividad.

Cómo integrar GPT-5.2 mediante API

base_url al punto final EvoLink.Este único cambio desbloquea el enrutamiento independiente del modelo, las alternativas y la optimización de costos sin alterar la lógica principal de su aplicación.Aquí hay un fragmento limpio de Python que muestra una llamada de transmisión a GPT-5.2 a través de la puerta de enlace API EvoLink.

import requests

url = "https://api.evolink.ai/v1/chat/completions"

payload = {

"modelo": "gpt-5.2",

"mensajes": [

{

"rol": "usuario",

"content": "Preséntate"

}

],

"temperatura": 1,

"corriente": False,

"top_p": 1,

"penalización_frecuencia": 0,

"presencia_penalización": 0

}

headers = {

"Autorización": "Portador <token>",

"Tipo de contenido": "aplicación/json"

}

response = requests.post(url, json=payload, headers=headers)

print(response.text)Lista de verificación de migración: ¿Está lista su aplicación para GPT-5.2?

- Identificar casos de uso de alto valor: Identifique tareas en las que el razonamiento profundo y las alucinaciones bajas sean fundamentales (por ejemplo, análisis de contratos legales, generación de códigos complejos).

- Evaluar la tolerancia a la latencia: ¿Puede su experiencia de usuario tolerar un tiempo de respuesta un poco más largo para obtener una respuesta mucho más inteligente?

- Implemente un enrutador/puerta de enlace: Utilice un servicio como EvoLink para evitar la dependencia del proveedor y permitir la conmutación dinámica entre GPT-5.2 y modelos más económicos como GPT-4o.

- Reescribir indicaciones críticas: Si bien muchas indicaciones funcionan listas para usar, ajuste sus indicaciones del sistema más importantes para aprovechar las capacidades de razonamiento avanzadas de GPT-5.2.

- Supervise los costos de cerca: Configure paneles para realizar un seguimiento del consumo de tokens.El coste de GPT-5.2 puede aumentar rápidamente si se utiliza para cada consulta.

Casos de uso y guía de decisiones

Elegir el modelo correcto es una decisión arquitectónica crítica.

Cuándo usar GPT-5.2

-

Agentes autónomos: al crear agentes que necesitan realizar tareas de varios pasos con alta confiabilidad y usar herramientas (llamadas a funciones) correctamente en todo momento.

-

RAG complejo: Para sistemas de respuesta a preguntas que deben sintetizar información de múltiples documentos técnicos densos con alta fidelidad.

-

Asistentes de codificación avanzada: para herramientas que necesitan comprender bases de código completas, generar lógica compleja e identificar errores sutiles.

-

Análisis legal y médico: En ámbitos donde la precisión no es negociable y las alucinaciones son inaceptables.

Cuándo alojarse en GPT-4o / Mini

-

Clasificadores de alto volumen: Para clasificación de texto simple, análisis de opiniones o extracción de datos donde la velocidad y el bajo costo son primordiales.

-

Chatbots simples: Cuando el objetivo es el flujo de conversación y respuestas rápidas en lugar de una resolución profunda de problemas.

-

Flujos de latencia crítica: Para aplicaciones en tiempo real como transcripción en vivo o sugerencias de búsqueda interactivas donde cada milisegundo cuenta.

Conclusión: el camino de la actualización estratégica

GPT-5.2 es más que un simple modelo nuevo y potente;Es una herramienta especializada para tareas de razonamiento de alto riesgo.Una actualización general de todos sus flujos de trabajo de IA a GPT-5.2 no sólo es poco práctica debido al costo y la latencia, sino que también es una mala ingeniería.La estrategia óptima es adoptar un enfoque multimodelo, utilizando una puerta de enlace API sólida como EvoLink para enrutar las tareas al modelo adecuado para el trabajo.Esto le permite aprovechar el poder de GPT-5.2 para los problemas complejos que lo exigen, manteniendo al mismo tiempo la rentabilidad y la baja latencia para todo lo demás. El futuro de la IA de producción no consiste en encontrar el "mejor" modelo, sino en construir un sistema flexible, inteligente y rentable.

Preguntas frecuentes (FAQ)

1. ¿Cómo se compara el precio de GPT-5.2 con el de GPT-4o?

GPT-5.2 es significativamente más caro por token.En promedio, se puede esperar que los costos de insumos sean ~40% más altos y los costos de producción sean ~40% más altos que GPT-4o.Esto hace que las estrategias de gestión de costos sean esenciales.

2. ¿La ingeniería rápida es diferente para GPT-5.2?

Si bien muchas indicaciones funcionarán tal como están, es posible que no aproveches toda su potencia.Las indicaciones se pueden simplificar, con menos necesidad de "cadena de pensamiento" o ejemplos de pocas tomas, ya que el razonamiento inherente del modelo es más sólido.

3. ¿Qué tan confiable es el modo JSON de GPT-5.2?

Extremadamente confiable.Los comentarios de los desarrolladores indican que es una de las características destacadas del modelo, lo que lo hace perfecto para la extracción de datos estructurados y la creación de flujos de trabajo agentes confiables.

4. ¿Cuáles son los principales beneficios de usar EvoLink para GPT-5.2?

EvoLink proporciona una API unificada para acceder a GPT-5.2 junto con otros modelos, facturación consolidada, descuentos en precios por volumen, enrutamiento inteligente para optimizar costos y capacidades alternativas para mejorar la confiabilidad.

5. ¿Cómo se compara la ventana contextual de GPT-5.2 con Claude 3.7?

GPT-5.2 presenta una ventana de contexto de token de 400 000, que es el doble de la ventana de contexto de 200 000 de Claude 3.7.Esto le permite procesar y analizar volúmenes de información mucho mayores en una sola pasada.