DeepSeek V4 API 评测指南 2026:Flash vs Pro 选型、迁移与生产上线清单

deepseek-v4-flash 和 deepseek-v4-pro 两个模型,公布了各自的定价,并标注支持 1M context 和 384K max output。同日,路透社也报道了 V4 以 preview 形式发布——也就是说,团队现在就可以开始评估,但在正式版发布前,模型行为仍可能调整。DeepSeek API Docs DeepSeek Models & Pricing Reuters via Investing.com这意味着实际决策逻辑发生了变化:

- DeepSeek V4 Flash 已经是一个可用于生产路由的低成本选项

- DeepSeek V4 Pro 已经是一个值得跑 benchmark 的高端 DeepSeek 路由

- Claude Opus 4.7 现在是 Anthropic 的当前旗舰基线,不再是 Opus 4.6

- GPT-5.4 仍然是 OpenAI 阵营中文档最齐全的旗舰模型,适合专业和编程场景

本指南适用于谁

如果你属于以下角色,这篇文章会最有帮助:

- 正在考虑是否将 DeepSeek V4 接入路由系统的工程负责人

- 需要从

deepseek-chat和deepseek-reasoner迁移的平台团队 - 想在不大幅损失质量的前提下降低编程模型成本的产品团队

- 需要决定何时路由到 Flash、何时升级到 Pro、何时继续用 GPT-5.4 或 Claude Opus 4.7 的 AI 团队

一句话总结

- 优先测试 DeepSeek V4 Flash——如果你的核心诉求是低成本编程、长 context 路由和高吞吐的 agent 工作负载。官方定价为 $0.14 input / $0.28 output(每百万 token),支持 1M context 和 384K max output。DeepSeek Models & Pricing

- 选择 DeepSeek V4 Pro——如果你的任务偏重推理或复杂编程,需要比 Flash 更强的能力但不想付 Claude 级别的价格。官方定价为 $1.74 input / $3.48 output(每百万 token)。DeepSeek Models & Pricing

- 选择 Claude Opus 4.7——如果你需要 Anthropic 当前最强的通用编程和 agent 模型,并且能接受 $5 / $25(每百万 token) 的高端定价。Anthropic Claude Opus 4.7

- 选择 GPT-5.4——如果你需要 OpenAI 官方旗舰路由,1,050,000 context、128,000 max output,以及完整的 OpenAI 平台支持,定价 $2.50 / $15.00。OpenAI Pricing OpenAI GPT-5.4 Model

- 不要一步到位地盲目迁移。 DeepSeek V4 已有公开文档且可在 preview 阶段使用,但 preview 意味着你仍应使用真实工作负载评估,保留回滚路径,并在路由逻辑中将 Flash 和 Pro 分开处理。Reuters via Investing.com

DeepSeek V4 的现状

关于 DeepSeek V4 的讨论,比 4 月初已经清晰得多了。

- 公开的 API 模型 ID:

deepseek-v4-flash、deepseek-v4-pro - context 长度:

1M - max output:

384K - 支持 thinking 模式

- 支持 tool calls

deepseek-chat和deepseek-reasoner仍可使用以保持兼容,但计划于 2026 年 7 月 24 日 下线

DeepSeek V4 Flash vs Pro:如何选择

这是整个 DeepSeek V4 上线过程中最关键的决策。

| 对比维度 | DeepSeek V4 Flash | DeepSeek V4 Pro |

|---|---|---|

| 官方 input 定价 | $0.14 / 1M(cache miss) | $1.74 / 1M(cache miss) |

| 官方 output 定价 | $0.28 / 1M | $3.48 / 1M |

| Context | 1M | 1M |

| Max output | 384K | 384K |

| 最佳角色 | 通用默认路由 | 高智能高端路由 |

| 最佳首选测试场景 | 高并发编程、路由分发、仓库分析 | 更难的编程和推理任务 |

| 主要取舍 | 能力上限低于高端模型 | 成本高于 Flash |

如果你的核心问题是"能不能低成本大规模跑",选 Flash

Flash 是你应该优先测试的默认路由,适用于:

- 低成本的默认编程模型

- 便宜的长 context 路由

- output 成本敏感的 agent 系统

- 需要在多个团队广泛开放使用但不想费用失控

如果你目前在用更贵的前沿模型处理简单编程、摘要、仓库阅读或中等复杂度的 agent 工作流,Flash 是最明显的替代候选。

如果你的核心问题是"在哪些场景需要更强的智能",选 Pro

Pro 适合以下场景:

- 需要比预算路由更高的编程和推理质量

- 更难的多步骤分析

- 更长的结构化输出

- 需要高端路由但希望 output 成本低于 Claude Opus 4.7

最简单的心智模型是:

- Flash = 默认路由

- Pro = 升级路由

在生产中,这种分层架构通常比强行把一个昂贵模型塞进所有场景效果更好。

DeepSeek V4 对编程团队值得吗?

对很多编程团队来说,值得——但不建议盲目全量替换。

DeepSeek V4 值得认真评估的情况:

- 你有大量代码生成、代码审查、仓库阅读或长 context 编程工作

- 目前的 output token 账单让人肉疼

- 你需要一个更便宜的默认路由给 agent 和编程助手

- 你愿意做分阶段上线而非一刀切迁移

不太适合的情况:

- 你最难的工作流已经能通过高端闭源模型的定价获得足够价值

- 团队更依赖某一厂商的平台功能而非模型经济性

- 你还没有评估集和回滚路径

DeepSeek V4 与 GPT-5.4 和 Claude Opus 4.7 的对比

如果你的团队需要跨模型家族做选型,当前最有参考价值的基线已经不再是 Claude Opus 4.6,而是:

- DeepSeek V4 Flash

- DeepSeek V4 Pro

- GPT-5.4

- Claude Opus 4.7

| 模型 | Input | Output | Context | Max output | 最佳适用场景 |

|---|---|---|---|---|---|

| DeepSeek V4 Flash | $0.14 | $0.28 | 1M | 384K | 最便宜的长 context 生产路由 |

| DeepSeek V4 Pro | $1.74 | $3.48 | 1M | 384K | DeepSeek 高端路由 |

| GPT-5.4 | $2.50 | $15.00 | 1,050,000 | 128K | OpenAI 官方旗舰 |

| Claude Opus 4.7 | $5.00 | $25.00 | 1M | 128K | Anthropic 最强的 GA 编程和 agent 路由 |

DeepSeek V4 的最大优势在哪

根据官方文档的功能和定价结构,DeepSeek V4 在以下条件同时满足时优势最突出:

- 长 context 是刚需

- output 成本敏感

- 工作负载以编程和 agent 为主

- 你想把廉价默认路径和更强的高端路径分开

能同时满足这些条件的场景并不多见,这也是 DeepSeek V4 的影响力远超普通模型发布的原因。

GPT-5.4 在什么场景下仍然合理

GPT-5.4 仍然合理的场景:

- 你需要端到端的 OpenAI 官方平台支持

- 团队已经深度依赖 OpenAI 的工具和集成

- 你需要 OpenAI 官方旗舰的编程和专业工作路由

- 你更看重平台一致性而非纯粹的 output 成本

Claude Opus 4.7 在什么场景下仍然合理

Claude Opus 4.7 是正确选择的场景:

- 你需要 Anthropic 最强的通用编程路由

- 你的工作流依赖持续的 agent 运行

- 你需要 Claude 在 effort 控制和长时间任务方面不断演进的控制能力

- 你的团队愿意为质量和可靠性支付溢价

DeepSeek V4 在真实工作负载下的实际成本

官方的百万 token 单价只是参考。团队买的不是"一百万个 token",而是业务结果。

以下是基于官方公开定价的几个贴近实际工作负载的成本示例,token 用量仅用于展示成本结构。

场景一:仓库分析

假设:

- 250K input token

- 20K output token

预估 API 费用:

- DeepSeek V4 Flash:约 $0.04 input + $0.01 output

- DeepSeek V4 Pro:约 $0.44 input + $0.07 output

- GPT-5.4:约 $0.63 input + $0.30 output

- Claude Opus 4.7:约 $1.25 input + $0.50 output

这就是为什么 Flash 是代码库阅读、依赖审计和仓库摘要的首选测试对象。

场景二:多轮对话编程 agent 任务

假设:

- 120K input token

- 80K output token

预估 API 费用:

- DeepSeek V4 Flash:约 $0.02 input + $0.02 output

- DeepSeek V4 Pro:约 $0.21 input + $0.28 output

- GPT-5.4:约 $0.30 input + $1.20 output

- Claude Opus 4.7:约 $0.60 input + $2.00 output

这里的核心教训不是高端模型"不好",而是 output 密集型工作负载会被昂贵的 output 定价严重放大成本。

场景三:长文档或法律审查

假设:

- 400K input token

- 25K output token

这些场景说明了什么

如果你的产品主要做:

- 代码生成

- 代码审查

- 长仓库阅读

- 长 PDF 或政策文档审查

- 多步骤 agent 循环

DeepSeek V4 仍然存在的局限

一篇有用的评测不应假装所有优势放之四海而皆准。

1. Preview 状态仍然是重要考量

2. 你仍然需要自己的评估集

- agent 循环

- 代码审查精度

- diff 质量

- 长时间运行任务

- schema 可靠性

3. 高端闭源模型在你最难的任务上可能仍然更强

Claude Opus 4.7 和 GPT-5.4 仍然重要,因为有些工作负载确实值得为之付更高的价格:

- 风险最高的代码变更

- 最难的 agent 任务

- 失败成本很高的企业工作流

- 平台工具生态与模型价格同等重要的环境

正确的对比方式不是"哪个模型在网上赢了",而是"哪个模型在我能安全路由给它的任务上成本最低"。

什么时候仍然应该用 Claude Opus 4.7 或 GPT-5.4?

保留 Claude Opus 4.7 的场景:

- 你的团队需要处理最难的编程和代码审查任务

- 你需要 Anthropic 最强的通用模型

- agent 可靠性比 token 成本更重要

保留 GPT-5.4 的场景:

- 你的团队已经深度投入 OpenAI 平台

- 你需要 OpenAI 官方旗舰路由用于专业和编程工作

- 你的工作流同样依赖 OpenAI 周边工具

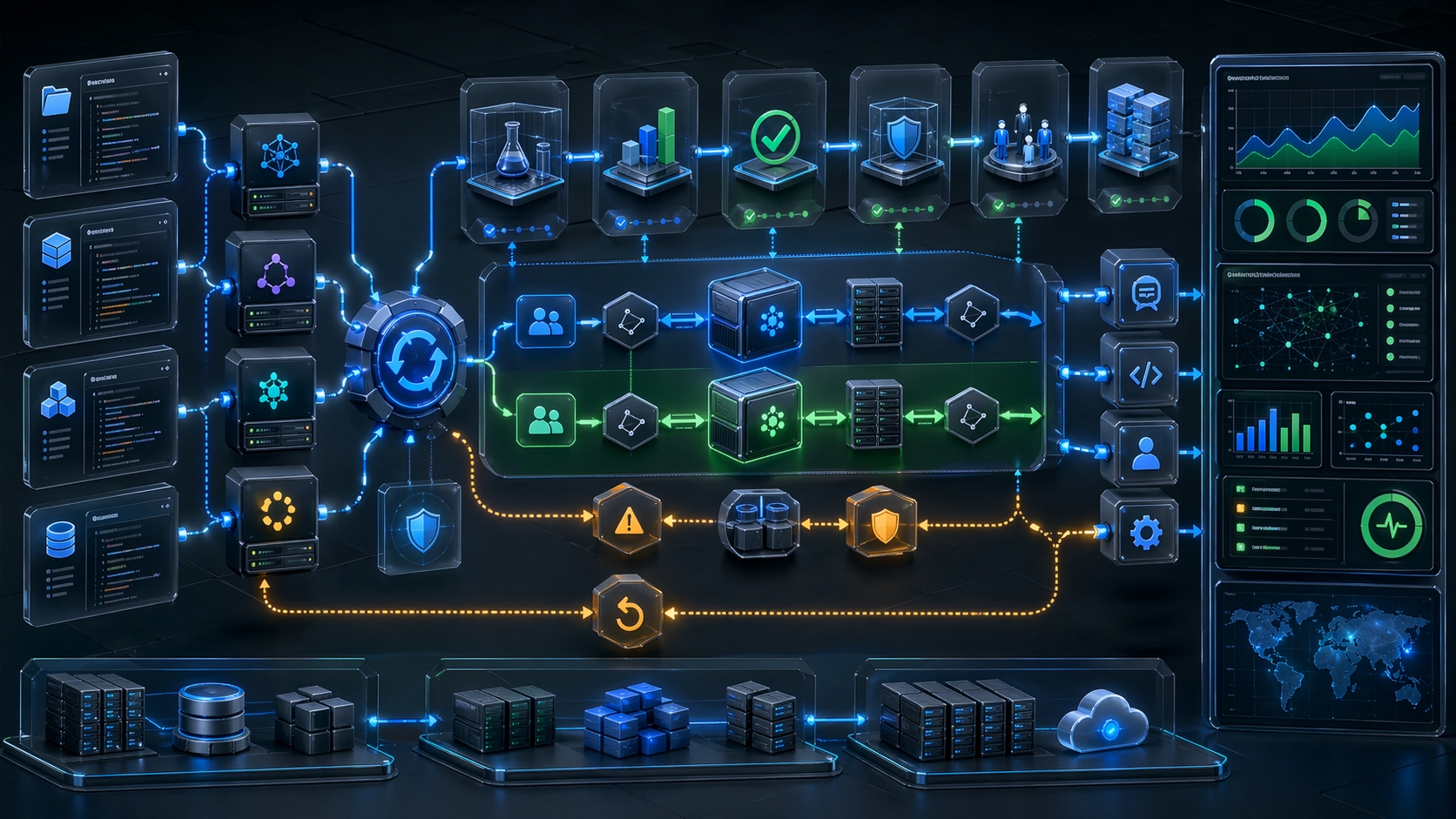

多数团队最务实的架构

对很多生产系统来说,最佳答案不是"全部替换",而是:

- DeepSeek V4 Flash 作为廉价默认路由

- DeepSeek V4 Pro 用于更难的 DeepSeek 适用场景

- Claude Opus 4.7 或 GPT-5.4 作为高端兜底和升级路由

这种架构通常比试图找出一个万能冠军模型更合理。

如何从 deepseek-chat 和 deepseek-reasoner 迁移

这是现在发布本指南最实际的原因之一。

DeepSeek 官方文档说明:

deepseek-chat计划于 2026 年 7 月 24 日 下线deepseek-reasoner计划于 2026 年 7 月 24 日 下线- 为保持兼容,两者分别映射到

deepseek-v4-flash的非思考模式和思考模式

推荐迁移路径

- 盘点当前生产中所有 DeepSeek 路由

找出你的应用中还在引用以下内容的地方:

deepseek-chatdeepseek-reasoner- 与旧 output 行为绑定的硬编码 prompt 逻辑

- 先测试

deepseek-v4-flash

由于兼容别名指向的是 Flash 行为,Flash 通常是风险最低的首选迁移目标。

- 仅将特定工作负载升级到 Pro

不要默认把所有东西都切到 Pro。先给 Pro 一个明确的定位:

- 高难度编程任务

- 深度分析

- 高价值的升级路径

- 保持回滚路由可用

Preview 阶段意味着你应该能够在以下情况下快速回退或重新路由:

- 质量下降

- 延迟飙升

- schema 可靠性变化

- tool use 行为出现差异

迁移对照表

| 旧路由 | 短期替换方案 | 长期建议 |

|---|---|---|

deepseek-chat | deepseek-v4-flash 非思考模式 | 将 Flash 作为低成本默认路由 |

deepseek-reasoner | deepseek-v4-flash 思考模式 | 测试 Pro 是否在你最难的任务上表现更好 |

DeepSeek V4 生产上线清单

如果你正在评估 DeepSeek V4 的实际落地,建议参照以下清单:

- 从自己的工作负载中选出 20 到 50 个真实任务

- 将简单的默认路由任务和高端路由任务分开

- 分别对 Flash 和 Pro 进行独立基准测试

- 对比实际输出质量,而不只是 benchmark 标题

- 衡量每个成功任务的成本,而不只是每 token 的成本

- 保留 GPT-5.4 或 Claude Opus 4.7 的回滚路由

- 对 prompt 和评估流程做版本管理

- 单独记录 tool call 失败和 schema 失败

- 在 preview 期间关注延迟和重试模式

- 提前定义"达到什么标准才可以正式上线"

这是很多发布文章会跳过的部分,但恰恰是这部分决定了一个模型到底是省了钱还是带来了隐性运维成本。

按团队类型的推荐决策

团队 A:成本敏感的编程平台

团队 B:输出质量要求极高的企业应用

团队 C:长 context 产品

DeepSeek V4 的吸引力格外突出,因为它同时具备:

- 官方 1M context

- 超大 384K output

- 极低的 output 定价

团队 D:多模型路由架构

对很多团队来说,现在最清晰的技术栈可能是:

- DeepSeek V4 Flash 作为廉价默认路由

- DeepSeek V4 Pro 用于更难的推理和编程

- Claude Opus 4.7 或 GPT-5.4 用于高端升级路由

最终结论

DeepSeek V4 的意义在于它改变了路由经济学,而不是它能神奇地替代所有高端闭源模型。

目前最有力的结论是:

- Flash 是一个值得认真考虑的默认路由候选

- Pro 是一个值得认真考虑的高端 DeepSeek 路由

- GPT-5.4 和 Claude Opus 4.7 在高端和高风险工作负载中仍然不可替代

- 最佳的上线方式是分阶段推进,而不是一步到位

如果你的团队只需要一句话建议,那就是:

FAQ

DeepSeek V4 现在可以用了吗?

deepseek-v4-flash 和 deepseek-v4-pro,路透社也在 2026 年 4 月 24 日 报道了 DeepSeek 发布 V4 preview 版本。DeepSeek API Docs Reuters via Investing.com应该先测试 Flash 还是 Pro?

DeepSeek V4 对编程团队值得用吗?

通常值得——前提是你的团队对成本敏感、output 量大,或者有大量长 context 编程工作。最佳方式是分阶段评估,而非立即全量替换。

DeepSeek V4 是开源的吗?

DeepSeek V4 比 GPT-5.4 和 Claude Opus 4.7 便宜吗?

仓库级别的编程工作应该用 Flash 还是 Pro?

应该立刻替换 Claude Opus 4.7 或 GPT-5.4 吗?

通常不建议。更稳妥的做法是分层路由:先测试 Flash,再评估 Pro,在你的真实工作负载验证 V4 可靠之前保留高端模型作为兜底。

deepseek-chat 和 deepseek-reasoner 会怎样?

deepseek-v4-flash 的兼容行为。DeepSeek API Docs哪里可以看到 DeepSeek V4 API 的详细路由信息?

来源

- DeepSeek API Docs

- DeepSeek Models & Pricing

- DeepSeek V4 Pro LICENSE on Hugging Face

- OpenAI API Pricing

- OpenAI GPT-5.4 Model

- Anthropic Claude Opus 4.7

- China's AI darling DeepSeek previews new model | Reuters via Investing.com

准备测试 DeepSeek V4?

相关阅读:

- DeepSeek V4 Is Live in Preview: Official API Models, Pricing, and What Changed

- DeepSeek V4 Flash & Pro vs GPT-5.4 vs Claude Opus 4.6: Official Pricing and Capability Comparison (历史基线——基准为 Opus 4.6)

- 编码代理最佳 LLM:API 成本、工具调用与可靠性对比 — 了解 DeepSeek V4 在编码代理工作负载中的表现

- DeepSeek 状态与编码工作负载故障转移方案 — 监控 DeepSeek 可用性和规划故障转移

- 重试和失败率如何改变编码代理的 API 成本 — 包含失败和重试的真实成本