如何把 GPT Image 2 和 Seedance 2.0 串起来用:为什么团队会这样做,以及它如何用于分镜和短视频

如何把 GPT Image 2 和 Seedance 2.0 串起来用

gpt-image-2。ByteDance 和 BytePlus 也公开文档化了 Seedance 2.0,并说明它支持文本、图像、音频和视频输入。这样一来,这种搭配就很好理解了:gpt-image-2 更适合做前期视觉结构,Seedance 2.0 更适合做运动、节奏和视听执行。TL;DR

- 当你需要角色设定图、分镜网格、关键帧、标题卡、海报或其他结构化视觉资产时,优先用

gpt-image-2。 - 当你已经知道画面应该长什么样,只差运动、镜头行为和短视频成片时,优先用 Seedance 2.0。

- 比起强行让一个模型一次性做完所有事情,这种两阶段组合通常更稳。

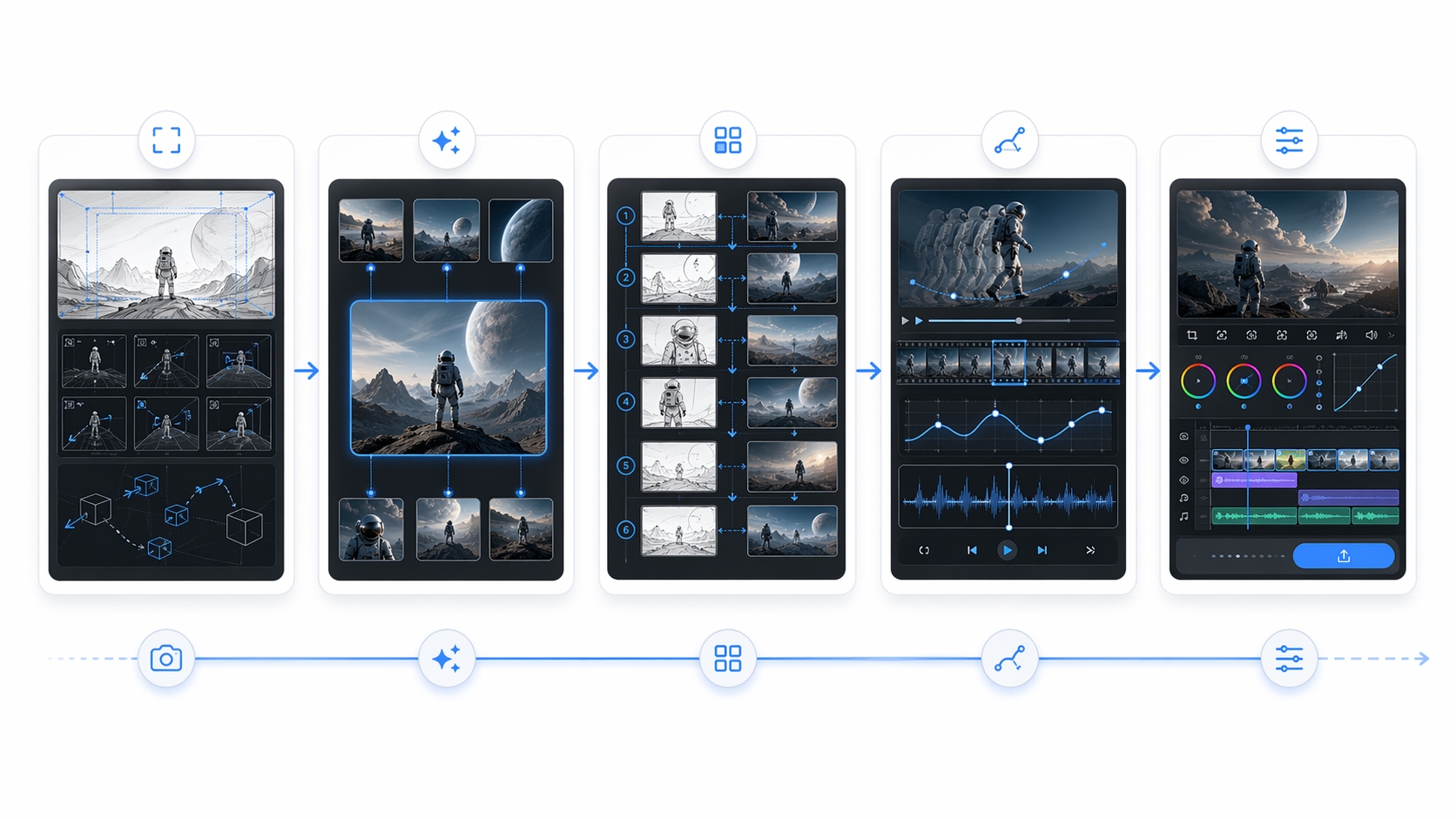

- 最常见的工作流是:先定义镜头 -> 生成视觉锚点 -> 做分镜或关键帧 -> 在 Seedance 2.0 里做运动 -> 在剪辑阶段补标题和节奏。

- 这套组合更适合 预告片、teaser、视觉叙事、产品短视频和社媒短片,不太适合纯 talking head 或单图任务。

这两个模型各自最适合做什么

理解这套组合的最好方式,不是按“谁更强”,而是按生产阶段来拆。

| 阶段 | GPT Image 2(gpt-image-2) | Seedance 2.0 |

|---|---|---|

| 主要职责 | 前期视觉设计 | 运动化和短视频生成 |

| 最适合的输入 | 文本,外加可选图片参考 | 文本、图片、音频、视频 |

| 最适合的输出 | 角色设定图、分镜页、漫画式面板、海报、关键帧、标题卡 | image-to-video、多模态 reference-to-video、偏编辑型视频工作流 |

| 最适合解决的问题 | 锁定视觉结构和一致性 | 增加时间、运动、镜头方向和视听感 |

| 官方已文档化的能力重点 | 快速、高质量图像生成与编辑 | 带图片、音频、视频参考的多模态视频生成 |

如果你现在卡住的问题是:

- 角色到底应该长什么样

- 单帧画面里该放什么

- 视觉信息密度该怎么安排

- 一段内容在动起来之前应该怎么排布

那 GPT Image 2 通常是更好的起点。

如果你现在卡住的问题是:

- 场景应该怎么动

- 镜头应该怎么走

- 节拍之间如何推进

- 片子整体应该如何在时间维度上成立

那 Seedance 2.0 通常更合适。

为什么团队会把它们串起来,而不是强迫一个模型做完全部

1. 视觉一致性会更早被锁住

直接 text-to-video 当然也能工作,但它需要一次性同时解决角色设计、构图、运动、场景逻辑、节奏,有时还包括音频。把这些前期视觉决策先在 GPT Image 2 里完成,后面的 video 阶段出漂移的机会就会少很多。

这在以下输出里尤其重要:

- trailer

- teaser

- 社媒广告

- 有重复角色的短叙事

- 风格明确的视觉短片

2. 节奏会更容易控制

比起让视频模型自己发明整个序列,这个工作流更像:

- 先决定镜头

- 再把镜头可视化

- 最后把镜头动起来

这通常比一条超长 prompt 更容易调试。

3. 带文字和版式的画面更容易保住

OpenAI 把 GPT Image 2 定位为高质量图像生成和编辑模型,而 ChatGPT Images 2.0 的发布内容也反复强调了结构化版式、多语言文字渲染、漫画页、reference sheet 和编辑式构图。这让它更适合先产出下面这些静态资产:

- 标题卡

- 海报式版式

- 漫画或 manga 风格页面

- 类界面型视觉

- 品牌化或信息密集型构图

而这些,恰恰是直接丢进视频运动阶段时最容易坏掉的部分。

最常见的两种组合方式

这套组合通常会落在两种模式里。

| 工作流 | 在 GPT Image 2 里先做什么 | 在 Seedance 2.0 里怎么收尾 | 最适合的场景 |

|---|---|---|---|

| 分镜优先 | 3x3 分镜网格图或多格故事页 | 把分镜作为 image-to-video 或 reference-driven video 的起点 | 预告片、teaser、短叙事 |

| 关键帧优先 | 角色设定图、风格锚点、4 到 6 张关键帧、标题卡 | 把每张图分别动画化,再拼成短片 | 产品短视频、角色 PV、社媒剪辑、风格化广告 |

一套足够轻量的实操流程

你不需要一个特别重的管线。对大多数团队来说,一个五步流程就够了。

1. 先写镜头意图

在提示任何模型之前,先写一个简短 shot list:

目标:15 秒 teaser

镜头 1:建立主体和氛围

镜头 2:局部特写带出张力

镜头 3:扩展世界观或产品语境

镜头 4:出现运动或冲突

镜头 5:最终揭示或标题定格这就够了。重点不是把它写成“高级 prompt”,而是先把片子要表达什么定下来。

2. 用 GPT Image 2 锁角色和风格锚点

正式做序列前,先做一两张锚点图:

- 一张角色设定图或产品视觉锚点

- 一张风格锚点,用来锁颜色、光线和材质

如果这些基础图不稳,后面的运动阶段通常只会把问题放大。

3. 做分镜网格或关键帧组

按任务选择更轻的结构:

- storyboard grid:适合你想让一张图承载整个序列

- keyframe set:适合你想要更强的镜头级控制

4. 进入 Seedance 2.0 做运动

480p、720p 输出和 4 到 15 秒时长。这让它很适合作为第二阶段工具,接住已经定好的视觉设计。到了这个阶段,提示词最好更像导演笔记,而不是图片标签。重点描述:

- 什么东西在动

- 镜头怎么动

- 节拍什么时候变化

- 音频氛围应该是什么感觉

5. 标题和节奏放到后处理

就算视频模型已经很强了,通常也还是更安全把下面这些事情放到后处理里做:

- 标题处理

- 字幕

- 节奏裁切

- end card

- 最终包装

而不是指望单次生成把所有事情一次性做完。

常见翻车点

分镜网格直接成了开场首帧

这是 storyboard-first 工作流里很常见的问题。最简单的修法要么是后期裁掉第一秒,要么是让开头两格的画面更接近,这样转场不会太突兀。

角色漂移其实不是从视频阶段才开始的

这看起来像 Seedance 的问题,但根源通常更早。如果角色设定图或关键帧本身就不稳定,运动阶段只是继承了这种不稳定。通常应该先回去强化图像锚点,而不是不停重抽视频。

标题和 Logo 一动就坏

文字依然是视频生成里比较脆弱的部分。如果标题或 Logo 很重要,更稳的做法通常是先把它做成静态资产,再做轻量动画,或者直接留给剪辑阶段处理。

什么时候这套组合最适合

这不是一套放之四海而皆准的搭配。它最适合那些至少存在一个轻量前期阶段的项目。

| 更适合 | 不太适合 |

|---|---|

| 预告片和 teaser | 单图任务 |

| 短篇视觉叙事 | 纯 talking head 生成 |

| 有镜头结构的社媒广告 | 快速的一次性 prompt 实验 |

| 需要提前规划版式的产品视频 | 完全不需要视觉一致性的工作流 |

| 角色导向或风格导向短片 | 直接 text-to-video 已经足够解决的问题 |

如果你的任务只是“生成一张图”,那直接用 GPT Image 2 就行。

如果你的任务只是“用一条 prompt 快速出一个视频片段”,那也未必需要额外这层结构。

这对 EvoLink 意味着什么

EvoLink 在这里的意义,不是“发明了这套工作流”,而是让它更容易在一个工作面里运转。

- 把图像阶段和视频阶段放在同一个模型工作流里管理

- 不用重建整套集成,就能对比不同 route 的表现

- 更自然地决定什么时候留在同一家模型里,什么时候切给另一家模型

FAQ

ChatGPT Images 2.0 和 gpt-image-2 是一回事吗?

gpt-image-2 是对应的 API 模型名。为什么不直接整条视频一次性生成?

可以,而且有些时候这反而更快。只有当团队开始需要更强的角色一致性、镜头顺序控制和结构化视觉规划时,这种两阶段工作流才更有价值。

我应该先做分镜网格,还是先做关键帧?

在这套工作流里,GPT Image 2 的核心职责是什么?

它的核心职责是生成可用的前期视觉资产,比如角色设定图、视觉锚点、分镜页、关键帧和标题卡。

在这套工作流里,Seedance 2.0 的核心职责是什么?

它的核心职责是把这些静态视觉资产变成有时间维度的输出,比如 image-to-video 或多模态 reference 驱动的视频,并提供更强的镜头与节奏控制。

标题和 Logo 应该放在视频阶段里一起做吗?

通常不建议。如果可读性很重要,更稳的方式是先把它们做成单独的静态资产,再后面补动画或直接在剪辑阶段叠加。

什么情况下这套组合反而不合适?

当任务只是单张静态图、简单 direct video prompt,或者对跨镜头一致性没有要求时,这套搭配往往会显得过重。

Sources

- OpenAI,“Introducing ChatGPT Images 2.0”(2026 年 4 月 21 日):https://openai.com/index/introducing-chatgpt-images-2-0/

- OpenAI API

gpt-image-2模型页:https://developers.openai.com/api/docs/models/gpt-image-2 - ByteDance Seedance 2.0 官方页:https://seed.bytedance.com/en/seedance2_0

- BytePlus ModelArk Seedance 2.0 教程:https://docs.byteplus.com/api/docs/ModelArk/2291680