Comment utiliser GPT Image 2 avec Seedance 2.0 : pourquoi les équipes les associent pour les storyboards et vidéos courtes

Comment utiliser GPT Image 2 avec Seedance 2.0

gpt-image-2. ByteDance et BytePlus documentent publiquement Seedance 2.0 comme un modèle vidéo multimodal prenant en charge les entrées texte, image, audio et vidéo. L'association devient alors naturelle : gpt-image-2 est particulièrement adapté à la structuration visuelle en pré-production, tandis que Seedance 2.0 excelle dans le mouvement, le timing et l'exécution audiovisuelle.En résumé

- Utilisez

gpt-image-2quand vous avez besoin de fiches de personnages, grilles de storyboard, keyframes, cartons-titres, affiches ou autres éléments visuels structurés. - Utilisez Seedance 2.0 quand vous savez déjà à quoi la scène doit ressembler et qu'il faut maintenant ajouter du mouvement, un comportement de caméra et produire une vidéo courte.

- L'association est généralement plus efficace que de forcer un seul modèle à tout faire en un seul prompt.

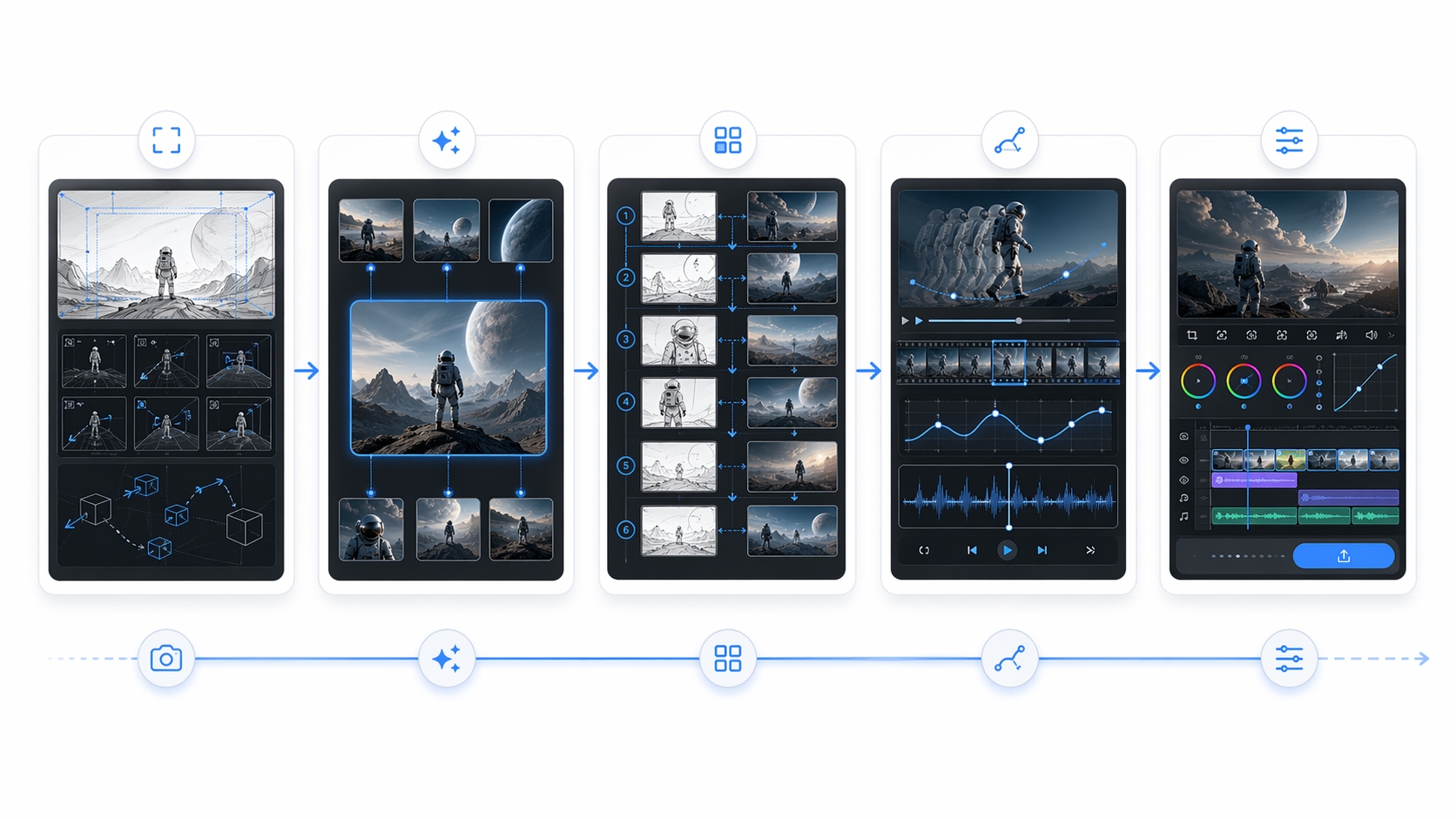

- Le workflow le plus courant est simple : définir les plans → générer les ancres visuelles → construire le storyboard ou les keyframes → animer dans Seedance 2.0 → finaliser les titres et le rythme au montage.

- Cette association convient mieux aux bandes-annonces, teasers, récits visuels, vidéos produit et clips pour les réseaux sociaux qu'aux tâches de type talking-head ou image unique.

À quoi chaque modèle excelle réellement

La façon la plus claire de comprendre cette association est de raisonner par étape de production, pas par effet de mode.

| Étape | GPT Image 2 (gpt-image-2) | Seedance 2.0 |

|---|---|---|

| Rôle principal | Conception visuelle en pré-production | Mouvement et génération de vidéos courtes |

| Meilleures entrées | Texte + références image optionnelles | Texte, image, audio et vidéo |

| Meilleures sorties | Fiches de personnages, planches de storyboard, panneaux style BD, affiches, keyframes, cartons-titres | Image-to-video, reference-to-video multimodal, workflows vidéo orientés montage |

| Meilleur usage | Verrouiller la structure et la cohérence visuelle | Ajouter le timing, le mouvement, la direction de caméra et l'atmosphère audiovisuelle |

| Forces officiellement documentées | Génération et édition d'images rapide et de haute qualité | Génération vidéo multimodale avec références image, audio et vidéo |

Si la question ouverte porte sur :

- à quoi le personnage doit ressembler

- ce que le cadre doit contenir

- quelle densité d'information visuelle est nécessaire

- comment une séquence doit être disposée avant l'animation

alors GPT Image 2 est généralement le meilleur point de départ.

Si la question ouverte porte sur :

- comment la scène doit bouger

- comment la caméra doit se comporter

- comment le clip doit progresser d'un temps fort à l'autre

- comment la séquence doit se ressentir dans la durée

alors Seedance 2.0 est généralement le meilleur outil.

Pourquoi les équipes les associent au lieu de tout forcer dans un seul modèle

1. La cohérence visuelle se décide plus tôt

Le text-to-video direct peut bien fonctionner pour de courtes expérimentations, mais il doit résoudre trop de choses à la fois : design de personnage, composition, mouvement, logique de scène, rythme, et parfois même l'audio. Quand les équipes déplacent ces premières décisions visuelles dans GPT Image 2 d'abord, l'étape vidéo ultérieure a moins de risques de dériver.

Cela compte surtout quand la sortie n'est pas juste « un joli clip », mais quelque chose avec une structure répétable :

- une bande-annonce

- un teaser

- une publicité pour les réseaux sociaux

- une courte séquence avec des personnages récurrents

- un récit visuel stylisé

2. Le rythme narratif devient plus facile à contrôler

Au lieu de demander à un modèle vidéo d'inventer toute la séquence, le workflow devient :

- décider les plans

- montrer les plans visuellement

- animer les plans

C'est généralement plus facile à déboguer qu'un seul prompt monolithique.

3. Les visuels riches en texte et en mise en page résistent mieux

OpenAI positionne GPT Image 2 comme un modèle puissant de génération et d'édition d'images, et les supports de lancement de ChatGPT Images 2.0 mettent fortement l'accent sur les mises en page structurées, le rendu de texte multilingue, les pages de BD, les fiches de référence et les compositions éditoriales. Cela en fait un meilleur choix pour les éléments comme :

- les cartons-titres

- les mises en page de type affiche

- les pages de BD ou de manga

- les visuels de type interface

- les compositions à forte densité d'information ou de marque

Ce sont exactement les types d'éléments qui se dégradent souvent quand on tente de les générer directement dans l'étape de mouvement.

Le workflow le plus fréquemment observé

L'association suit généralement l'un de ces deux schémas.

| Workflow | Commencer dans GPT Image 2 | Finir dans Seedance 2.0 | Meilleur usage |

|---|---|---|---|

| Storyboard d'abord | Grille de storyboard 3×3 ou planche multi-panneaux | Animer à partir du storyboard en image-to-video ou vidéo pilotée par référence | Bandes-annonces, teasers, clips narratifs courts |

| Keyframes d'abord | Fiche de personnage, ancre de style, 4-6 keyframes, cartons-titres | Animer chaque visuel comme un clip ou une séquence | Vidéos produit, PV de personnages, montages pour réseaux sociaux, publicités stylisées |

Un processus pratique et léger

Vous n'avez pas besoin d'un pipeline complexe pour rendre cela utile. Pour la plupart des équipes, un workflow en cinq étapes suffit.

1. Définir l'intention de chaque plan d'abord

Avant de prompter l'un ou l'autre modèle, rédigez une courte liste de plans :

Objectif : teaser de 15 secondes

Plan 1 : établir le sujet et l'ambiance

Plan 2 : gros plan de détail qui introduit la tension

Plan 3 : le contexte du monde ou du produit s'élargit

Plan 4 : un mouvement ou un conflit apparaît

Plan 5 : révélation finale ou maintien du titreC'est suffisant. Le but n'est pas de rédiger de la poésie de prompt. Le but est de décider ce que le clip doit communiquer.

2. Utiliser GPT Image 2 pour verrouiller les ancres de personnage et de style

Créez une ou deux ancres visuelles avant de tenter une séquence :

- une fiche de personnage ou un visuel d'ancrage produit

- une ancre de style pour la couleur, l'éclairage et les matériaux

Si ces éléments sont instables, l'étape de mouvement ultérieure empire généralement, au lieu de s'améliorer.

3. Construire une grille de storyboard ou un ensemble de keyframes

Choisissez la structure la plus légère qui correspond à votre charge de travail :

- grille de storyboard si vous voulez une seule image qui porte toute la séquence

- ensemble de keyframes si vous voulez plus de contrôle au niveau de chaque plan

4. Passer à Seedance 2.0 pour le mouvement

480p et 720p, et des durées de 4 à 15 secondes. Cela en fait un bon outil de seconde étape quand le design visuel est déjà arrêté.À cette étape, rédigez vos prompts davantage comme des notes de réalisation que comme des tags d'image. Concentrez-vous sur :

- ce qui bouge

- comment la caméra se déplace

- quand le rythme change

- quelle atmosphère sonore vous visez

5. Finaliser les titres et le rythme en dehors de l'étape de mouvement

Même quand le modèle vidéo est performant, il est généralement plus sûr de finaliser :

- le traitement des titres

- les sous-titres

- les ajustements de rythme

- les écrans de fin

- le packaging final

au montage, plutôt que de demander à l'étape de génération de tout faire en une fois.

Points de défaillance courants

La grille de storyboard apparaît comme le tout premier plan

C'est un effet secondaire fréquent des workflows storyboard d'abord. La solution la plus simple est soit de couper la première seconde au montage, soit de rapprocher visuellement les premiers panneaux pour que la transition paraisse moins abrupte.

La dérive du personnage commence avant l'étape vidéo

Cela ressemble souvent à un problème de Seedance, mais la cause racine est généralement en amont. Si la fiche de personnage ou l'ensemble de keyframes n'est pas stable, l'étape de mouvement hérite de cette instabilité. La solution consiste généralement à renforcer les ancres image, pas à relancer indéfiniment l'étape vidéo.

Les titres et logos se dégradent en mouvement

Le texte reste un point fragile de la génération vidéo. Si un titre ou un logo est important, générez-le séparément comme élément statique d'abord, puis animez-le légèrement ou intégrez-le au montage.

Quand cette association fonctionne le mieux

Ce workflow n'est pas universel. Il est le plus efficace quand vous avez une vraie étape de pré-production, même légère.

| Bonne adéquation | Mauvaise adéquation |

|---|---|

| Bandes-annonces et teasers | Tâches d'image unique |

| Courts récits visuels | Génération de type talking-head |

| Publicités sociales avec structure de plans | Expérimentations rapides en un seul prompt |

| Vidéos produit nécessitant une planification de mise en page | Charges de travail sans besoin de cohérence visuelle |

| Courts métrages centrés sur un personnage ou un style | Cas où le text-to-video direct résout déjà proprement le problème |

Si votre tâche principale est « générer une seule image », utilisez simplement GPT Image 2.

Si votre tâche principale est « générer un clip vidéo rapide à partir d'un seul prompt », vous n'avez peut-être pas besoin de cette structure supplémentaire.

Ce que cela signifie sur EvoLink

L'intérêt d'EvoLink ici n'est pas que la plateforme ait inventé ce workflow. C'est que ce workflow devient plus facile à opérer quand les routes image et vidéo peuvent coexister dans le même environnement de travail.

- garder l'étape image et l'étape vidéo dans le même workflow de modèles

- comparer le comportement des routes sans reconstruire votre stack

- décider quand rester dans une même famille de modèles et quand passer à une autre

FAQ

ChatGPT Images 2.0 et gpt-image-2, est-ce la même chose ?

gpt-image-2 est le nom du modèle documenté dans l'API.Pourquoi ne pas simplement générer toute la vidéo directement ?

Vous pouvez le faire, et c'est parfois le choix le plus rapide. Le workflow associé devient utile quand votre équipe a besoin de plus de contrôle sur la cohérence des personnages, l'ordre des plans ou la planification visuelle structurée.

Faut-il commencer par les grilles de storyboard ou par les keyframes ?

Quel est le rôle principal de GPT Image 2 dans ce workflow ?

Son rôle principal est de créer des visuels de pré-production exploitables : fiches de personnages, ancres visuelles, planches de storyboard, keyframes, cartons-titres et autres éléments image structurés.

Quel est le rôle principal de Seedance 2.0 dans ce workflow ?

Son rôle principal est de transformer ces éléments visuels en productions orientées mouvement via des workflows image-to-video ou reference-to-video multimodaux, avec un contrôle de caméra et de timing plus précis que ce qu'un modèle d'image fixe peut offrir.

Faut-il générer les titres et logos dans l'étape vidéo ?

En général, non. Si la lisibilité compte, il est plus sûr de créer ces éléments séparément et de les ajouter ou les animer par la suite.

Quand cette association est-elle mal adaptée ?

Elle est généralement surdimensionnée pour les images fixes uniques, les prompts vidéo directs simples, ou les charges de travail où la cohérence entre les plans n'a pas beaucoup d'importance.

Sources

- OpenAI, "Introducing ChatGPT Images 2.0" (April 21, 2026): https://openai.com/index/introducing-chatgpt-images-2-0/

- OpenAI API model page for

gpt-image-2: https://developers.openai.com/api/docs/models/gpt-image-2 - ByteDance Seedance 2.0 official page: https://seed.bytedance.com/en/seedance2_0

- BytePlus ModelArk Seedance 2.0 series tutorial: https://docs.byteplus.com/api/docs/ModelArk/2291680