DeepSeek V4 Flash/Pro vs GPT-5.4 vs Claude Opus 4.6 : Tarifs officiels et comparaison des capacités

Cet article a été publié avant que DeepSeek V4 ne soit officiellement documenté. Il a été entièrement révisé pour refléter le lancement officiel en preview de DeepSeek V4, y compris les identifiants de modèle publics, les tarifs, le contexte de 1M et la division entre Flash et Pro.

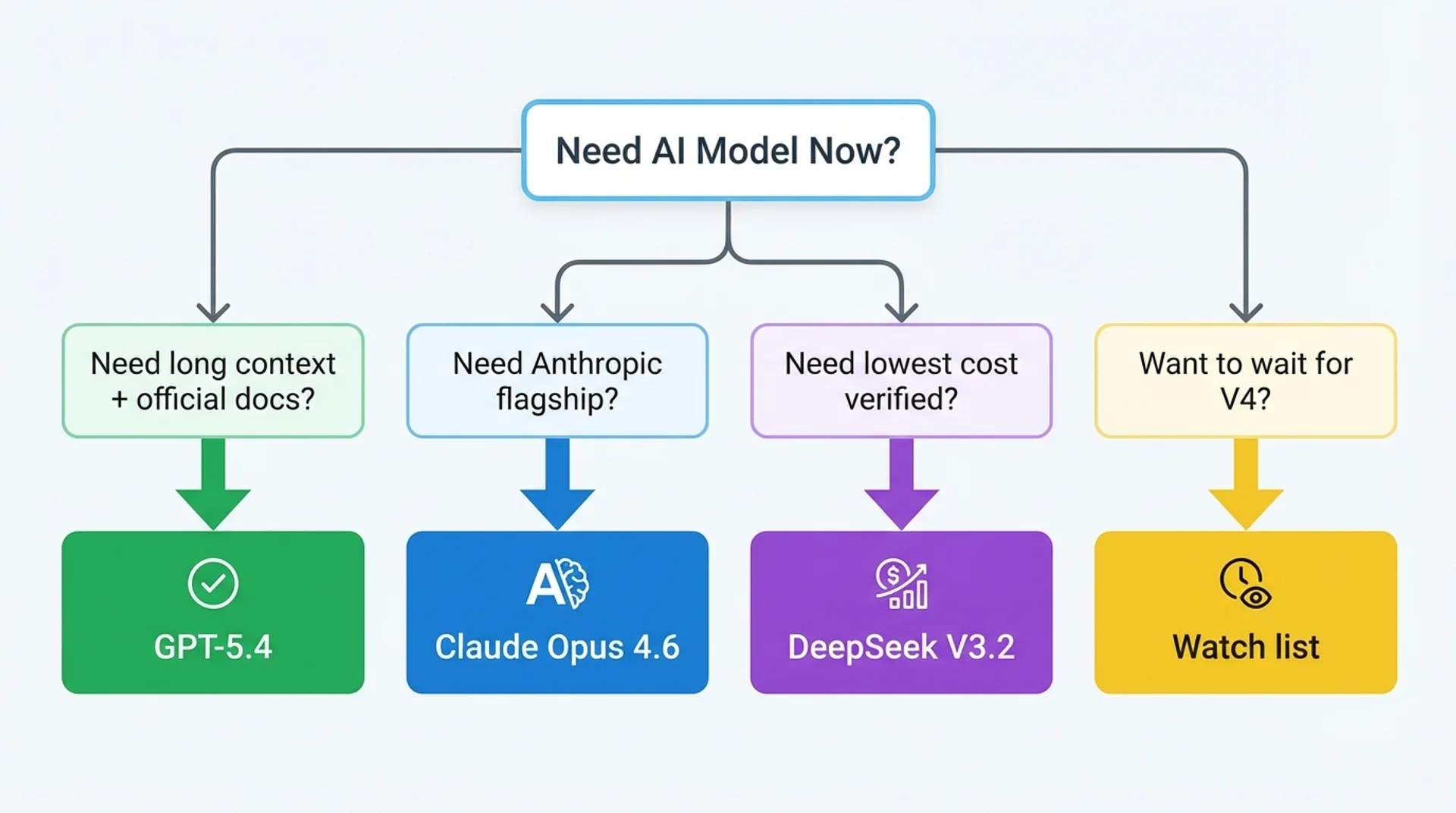

4.6. Considérez cette page comme une base de comparaison historique toujours utile, et non comme le verdict final sur la dernière version de Claude.deepseek-v4-flash et deepseek-v4-pro, et la page de tarifs publie les prix, le contexte de 1M et la sortie maximale de 384K. DeepSeek API Docs DeepSeek Models & PricingLa comparaison est passée de « peut-on vérifier DeepSeek V4 ? » à une décision plus utile :

- Quand DeepSeek V4 Flash est-il le meilleur choix ?

- Quand vaut-il la peine de payer pour DeepSeek V4 Pro ?

- Quand les équipes devraient-elles toujours choisir GPT-5.4 ou Claude Opus 4.6 ?

En bref

- DeepSeek V4 Flash — l'option officielle la moins chère de cette comparaison : 0,14 $ input / 0,28 $ output par 1M tokens, 1M contexte, 384K sortie maximale. Meilleur candidat pour le coding à gros volume, le routage d'agents et les workloads longues sensibles au coût. DeepSeek Models & Pricing

- DeepSeek V4 Pro — la route V4 à intelligence supérieure : 1,74 $ input / 3,48 $ output par 1M tokens. Nettement moins cher que Claude Opus 4.6, output moins cher que GPT-5.4. Même 1M contexte et 384K sortie maximale. DeepSeek Models & Pricing

- GPT-5.4 — le flagship officiel d'OpenAI pour le travail professionnel complexe : 1 050 000 contexte, 128 000 sortie maximale, 2,50 $ / 15,00 $. OpenAI Pricing OpenAI GPT-5.4 Model

- Claude Opus 4.6 — choix de premier plan pour le coding et les tâches d'agents : 5 $ / 25 $ par 1M tokens, 128K sortie, 1M contexte en bêta sur la plateforme Claude. Anthropic Claude Opus 4.6

Ce qui est officiellement vérifiable maintenant

Le tableau ci-dessous utilise exclusivement les informations officielles documentées par chaque fournisseur.

| Sujet | DeepSeek V4 Flash | DeepSeek V4 Pro | GPT-5.4 | Claude Opus 4.6 |

|---|---|---|---|---|

| Fournisseur | DeepSeek | DeepSeek | OpenAI | Anthropic |

| Statut | Preview API publique documentée | Preview API publique documentée | Documenté et disponible | Documenté et disponible |

| Prix input | 0,14 $ / 1M (cache miss) | 1,74 $ / 1M (cache miss) | 2,50 $ / 1M | 5,00 $ / 1M |

| Prix input caché | 0,028 $ / 1M | 0,145 $ / 1M | 0,25 $ / 1M | Variable selon le tier de cache/contexte long |

| Prix output | 0,28 $ / 1M | 3,48 $ / 1M | 15,00 $ / 1M | 25,00 $ / 1M |

| Contexte | 1M | 1M | 1 050 000 | 1M (bêta) |

| Sortie maximale | 384K | 384K | 128K | 128K |

| Mode de raisonnement | Pris en charge | Pris en charge | Via reasoning effort | Via adaptive/extended thinking |

| Appels d'outils | Pris en charge | Pris en charge | Pris en charge | Pris en charge |

| Positionnement | Route V4 à bas coût | Route V4 à intelligence supérieure | Flagship OpenAI | Flagship Anthropic |

Vérification des tarifs

Les trois fournisseurs publient des chiffres officiels exploitables — la comparaison est directe.

| Modèle | Input | Input caché | Output | Conclusion pratique |

|---|---|---|---|---|

| DeepSeek V4 Flash | 0,14 $ | 0,028 $ | 0,28 $ | Route officielle la moins chère de loin |

| DeepSeek V4 Pro | 1,74 $ | 0,145 $ | 3,48 $ | Bien moins cher que Claude Opus 4.6, output sous GPT-5.4 |

| GPT-5.4 | 2,50 $ | 0,25 $ | 15,00 $ | Route premium OpenAI pour le travail complexe |

| Claude Opus 4.6 | 5,00 $ | Selon le tier | 25,00 $ | Route la plus chère, mais modèle top pour coding et agents |

Deux constats immédiats :

- DeepSeek V4 Flash est le leader coût avec une large avance.

- DeepSeek V4 Pro est passé de « liste de surveillance non vérifiée » à une vraie option premium avec un bon rapport coût-performance.

Si le coût par token de sortie compte pour vos workloads :

- V4 Flash output est bien moins cher que GPT-5.4 et Claude Opus 4.6

- V4 Pro output reste nettement inférieur à GPT-5.4 et Claude Opus 4.6

Le changement pratique majeur : DeepSeek V4 est désormais Flash vs Pro

Les articles précédents traitaient V4 comme un modèle hypothétique unique. Ce n'est plus exact pour la prise de décision.

Le cadrage plus utile aujourd'hui :

- Choisir Flash — quand coût, débit et déploiement large sont prioritaires

- Choisir Pro — quand une meilleure qualité de raisonnement est nécessaire tout en restant sous les tarifs des modèles fermés

DeepSeek V4 ressemble moins à un concurrent unique de GPT-5.4 ou Opus 4.6 et plus à une famille de produits à deux niveaux.

Quel modèle pour quel workflow

DeepSeek V4 Flash : le meilleur rapport coût-performance

Flash est optimal quand vous avez besoin de :

- Assistance coding à gros volume

- Pipelines d'agents sensibles au coût

- Traitement de documents ou de dépôts à contexte long

- Defaults de routage qui doivent rester bon marché

DeepSeek V4 Pro : route V4 premium sans tarifs de modèle fermé

Pro convient mieux quand vous avez besoin de :

- Raisonnement plus profond qu'une route budget

- Tâches de coding et d'analyse plus difficiles

- Sortie structurée de format long

- Une montée en gamme depuis Flash sans atteindre les tarifs de Claude Opus 4.6

Pour beaucoup d'équipes, Pro n'est pas un remplacement universel de GPT-5.4 ou Opus 4.6, mais une option premium à moindre coût qui mérite d'être évaluée en parallèle.

GPT-5.4 : le flagship officiel d'OpenAI

GPT-5.4 reste intéressant quand vous voulez :

- Le support officiel de la plateforme OpenAI

- Une fenêtre de contexte documentée de 1 050 000

- 128 000 de sortie maximale

- Un workflow développeur OpenAI familier

Claude Opus 4.6 : priorité au coding et aux agents Anthropic

Claude Opus 4.6 reste fort quand vous voulez :

- Le modèle de coding flagship d'Anthropic

- Les contrôles extended et adaptive thinking

- Des workflows d'agents de longue durée

- Les fonctionnalités de la plateforme Claude (compaction de contexte, 1M contexte bêta)

Contexte et limites de sortie comptent plus qu'avant

La mise à jour DeepSeek V4 change aussi la discussion sur le contexte long.

Avant, une raison pratique de choisir GPT-5.4 ou Claude Opus 4.6 était que DeepSeek V4 n'était pas documenté publiquement. Maintenant que Flash et Pro offrent :

- 1M contexte

- 384K sortie maximale

DeepSeek entre officiellement dans la même conversation de planification. Cela importe pour :

- Compréhension de code à l'échelle d'un dépôt

- Longs documents juridiques ou de recherche

- Boucles d'agents multi-étapes longues

- Tâches nécessitant de très grandes sorties en une seule réponse

En marge de sortie maximale pure, DeepSeek V4 dépasse clairement GPT-5.4 et Claude Opus 4.6 selon la documentation officielle actuelle.

Recommandation par cas d'usage

| Cas d'usage | Meilleur choix | Pourquoi |

|---|---|---|

| Route officielle de contexte long la moins chère | DeepSeek V4 Flash | Tarif officiel le plus bas avec 1M contexte et 384K sortie |

| Route premium DeepSeek plus puissante | DeepSeek V4 Pro | Option V4 haut de gamme sans tarifs GPT/Claude |

| Flagship officiel OpenAI | GPT-5.4 | Flagship documenté avec 1 050 000 contexte et 128K sortie |

| Modèle top coding et agents d'Anthropic | Claude Opus 4.6 | Flagship Anthropic avec 1M bêta et 128K sortie |

| Évaluer un modèle pour un routage de production large | Flash → Pro | Flash pour le routage sensible au coût, Pro pour les workloads difficiles |

Ce qui a changé par rapport à la conclusion de mars 2026

Ancienne conclusion :

- DeepSeek V4 était un élément de surveillance

- V3.2 était la baseline officielle pratique de DeepSeek

- Les équipes ne devaient pas budgétiser autour de V4

Ce n'est plus correct.

- DeepSeek V4 est officiellement documenté et utilisable en preview

- Flash et Pro doivent être évalués directement

- V3.2 n'est plus la bonne baseline de planification pour les comparaisons centrées sur V4

FAQ

1. DeepSeek V4 est-il officiellement disponible ?

deepseek-v4-flash et deepseek-v4-pro, et Reuters a rapporté le lancement preview le 24 avril 2026. DeepSeek API Docs Reuters via Investing.com2. Puis-je comparer les tarifs de DeepSeek V4 avec GPT-5.4 et Claude Opus 4.6 de manière responsable ?

3. Quelle variante tester en premier : Flash ou Pro ?

Pour la plupart des équipes, Flash. Bien moins cher tout en gardant 1M contexte et 384K sortie maximale. Pour des tâches de raisonnement ou de coding plus difficiles, testez Pro ensuite.

4. GPT-5.4 a-t-il encore des avantages ?

5. Claude Opus 4.6 a-t-il encore des avantages ?

6. Quelle est l'option officielle la moins chère de cette comparaison ?

7. Dois-je encore utiliser DeepSeek-V3.2 comme baseline budgétaire ?

Non pour la planification V4. V4 Flash et V4 Pro sont la baseline correcte actuelle.

8. Où trouver les détails de routage et les guides d'implémentation ?

Sources

- DeepSeek API Docs

- DeepSeek Models & Pricing

- OpenAI API Pricing

- OpenAI GPT-5.4 Model

- Anthropic Claude Opus 4.6

- Anthropic Claude Opus 4.7

- China's AI darling DeepSeek previews new model | Reuters via Investing.com