LLM TCO en 2026: por qué los costos de los tokens son solo una parte del precio real

LLM TCO en 2026: Por qué los costos de los tokens son solo una parte del precio real

La mayoría de los equipos estiman el costo de las funciones de LLM utilizando una única métrica: precio por millón de tokens.

Esa métrica importa, pero sólo en el papel.

En los sistemas de producción reales, el costo total de propiedad (TCO) de LLM a menudo está impulsado no solo por el gasto simbólico, sino también por los gastos generales de ingeniería: trabajo de integración, correcciones de confiabilidad, mantenimiento rápido y brechas de evaluación que erosionan silenciosamente el ROI de la IA con el tiempo.

Esta guía explica los costos ocultos de la integración de LLM y proporciona un marco práctico para identificar a dónde se van realmente el dinero y el tiempo de ingeniería:

- Código de pegamento: el impuesto de integración en curso

- Eval Debt — el costo de la incertidumbre

- Prompt Drift: la migración que nunca termina

Una autoauditoría de TCO de LLM de 10 minutos

Antes de profundizar, responda estas cinco preguntas:

- ¿Cuántos modelos o proveedores admite su sistema actualmente (incluidos los previstos)?

- ¿Mantiene adaptadores específicos del proveedor o ramas condicionales?

- ¿Realizan evaluaciones automatizadas en cada cambio de modelo?

- ¿Puede redirigir el tráfico a otro modelo sin reescribir las indicaciones ni la lógica empresarial?

- ¿Tiene una visión única de los costos, la latencia y las tasas de fallas?

Costo oculto n.° 1: Código de pegamento: el impuesto de integración

El código Glue es un trabajo de ingeniería que no produce ningún valor para el usuario, pero es necesario para normalizar las diferencias entre proveedores.

Crece en tres áreas predecibles.

1) Gestión de uso y contexto

Una vez que intervienen varios modelos, la contabilidad de uso deja de ser uniforme.

Las fuentes comunes de código de pegamento incluyen:

- cálculo y truncamiento de la ventana de contexto

- Protecciones de "salida máxima segura"

- campos de uso inconsistentes o faltantes

El desbordamiento del contexto a menudo provoca reintentos, resultados parciales y gastos inesperados, no solo errores.

2) Normalización de confiabilidad y fallas

Las distintas API fallan de formas fundamentalmente diferentes:

- errores de API estructurados versus fallas a nivel de transporte

- aceleración frente a tiempos de espera silenciosos

- transmisión parcial frente a desconexiones abruptas

Esto convierte "simplemente agregar reintentos" en un árbol de decisiones en crecimiento.

# Ejemplo ilustrativo: normalización de fallas independiente del proveedor

def should_retry(err) -> bool:

if getattr(err, "status", None) in (408, 429, 500, 502, 503, 504):

return True

if "timeout" in str(err).lower() or "connection" in str(err).lower():

return True

return FalseEste código mantiene vivos los sistemas, pero no añade nada a la diferenciación del producto.

3) Llamada de herramientas y salidas estructuradas

En el momento en que confías en herramientas o resultados JSON estrictos, estás integrando un protocolo, no una API de chat.

Incluso las API que aceptan formas de solicitud similares pueden diferir en:

- donde aparecen las llamadas a herramientas en las respuestas

- cómo se codifican los argumentos

- cómo se aplica la producción estrictamente estructurada

Esta es una consecuencia directa de la fragmentación de la API de LLM.

Prueba de olor del código de pegamento

Estás pagando un impuesto de integración si:

- solicita bifurcación por proveedor

- Los analizadores de streaming difieren según el modelo.

- los adaptadores se multiplican con el tiempo

- la observabilidad está centrada en el proveedor en lugar de en las características

Costo oculto n.° 2: Deuda de evaluación: el costo de la incertidumbre

La deuda de evaluación se acumula cuando los equipos implementan modelos sin una evaluación automatizada vinculada a flujos de trabajo reales.

El resultado es predecible:

- las migraciones se sienten riesgosas

- los modelos más baratos o más rápidos no se utilizan

- los equipos siguen con costosos incumplimientos

- El ROI de la IA disminuye con el tiempo

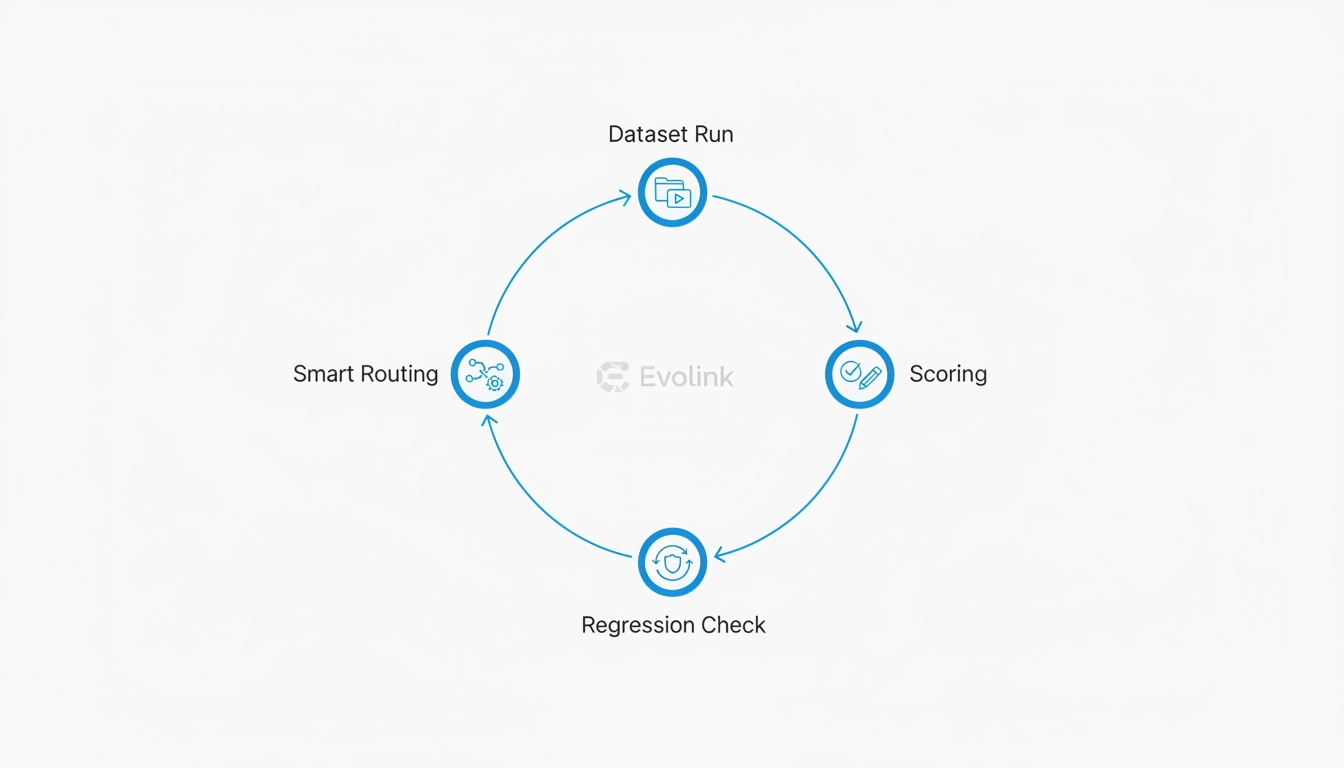

El bucle de evaluación mínimo viable (MVEL)

No necesita una plataforma MLOps completa para reducir la deuda de evaluación.

Necesita un bucle que responda una pregunta:

Si cambiamos de modelo, ¿lo notarán los usuarios?

Una base práctica que muchos equipos pueden implementar en 1 o 2 días:

1) Conjuntos de datos pequeños y versionados (50 a 300 casos)

Utilice ejemplos de producción reales:

- flujos de usuarios comunes

- casos extremos

- fracasos históricos

eval/

├── datasets/

│ ├── v1_core.jsonl

│ ├── v1_edges.jsonl

│ └── v1_failures.jsonl

2) Ejecutor de lotes repetible

Un guión que:

- ejecuta el mismo conjunto de datos en todos los modelos

- registra resultados, latencia y costos

- se ejecuta localmente o en CI

3) Puntuación ligera (centrada en la regresión)

Como mínimo, realice un seguimiento de:

- validez del formato

- campos obligatorios presentes

- umbrales de latencia y costo

4) Configuración de evaluación simple

dataset: datasets/v1_core.jsonl

model_targets:

- primary

- candidate

metrics:

- format_validity

- required_fields

thresholds:

format_validity: 0.98

latency_p95_ms: 1200

report:

output: reports/diff.htmlEsta estructura por sí sola reduce drásticamente el riesgo de migración.

Costo oculto n.° 3: deriva inmediata: la migración que nunca termina

El concepto erróneo más común en ingeniería LLM es:

"Intercambiaremos el ID del modelo más tarde."

En la práctica, las indicaciones varían porque los modelos difieren en:

- disciplina de formato

- comportamiento de uso de herramientas

- umbrales de rechazo

- estilo de seguir instrucciones

Un patrón de falla común (independiente del proveedor)

- El mensaje requiere una salida JSON estricta

- El modelo A cumple consistentemente

- El modelo B añade una breve explicación o frase de rechazo.

- El análisis posterior falla

- Los ingenieros parchean avisos, analizadores o ambos

LLM TCO Iceberg: De dónde provienen realmente los costos

- Costo visible: Precio del token

- Costos ocultos:

- Mantenimiento del código de pegamento.

- Remediación rápida de la deriva

- Infraestructura de evaluación

- Depuración, reintentos y reversiones

Nota sobre sistemas multimodales (imagen y vídeo)

Si bien este artículo se centra en la integración de LLM, el mismo marco de TCO se aplica aún más a los sistemas multimodales como la generación de imágenes y videos.

Una vez que se va más allá del texto, los gastos de ingeniería se expanden para incluir orquestación de trabajos asincrónicos, webhooks o sondeos, almacenamiento temporal de activos, costos de ancho de banda, manejo de tiempos de espera y evaluación de calidad para resultados no deterministas. En la práctica, estos factores a menudo superan el precio por unidad, ya sea que la unidad sea tokens, imágenes o segundos de video.

Esta es la razón por la que los equipos que crean flujos de trabajo de imágenes o videos de nivel de producción con frecuencia experimentan costos de evaluación y código adhesivo más altos que los sistemas de texto puro, incluso cuando el precio del modelo parece más barato en papel.

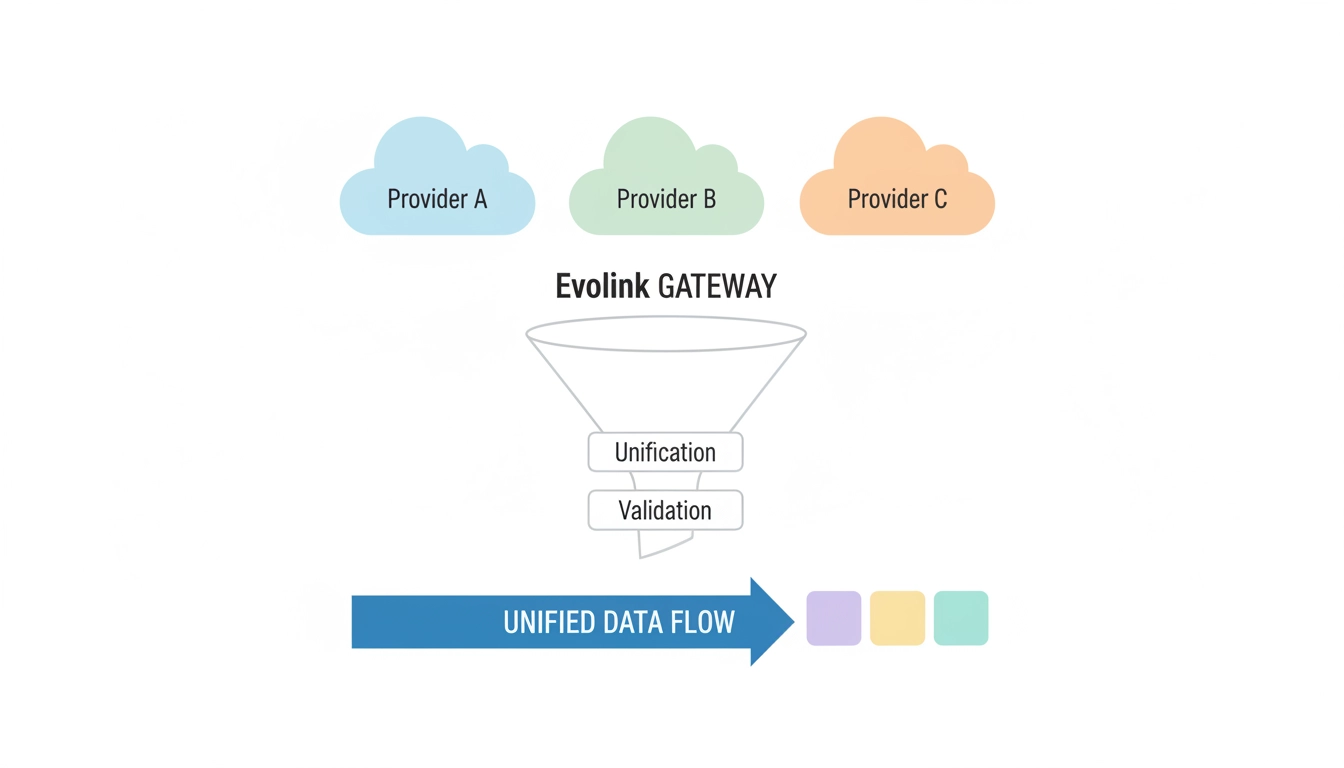

Integración directa versus puerta de enlace normalizada

| Área de costos | Integración directa | Puerta de enlace normalizada |

|---|---|---|

| Costo del token | Baja–variable | Baja–variable |

| Esfuerzo de integración | Alto | Inferior |

| Mantenimiento | Continuo | Centralizado |

| Velocidad de migración | Lento | Más rápido |

| Observabilidad | Fragmentado | Unificado |

| Gastos generales de ingeniería | Repetido | Consolidado |

En esta etapa, la verdadera decisión no es qué modelo usar, sino dónde desea que viva esta complejidad.

Los equipos líderes trasladan la fragmentación, el enrutamiento y la observabilidad del código de la aplicación a una capa de puerta de enlace dedicada.

Ese cambio arquitectónico es exactamente la razón por la que existe Evolink.ai.

Preguntas frecuentes (optimizadas para búsqueda)

¿Cómo se calculan los costos ocultos de la integración de LLM?

Teniendo en cuenta el tiempo de ingeniería dedicado a la integración, la evaluación, el mantenimiento rápido, las correcciones de confiabilidad y las migraciones, no solo el gasto simbólico.

¿Cuál es la sobrecarga de ingeniería de las estrategias de múltiples LLM?

Incluye código adhesivo, manejo rápido de derivas, infraestructura de evaluación y observabilidad entre proveedores.

¿Qué es la deuda de evaluación en los sistemas LLM?

La deuda de evaluación es el riesgo acumulado causado por la implementación de modelos sin evaluación automatizada, lo que hace que los cambios futuros sean más lentos y costosos.

¿Cómo mejora una puerta de enlace LLM el ROI de la IA?

Al centralizar la normalización, el enrutamiento y la observabilidad, se permite a los equipos optimizar o cambiar modelos sin reescribir el código de integración a nivel de funciones.