Wenn aus einem LLM-API-Wrapper Infrastruktur wird

Wenn aus einem LLM-API-Wrapper Infrastruktur wird

Die meisten Engineering-Teams nehmen sich nicht explizit vor, einen LLM-API-Wrapper zu bauen.

Meistens gibt es kein Kick-off-Dokument, keine explizite Roadmap und keinen Moment, in dem jemand sagt: „Lasst uns alle unsere Modellanbieter abstrahieren.“ Stattdessen entstehen Wrapper im Stillen – Zeile für Zeile –, während Teams versuchen, ihre Produktionssysteme stabil zu halten.

Dieser Artikel erklärt, warum Wrapper oft in Produktionssystemen auftauchen, wie man erkennt, wann einer die Grenze zur Infrastruktur überschritten hat, und vor welchen Entscheidungen Teams typischerweise als Nächstes stehen.

Was ein LLM-API-Wrapper tatsächlich ist (in der Praxis)

In Produktionssystemen ist ein Wrapper selten eine einzelne Komponente. Er ist eine wachsende Logikschicht, die zwischen Ihrer Anwendung und einem oder mehreren LLM-Anbietern sitzt.

Häufige Aufgaben sind:

- Normalisierung von Request- und Response-Schemata

- Handhabung von Retries, Timeouts und anbieterspezifischen Fehlern

- Verwaltung der Modellauswahl oder Fallback-Logik

- Injizieren von Prompts, System-Messages oder Sicherheitsregeln

- Verfolgung der Nutzung für Kostenzuordnung, Logging oder Audits

Die meisten Wrapper beginnen als pragmatischer Hilfscode. Viele entwickeln sich zu geschäftskritischen Pfaden.

Warum Wrapper entstehen (auch wenn niemand sie plant)

Teams bauen keine Wrapper, weil sie Abstraktion lieben. Sie bauen sie, weil eine direkte Integration unter Produktionsdruck oft nicht mehr zuverlässig genug ist.

Nachfolgend sind die häufigsten Kräfte aufgeführt, die Teams in diese Richtung drängen.

1. Verhaltenskonsistenz ist schwieriger als Schnittstellenkonsistenz

API-Schemata lassen sich relativ leicht normalisieren. Das Laufzeitverhalten hingegen nicht.

Teams stoßen oft auf Unterschiede wie:

- Streaming-Antworten, die stocken, unterschiedlich stückeln oder lautlos fehlschlagen können

- Fehler, die ähnlich aussehen, aber eine unterschiedliche operative Handhabung erfordern

- Timeouts, die sich unter Last unvorhersehbar verhalten können

- Subtile Unterschiede in der Prompt-Interpretation oder Kürzung

Wenn diese Probleme in der Produktion auftreten, besteht eine häufige kurzfristige Reaktion darin, eine lokale, anbieterspezifische Logik hinzuzufügen:

if provider == X:

retry differently

if streaming stalls:

fallback to non-streamIm Laufe der Zeit häufen sich diese Bedingungen an. Ein Wrapper bildet sich nicht, um „die API zu säubern“, sondern um Verhaltensunwägbarkeiten einzudämmen.

2. Prompt-Kontrolle beginnt als Annehmlichkeit und endet als Richtlinie

Anfänglich sind Prompts nur Strings, die vom Anwendungscode übergeben werden.

Später können sie zu Folgendem werden:

- Versionierte Assets

- Gemeinsam genutzte Ressourcen über mehrere Dienste hinweg

- Gekoppelt an Evaluierungs-Baselines

- Manchmal überprüft auf Sicherheit, Compliance oder Qualitätsstandards (abhängig vom Produkt und Risikoprofil)

An diesem Punkt verhalten sich Prompts nicht mehr wie Anwendungsdetails, sondern wie Konfigurationen.

Wrapper entstehen, um:

- Die Prompt-Injektion zu zentralisieren

- Anweisungen auf Systemebene durchzusetzen

- Unbeabsichtigten „Drift“ zwischen Diensten zu reduzieren

Was wie „Prompt-Helfer“ aussieht, ist oft das erste Zeichen einer Zentralisierung von Richtlinien.

3. Kostentransparenz zersplittert ohne eine Zwischenschicht

Die direkte API-Nutzung kann Kostensignale über verschiedene Anbieter hinweg verstreuen:

- Unterschiedliche Preiseinheiten

- Unterschiedliche Abrechnungszyklen

- Unterschiedliche Rate-Limit-Semantiken

Engineering-Teams spüren diesen Schmerz oft früh – manchmal noch bevor die Finanzabteilung es tut.

Wrapper können helfen, um:

- Die Nutzung konsistent zu verfolgen

- Kosten Features oder Teams zuzuordnen

- Guardrails anzuwenden, bevor die Rechnungen in die Höhe schießen

Dies ist nicht unbedingt ein Zeichen von FinOps-Reife. Es ist oft „defensive Engineering“.

4. Zuverlässigkeitsgarantien skalieren nicht innerhalb des Produktcodes

Wenn LLMs von Experimenten zu Abhängigkeiten werden, benötigen Teams oft:

- Fallbacks

- Anbieter-Rotation

- „Graceful Degradation“ (kontrollierter Funktionsabbau)

Diese Logik direkt im Anwendungscode einzubetten, kann zu einer engen Kopplung und fragilen Pfaden führen.

Ein Wrapper wird zum natürlichen Ort, um Zuverlässigkeitsabsichten auszudrücken:

- „Wenn dies fehlschlägt, versuche jenes.“

- „Wenn die Latenz einen Schwellenwert überschreitet, wechsle auf ein kleineres Modell.“

- „Wenn das Kontingent erreicht ist, wechsle den Modellanbieter.“

In dieser Phase ist der Wrapper kein optionaler Kleber mehr. Er beginnt, Erwartungen auf Service-Ebene durchzusetzen.

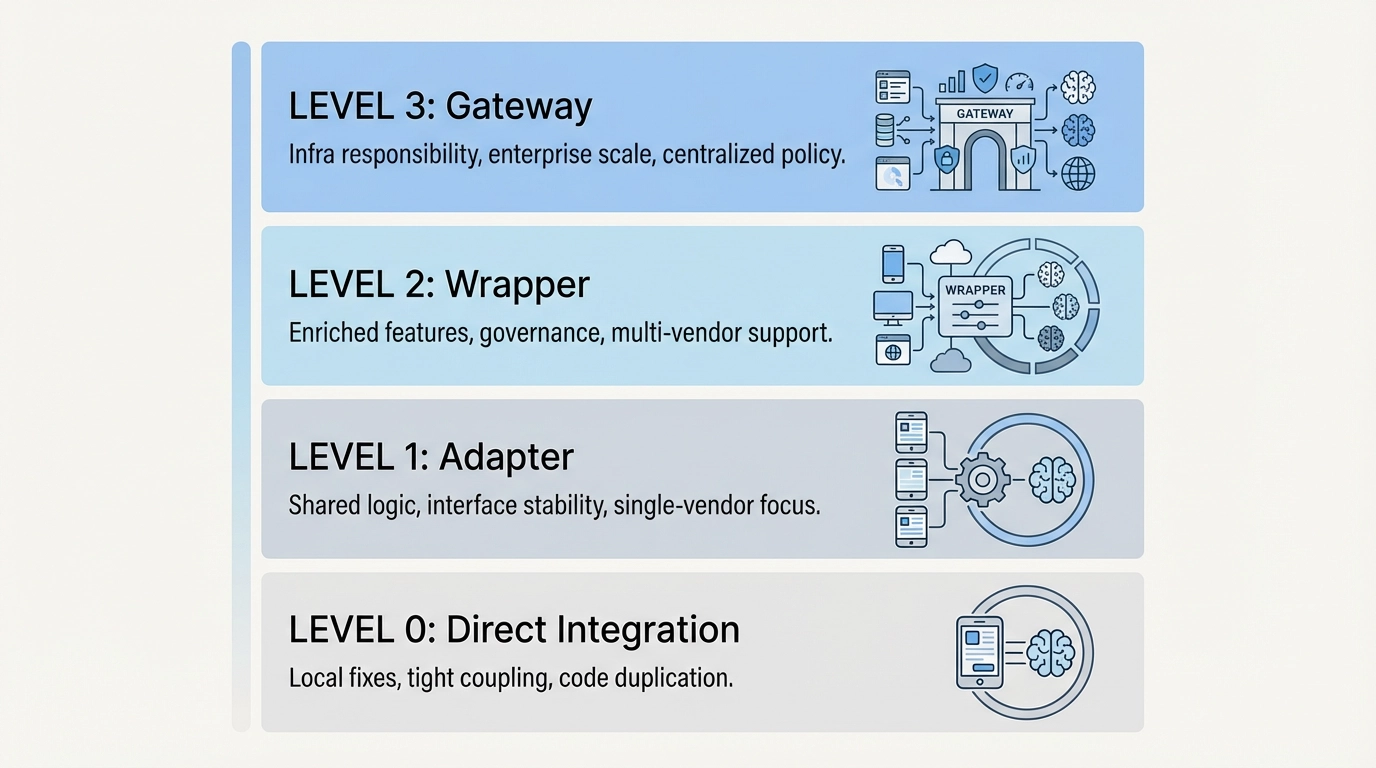

Das Reifegradmodell für Wrapper

Viele Teams unterschätzen, wie weit sich ihr Wrapper bereits entwickelt hat. Die folgende Tabelle skizziert eine typische Progression.

| Stufe | Wie es aussieht | Häufiger Schmerz | Was normalerweise folgt |

|---|---|---|---|

| Direkte Integration | App ruft Anbieter direkt auf | Verstreute Exceptions | Minimaler Adapter |

| Adapter | Einheitliches Schema, leichte Helfer | Abweichendes Laufzeitverhalten | Zentralisierte Retries |

| Wrapper | Prompts, Routing, Kostentracking | Bottlenecks bei der Zuständigkeit | Denken auf Infrastruktur-Ebene |

| Gateway | Explizite Verträge & Observability | Sichtbare Abwägungen (Trade-offs) | Organisatorische Abstimmung |

Wenn Ihr System auf Stufe 2 oder höher betrieben wird, ist der Wrapper oft nicht mehr rein temporär, sondern übernimmt infrastrukturähnliche Aufgaben.

Wenn ein Wrapper im Stillen zur Infrastruktur wird

Teams merken oft zu spät, dass eine Grenze überschritten wurde.

Häufige Signale sind:

- Mehrere Teams sind vom selben Wrapper abhängig

- Änderungen erfordern Koordination und Rollout-Pläne

- Ausfälle betreffen nicht verwandte Dienste

- Die Schicht benötigt Dokumentation, klare Zuständigkeit und Monitoring

An diesem Punkt fungiert der Wrapper bereits wie eine Gateway-Schicht – auch wenn er noch nicht so benannt oder betrieben wird.

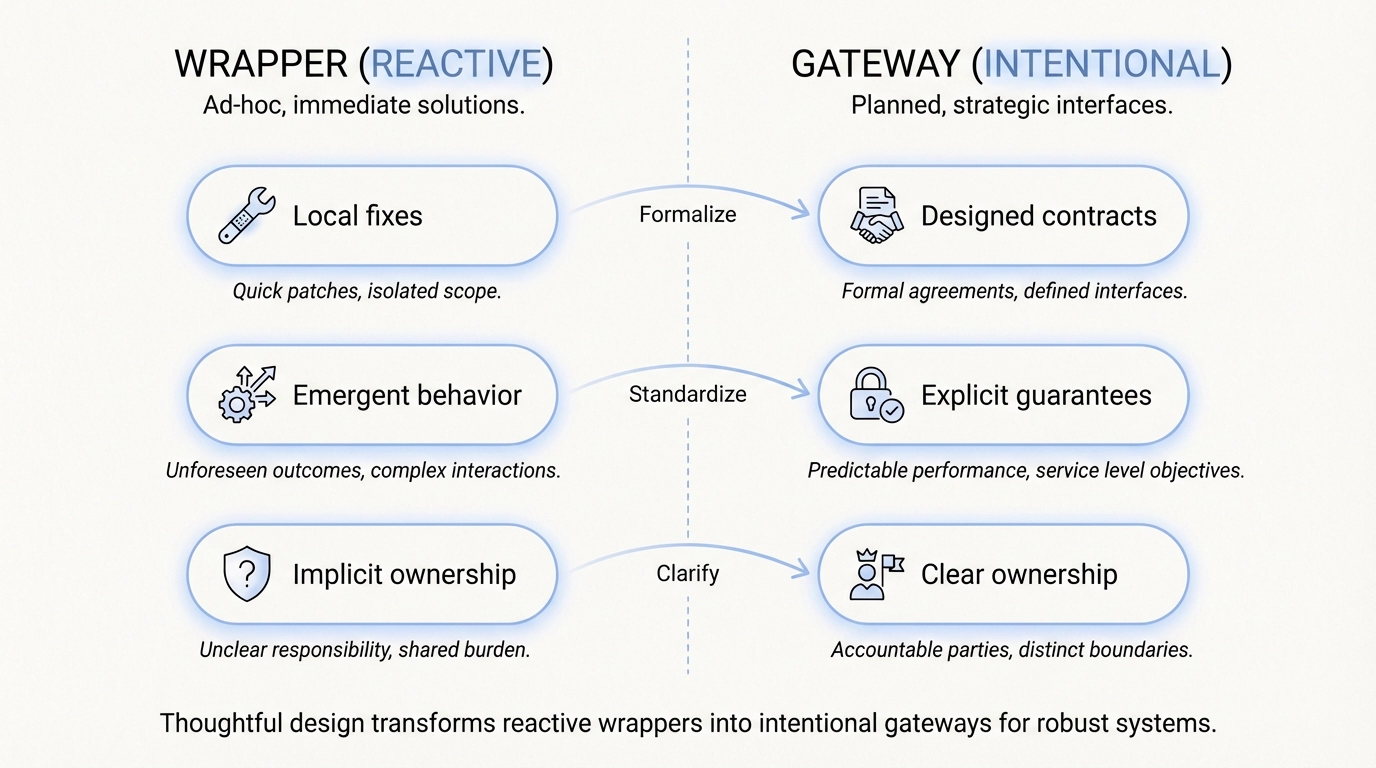

Der Unterschied liegt nicht nur in der Funktionalität. Er liegt in der Absicht und dem Betrieb.

Wrapper sind oft reaktiv. Gateways sind bewusst entworfen.

Bauen oder Weiterentwickeln: Die eigentliche Entscheidung

Die Frage ist selten: „Sollten wir einen Wrapper bauen?“ Diese Entscheidung wurde oft schon implizit getroffen.

Die eigentliche Frage lautet:

Ad-hoc-Entwicklung führt oft zu:

- Versteckter Kopplung

- Inkonsistenten Garantien

- Wissen, das auf wenige Ingenieure konzentriert ist

Bewusste Infrastruktur bringt tendenziell:

- Klare Verträge (Contracts)

- Beobachtbares Verhalten

- Explizite Abwägungen

Keiner der beiden Pfade ist universell richtig. Aber nicht zu wählen, ist auch eine Entscheidung.

Anti-Pattern, auf die man achten sollte

Teams, die Schwierigkeiten mit Wrappern haben, tappten oft in ähnliche Fallen:

- Anbieterspezifische Logik, die in den Produktcode durchsickert

- Mehrere Wrapper, die von verschiedenen Teams gepflegt werden

- Routing-Logik ohne Evaluierungs-Baselines

- Kostentracking ohne Nutzungszuordnung

- Kritische Pfade ohne Telemetrie oder Alarme

Diese Muster signalisieren oft, dass das System aus der informellen Abstraktion herausgewachsen ist.

Eine einfache Checkliste zur Selbsteinschätzung

Wenn Sie drei oder mehr Fragen mit „Ja“ beantworten, ist der Wrapper wahrscheinlich bereits fester Bestandteil Ihrer Architektur:

- Tauchen anbieterspezifische Bedingungen in mehreren Diensten auf?

- Werden Prompts außerhalb des Produktcodes injiziert oder modifiziert?

- Gibt es keine „Single Source of Truth“ für LLM-Nutzung oder -Kosten?

- Ist die Retry- oder Fallback-Logik an mehreren Stellen dupliziert?

- Würde ein Ausfall eines Anbieters koordinierte Codeänderungen erfordern?

Falls ja, ist der Wrapper nicht mehr optional.

👉 Nächster Schritt

ist die nächste Frage, ob direkte APIs noch die richtige Abstraktion sind – oder ob ein Gateway nun den Aufwand wert ist.

Abschließender Gedanke

Wrapper sind kein Fehler.

Sie sind ein Symptom von Skalierung, Komplexität und Produktionsdruck.

Das wirkliche Risiko besteht darin, eine kritische Abstraktionsschicht als „nur kleine Helfer“ zu behandeln, lange nachdem sie zur Infrastruktur geworden ist.

Zu verstehen, wann ein Wrapper diese Grenze überschritten hat, ist der erste Schritt bei der Entscheidung, was daraus als Nächstes entstehen soll.

FAQ

Was ist ein LLM-API-Wrapper?

Ein Wrapper ist eine Zwischenschicht, die das Verhalten normalisieren, Richtlinien durchsetzen und die Zuverlässigkeit über einen oder mehrere LLM-Anbieter hinweg verwalten kann.

Wann sollte ein Team einen LLM-Wrapper bauen?

Viele Teams bauen implizit einen, sobald Produktionszuverlässigkeit, Kostenkontrolle oder Prompt-Governance zu wiederkehrenden Themen werden.

Was ist der Unterschied zwischen einem Wrapper und einem Gateway?

In der Praxis sind Wrapper oft reaktive Sammlungen von Korrekturen, während Gateways bewusst konzipierte Infrastruktur mit expliziten Verträgen sind.

Woran erkenne ich, dass ich über einen Wrapper hinausgehen muss?

Wenn mehrere Teams davon abhängig sind, Ausfälle weitreichende Folgen haben und operative Garantien wichtig werden, ist der Wrapper wahrscheinlich zur Infrastruktur geworden und sollte entsprechend behandelt werden.