GPT-5.2 Deep Dive: Produktions-Benchmarks, API-Migration & Kostenanalyse

Die Ankunft von GPT-5.2 im Dezember 2025 markiert einen bedeutenden Paradigmenwechsel in der KI-Entwicklung. Wir bewegen uns weg von Modellen, die nur plausiblen Text generieren, hin zu Systemen, die zu zuverlässigem logischem Denken fähig sind. Für Ingenieure und CTOs ist dies nicht nur ein inkrementelles Upgrade; es ist eine fundamentale Änderung in der Art und Weise, wie wir geschäftskritische Anwendungen entwerfen und bereitstellen können. GPT-5.2 ist nicht nur "klüger" – es ist für die hochparallelen, komplexen Workflows optimiert, die moderne Unternehmenssoftware definieren.

Wichtige Erkenntnisse

- Fortschrittliches logisches Denken: GPT-5.2 zeigt einen signifikanten Sprung im logischen Denken ("System 2"), reduziert Halluzinationen und ermöglicht komplexere Problemlösungen in einem einzigen Durchgang.

- Produktionsbereit?: Obwohl immens leistungsfähig, führt das Modell einen kritischen Kompromiss zwischen Intelligenz, Latenz und Kosten ein. Es ist kein universeller Ersatz für GPT-4o.

- Agenten-Fähigkeiten: Deutlich verbesserte Funktionsaufrufe und JSON-Modus-Einhaltung machen es zur überlegenen Wahl für den Bau zuverlässiger autonomer Agenten und strukturierter Datenextraktions-Pipelines.

- Integration & Kosten: Der direkte Zugang ist begrenzt und kostspielig. Eine einheitliche API-Schicht wie EvoLink ist unerlässlich für die Kostenverwaltung, die Gewährleistung der Zuverlässigkeit durch Modell-Fallbacks und die Vereinfachung der Integration.

Was GPT-5.2 ist: Ein Blick auf die Architektur

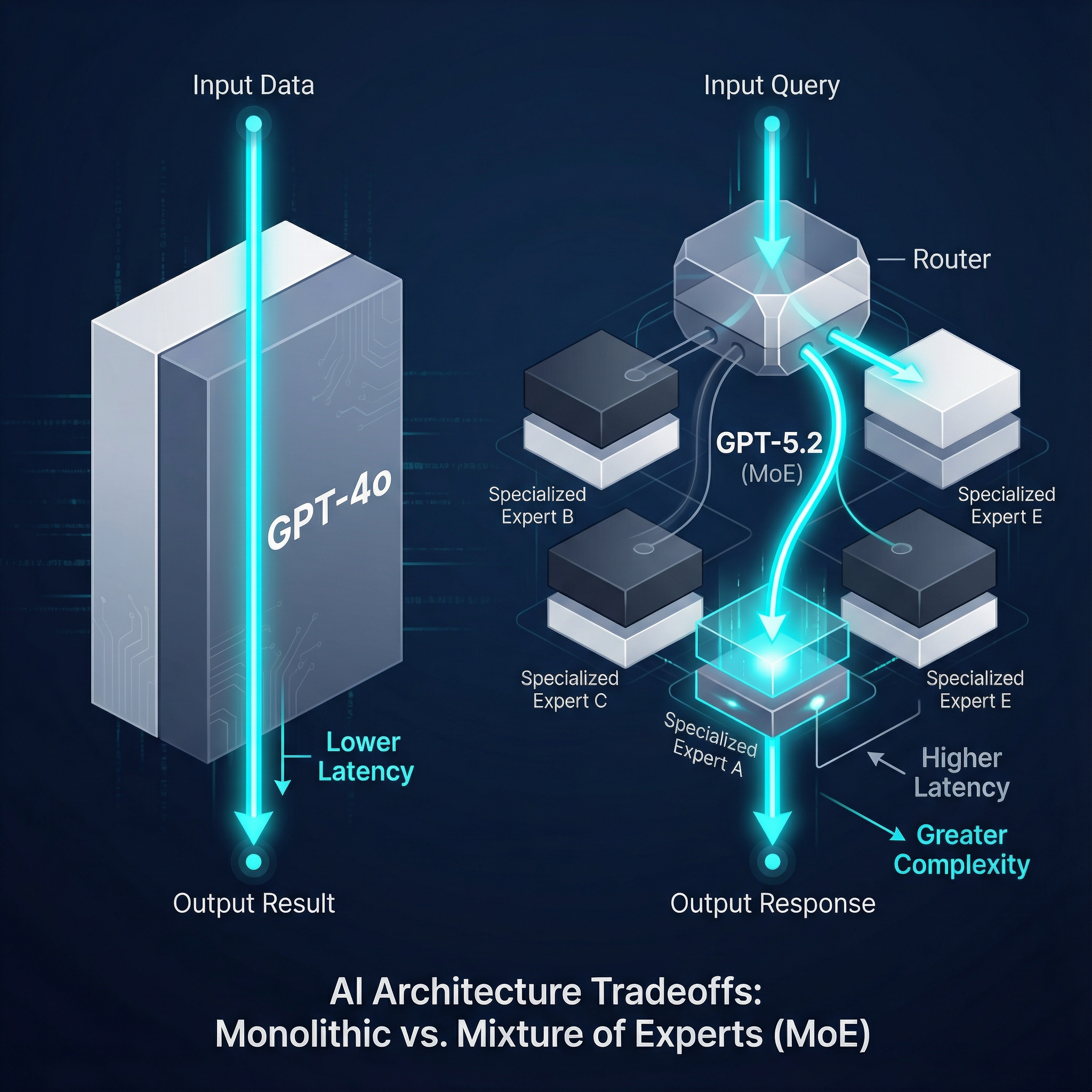

GPT-5.2 repräsentiert eine bedeutende architektonische Evolution. Während OpenAI sich über die genaue Implementierung bedeckt hält, deuten die Leistungssteigerungen auf wichtige Fortschritte hin:

- Architektur: Es wird allgemein angenommen, dass es sich um ein ausgeklügeltes Mixture of Experts (MoE) Modell handelt. Im Gegensatz zu seinen Vorgängern leitet es Anfragen wahrscheinlich an spezialisierte Sub-Netzwerke weiter, was die Effizienz und Fähigkeit bei domänenspezifischen Aufgaben (z. B. Programmieren vs. kreatives Schreiben) verbessert.

- Kontextfenster: Erweitert auf robuste 400.000 Token, was eine tiefere Analyse großer Dokumente, Codebasen oder komplexer Gesprächsverläufe ermöglicht.

- Multimodalität: GPT-5.2 ist nativ multimodal und verarbeitet Text-, Bild- und Audioeingaben mit einem einheitlicheren Verständnis. Dies ermöglicht es ihm, komplexe Datenvisualisierungen, Benutzeroberflächen und Audiohinweise sofort zu interpretieren, ohne separate Modelle zu verketten.

- Reasoning Tokens: Spekulationen deuten auf einen neuen Mechanismus hin, möglicherweise "Reasoning Tokens", der es dem Modell ermöglicht, expliziteres "System 2"-Denken durchzuführen, bevor es eine endgültige Antwort generiert, was seine Leistung bei komplexen logischen und mathematischen Problemen verbessert.

Warum GPT-5.2 für Produktionssysteme wichtig ist

Für diejenigen, die reale Produkte bauen, wird der Wert eines neuen Modells an Zuverlässigkeit und Leistung gemessen, nicht nur an Benchmark-Scores.

1. Zuverlässigkeit

Der bedeutendste Fortschritt ist die dramatische Reduzierung der Halluzinationsraten. Für geschäftskritische Anwendungen in der Rechts-, Medizin- oder Finanzanalyse verschiebt diese verbesserte Zuverlässigkeit die Nadel von "experimentell" zu "verlässlich".

2. Argumentationstiefe

Wo GPT-4 oft komplexe Prompt-Ketten (Prompt Chains) benötigte, um ein Problem zu dekonstruieren, kann GPT-5.2 mehrstufige Logik in einer einzigen Inferenz handhaben. Dies vereinfacht die Anwendungsarchitektur und reduziert Fehlerquellen.

3. Agenten-Fähigkeit

Funktionsaufrufe und JSON-Modus sind laut frühem Entwickler-Feedback jetzt "felsenfest". Die Fähigkeit des Modells, strukturierte Datenformate zuverlässig einzuhalten, macht es zum neuen Goldstandard für den Betrieb autonomer Agenten und vorhersehbarer API-gesteuerter Workflows.

Der Kompromiss

Dieser Intelligenzsprung hat seinen Preis. GPT-5.2 hat eine höhere Latenz und einen höheren Preis pro Token als seine Vorgänger. Die zentrale technische Herausforderung lautet nicht mehr "Ist das Modell schlau genug?", sondern "Ist die zusätzliche Intelligenz die Latenz und die Kosten für diesen spezifischen Anwendungsfall wert?"

Entsperren Sie GPT-5.2 für Ihre Produktionsumgebung

Müde von Wartelisten und unvorhersehbaren Kosten? Erhalten Sie sofortigen, skalierbaren Zugriff auf die GPT-5.2 API ohne Reibung. EvoLink bietet eine einheitliche API mit Großhandelspreisen und Zuverlässigkeit auf Unternehmensniveau.

Kernkompetenzen & Stärken

Die Stärken von GPT-5.2 zeigen sich am deutlichsten bei Aufgaben, die tiefes Fachwissen und Präzision erfordern.

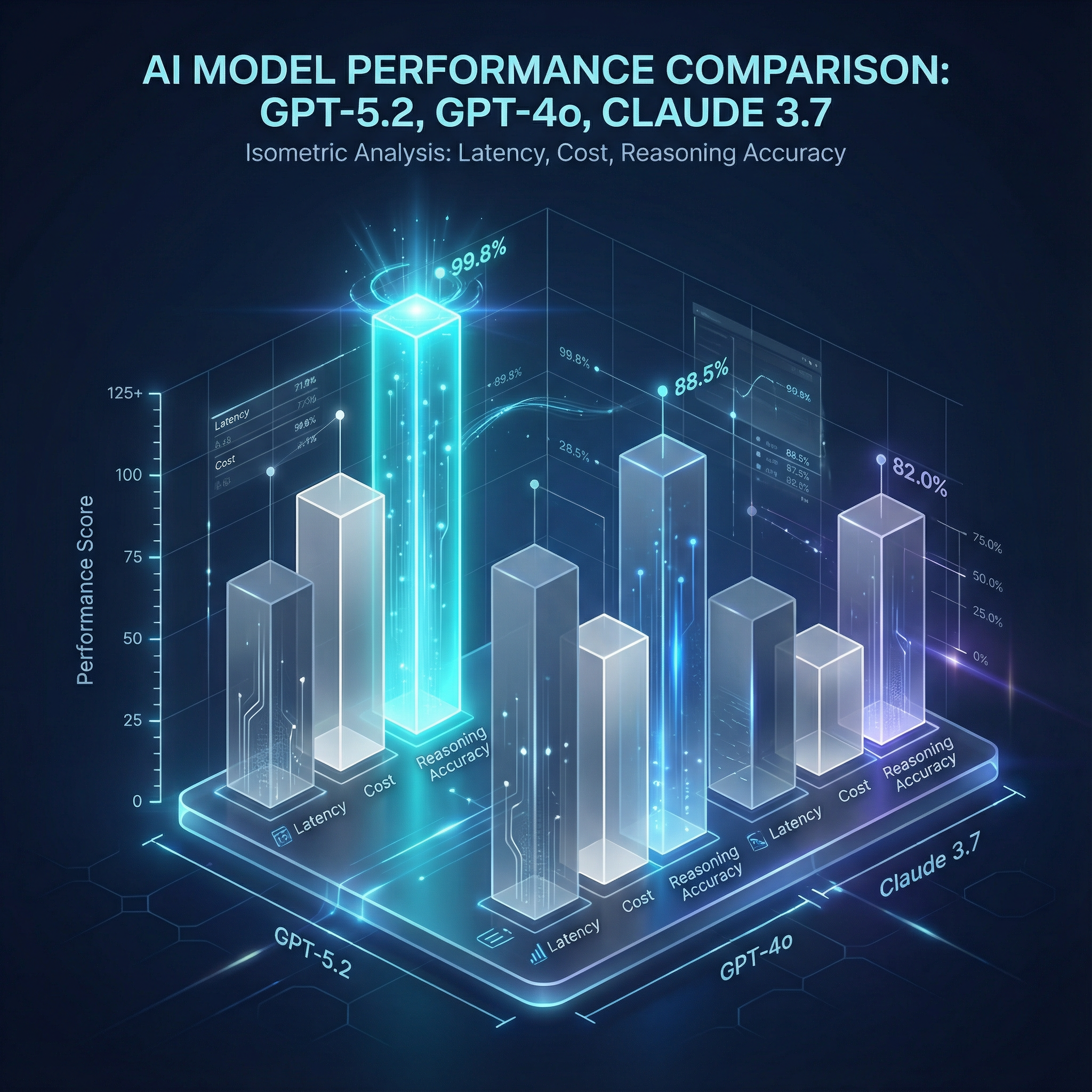

- Fortschrittliches logisches Denken: Übertrifft GPT-4o und Claude 3.7 bei wichtigen Benchmarks wie MATH und GSM8K und demonstriert seine Fähigkeit, mathematische und logische Probleme auf Hochschulniveau zu lösen.

- Programmierkompetenz: Zeigt signifikante Verbesserungen bei HumanEval und SWE-bench. Es kann nicht nur Code generieren, sondern auch komplexe Repositories verstehen und debuggen, was es zu einem mächtigen Pair-Programmer macht.

- Multimodale Fluidität: Kann sofort Finanzdiagramme analysieren, Screenshots von Benutzeroberflächen einem Automatisierungsskript erklären oder Audio transkribieren und zusammenfassen – alles durch einen einzigen API-Aufruf.

- Langzeit-Kontext-Abruf: Zeichnet sich bei "Nadel im Heuhaufen"-Tests aus und ruft spezifische Fakten, die tief in seinem 400.000-Token-Kontextfenster vergraben sind, genau ab. Dies ist entscheidend für RAG-Systeme, die dichte Forschungsarbeiten oder Rechtsdokumente analysieren.

Benchmarks & Kompromisse (Die "echten" Zahlen)

Während Benchmarks einen Teil der Geschichte erzählen, zählen Produktionsmetriken mehr. Hier ist ein pragmatischer Vergleich basierend auf frühen Daten und Community-Berichten.

| Modell | Eingabekosten ($/1M Token) | Ausgabekosten ($/1M Token) | Kontextfenster |

|---|---|---|---|

| GPT-5.2 | 1,75 $ | 14,00 $ | 400K |

| GPT-4o | 1,25 $ | 10,00 $ | 128K |

| Claude 3.7 | 1,50 $ | 12,00 $ | 200K |

| Llama 4 (Open) | 0,50 $ | 4,00 $ | 100K |

Wichtige Metriken

-

Latenz (TTFT): Die Time To First Token von GPT-5.2 ist merklich höher als die von GPT-4o. Für Echtzeit-Konversations-Chatbots kann dies die Benutzererfahrung beeinträchtigen. Es eignet sich besser für asynchrone Aufgaben, bei denen einige Sekunden Verarbeitungszeit akzeptabel sind.

-

Kosten pro Token: Mit 1,75 $ (Eingabe) und 14,00 $ (Ausgabe) pro Million Token ist es die Premium-Option. Eine komplexe Aufgabe, die auf GPT-5.2 günstiger ist (aufgrund weniger Wiederholungsversuche), könnte absolut gesehen immer noch mehr kosten als ein verketteter Prompt-Ansatz auf GPT-4o.

-

Durchsatz (TPS): Offizielle Anbieter verhängen oft strenge Ratenbegrenzungen ("Tier 5" Zugang), was die Skalierung erschwert. Produktionssysteme benötigen eine Lösung, die hohe Token-pro-Sekunde (TPS) bewältigen und Gleichzeitigkeit verwalten kann, ein Kernvorteil der Verwendung eines API-Gateways wie EvoLink.

Entwicklerstimmung & Community-Einblicke

Die Reaktion der Engineering-Community war pragmatisch und aufschlussreich und hat den Hype durchbrochen.

Lob

"Löst endlich komplexe Logikaufgaben mit weniger Halluzinationen. Wir haben eine 5-stufige Prompt-Kette durch einen einzigen Aufruf an GPT-5.2 ersetzt."

"Der JSON-Modus ist für API-Antworten felsenfest. Wir sehen 99,9 % Konformität, was bei früheren Modellen unerhört war."

Beschwerden

"Höhere Latenz für klügere Ausgaben. Das ist schwer zu verkaufen für unsere interaktiven Funktionen."

"Die Migration verlief reibungslos, aber die Kosten pro Token summieren sich schnell. Man muss sehr bewusst entscheiden, welche Aufgaben man darauf auslagert."

Ein wiederkehrendes Thema in Entwicklerforen ist die "Kosten vs. Fähigkeiten"-Kalkulation. Ein Reddit-Nutzer bemerkte:

"EvoLinks Fallback-Funktion hat uns bei Spitzenlasten gerettet. Wir leiten einfache Abfragen an 4o weiter und nutzen 5.2 nur für die schwere Arbeit. Das ist der einzige Weg, wie die Wirtschaftlichkeit funktioniert."

Preisgestaltung & Kosteneffizienz

Der Betrieb von GPT-5.2 im großen Maßstab ist eine erhebliche finanzielle Verpflichtung. Das Problem des "Tier 5"-Zugangs über offizielle Anbieter bedeutet, dass viele Unternehmen aufgrund strenger Ratenbegrenzungen und Wartelisten gegen eine Wand fahren. Darüber hinaus verursacht die Verwaltung der Abrechnung über mehrere Modelle und Anbieter hinweg unnötigen operativen Aufwand. Hier wird eine API-Infrastrukturschicht entscheidend. EvoLink geht diese Herausforderungen direkt an:

-

Großhandelspreise: Durch die Bündelung der Nachfrage bietet EvoLink Zugang zu Modellen wie GPT-5.2 zu mengenrabattierten Preisen, die für einzelne Unternehmen typischerweise nicht verfügbar sind.

-

Einheitliche Abrechnung: Konsolidieren Sie Ausgaben für GPT-5.2, GPT-4o, Claude und andere Modelle in einer einzigen Rechnung. Dies vereinfacht die Kostenverfolgung und das Budgetmanagement für Ihren gesamten KI-Stack.

-

Intelligentes Routing & Fallbacks: Zahlen Sie keine Premiumpreise für einfache Aufgaben. Nutzen Sie EvoLink, um Anfragen dynamisch an das kostengünstigste Modell zu leiten, das den Job erledigen kann, mit automatischen Fallbacks zur Sicherung der Verfügbarkeit.

So integrieren Sie GPT-5.2 via API

base_url auf den EvoLink-Endpunkt zu verweisen. Diese einzelne Änderung schaltet modellunabhängiges Routing, Fallbacks und Kostenoptimierung frei, ohne Ihre Kernanwendungslogik zu ändern.Hier ist ein sauberer Python-Schnipsel, der einen Streaming-Aufruf an GPT-5.2 über das EvoLink API-Gateway demonstriert.

import requests

url = "https://api.evolink.ai/v1/chat/completions"

payload = {

"model": "gpt-5.2",

"messages": [

{

"role": "user",

"content": "Please introduce yourself"

}

],

"temperature": 1,

"stream": False,

"top_p": 1,

"frequency_penalty": 0,

"presence_penalty": 0

}

headers = {

"Authorization": "Bearer <token>",

"Content-Type": "application/json"

}

response = requests.post(url, json=payload, headers=headers)

print(response.text)Migrationscheckliste: Ist Ihre App bereit für GPT-5.2?

- Identifizieren Sie hochwertige Anwendungsfälle: Ermitteln Sie Aufgaben, bei denen tiefes logisches Denken und geringe Halluzinationen entscheidend sind (z. B. Analyse von Rechtsverträgen, komplexe Codegenerierung).

- Bewerten Sie die Latenztoleranz: Kann Ihre Benutzererfahrung eine etwas längere Antwortzeit für eine viel klügere Antwort tolerieren?

- Implementieren Sie einen Router/Gateway: Nutzen Sie einen Dienst wie EvoLink, um Vendor Lock-in zu vermeiden und dynamisches Umschalten zwischen GPT-5.2 und wirtschaftlicheren Modellen wie GPT-4o zu ermöglichen.

- Schreiben Sie kritische Prompts um: Während viele Prompts sofort funktionieren, verfeinern Sie Ihre wichtigsten System-Prompts, um die fortschrittlichen Argumentationsfähigkeiten von GPT-5.2 zu nutzen.

- Überwachen Sie Kosten genau: Richten Sie Dashboards ein, um den Token-Verbrauch zu verfolgen. Die Kosten für GPT-5.2 können schnell eskalieren, wenn es für jede einzelne Abfrage verwendet wird.

Anwendungsfälle & Entscheidungsleitfaden

Die Wahl des richtigen Modells ist eine kritische Architekturentscheidung.

Wann man GPT-5.2 verwendet

-

Autonome Agenten: Beim Bau von Agenten, die mehrstufige Aufgaben mit hoher Zuverlässigkeit ausführen und Werkzeuge (Funktionsaufrufe) jedes Mal korrekt verwenden müssen.

-

Komplexes RAG: Für Frage-Antwort-Systeme, die Informationen aus mehreren dichten, technischen Dokumenten mit hoher Wiedergabetreue synthetisieren müssen.

-

Fortgeschrittene Coding-Assistenten: Für Werkzeuge, die ganze Codebasen verstehen, komplexe Logik generieren und subtile Fehler identifizieren müssen.

-

Rechts- & Medizinanalyse: In Bereichen, in denen Präzision nicht verhandelbar ist und Halluzinationen inakzeptabel sind.

Wann man bei GPT-4o / Mini bleibt

-

Klassifikatoren mit hohem Volumen: Für einfache Textklassifizierung, Sentimentanalyse oder Datenextraktion, wo Geschwindigkeit und niedrige Kosten oberste Priorität haben.

-

Einfache Chatbots: Wenn das Ziel Konversationsfluss und schnelle Antworten statt tiefer Problemlösung ist.

-

Latenzkritische Flows: Für Echtzeitanwendungen wie Live-Transkription oder interaktive Suchvorschläge, wo jede Millisekunde zählt.

Fazit: Der strategische Upgrade-Pfad

GPT-5.2 ist mehr als nur ein leistungsstarkes neues Modell; es ist ein spezialisiertes Werkzeug für anspruchsvolle Argumentationsaufgaben. Ein pauschales Upgrade all Ihrer KI-Workflows auf GPT-5.2 ist aufgrund von Kosten und Latenz nicht nur unpraktisch – es ist schlechtes Engineering.

Die Zukunft der Produktions-KI liegt nicht darin, das eine "beste" Modell zu finden, sondern darin, ein flexibles, intelligentes und kostenbewusstes System aufzubauen.

Häufig gestellte Fragen (FAQ)

1. Wie verhält sich die Preisgestaltung von GPT-5.2 im Vergleich zu GPT-4o?

GPT-5.2 ist pro Token deutlich teurer. Im Durchschnitt können Sie erwarten, dass die Eingabekosten etwa 40 % höher und die Ausgabekosten etwa 40 % höher sind als bei GPT-4o. Dies macht Kostenmanagement-Strategien unerlässlich.

2. Ist Prompt Engineering für GPT-5.2 anders?

Während viele Prompts unverändert funktionieren, nutzen Sie möglicherweise nicht die volle Leistung. Prompts können vereinfacht werden, mit weniger Bedarf an "Chain-of-Thought" oder Few-Shot-Beispielen, da das inhärente logische Denken des Modells stärker ist.

3. Wie zuverlässig ist der JSON-Modus von GPT-5.2?

Extrem zuverlässig. Entwickler-Feedback zeigt, dass dies eines der herausragenden Merkmale des Modells ist, was es perfekt für die strukturierte Datenextraktion und den Aufbau zuverlässiger Agenten-Workflows macht.

4. Was sind die Hauptvorteile der Verwendung von EvoLink für GPT-5.2?

EvoLink bietet eine einheitliche API für den Zugriff auf GPT-5.2 neben anderen Modellen, konsolidierte Abrechnung, Mengenrabatte, intelligentes Routing zur Kostenoptimierung und Fallback-Funktionen zur Verbesserung der Zuverlässigkeit.

5. Wie verhält sich das Kontextfenster von GPT-5.2 im Vergleich zu Claude 3.7?

GPT-5.2 verfügt über ein 400.000-Token-Kontextfenster, was das Doppelte des 200.000-Token-Kontextfensters von Claude 3.7 ist. Dies ermöglicht es ihm, viel größere Informationsmengen in einem einzigen Durchgang zu verarbeiten und zu analysieren.