GPT-5.2 in der Produktion: Reasoning, Zuverlässigkeit, Preisgestaltung und Systemdesign in der realen Welt

GPT-5.2 ist kein Upgrade, bei dem man einfach "den Modell-String austauscht". In der Produktion drängt dieses Modell Teams zu expliziten technischen Kompromissen: Kontextbudgets, Ausgabebudgets, Latenzvarianz, Wiederholungsversuche und Leitplanken (Guardrails). Wenn Sie es überall fest codieren, werden Sie entweder zu viel ausgeben oder SLOs verletzen.

Dieser Leitfaden ist bewusst praxisorientiert: Langkontext-Muster, Schema-Einschränkungen, asynchrone Ausführung, Kostenrahmen und Rollout-Gates. Wir werden explizit darauf eingehen, was bestätigt ist und was von der Arbeitslast abhängt.

Der technische Wandel: Warum dieses Modell "Standardarchitekturen" verändert

Viele Teams bewerten Frontier-Modelle wie Bibliotheken: Version aktualisieren, Tests ausführen, ausliefern. Diese Denkweise bricht in der Produktion zusammen, wenn Ihre "Bibliothek" auch Ihre größte Quelle für variable Latenz und variable Kosten ist.

Bei dieser Veröffentlichung ist die kritische Änderung nicht "es ist klüger". Die Änderung besteht darin, dass sie langen Kontext und große Ausgaben erstklassig macht, und OpenAI Reasoning-Token auch als Konzept mit expliziten Abrechnungs- und Kontextimplikationen offenlegt.

Diese Kombination drängt Produktionsteams in Richtung eines Betreiber-Rahmens:

- Sie "rufen das Modell nicht auf". Sie führen eine begrenzte Ausführung mit Budgets, Validierung und Abbruchbedingungen aus.

- Sie messen nicht die "durchschnittliche Latenz". Sie verwalten Verteilungen (p50/p95/p99) und planen für Tail-Amplifikation, wenn Prompts groß werden.

- Sie verfolgen nicht die "Kosten pro Anfrage".

Sie verfolgen die Kosten pro erfolgreicher Aufgabe, da Wiederholungsversuche und Tool-Schleifen alles verändern.

Aktuell dokumentierte GPT-5.2 Grenzen

Dieser Abschnitt enthält nur Spezifikationen, auf die Sie ohne "Benchmark-Blog-Hörensagen" verweisen können.

Kontextfenster, Ausgabelimit und Wissensstichtag

Aus OpenAIs Modelldokumentation für GPT-5.2:

- Kontextfenster: 400.000 Token

- **Max.

Ausgabe-Token:** 128.000

-

Wissensstichtag: 31. August 2025 Diese drei Zahlen definieren Ihre operativen Grenzen:

-

400k Kontext macht es verlockend, ganze Repositories in einen einzigen Aufruf zu werfen. Das funktioniert – bis Ihre Tail-Latenz und Kosten explodieren.

-

128k Ausgabe macht es verlockend, nach Ausgaben mit mehreren tausend Zeilen zu fragen. Das funktioniert – bis Sie feststellen, dass Ihrem System eine Abbruchfunktion fehlt.

-

31. Aug. 2025 bedeutet, dass Sie ohne Abruf oder Browsing keine aktuellen Fakten nach dem Stichtag annehmen können.

Reasoning-Token: Die versteckte Variable, die Sie budgetieren müssen

OpenAI gibt explizit an, dass Reasoning-Token nicht über die API sichtbar sind, aber sie belegen dennoch Platz im Kontextfenster und sind in der abrechenbaren Ausgabenutzung enthalten. Dies ist leicht zu übersehen und schmerzhaft, wenn man es spät lernt. Selbst wenn Ihre Anwendung nur eine kurze Antwort druckt, kann internes Reasoning die Ausgabe-Token-Buchhaltung erhöhen. In der Produktion bedeutet das:

-

Ausgabekosten können "sichtbare Textkosten" übersteigen

-

Kontextdruck kann "sichtbaren Prompt + sichtbare Ausgabe" übersteigen

-

Budgetierung muss konservativ sein, insbesondere für Langkontext-Aufgaben

Langlaufende Generierungen sind real (Design für Async)

OpenAI merkt an, dass einige komplexe Generierungen (z. B. Tabellenkalkulationen oder Präsentationen) viele Minuten dauern können. Sie brauchen kein "TTFT-Diagramm", um dies umsetzbar zu machen. "Viele Minuten" reichen aus, um Folgendes zu erfordern:

-

Asynchrone Job-Orchestrierung

-

Fortschrittsberichte und Teilausgaben

-

Abbruch

-

Idempotenz-Schlüssel

-

Timeouts pro Route

Langkontext-Systeme: Entwurfsmuster, die die Produktion vorhersehbar halten

Ein 400k-Kontextfenster erweitert das Mögliche, hebt aber die Gesetze von Produktionssystemen nicht auf. "Großer Kontext" verhält sich wie "große Payload" überall sonst.

Behandeln Sie Kontext nicht als Müllkippe. Behandeln Sie ihn als Budget.

Langer Kontext ist keine "kostenlose Genauigkeit". Es ist ein Tausch: mehr Beweise können die Richtigkeit verbessern, aber mehr Token erhöhen die Variabilität. Ein praktischer Ansatz ist es, Token-Budgets so zuzuweisen, wie Sie CPU/Speicher zuweisen:

-

System + Richtlinien-Präfix: Fest und cachebar

-

Abgerufene Beweise: Begrenzt und gewichtet

-

Aufgabenanweisungen: Kurz und präzise

-

Tool-Ausgaben: Zusammengefasst vor der Reinjektion

-

Benutzerverlauf: Gefenstert, nicht unendlich

Abrufdisziplin schlägt rohe Kontextlänge

Wenn Sie RAG haben, ist der Gewinnzug nicht "mehr stopfen". Es ist "besser stopfen". Produktionsempfehlungen:

-

Nach Nützlichkeit ranken, nicht nach Aktualität

-

Beweise atomar halten: kurze Stücke, die eine Frage beantworten

-

Immer Quellenkennungen (Doc-ID, Zeitstempel) einschließen

-

Beweise in aufgabenorientierte Aufzählungspunkte zusammenfassen

Das "Two-Pass Long-Context"-Muster

Für große Korpora (Ticket-Verläufe, Transkripte, Repo-Diffs) verwenden Sie ein Two-Pass-Design:

-

Map-Phase: Zerlegen → in strukturierte Einheiten zusammenfassen

-

Reduce-Phase: Zusammenfassungen kombinieren → mit begrenzter Ausgabe antworten

Dieses Muster reduziert die Tail-Latenz, verbessert die Debugging-Fähigkeit und erleichtert das Caching von Zwischenzusammenfassungen.

Zuverlässigkeitsrealität: Schema, Tools, Drift und die Fehler-Taxonomie

Die Mehrheit der "Modellvorfälle" sind eigentlich Vertragsvorfälle. Das Modell tat etwas Plausibles – aber Ihr System brauchte etwas Spezifisches.

Behandeln Sie Struktur als Vertrag, nicht als Vorschlag

Für Aufgaben wie Extraktion, Routing-Entscheidungen oder Tool-Aufruf:

-

Verwenden Sie JSON-Schema (oder strenge Schlüssel/Wert-Formate)

-

Validieren Sie jede Ausgabe vor der Verwendung

-

Implementieren Sie einen einzelnen "Reparaturdurchlauf", wenn die Validierung fehlschlägt Ein zuverlässiges Muster:

-

JSON mit strengen Anweisungen generieren

-

Gegen Schema validieren

-

Wenn ungültig, einen Reparatur-Prompt ausführen

-

Wenn immer noch ungültig, ordnungsgemäß fehlschlagen

Tool-Sicherheit: Deterministische Wrapper, nicht "Modellmagie"

Auch wenn GPT-5.2 stark in der Planung ist, muss Tool-Sicherheit vom System durchgesetzt werden:

-

Allowlist für Tools pro Route

-

Parameter und Bereiche validieren

-

Idempotenz-Schlüssel hinzufügen

-

Tools mit Nebenwirkungen in eine Sandbox stecken

-

Tool-Aufrufe für Audits protokollieren

Benchmarks & Kompromisse: SWE-bench Deltas, die Sie zitieren können

-

SWE-Bench Pro (öffentlich): 55,6 %

-

SWE-bench Verified: 80,0 % GPT-5.1:

-

SWE-Bench Pro (öffentlich): 50,8 %

-

SWE-bench Verified: 76,3 %

Interpretation für Produktionscode-Workflows

Das Delta ist bedeutend genug, um eine Bewertung für Coding-Agenten und Code-Assistenz-Workflows zu rechtfertigen. Aber SWE-bench-Verbesserungen beseitigen nicht die Notwendigkeit für Tests, Gates und Rollback.

Preisgestaltung: Stückkostenrechnung, Caching und Budgetrahmen

Wenn Teams sagen "das Modell ist teuer", meinen sie normalerweise, dass sie die Ausgabe nicht gedeckelt haben, stabile Präfixe nicht gecacht haben und Wiederholungsversuche ihre Nutzung vervielfacht haben.

Offizielle Preisgestaltung

Für gpt-5.2 zeigt OpenAIs Preisgestaltung:

-

Eingabe: 1,75 $ / 1M Token

-

Gecachte Eingabe: 0,175 $ / 1M Token (90 % Rabatt)

-

Ausgabe: 14,00 $ / 1M Token

Praktische Kostenkontrollen

-

Stabile Präfixe cachen (System-Prompts, Richtlinien, Schemata, Tool-Beschreibungen)

-

Ausgabe und Wiederholungsversuche deckeln (Reasoning-Token werden als Ausgabe abgerechnet)

-

Tool-Ausgaben zusammenfassen vor der Reinjektion

-

Kosten pro erfolgreicher Aufgabe verfolgen, nicht Kosten pro Anfrage

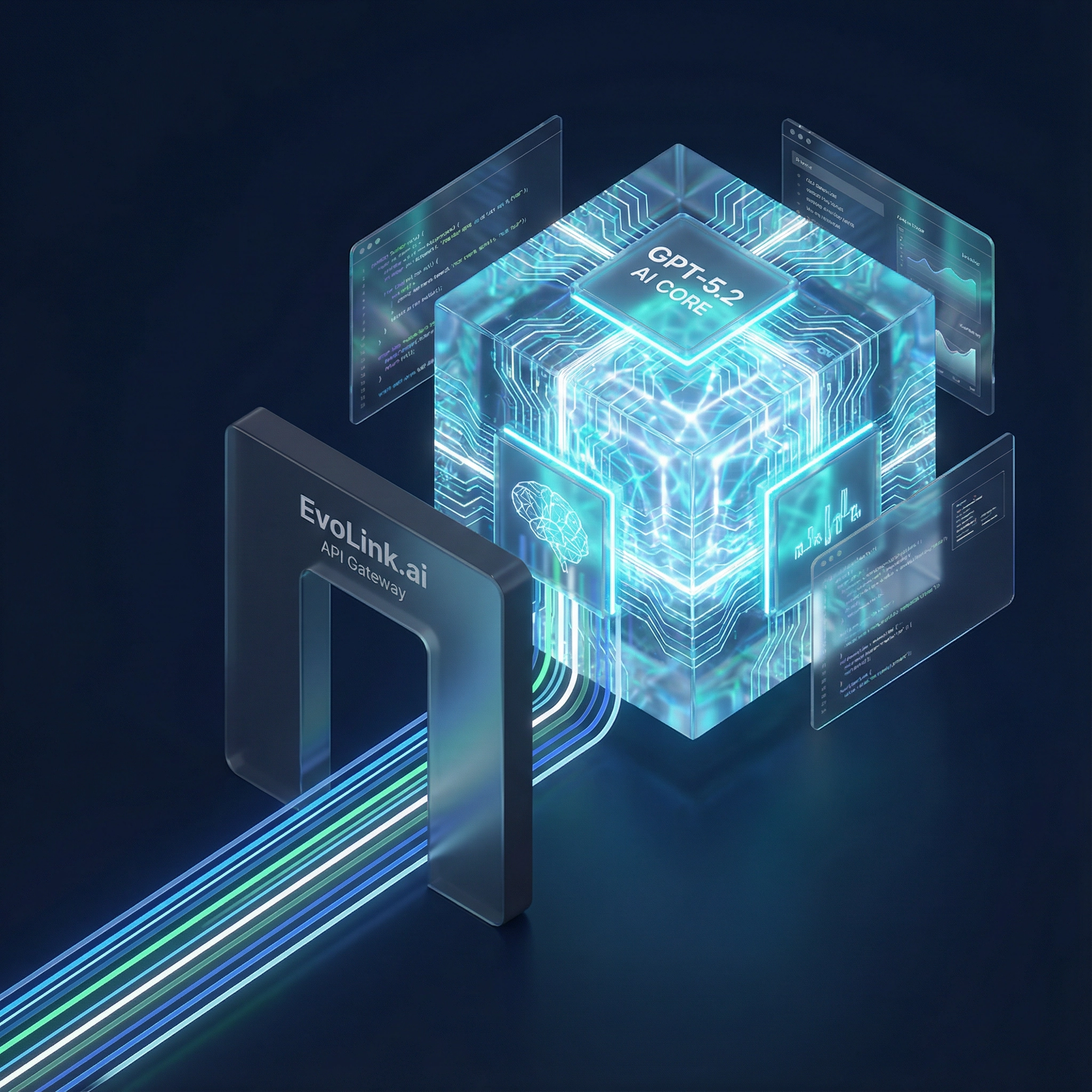

EvoLink: Einheitliche API + Niedrigere Kosten

EvoLink hilft Teams, dieses Modell mit zwei konkreten Werten einzuführen: einheitliche Integration und niedrigere effektive Kosten.

Einheitliche API: Einmal integrieren, über Modelle hinweg entwickeln

Anstatt Ihre Anwendung an ein Anbieter-SDK zu binden, gibt Ihnen EvoLink:

-

Eine base_url

-

Eine Authentifizierungsoberfläche

-

Konsistente Schnittstelle über Modelle hinweg

Dies verhindert, dass die Einführung von GPT-5.2 zu einer Abhängigkeitsfalle wird.

Niedrigere effektive Kosten: Großhandelspreise + Vereinfachte Abrechnung

Stückkostenrechnung kann im großen Maßstab herausfordernd sein. EvoLinks Positionierung:

-

Nutzung über ein einziges Gateway konsolidieren

-

Von Großhandels-/Mengenpreisdynamiken profitieren

-

Abrechnung und Kostenzuordnung über Teams hinweg vereinfachen

Python— GPT-5.2 via EvoLink

import requests

url = "https://api.evolink.ai/v1/chat/completions"

payload = {

"model": "gpt-5.2",

"messages": [

{

"role": "user",

"content": "Hello, introduce the new features of GPT-5.2"

}

]

}

headers = {

"Authorization": "Bearer <token>",

"Content-Type": "application/json"

}

response = requests.post(url, json=payload, headers=headers)

print(response.text)cURL — GPT-5.2 via EvoLink

curl --request POST \

--url https://api.evolink.ai/v1/chat/completions \

--header 'Authorization: Bearer <token>' \

--header 'Content-Type: application/json' \

--data '

{

"model": "gpt-5.2",

"messages": [

{

"role": "user",

"content": "Hello, introduce the new features of GPT-5.2"

}

]

}

'Entscheidungsmatrix: Wann sich GPT-5.2 lohnt

|----------|---------------------|--------------|----------------|

| Klassifizierung / Tagging | Hoch | Niedrig | Schnelleren/günstigeren Tier nutzen |

| Kundenorientierter Chat | Hoch | Mittel | Fast Tier als Standard; Eskalation zu GPT-5.2 | | Langkontext-Synthese | Mittel | Mittel/Hoch | GPT-5.2 mit Kompression + Obergrenzen | | Tool-gesteuerte Workflows | Mittel | Hoch | GPT-5.2 mit deterministischen Tools | | High-Stakes-Liefergegenstände | Niedrig | Hoch | GPT-5.2; asynchrone Jobs für lange Arbeit |

Produktions-Rollout-Checkliste

Beobachtbarkeit & Budgets

-

Log: prompt_tokens, output_tokens, retries, tool_calls, schema_pass

-

Track: p50/p95/p99 Latenz, timeout_rate, cancel_rate

-

Add: Kosten pro erfolgreicher Aufgabe (pro Route)

-

Cap: Max. Ausgabe-Token; Wiederholungsbudget; Tool-Aufruf-Limits

-

Implement: Idempotenz-Schlüssel für wiederholbare Operationen

Zuverlässigkeits-Gates

-

Schema-Validierung bei jeder strukturierten Ausgabe

-

Ein Reparaturdurchlauf bei Schema-Fehler

-

Schleifenerkennung für Tool-Workflows

-

Zustandskompression für lange Konversationen

Rollout-Plan

-

Schattenverkehr und Erfolg/Kosten/Latenz vergleichen

-

Schrittweise Steigerung: 1 % → 5 % → 25 % → 50 % → 100 %

-

Rollback-Trigger: p95-Verletzung, Anstieg von Schema-Fehlern, Anstieg Kosten/Aufgabe

-

Runbooks: Timeouts, Ratenbegrenzungen, Teilausfälle

FAQ

Was ist das GPT-5.2 Kontextfenster?

Was ist die GPT-5.2 maximale Ausgabe?

Was ist die GPT-5.2 Preisgestaltung?

1,75 $/1M Eingabe, 0,175 $/1M gecachte Eingabe (90 % Rabatt), 14 $/1M Ausgabe.

Werden Reasoning-Token abgerechnet?

Ja – in der Praxis sind Reasoning-Token in der API-Antwort nicht sichtbar, aber sie belegen Kontext und tragen zur ausgabeseitigen Abrechnung bei.

Bietet OpenAI eine universelle TTFT für GPT-5.2?

Nicht als eine einzige Zahl, die über alle Workloads hinweg anwendbar ist. OpenAI merkt an, dass komplexe Generierungen viele Minuten dauern können.

Hat GPT-5.2 veröffentlichte SWE-bench Deltas?

Wie fange ich mit GPT-5.2 auf EvoLink an?

Fazit

Aus der Perspektive eines Betreibers wird GPT-5.2 am besten als begrenzte Ausführungsmaschine mit Budgets und Verträgen behandelt. Nutzen Sie EvoLink, wenn Sie eine einheitliche API-Oberfläche und günstigere effektive Preise wünschen, während Sie die Nutzung über Dienste hinweg skalieren.

Die Zukunft der Produktions-KI liegt nicht darin, das eine "beste" Modell zu finden, sondern darin, ein flexibles, intelligentes und kostenbewusstes System aufzubauen, das Aufgaben an das richtige Modell für den Job leitet.