Wan 2.5 API Review: Der komplette Entwicklerleitfaden zur KI-Videogenerierung 2026

Was ist Wan 2.5? Alibabas Videogenerierungs-Plattform verstehen

Kernarchitektur & Fähigkeiten

- Text-to-Video API (

wan2.5-t2v-preview): Generiert Videos komplett aus Text. Das Modell versteht räumliche Beziehungen, Lichtverhältnisse, Bewegungsmuster und kann sogar emotionale Nuancen aus natürlicher Sprache erfassen. - Image-to-Video API (

wan2.5-i2v-preview): Erweckt statische Bilder zum Leben und animiert Fotos, Illustrationen oder digitale Kunst zu kurzen Videos mit realistischen Bewegungen, während der ursprüngliche Stil strikt beibehalten wird.

Audio-Visuelle Synchronisation: Das wahre Alleinstellungsmerkmal

- Lippensynchronisation (Lip-Syncing): Präzise Synchronisation der Lippenbewegungen von Charakteren (Genauigkeit ~92%-95%).

- Ambient Sound Design: Hintergrundgeräusche, die logisch zum visuellen Kontext passen.

- Musikgenerierung: Musikalischer Rhythmus, der auf Kamerabewegung und Tempo abgestimmt ist.

- Dialoggenerierung: Unterstützt Konversationen mit mehreren Charakteren mit natürlichem Sprecherwechsel.

Plattformverfügbarkeit & Zugangskanäle

Die Wan 2.5 API ist über mehrere Drittanbieter-Plattformen zugänglich:

- Alibaba Cloud DashScope: Die offizielle Hauptplattform.

- Kie.ai: Wettbewerbsfähige Preise.

- Fal.ai: Exzellente Client-Bibliotheken und Webhook-Erfahrung.

- Evolink.ai: Benutzerfreundliche Oberfläche mit hervorragender Preisgestaltung.

- Pixazo: Mittleres Preissegment mit integrierten Kreativ-Tools.

- AIMLAPI.com: Einheitlicher Aggregationszugang.

Hauptfunktionen der Wan 2.5 API

1. Multimodale Eingabeverarbeitung

- Text-Prompts: Bis zu ~800 Zeichen (unterstützt Englisch/Chinesisch).

- Referenzbilder: JPG/PNG als visuelle Anker.

- Audiodateien: Upload von WAV/MP3-Dateien zur Steuerung von Rhythmus und Tempo.

- Negative Prompts: Bis zu ~500 Zeichen, um unerwünschte Elemente auszuschließen.

2. Native Audio-Visuelle Synchronisation

- Hochpräzise Lip-Sync: Phonem-genaue Übereinstimmung mit ~92-95% Genauigkeit.

- Multi-Sprecher-Unterstützung: Fähig, Dialogszenen zu generieren.

- Ambiente & Musik: Kontextsensitive Audiogenerierung.

3. HD-Ausgabeoptionen

| Auflösung | Abmessungen | Bildrate | Idealer Anwendungsfall |

|---|---|---|---|

| 480p | 854×480 | 24fps | Vorschauen, Entwürfe, Stapelverarbeitung |

| 720p HD | 1280×720 | 24fps | Online-Inhalte, YouTube |

| 1080p Full HD | 1920×1080 | 24fps | Professionelles Marketing, Broadcast-Qualität |

4. Filmische Kontrolle

- Kamerabewegung: Schwenken, Neigen, Zoomen, Dolly, Kran/Boom, etc.

- Schärfentiefe: Flacher/tiefer Fokus, Rack-Focus-Effekte.

- Beleuchtungskontrolle: Goldene Stunde, dramatisches Licht, Studiolicht, etc.

5. Verbesserte Bewegung & "Physik"

- Physikbewusste Animation: Realistischere Darstellungen von Gewicht und Schwerkraft.

- Zeitliche Konsistenz: Beansprucht bis zu ~94% Frame-zu-Frame-Konsistenz.

Technische Spezifikationen der Wan 2.5 API

| Spezifikation | Details |

|---|---|

| API-Version | Wan 2.5 Preview (Veröffentlicht Sept 2025) |

| Modellarchitektur | Diffusions-basierter Multimodaler Transformer |

| Unterstützte Auflösungen | 480p, 720p, 1080p |

| Bildrate | 24 fps |

| Videodauer | 5 Sekunden, 10 Sekunden |

| Seitenverhältnisse | 16:9, 9:16, 1:1, 4:3, 3:4 |

| Audio-Eingang | WAV, MP3 (3–30s, Max 15MB) |

| Lip-Sync-Genauigkeit | ~92%-95% auf Phonem-Ebene |

| Sprachunterstützung | Chinesisch (Primär), Englisch und 20+ weitere |

| Durchschn. Generierungszeit | 720p: ~2–4 Min; 1080p: ~3–5 Min |

| Videoformat | MP4 (H.264 kodiert) |

Wan 2.5 API Preisgestaltung: Komplette Kostenanalyse

Das Standard-Abrechnungsmodell für diese API erfolgt in der Regel pro Sekunde: Gesamtkosten = Dauer (Sekunden) × Preis pro Sekunde.

Plattformübergreifender Preisvergleich

| Plattform | 480p/Sek | 720p/Sek | 1080p/Sek | Highlights |

|---|---|---|---|---|

| Kie.ai | $0.05 | $0.06 | $0.10 | Benutzerfreundliche UI |

| Fal.ai | $0.05 | $0.10 | $0.15 | Exzellentes SDK |

| Evolink.ai | $0.05 | $0.07 | $0.071 | Bestes Preis-Leistungs-Verhältnis für 1080p; einfache Integration |

| Pixazo | $0.06 | $0.08 | $0.12 | Integrierte Kreativ-Tools |

| AIMLAPI | $0.05 | $0.09 | $0.13 | Einheitliche Aggregation |

Beispiel für reale Kosten (Einzelnes Video)

| Dauer | Auflösung | Kie.ai | Fal.ai | Evolink.ai |

|---|---|---|---|---|

| 5 Sekunden | 720p | $0.30 | $0.50 | $0.35 |

| 10 Sekunden | 1080p | $1.00 | $1.50 | $1.10 |

So verwenden Sie die Wan 2.5 API: Integrations-Tutorial

Schritt 1: Abhängigkeiten installieren

Python:

pip install requests python-dotenvNode.js:

npm install axios dotenvSchritt 2: Python-Beispiel (Text-to-Video)

import requests

import os

import time

from dotenv import load_dotenv

load_dotenv()

api_key = os.getenv("WAN_API_KEY")

base_url = "https://api.evolink.ai/v2"

def generate_text_to_video(prompt, resolution="1080p", duration=10, enable_audio=True):

url = f"{base_url}/generate/video/wan/2-5-text-to-video"

headers = {

"Authorization": f"Bearer {api_key}",

"Content-Type": "application/json"

}

payload = {

"prompt": prompt,

"resolution": resolution,

"duration": duration,

"audio": enable_audio,

"prompt_extend": True,

"aspect_ratio": "16:9",

"seed": -1

}

try:

response = requests.post(url, json=payload, headers=headers, timeout=30)

response.raise_for_status()

return response.json().get("task_id")

except requests.exceptions.RequestException as e:

print(f"✗ API-Fehler: {e}")

raise

# Anwendungsbeispiel

task_id = generate_text_to_video(

prompt="A sleek sports car accelerating through a neon-lit cyberpunk city at night.",

resolution="1080p"

)Schritt 3: Produktions-Empfehlung – Webhooks verwenden

# Flask Webhook Example

from flask import Flask, request, jsonify

app = Flask(__name__)

@app.route('/api/webhook/wan-video', methods=['POST'])

def handle_video_completion():

data = request.json

task_id = data.get("task_id")

status = data.get("status")

video_url = data.get("video_url")

if status == "completed":

print(f"Video {task_id} completed: {video_url}")

# Save to DB logic here

return jsonify({"status": "received"}), 200

return jsonify({"status": "unknown"}), 400Wettbewerbsvergleich

Funktionsmatrix

| Funktion | Wan 2.5 | Google Veo 3 | Kling 2.5 | Runway Gen-4 | Sora |

|---|---|---|---|---|---|

| Max. Dauer | 10 Sek | 60 Sek | 10 Sek | 15 Sek | 60 Sek |

| Audio-Sync | ✅ Nativ | ✅ Nativ | ❌ Stumm | ❌ Stumm | ✅ Nativ |

| Lip-Sync | (92%-95%) | (88%-91%) | N/A | N/A | ~90% |

| Verfügbarkeit | ✅ Öffentlich | ⚠️ Eingeschränkt | ✅ Öffentlich | ✅ Öffentlich | ❌ Preview |

| Kosten (10s/1080p) | $1.00–1.50 | $4.00–6.00 | $1.80–2.40 | $3.00–5.00 | TBD |

| Best For | Scaling/Apps | High-End Content | Physics/Realism | Film/Art | Future Potential |

-

Vs. Google Veo 3: Wan 2.5 ist ~50%-75% günstiger und sofort einfacher zugänglich, obwohl Veo 3 längere Laufzeiten unterstützt.

-

Vs. Kling 2.5: Wan 2.5 beinhaltet Audio/Lip-Sync; Kling in der Regel nicht, obwohl Kling bei komplexen Physiksimulationen einen Vorteil haben könnte.

-

Vs. Runway: Wan 2.5 eignet sich besser für Automatisierung und Skalierung; Runway bietet eine ausgereiftere Suite kreativer Tools.

Anwendungsfälle aus der Praxis

- E-Commerce-Showcases: Batch-Generierung von 360°-Produktvideos aus statischen Bildern (~$0.50/Video vs. $200+ für traditionelle Produktion).

- Social-Media-Automatisierung: Umwandlung von Blogbeiträgen oder Fotos in Inhalte im TikTok/Reels-Stil in großem Maßstab.

- Bildungsinhalte: Umwandlung von Lehrbuchabschnitten in animierte Kurzfilme mit Erzählung.

- Sprachenlernen: Generierung von „Talking Heads“ mit präziser Lippensynchronisation für Vokabel- und Aussprachetraining.

- SaaS-Demos: Automatische Generierung von Funktionsdemo-Videos mithilfe von Screenshots und Skripten.

Performance-Benchmarks

Generierungsgeschwindigkeit

| Auflösung | Durchschn. Zeit | Hinweis |

| :--- | :--- | :--- |

Audio-Sync-Qualität

-

Lip-Sync-Genauigkeit: 92%-95% (Branchendurchschnitt ~82%)

-

Audio-Visuelle Zeitkonsistenz: 97%-98%

-

Relevanz der Umgebungsgeräusche: 94%

Vor- & Nachteile der Wan 2.5 API

Vorteile ✅

-

Branchenführende AV-Sync: Reduziert die Nachbearbeitungsarbeit bei Audio erheblich.

-

Kostengünstig: ~50%-75% günstiger als High-End-Alternativen.

-

Multi-Plattform-Verfügbarkeit: Replicate.ai, Fal.ai, Evolink, etc., reduziert Vendor Lock-in.

-

Multimodale Fähigkeiten: Kombiniert Text-, Bild- und Audioeingaben effektiv.

-

Sprachunterstützung: Starke Unterstützung für Chinesisch und andere asiatische Sprachen neben Englisch.

Nachteile ❌

-

Dauerbegrenzung: Begrenzt auf 10 Sekunden pro Generierung; lange Videos erfordern Stitching.

-

Komplexe Physik: Flüssigkeitsdynamik oder extreme physikalische Szenarien können immer noch instabil sein.

-

Preview-Status: Unterliegt möglichen Breaking Changes in der Zukunft.

-

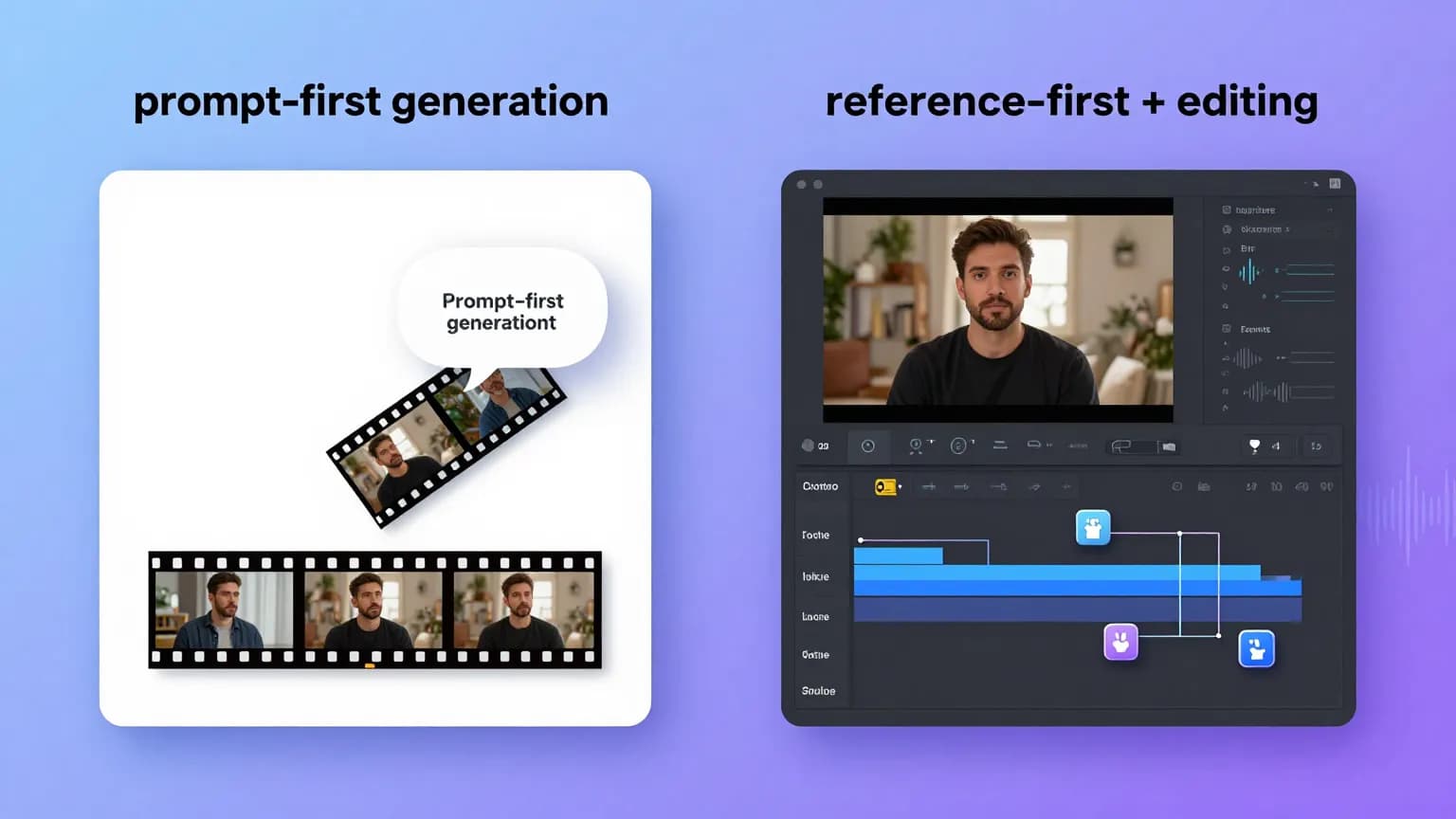

Keine Bearbeitungstools: Rein auf Generierung fokussiert; Zuschneiden/Spleißen erfordert Drittanbietertools.

Best Practices & Optimierung

-

Prompt-Struktur: Verwenden Sie „Subjekt + Aktion + Stil“.

- Beispiel: Subjekt: Ein eleganter Sportwagen. Aktion: Beschleunigung mit einer Tracking-Aufnahme. Stil: Cyberpunk Neon Nacht.

-

Auflösungsstrategie: Verwenden Sie 480p für A/B-Tests (günstiger) und generieren Sie die gewinnende Version dann in 1080p neu.

-

Dialog-Audio: Schreiben Sie Dialoge direkt in den Prompt, z.B. „A woman saying: 'Welcome'“.

-

Kamerasteuerung: Seien Sie spezifisch, aber nicht übermäßig komplex, z.B. „smooth dolly shot pushing forward“ (sanfte Dolly-Fahrt nach vorne).

-

Caching: Implementieren Sie Hash-Caching für identische Anfragen, um verschwendete Kosten für doppelte Generierungen zu vermeiden.

def generate_or_retrieve_cached(prompt, resolution):

cache_key = get_prompt_hash(prompt, resolution)

if db.exists(cache_key):

return db.get(cache_key)

return generate_text_to_video(prompt, resolution)