GPT Image 2와 Seedance 2.0 활용법: 스토리보드부터 숏폼 영상까지 팀이 두 모델을 함께 쓰는 이유

GPT Image 2와 Seedance 2.0 활용법

gpt-image-2**로 문서화되어 있습니다. ByteDance와 BytePlus는 Seedance 2.0을 텍스트, 이미지, 오디오, 영상 입력을 모두 지원하는 멀티모달 영상 모델로 공식 문서에 기재하고 있습니다. 이 조합의 핵심은 명확합니다. gpt-image-2는 프리프로덕션 단계의 시각적 구조 설계에 적합하고, Seedance 2.0은 모션, 타이밍, 시청각 연출에 적합합니다.요약

- 캐릭터 시트, 스토리보드 그리드, 키프레임, 타이틀 카드, 포스터 등 구조화된 시각 에셋이 필요할 때는 **

gpt-image-2**를 사용하세요. - 장면의 모습이 이미 결정되어 있고, 모션과 카메라 움직임, 숏폼 영상 출력이 필요할 때는 Seedance 2.0을 사용하세요.

- 하나의 모델에 모든 것을 맡기는 것보다, 두 모델을 조합하는 것이 대부분의 경우 더 좋은 결과를 냅니다.

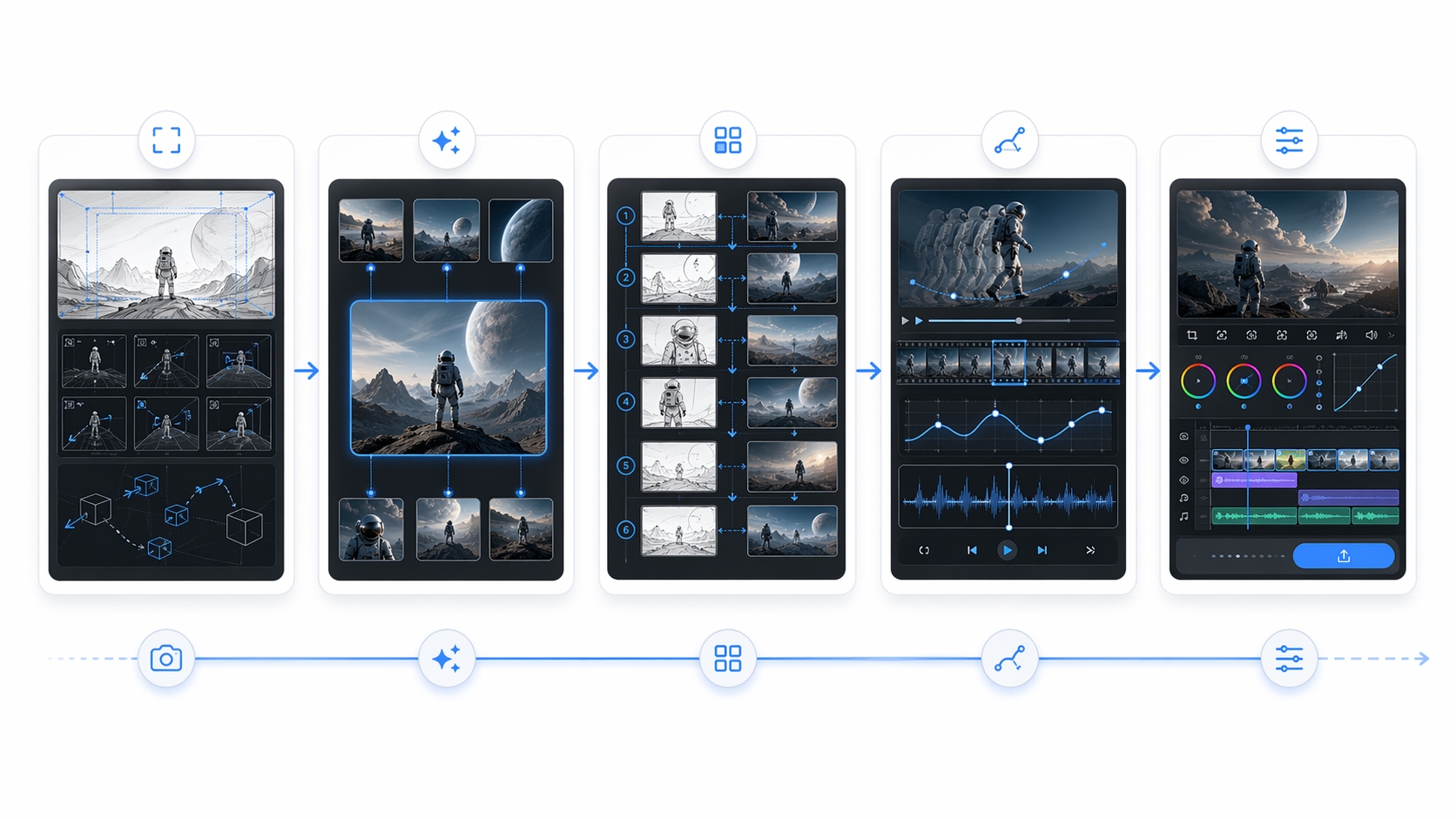

- 가장 흔한 워크플로우는 간단합니다: 촬영 구성 정의 -> 비주얼 앵커 생성 -> 스토리보드 또는 키프레임 제작 -> Seedance 2.0에서 애니메이션 -> 편집 단계에서 타이틀과 페이싱 마무리.

- 이 조합은 트레일러, 티저, 비주얼 내러티브, 제품 숏, 소셜 클립 제작에 특히 적합하며, 단순 토킹헤드나 단일 이미지 작업에는 과한 구성입니다.

각 모델이 실제로 잘하는 것

이 조합을 이해하는 가장 깔끔한 방법은 트렌드가 아니라 프로덕션 단계별로 나눠보는 것입니다.

| 단계 | GPT Image 2 (gpt-image-2) | Seedance 2.0 |

|---|---|---|

| 주요 역할 | 프리프로덕션 비주얼 디자인 | 모션 및 숏폼 영상 생성 |

| 최적 입력 | 텍스트 + 선택적 이미지 레퍼런스 | 텍스트, 이미지, 오디오, 영상 입력 |

| 최적 출력 | 캐릭터 시트, 스토리보드 페이지, 만화 스타일 패널, 포스터, 키프레임, 타이틀 카드 | image-to-video, 멀티모달 reference-to-video, 편집 지향 영상 워크플로우 |

| 최적 용도 | 시각적 구조와 일관성 확정 | 타이밍, 모션, 카메라 디렉션, 시청각 분위기 구현 |

| 공식 문서에 명시된 강점 | 빠르고 고품질의 이미지 생성 및 편집 | 이미지, 오디오, 영상 레퍼런스를 활용한 멀티모달 영상 생성 |

현재 풀어야 할 과제가 다음과 같다면:

- 캐릭터가 어떻게 생겨야 하는지

- 프레임에 무엇이 들어가야 하는지

- 시각 정보의 밀도를 어느 정도로 할지

- 애니메이션 전에 시퀀스를 어떻게 구성할지

GPT Image 2에서 시작하는 것이 대체로 더 효과적입니다.

현재 풀어야 할 과제가 다음과 같다면:

- 장면이 어떻게 움직여야 하는지

- 카메라가 어떻게 동작해야 하는지

- 클립이 비트별로 어떻게 전개되어야 하는지

- 시퀀스가 시간에 따라 어떤 느낌이어야 하는지

Seedance 2.0이 대체로 더 적합한 도구입니다.

하나의 모델로 다 하지 않고 두 모델을 조합하는 이유

1. 시각적 일관성을 더 이른 단계에서 확정할 수 있습니다

text-to-video 직접 생성도 짧은 실험에는 잘 작동하지만, 한 번에 너무 많은 것을 해결해야 합니다. 캐릭터 디자인, 구도, 모션, 장면 로직, 페이싱, 때로는 오디오까지 말이죠. 이런 초기 시각적 결정을 GPT Image 2에서 먼저 처리하면, 이후 영상 단계에서 편차가 발생할 가능성이 크게 줄어듭니다.

이것은 결과물이 단순히 "괜찮은 클립" 하나가 아니라, 반복 가능한 구조를 가진 작업일 때 특히 중요합니다:

- 트레일러

- 티저

- 소셜 광고

- 반복 등장하는 캐릭터가 있는 짧은 시퀀스

- 스타일이 통일된 비주얼 내러티브

2. 스토리 페이싱을 더 쉽게 제어할 수 있습니다

영상 모델에게 전체 시퀀스를 처음부터 만들어달라고 하는 대신, 워크플로우가 다음과 같이 바뀝니다:

- 촬영 구성을 결정한다

- 촬영 구성을 시각적으로 보여준다

- 촬영 구성을 애니메이션으로 만든다

이 방식은 하나의 거대한 프롬프트보다 디버깅이 훨씬 쉽습니다.

3. 텍스트와 레이아웃 중심 비주얼이 더 잘 유지됩니다

OpenAI는 GPT Image 2를 강력한 이미지 생성 및 편집 모델로 포지셔닝하고 있으며, ChatGPT Images 2.0 출시 자료에서도 구조화된 레이아웃, 다국어 텍스트 렌더링, 만화 페이지, 레퍼런스 시트, 편집 구성을 크게 강조하고 있습니다. 따라서 다음과 같은 에셋에 더 적합합니다:

- 타이틀 카드

- 포스터 스타일 레이아웃

- 만화 또는 만화(망가) 스타일 페이지

- 인터페이스형 비주얼

- 브랜드 요소가 포함되거나 정보 밀도가 높은 구성

이런 종류의 에셋은 모션 단계에서 직접 생성하려고 하면 깨지기 쉽습니다.

가장 많이 사용되는 워크플로우

이 조합은 보통 두 가지 패턴 중 하나로 나뉩니다.

| 워크플로우 | GPT Image 2에서 시작 | Seedance 2.0에서 마무리 | 적합한 작업 |

|---|---|---|---|

| 스토리보드 우선 | 3x3 스토리보드 그리드 또는 다중 패널 스토리 페이지 | 스토리보드를 image-to-video 또는 reference-driven 영상으로 애니메이션 | 트레일러, 티저, 숏폼 내러티브 클립 |

| 키프레임 우선 | 캐릭터 시트, 스타일 앵커, 4~6개 키프레임, 타이틀 카드 | 각 비주얼을 하나의 클립 또는 시퀀스로 애니메이션 | 제품 숏, 캐릭터 PV, 소셜 편집, 스타일 광고 |

실전 경량 프로세스

이 조합을 활용하기 위해 거대한 파이프라인이 필요하지 않습니다. 대부분의 팀에게는 5단계 워크플로우면 충분합니다.

1. 먼저 촬영 의도를 정의합니다

어느 모델에든 프롬프트를 작성하기 전에, 간단한 샷 리스트를 작성합니다:

Goal: 15-second teaser

Shot 1: establish subject and mood

Shot 2: close-up detail introduces tension

Shot 3: world or product context expands

Shot 4: movement or conflict appears

Shot 5: final reveal or title hold이 정도면 충분합니다. 목적은 프롬프트를 예술적으로 쓰는 것이 아닙니다. 이 클립이 전달해야 할 메시지를 결정하는 것입니다.

2. GPT Image 2로 캐릭터와 스타일 앵커를 확정합니다

시퀀스를 시도하기 전에 한두 개의 비주얼 앵커를 먼저 만듭니다:

- 캐릭터 시트 또는 제품 비주얼 앵커

- 색상, 조명, 소재에 대한 스타일 앵커

이 단계가 불안정하면, 이후 모션 단계의 결과는 대체로 나빠지지 좋아지지 않습니다.

3. 스토리보드 그리드 또는 키프레임 세트를 구성합니다

작업 부하에 맞는 더 가벼운 구조를 선택합니다:

- 전체 시퀀스를 하나의 이미지로 담고 싶다면 스토리보드 그리드

- 촬영 단위로 더 세밀한 제어가 필요하다면 키프레임 세트

4. Seedance 2.0에서 모션 작업을 진행합니다

480p와 720p 출력, 4초에서 15초까지의 길이를 지원합니다. 시각 디자인이 이미 확정된 상태에서 2단계 도구로 활용하기에 적합합니다.이 단계에서는 이미지 태그 나열 방식보다 연출 노트 형식으로 프롬프트를 작성하세요. 다음 사항에 집중합니다:

- 무엇이 움직이는지

- 카메라가 어떻게 움직이는지

- 비트가 언제 전환되는지

- 오디오 분위기가 어때야 하는지

5. 타이틀과 페이싱은 모션 단계 밖에서 마무리합니다

영상 모델이 아무리 뛰어나더라도, 다음 항목은 편집 도구에서 마무리하는 것이 대체로 더 안전합니다:

- 타이틀 처리

- 자막

- 페이싱 조정

- 엔드 카드

- 최종 패키징

생성 단계에 모든 작업을 한 번에 맡기기보다, 후반 작업으로 분리하는 것이 좋습니다.

자주 발생하는 실패 포인트

스토리보드 그리드가 영상의 오프닝 프레임으로 그대로 나타나는 경우

스토리보드 우선 워크플로우에서 흔히 발생하는 부작용입니다. 가장 쉬운 해결 방법은 편집 단계에서 첫 1초를 트리밍하거나, 오프닝 패널들의 비주얼을 서로 비슷하게 만들어 전환이 덜 급작스럽게 느껴지도록 하는 것입니다.

캐릭터 편차가 영상 단계 이전부터 시작되는 경우

이 문제는 Seedance 쪽 문제처럼 보이지만, 근본 원인은 대부분 더 앞 단계에 있습니다. 캐릭터 시트나 키프레임 세트가 안정적이지 않으면, 모션 단계가 그 불안정성을 그대로 이어받습니다. 해결 방법은 보통 영상 단계를 반복 재생성하는 것이 아니라, 이미지 앵커를 강화하는 것입니다.

타이틀과 로고가 모션에서 깨지는 경우

텍스트는 여전히 영상 생성에서 취약한 부분입니다. 타이틀이나 로고의 가독성이 중요하다면, 먼저 정적 에셋으로 별도 생성한 다음, 가볍게 애니메이션을 적용하거나 편집 단계에서 배치하세요.

이 조합이 가장 잘 맞는 경우

이 워크플로우는 모든 상황에 적합한 것은 아닙니다. 경량이라 하더라도 실질적인 프리프로덕션 단계가 있는 경우에 가장 효과적입니다.

| 잘 맞는 경우 | 맞지 않는 경우 |

|---|---|

| 트레일러, 티저 | 단일 이미지 작업 |

| 숏폼 비주얼 내러티브 | 순수 토킹헤드 생성 |

| 촬영 구조가 있는 소셜 광고 | 빠른 일회성 프롬프트 실험 |

| 레이아웃 기획이 필요한 제품 영상 | 시각적 일관성이 필요 없는 작업 |

| 캐릭터 중심 또는 스타일 중심 숏 | text-to-video 직접 생성으로 충분히 해결되는 경우 |

주된 작업이 "이미지 한 장 생성"이라면, GPT Image 2만 사용하면 됩니다.

주된 작업이 "프롬프트 하나로 빠르게 영상 클립 하나 생성"이라면, 이 추가 구조가 필요하지 않을 수 있습니다.

EvoLink에서의 활용

여기서 EvoLink의 역할은 이 워크플로우를 발명한 것이 아닙니다. 이미지 라우트와 영상 라우트가 동일한 작업 환경 안에 존재할 때 이 워크플로우의 운영이 훨씬 쉬워진다는 점입니다.

- 이미지 단계와 영상 단계를 동일한 모델 워크플로우 안에서 유지

- 기존 스택을 재구축하지 않고 라우트 동작 비교

- 하나의 모델 패밀리에 머물 때와 다른 모델로 넘길 때를 결정

FAQ

ChatGPT Images 2.0과 gpt-image-2는 같은 건가요?

gpt-image-2**는 API 문서에 기재된 모델명입니다.영상을 처음부터 바로 생성하면 안 되나요?

가능합니다. 오히려 그 방식이 더 빠를 때도 있습니다. 이 조합 워크플로우는 팀에서 캐릭터 일관성, 촬영 순서, 구조화된 시각 기획에 대한 제어가 더 필요할 때 유용해집니다.

스토리보드 그리드와 키프레임 중 어디서 시작해야 하나요?

이 워크플로우에서 GPT Image 2의 주요 역할은 무엇인가요?

활용 가능한 프리프로덕션 비주얼을 만드는 것입니다. 캐릭터 시트, 비주얼 앵커, 스토리보드 페이지, 키프레임, 타이틀 카드 등 구조화된 이미지 에셋이 이에 해당합니다.

이 워크플로우에서 Seedance 2.0의 주요 역할은 무엇인가요?

이러한 시각 에셋을 image-to-video 또는 멀티모달 레퍼런스 워크플로우를 통해 모션 중심 출력물로 변환하는 것입니다. 순수 정지 이미지 모델보다 더 명확한 카메라 및 타이밍 제어가 가능합니다.

타이틀과 로고를 영상 생성 단계에서 만들어도 되나요?

대부분의 경우 권장하지 않습니다. 가독성이 중요하다면, 해당 에셋을 별도로 생성한 뒤 나중에 추가하거나 애니메이션을 적용하는 것이 더 안전합니다.

이 조합이 적합하지 않은 경우는 언제인가요?

단일 정지 이미지, 단순 직접 영상 프롬프트, 또는 촬영 간 일관성이 크게 중요하지 않은 작업에는 보통 과한 구성입니다.

출처

- OpenAI, "Introducing ChatGPT Images 2.0" (April 21, 2026): https://openai.com/index/introducing-chatgpt-images-2-0/

- OpenAI API model page for

gpt-image-2: https://developers.openai.com/api/docs/models/gpt-image-2 - ByteDance Seedance 2.0 official page: https://seed.bytedance.com/en/seedance2_0

- BytePlus ModelArk Seedance 2.0 series tutorial: https://docs.byteplus.com/api/docs/ModelArk/2291680