マルチモデルAIアプリに統一APIレイヤーが必要な理由

TL;DR

マルチモデルAIアプリは、もはや珍しい構成ではありません。一つのプロダクトがチャット用モデル、コーディング支援用モデル、構造化データ抽出用モデル、そしてメディアワークフロー向けの画像・動画モデルを組み合わせることは日常的になっています。

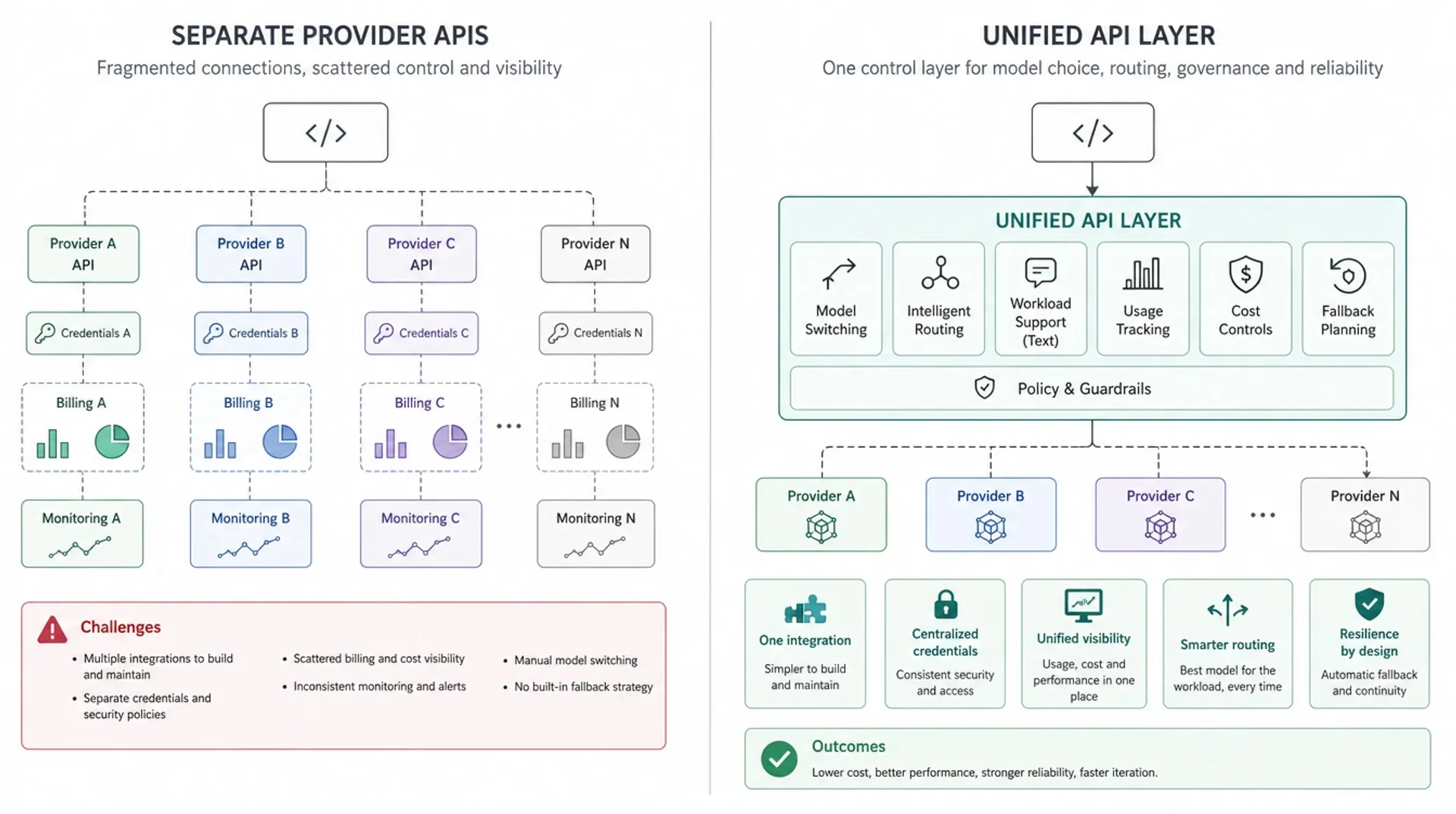

しかし、本当の難しさは複数のAPIを呼び出すことだけではありません。モデル選択、使用状況の追跡、課金、コストポリシー、フォールバック動作、本番運用を、モデル構成が変わるたびにコントロールし続けることこそが困難な点です。

統一APIレイヤーは、アプリケーションコードと対応AIモデルの間に一つのコントロールポイントを提供します。すべてのモデルの動作を均一にするものでもなければ、評価の必要性をなくすものでもありません。その価値はアーキテクチャ的なものです。プロダクトチームとインフラチームに、モデルアクセス、切り替え、ルーティング、可視性、運用ポリシーを管理するための安定した場所を提供するのです。

多くのチームが統一APIを採用する理由は、エンドポイントの数を減らしたいからではありません。マルチモデルアプリケーションには、いずれコントロールレイヤーが必要になるからです。

一度アプリが複数のモデルファミリーに依存すると、解くべき課題は「このモデルを呼び出せるか?」から「モデルスタックが変わるたびにプロダクトコードを書き直すことなく、モデル選択・使用状況・コスト・フォールバック・信頼性を運用できるか?」へと移行します。

マルチモデルアプリがデフォルトになりつつある

初期のAIプロダクトは、単一のモデルと単一のプロバイダーから始まることがほとんどでした。プロダクトの範囲がチャットボックス、要約ツール、サポートアシスタント、基本的なコンテンツ生成など狭い場合には、それで十分でした。

しかし、現在のAIアプリは異なります。一つのプロダクトに以下のような構成が含まれることがあります。

- 分類やリライト用の高速モデル

- 複雑なユーザー質問に対応する高性能推論モデル

- 開発者ワークフロー向けのコーディングモデル

- ドキュメント分析用のロングコンテキストモデル

- アセット生成・編集用の画像モデル

- クリエイティブ制作用の動画モデル

- プロバイダーが低速、利用不可、またはコスト過多な場合のフォールバックパス

この変化はアーキテクチャそのものを変えます。モデル選択は、一度きりのインテグレーション判断ではなく、機能、ユーザーティア、ワークロード種別、レイテンシ目標、予算に応じて変動する運用上の意思決定になります。

エージェントを構築するチームにとって、この圧力はさらに強くなります。エージェントのワークフローでは、意図の分類、コンテキストの取得、ステップの計画、ツールの呼び出し、結果の要約、最終レスポンスの生成が行われます。すべてのステップに同じモデルが必要なわけではありません。モデルの選択がすべてアプリケーションコードにハードコードされていると、プロダクトの進化がますます困難になります。

問題は「複数のAPIがある」ことだけではない

問題を「OpenAI、Anthropic、Google、そしていくつかの画像・動画プロバイダーと統合する必要がある」と表現したくなるかもしれません。しかし、それは表面的な部分にすぎません。

より深い問題は、運用上のドリフトです。

各プロバイダーは以下の点で異なる可能性があります。

- 認証とアカウント設定

- モデル識別子

- リクエストとレスポンスの形式

- ストリーミングの動作

- レート制限とリトライシグナル

- 使用状況のレポート

- 料金単位

- エラーセマンティクス

- 対応モダリティとパラメータ

- リリース頻度と非推奨化の挙動

二つのプロバイダーがOpenAI互換エンドポイントを公開している場合でも、本番システムではモデル固有の動作に対処する必要があります。「OpenAI互換」はオンボーディングの摩擦を軽減しますが、完全な運用上の契約として扱うべきではありません。

アーキテクチャの意思決定において重要な問いは「リクエストを送信できるか?」だけではありません。より適切な問いはこうです。

プロバイダー固有のロジックをコードベース全体に散在させることなく、アプリケーションがモデルを変更し、使用状況を追跡し、コストを管理し、障害に対処し、安定的に運用できるか?

ここに統一APIレイヤーの価値が生まれます。

よくある間違い:統一APIを単なるインテグレーションの近道と見なすこと

統一APIを評価する際のよくある間違いは、対応プロバイダー数だけで判断してしまうことです。これでは、より重要なアーキテクチャ上の問いを見落としてしまいます。

本当の問いは、そのAPIレイヤーが、モデル選択、使用状況の可視化、コストポリシー、フォールバック動作、本番運用を管理するための安定した基盤をチームに提供するかどうかです。

プロバイダーURLを隠すだけで、制御性、可視性、運用の一貫性が向上しないレイヤーは、インテグレーション作業を減らすだけで、マルチモデルの本質的な課題を解決しない可能性があります。

統一APIレイヤーは一つのコントロールポイントを生み出す

統一APIレイヤーは、アプリケーションとモデルプロバイダーまたはモデルルートの間に位置します。アプリケーションコードは統一レイヤーに対して通信し、レイヤーが各機能チームで重複すべきではない共通の関心事を処理します。

最もシンプルな形では、このレイヤーは以下を提供します。

- 一つのベースURL

- 一つの認証パターン

- 対応モデルを選択するための一つの場所

- 一つの使用状況・課金画面

- ルーティング、フォールバック、ポリシーを後から導入するための一つの拠点

より成熟した形では、これはより広範なAIデリバリーレイヤーの一部となり得ます。モデルアクセス、対応LLMリクエストのルーティングルール、使用状況の可視化、コスト管理、フォールバック計画、本番運用が、同一のAPIエントリポイントを中心に統合されます。

ただし、すべてのモデルが交換可能になるわけではありません。統一APIレイヤーは、品質、レイテンシ、モダリティ、コンテキストウィンドウ、ツール動作、料金の重要な違いを隠すべきではありません。良いアーキテクチャとは、これらの違いを評価可能な程度に可視化しつつ、アプリケーションコードの隅々にまで漏れ出すことを防ぐものです。

| 観点 | 個別プロバイダーAPI | 統一APIレイヤー |

|---|---|---|

| インテグレーション | プロバイダーごとに個別のセットアップ、認証情報、SDK選定、メンテナンスが必要 | 対応モデル向けの一つのインテグレーション基盤 |

| モデル切り替え | コード変更、新しいSDKパス、プロバイダー固有のアダプターが必要になることが多い | 通常はモデルまたはルートの選択判断で完結 |

| 使用状況の追跡 | 使用データがプロバイダーや内部ログに分散 | 使用状況を一つのレポート画面に正規化可能 |

| コスト管理 | チームが異なる課金ポータルや料金単位を横断して費用を比較 | コストポリシーをAPIレイヤー付近で管理可能 |

| フォールバック | サービスごとに独自のリトライやバックアップロジックを実装することが多い | フォールバック計画を適切な場所に集約可能 |

| 運用 | インシデント、制限、モデル変更がプロダクトコード全体に散在 | 運用管理がモデルデリバリーレイヤーに集約 |

統一APIレイヤーが可能にすること

アプリを書き直さずにモデルを切り替える

最初のメリットは明快です。モデル切り替えの影響範囲が小さくなります。

統一レイヤーがない場合、あるプロバイダーやモデルファミリーから別のものへ移行するには、新しい認証情報、SDK変更、リクエストマッピング、レスポンス解析、使用状況追跡の変更、新しい運用手順書が必要になることがあります。

統一APIレイヤーがあれば、アプリケーションはより安定したインテグレーション契約を維持しながら、その裏側でモデル選択を変更できます。出力品質が同一になるわけではありませんが、インテグレーションパスがボトルネックになりにくくなります。

例:

- サポートワークフローがバランス型モデルで開始される

- その後、大量の分類処理がより安価または高速なモデルに移行

- 複雑なエスカレーション案件がより強力な推論モデルに移行

- モデル構成が変わるたびに、AIインテグレーション全体を再構築する必要がない

ビジネス上の価値は「気軽にモデルを切り替える」ことではありません。モデル、価格、ワークロードのニーズが変化したときに、適応コストを削減できることにあります。

ワークロードに応じたルーティング

マルチモデルアプリには、多様なLLMワークロードが混在していることがよくあります。短いフォーマット変換、ロングコンテキストの分析、計画を要するエージェントのステップでは、同じモデルプロファイルは必要ありません。

統一APIレイヤーは、対応テキストワークロードに対してルーティングロジックを導入する自然な場所を提供します。

- シンプルなタスクを低レイテンシまたは低コストのモデルにルーティング

- 推論負荷の高いタスクをより強力なモデルにルーティング

- ベンチマーク済みまたは規制対象のワークフローには固定モデルを維持

- ルーティング使用時に実際に選択されたモデルを返し、チームが動作をログ記録・評価できるようにする

使用状況の可視化と課金の一貫性

アプリが複数のモデルを使用するようになると、使用状況の可視化はエンジニアリングの詳細ではなく、プロダクトやファイナンスの課題になります。

チームが答えなければならない問いは次のとおりです。

- どの機能がどのモデルを使用しているか?

- どの顧客セグメントがコストを牽引しているか?

- 高額なモデルがシンプルなタスクに使われていないか?

- モデル変更がレイテンシ、トークン使用量、またはエラー率を増加させていないか?

- 使用状況を機能、チーム、環境、またはAPIキー単位で帰属できるか?

プロバイダーごとのダッシュボードでは、各プロバイダーが使用状況を異なる形式で報告するため、これらの問いに答えるのが困難です。統一APIレイヤーは、対応モデル全体のリクエスト数、トークン数、タスク量、コストをより一貫した形で可視化できます。

この可視性がコスト管理の基盤です。使用データが分散していては、モデルの経済性を管理することはできません。

モデル横断のコスト管理

コスト管理は、コスト削減の保証とは異なります。統一APIレイヤーは、すべてのリクエストが安くなることを約束すべきではありません。

実務上の価値はコントロールにあります。

- タスク種別ごとにモデルを比較する

- シンプルな作業に高額モデルを過剰利用することを避ける

- APIキー、チーム、プロダクト単位で予算や上限を設定する

- モデル変更を使用状況と品質データに照らして評価する

- コストポリシーをアプリケーションコードに散在させず、プラットフォームレイヤー付近に集約する

本番環境で最大のコスト問題は、たいてい一つの高額リクエストではありません。変更する適切な場所がないために、何百万ものシンプルなリクエストに対して高額なデフォルトが静かに使われ続けることです。

フォールバックと信頼性の計画

本番AIシステムには、障害に対する計画が不可欠です。

- プロバイダーの障害

- クォータ枯渇

- レート制限

- レイテンシの悪化

- モデル固有のエラー

- モデルアップデート後の予期しない品質劣化

プロバイダー統合が個別になっている場合、フォールバックロジックはプロダクトサービス内に分散しがちです。あるチームは独自のリトライ方法を実装し、別のチームは異なるタイムアウトを使い、さらに別のチームにはバックアップパスがないといった具合です。

統一APIレイヤーは、フォールバック動作と運用ポリシーを定義するためのより適切な場所を提供します。アプリケーションロジックとプロバイダーの可用性判断を分離できます。

ただし、フォールバックには注意が必要です。バックアップモデルは、出力の挙動、コンテキスト制限、ツールサポート、料金が異なる場合があります。目的は盲目的な代替ではなく、代替を計画・テストできるコントロールされた場所を持つことです。

よりクリーンな本番運用

AIの利用が拡大するにつれて、モデルレイヤーにも他のインフラストラクチャと同等の運用規律が求められるようになります。

- ロギング

- 使用状況の帰属

- レイテンシの追跡

- エラーの分類

- アクセス制御

- モデル変更のレビュー

- インシデント対応

- 環境の分離

- 開発者向けドキュメント

各機能チームが独自のプロバイダー統合を保有していると、これらのプラクティスは一貫性を欠きます。統一APIレイヤーにより、モデル呼び出しの方法、監視、変更管理に関する共通の標準を定義しやすくなります。

「一つのAPI」という表現が誤解を招きやすいのはそのためです。本当のアーキテクチャ的価値は、単一のエンドポイントではなく、モデルデリバリーを運用するための一つの場所を持つことにあります。

シンプルな統一APIで十分なケース

主なニーズがインテグレーションの安定性である場合、シンプルな統一APIで十分です。

以下の場合はシンプルな統一APIレイヤーが適しています。

- 使用するモデル数が少ない

- 一つのAPIキーと一つのリクエストパターンで運用したい

- モデル選択がほぼ明示的

- トラフィック量が管理可能な範囲

- フォールバック要件が限定的

- チームの主な目的がインテグレーションのオーバーヘッド削減

例えば、スタートアップがユーザーチャットに一つのモデル、社内要約に一つのモデル、コンテンツ生成に一つの画像モデルを使用する場合があります。ダイナミックルーティングや高度なガバナンスがまだ必要でなければ、最初の成果は安定した共通インテグレーションレイヤーです。

この段階でも十分な価値があります。チームが自分たちの実際のワークロードを理解する前に、三つの異なるインテグレーションスタックが増殖することを防げるからです。

より高度なゲートウェイやルーティングレイヤーが必要なケース

統一APIレイヤーがアクセス提供以上のことを求められるとき、より高度なゲートウェイの必要性が生まれます。

以下のような状況では、ルーティング、ゲートウェイ制御、またはマネージドなモデルデリバリーレイヤーが必要になる可能性があります。

- リクエスト量が多く、モデル選択がマージンに影響する

- ワークロードの複雑さが大きく異なる

- 信頼性要件が明示的

- 複数のチームやサービスがモデル呼び出しに依存している

- 使用状況をプロダクト、顧客、チーム別に帰属させる必要がある

- フォールバック動作のテストとドキュメント化が必要

- モデル変更にアドホックな編集ではなくレビューが必要

| シナリオ | おそらく必要なもの | 理由 |

|---|---|---|

| プロトタイプで一つのモデルをテスト | ダイレクトAPIまたはシンプルな統一API | プラットフォーム制御よりもスピードが重要 |

| 一つのプロダクトで2〜3モデルを使用 | シンプルな統一APIレイヤー | 一つのインテグレーション基盤でプロバイダー固有のグルーコードを削減 |

| 大規模本番ワークロードの運用 | 統一API + コスト・使用状況管理 | コスト、レイテンシ、使用状況の帰属が重要に |

| 多様なタスクを持つエージェントの構築 | 統一API + 対応テキストワークロード向けルーティング | エージェントの各ステップで異なるモデルプロファイルが必要な場合がある |

| プロバイダー横断での信頼性管理 | ゲートウェイまたはフォールバック計画付きルーティングレイヤー | 障害処理を各サービスで重複させるべきではない |

EvoLinkとの対応関係

EvoLinkは、このモデルデリバリーパターンを中心に構築されています。対応モデル向けの一つのAPIエントリポイントと、アクセス、コストの可視化、テキストワークロードのルーティング、運用管理にまたがるプラットフォーム機能を備えています。

各モデル統合を個別プロジェクトとして扱う代わりに、チームはEvoLinkを対応モデルファミリー全体の共有モデルデリバリーレイヤーとして活用できます。

このポジショニングが重要なのは、EvoLinkが単なるモデルリストではないからです。長期的なアーキテクチャは、AIモデルデリバリーインフラストラクチャに近い形です。

- 統一アクセス: プロバイダーやモデルファミリーごとにアクセスを再構築する代わりに、対応モデル向けの一つのインテグレーションパスを使用できます。

- コスト管理: モデル選択の比較、料金の確認を行い、コストポリシーがアプリケーションコードの後回しにならないようにします。

- 呼び出し制御: モデル選択、対応LLMリクエストのルーティング判断、APIキー、使用制限をプラットフォームレイヤー付近に集約します。

- 本番レディネス: モデル呼び出しを、可視性、フォールバック計画、安定したインテグレーションプラクティスが求められる運用トラフィックとして扱います。

重要な境界線は次のとおりです。統一APIレイヤーはモデルデリバリーの運用を容易にしますが、すべてのモデルが同一の動作をするかのように装うべきではありません。チームには引き続き、評価、ロギング、コストレビュー、ワークフロー固有のQAが必要です。

判断チェックリスト

アプリに統一APIレイヤー、ゲートウェイ、またはプロバイダー直接呼び出しのどれが必要かを判断する前に、このチェックリストを活用してください。

- 現在、複数のモデルファミリーを使用していますか?

- 将来、画像、動画、音声、コーディング、ロングコンテキストモデルを追加する予定はありますか?

- 複数箇所のアプリケーションコードを変更せずにモデルを切り替えられますか?

- 使用状況を機能、チーム、顧客、APIキー別に確認できますか?

- 一つのワークフロー内でモデル間のコストを比較できますか?

- 各本番リクエストにどのモデルが使われたか把握していますか?

- レート制限、プロバイダー障害、レイテンシ悪化に対するフォールバック計画がありますか?

- リトライとタイムアウトの動作がサービス間で一貫していますか?

- 開発者が一つのドキュメント化されたモデルアクセスパターンを利用できますか?

- モデル選択が単なるコード変更ではなく、運用上の意思決定としてレビューされていますか?

大半の答えが「いいえ」であれば、問題は単なるインテグレーションの利便性にとどまりません。モデルレイヤーが本番インフラストラクチャの一部になりつつあるということです。

FAQ

AIモデル向け統一APIとは何ですか?

AIモデル向け統一APIとは、アプリケーションが一貫したAPIエントリポイントを通じて対応モデルを呼び出せるようにする一つのインテグレーションレイヤーです。プロバイダーセットアップの重複を削減し、モデルアクセス、使用状況の可視化、課金、コスト管理、ルーティング、運用ポリシーの共通基盤を提供できます。

統一APIとLLMゲートウェイは同じものですか?

必ずしも同じではありません。シンプルな統一APIは、複数モデルへの一つのアクセス基盤を提供するだけの場合があります。LLMゲートウェイは通常、ルーティング、フォールバック、オブザーバビリティ、ポリシー制御、レート制限、ガバナンスなど、より多くのインフラストラクチャ機能を備えています。実際には、多くのチームが統一アクセスから始めて、本番要件の拡大に伴いゲートウェイへと移行しています。

モデルを一つしか使っていない場合でも統一APIは必要ですか?

通常は必要ありません。プロダクトが一つのモデルを使用し、トラフィックが少なく、フォールバックやマルチプロバイダーの可視化が不要であれば、直接APIアクセスの方がシンプルです。統一APIは、モデル選択、コスト管理、信頼性計画が継続的な業務になると予想される場合に、より有用になります。

統一APIはモデルルーティングにどう役立ちますか?

ルーティングには、モデル選択の判断を行う安定した場所が必要です。統一APIレイヤーがアプリケーションに一つのリクエストパスを提供し、ルーティングロジックがタスク種別、レイテンシ要件、コストプロファイル、その他のシグナルに基づいてモデルを選択します。本番利用においては、ルーティングはどのモデルが選択されたかも公開すべきです。これにより、チームが動作をログ記録、評価、デバッグできるようになります。

統一APIですべてのモデルの動作が同じになりますか?

いいえ。統一APIは、アクセス、認証、リクエスト形式、使用状況レポート、ルーティングポリシーの一部を正規化できますが、モデルの品質、レイテンシ、コンテキスト制限、ツール動作、モダリティ対応、料金を同一にするものではありません。チームは引き続き、自分たちのワークフローに対して各モデルをテストすべきです。