2026年中国春節聯歓晩会が明らかにしたByteDanceのAI動画スタック

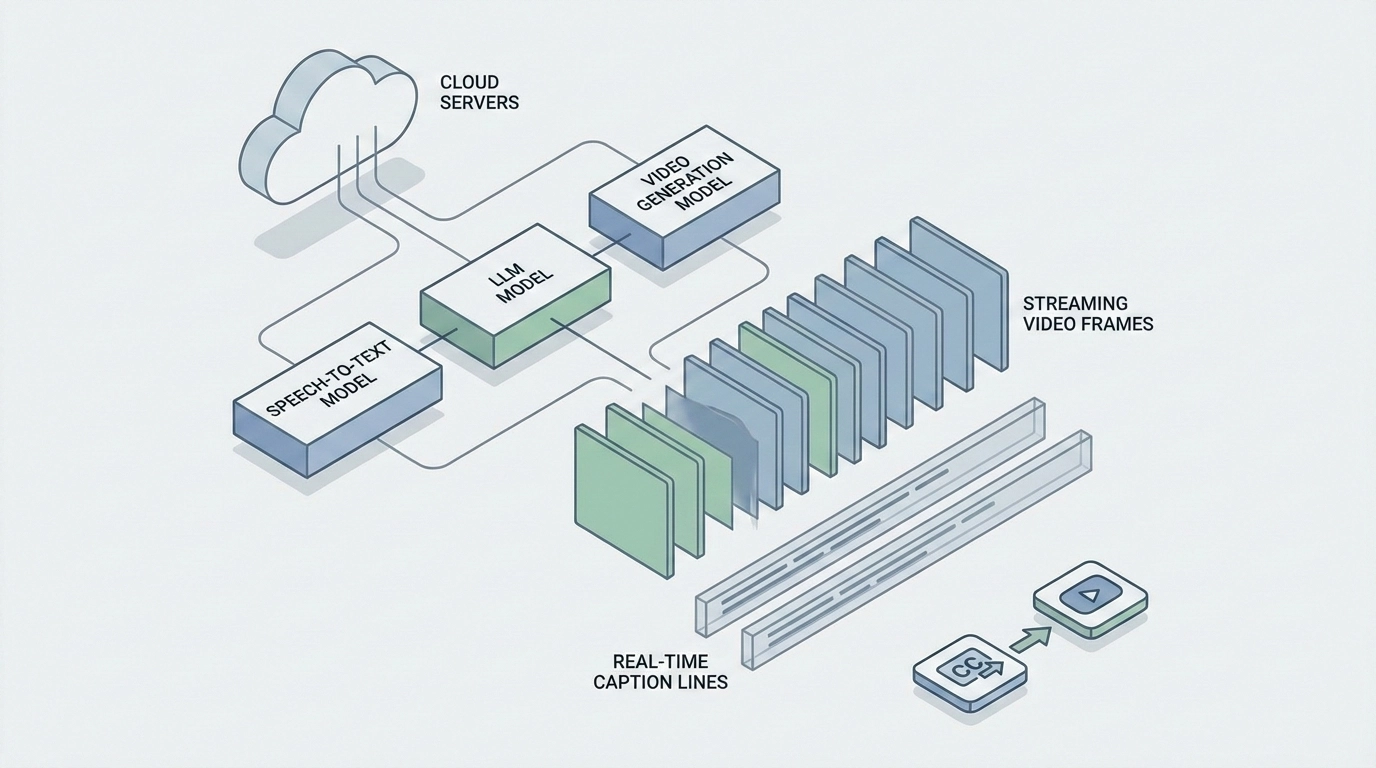

この晩会は、ByteDanceが複数のAIレイヤーをどのように連携させて位置付けているかを示しました:

- 動画生成

- 言語とインタラクション

- ライブ制作インフラ

なぜ春節聯歓晩会が重要だったか

| シグナル | 重要な理由 |

|---|---|

| AIが主流の全国放送で可視化された | ラボデモを超えた議論に発展 |

| 複数のByteDance AIサーフェスが同時に登場 | 孤立した実験ではなく、協調的な製品スタックを示唆 |

| 文脈がライブ、高プレッシャー、パブリックだった | プロダクショングレードのデプロイメントへの自信を示唆 |

| 検証済みの大規模リーチ | CMGは全メディアライブリーチ6.77億人を報告、ピーク同時視聴者数は4億人を超過 |

Seedance 2.0:何を象徴していたか

最も興味深いSeedanceの側面は、AI生成ビジュアルが大規模放送に登場したこと自体ではありません。

これが重要なのは、Seedance 2.0を目新しいジェネレーターとして考えるのをやめ、以下のためのツールとして考え始めると理解しやすくなるからです:

- ビジュアルディレクション

- 構造化されたモーション

- シーンの造形

- 大規模なスタイライズされたスペクタクル

春節聯歓晩会の文脈は、まさにそのポジショニングを強化しました。

最も注目されたAIの瞬間は「賀花神」(《贺花神》)でした。AI生成による花の開花、流れる水、季節の移り変わりのビジュアルがライブパフォーマーとシームレスに融合したダンスパフォーマンスです。技術的に重要だった点:

- クローズアップショットにはピクセルパーフェクトな生成が求められた。わずかなジッターや歪みでも数億人の視聴者に見えてしまう

- 花がゆっくり咲くような微小な変化には、テクスチャ、レイヤー、光、影にわたる精密な時間的制御が必要だった

- ByteDanceはこれを「AI生成コンテンツ」から「AIディレクテッドコンテンツ」への転換と表現した

Doubaoと広範なByteDanceスタック

Seedanceは1つのレイヤーに過ぎませんでした。

| レイヤー | 春節聯歓晩会が示唆したこと |

|---|---|

| 動画生成 | Seedanceスタイルのビジュアル制作とシーンサポート |

| 言語/インタラクション | Doubaoスタイルの推論とコミュニケーションサーフェス |

| インフラ | パブリック規模のイベントを支える能力を持つクラウドと制作レイヤー |

デプロイメントの規模は重要でした:

- Volcengineプラットフォーム全体で日次8000億以上のトークンを処理

- 100以上の業界にわたる100万以上の企業がVolcengine AIサービスを利用

この組み合わせは戦略的に重要です。ByteDanceが孤立したモデル品質だけを追求しているのではなく、異なるAIコンポーネントが互いを強化するエコシステムを構築していることを示唆しています。

なぜ単一のパフォーマンスを超えて重要だったか

春節聯歓晩会のようなイベントが重要なのは、認識を変えるからです。

このような公開放送の前は、多くのモデル議論は以下の範囲に留まっていました:

- ベンチマーク

- SNSのデモ

- 開発者コミュニティ

このような放送の後は、議論は以下に変わります:

- これらのシステムは実際の制作を支えられるか?

- プレッシャーとスケールに耐えられるか?

- AI生成メディアは主流のクリエイティブパイプラインの一部になれるか?

それがこの春節聯歓晩会が象徴した転換です。

目に見えるレイヤー:ロボティクス

ロボットは、より深いAIスタックの目に見えるレイヤーでした。4つのロボティクス企業がパフォーマンスを披露しました:

- Unitree G1ロボットがカンフーのバク宙を披露

- Noetix Bumiロボットがベテラン女優の蔡明とコメディスケッチを演じ、32個の顔面モーターを備えたリアルなバイオニックロボットダブルを登場させた

- MagicLab ロボットが「We Are Made in China」に合わせてダンス

- Galbot が追加のロボットパフォーマンスに貢献

Doubaoの言語モデルなくして、ロボットは人間のパフォーマーとインタラクションできませんでした。Seedanceなくして、ビジュアルスペクタクルは存在しませんでした。Volcengineのインフラなくして、リアルタイムインタラクションは負荷に耐えきれず崩壊していたでしょう。

春節聯歓晩会がByteDanceの戦略について示唆したこと

最も明確な戦略的読み取りは、ByteDanceが1つ以上のAIカテゴリで真剣に受け止められたいと考えていることです。

このイベントは以下を中心とした製品ストーリーを示唆しました:

- メディア生成

- アシスタントスタイルのインテリジェンス

- インフラサポート

- 高い可視性を持つコンシューマーおよびエンタープライズの関連性

これは「良い動画モデルがある」よりもはるかに大きな野心です。

開発者と製品チームが注目すべき理由

たとえ春節聯歓晩会規模のイベントを構築することがなくても、これが重要なのは、ByteDanceがそのAIスタックをより広い市場でどのように認識されたいかを示唆しているからです。

開発者と製品チームにとって、ここからの教訓は「春節聯歓晩会をコピーする」ではありません。

以下です:

ByteDanceは、AIプロダクトを、切り離されたツールではなく、1つのスタックの部品として位置付けようとしている。

これは、チームが同社の将来のモデルローンチ、エコシステムの変化、プラットフォーム決定をどう解釈すべきかに影響します。

API経由でアクセス可能な中国AIモデル

春節聯歓晩会の技術を支えた、または関連する多くのモデルがAPI経由でアクセス可能です:

| モデル | タイプ | 春節聯歓晩会との関連 |

|---|---|---|

| Seedance | 動画生成 | 春節聯歓晩会のビジュアルエフェクトを生成 |

| Seedream | 画像生成 | ByteDanceの画像モデル(Seedance 2.0と同時にアップデート) |

| Kling | 動画生成 | Kuaishouのテキストから動画への主力システム |

| Wan 2.6 | 動画生成 | Alibabaの動画生成モデル |

| DeepSeek | 言語モデル | 中国を代表するオープンソース推論モデル |

| Doubao | 言語モデル | 春節聯歓晩会のAIインタラクションの頭脳 |

なぜこれがEvoLinkで重要なのか

EvoLinkにとって、このようなストーリーの価値はByteDanceを宣伝することではありません。

チームが1か所からモデルファミリーを比較・ルーティングする理由を与えることです:

- ByteDanceファミリーの動画ルート

- 他の中国動画モデル

- ByteDance以外の代替案

最終的な見解

2026年春節聯歓晩会は、AI装飾付きの文化イベントではありませんでした。

ByteDanceがそのAIスタックをどのようにフレーム化したいかの、高い可視性を持つデモンストレーションでした:

- ビジュアル生成のためのSeedance

- インテリジェンスとインタラクションのためのDoubao

- パブリック規模デプロイメントのためのより広いインフラレイヤー

だからこそ春節聯歓晩会は重要でした。ByteDanceのAIストーリーを、製品ページの集合から、可視的なエコシステムナラティブへと変えたのです。

FAQ

なぜSeedance 2.0が春節聯歓晩会のストーリーに関連していたのですか?

イベントがAI生成のビジュアルスペクタクルを強調したためです。これはSeedance 2.0のByteDanceスタック内の動画生成レイヤーとしての広範なポジショニングに合致しています。

春節聯歓晩会は主にロボットの話でしたか?

いいえ。より重要な読み取りは、メディア、インタラクション、制作インフラにわたって機能するより広範なAIスタックを披露したことです。

この文脈でDoubaoが重要な理由は?

ByteDanceの広範なAI戦略における言語およびインタラクションレイヤーを代表しているからです。

春節聯歓晩会はByteDanceのAIの方向性について何を示唆しましたか?

ByteDanceが孤立したポイントモデルではなく、統合されたAIエコシステムを構築していると認識されたいことを示唆しました。

開発者がこのようなテレビイベントに注目すべき理由は?

大規模な公開イベントは、通常のデモでは不可能な規模で製品の野心、ポジショニング、本番環境準備への自信を明らかにできるからです。

この記事はAPIアクセスを説明していますか?

いいえ。本記事はイベントの市場的意味についてであり、アクセスや価格についてではありません。