OpenRouter vs liteLLM vs Build vs Managed: elección de una estrategia de abstracción de LLM

OpenRouter frente a liteLLM frente a compilación frente a administrado

A medida que crece el uso de LLM, muchos equipos llegan al mismo punto de inflexión:

"Las API directas ya no son suficientes, pero ¿qué debería haber entre medio?"

En esa etapa, la pregunta rara vez es si se debe introducir una capa de abstracción.La verdadera pregunta es qué estrategia de abstracción se ajusta a sus limitaciones.

Este artículo compara cuatro enfoques comunes:

- OpenRouter

- liteLLM

- Construcción de una puerta de enlace interna

- Usando una puerta de enlace administrada

El objetivo no es clasificar las herramientas, sino aclarar límites, compensaciones y criterios de decisión.

Los cuatro enfoques, claramente definidos

Antes de comparar, es útil definir qué representa realmente cada opción.

OpenRouter

Una capa de enrutamiento alojada que agrega acceso a muchos proveedores de LLM detrás de una superficie API unificada.

Los equipos suelen utilizarlo para:

- Acceda a múltiples modelos rápidamente

- Evite gestionar contratos de proveedores individuales

- Experimente con proveedores con una configuración mínima

ligeroLLM

Un proxy de código abierto que los equipos implementan y operan ellos mismos.

A menudo se utiliza para:

- Normalizar esquemas API

- Implementar enrutamiento básico o respaldo

- Mantener el control sobre la infraestructura y las rutas de datos.

Construir (puerta de enlace interna)

Una capa de abstracción personalizada diseñada, propiedad y operada por el equipo.

Las motivaciones comunes incluyen:

- Control total sobre el comportamiento y los contratos.

- Profunda integración con sistemas internos.

- Confiabilidad personalizada, política o lógica de costos

Puerta de enlace administrada

Una capa de abstracción alojada operada por un tercero.

Los equipos suelen elegir esto cuando:

- La propiedad de la infraestructura no es una competencia central

- Fiabilidad, observabilidad y gobernanza.

- El tiempo de producción es fundamental

Para qué se optimizan estas opciones

Cada enfoque optimiza diferentes restricciones, no diferentes niveles de "calidad".

- Velocidad de acceso a muchos modelos.

- Bajos gastos operativos

- Experimentación y amplitud.

- Control sobre el despliegue

- Flexibilidad de código abierto

- Flujos de trabajo de infraestructura de bricolaje

- Máxima personalización

- Estrecha integración con los sistemas internos.

- Control explícito sobre contratos y comportamiento.

- Reducción de la carga operativa

- Fiabilidad y observabilidad a nivel de producción

- Límites de abstracción claros

Comprender qué optimiza cada opción es más importante que las listas de verificación de funciones.

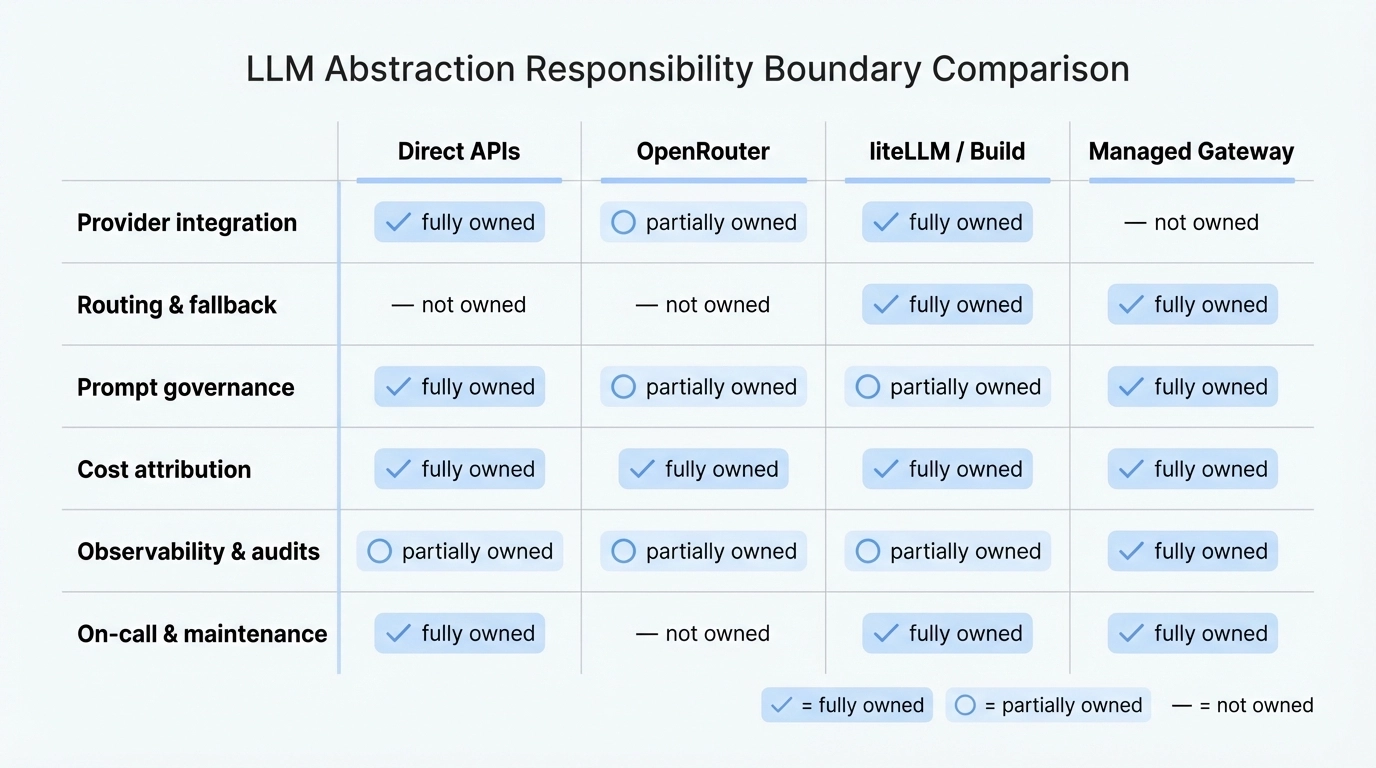

Una comparación práctica

| Dimensión | OpenRouter | liteLLM | Construir | Gestionado |

|---|---|---|---|---|

| Velocidad de configuración | Muy rápido | Moderado | Lento | Rápido |

| Propiedad operativa | Externo | Interno | Interno | Externo |

| Comportamiento personalizado | Limitado | Moderado | Completo | Moderado-alto |

| Observabilidad y auditorías | Definido por plataforma | Bricolaje | Bricolaje | Incorporado |

| Escalado de varios equipos | Moderado | Difícil | Difícil | Más fácil |

| Mantenimiento a largo plazo | Bajo | En curso | Alto | Bajo-Moderado |

Cuando cada opción tiende a tener sentido

OpenRouter suele ser una buena opción cuando:

-

Necesita acceso amplio a los modelos rápidamente

-

Quiere minimizar la inversión en infraestructura.

-

El uso es exploratorio o no crítico.

-

Se espera una rotación de proveedores

liteLLM se elige a menudo cuando:

-

Quieres control de código abierto

-

Te sientes cómodo corriendo infraestructura

-

Los requisitos aún están evolucionando

-

La gobernanza y la observabilidad son secundarias.

Construir tiene sentido cuando:

-

Los LLM son fundamentales para su producto

-

Los contratos, políticas y SLA no son negociables.

-

Tienes experiencia en infraestructura y horizontes a largo plazo.

-

La abstracción en sí misma es una ventaja competitiva.

Las puertas de enlace administradas tienden a funcionar cuando:

-

Cuestión de fiabilidad y auditabilidad.

-

Varios equipos dependen de los LLM

-

Quiere garantías operativas claras

-

Prefiere comprar infraestructura a dotarla de personal.

Los costos ocultos que los equipos suelen pasar por alto

La mayoría de los equipos se centran en la compatibilidad de API.Subestiman los costos organizativos y operativos.

Los factores que comúnmente se pasan por alto incluyen:

-

Propiedad de guardia para la capa de abstracción.

-

Depuración de errores entre proveedores

-

Mantener líneas base de evaluación para decisiones de enrutamiento.

-

Alinear los cambios de políticas entre los equipos.

-

Mantener la atribución de costos precisa a lo largo del tiempo.

Estos costos tienden a surgir después de que se introduce la abstracción, no antes.

Una lista de verificación de decisiones

Si responde "sí" a varias de las siguientes preguntas, su elección importa más que la herramienta en sí:

-

[] ¿Dependen varios equipos de la capa de abstracción?

-

¿Se están volviendo explícitas las garantías de confiabilidad?

-

¿Las políticas o los cambios rápidos requieren coordinación?

-

¿Es necesaria la atribución de costos más allá del gasto total?

-

¿Las fallas afectarían los flujos de usuarios críticos? De lo contrario, las opciones más ligeras pueden seguir siendo suficientes.

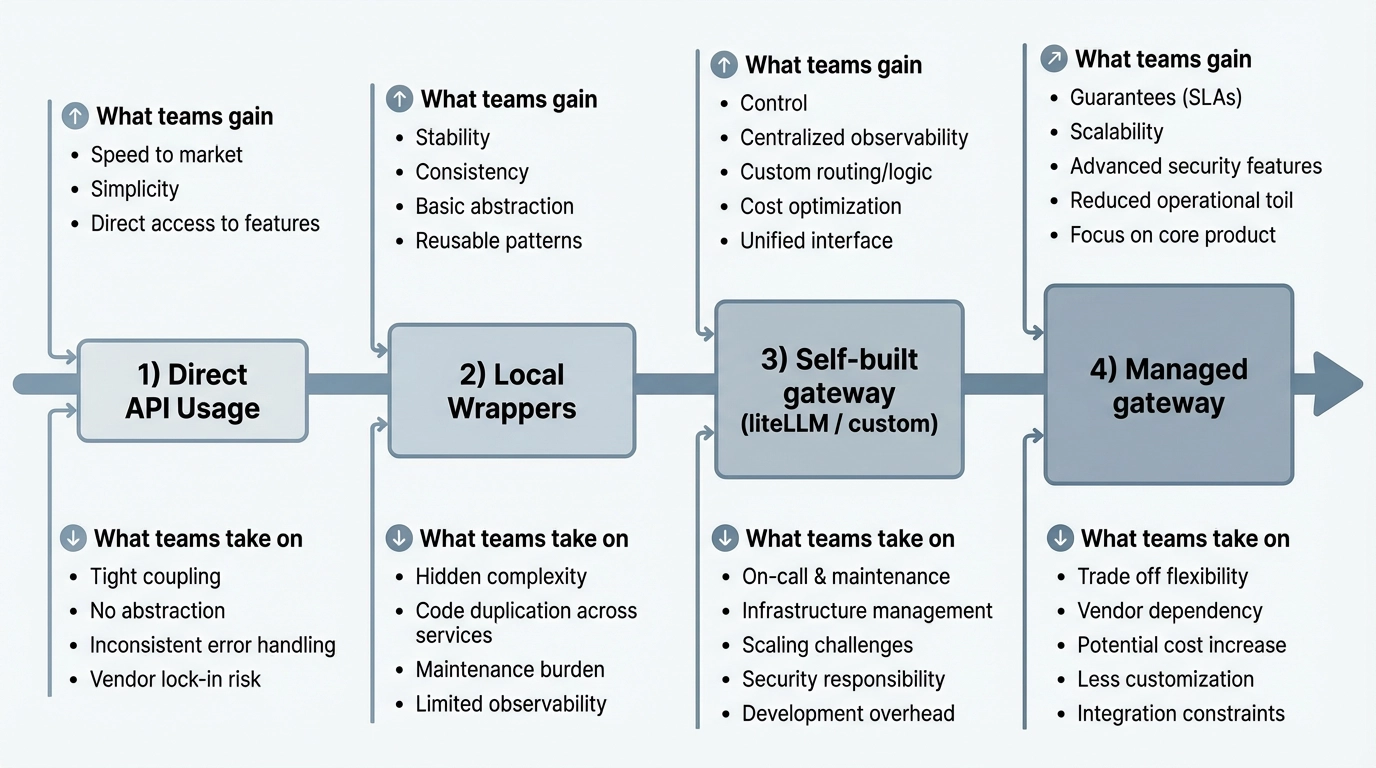

Cómo encaja esto en el camino más amplio de la arquitectura

En la práctica, los equipos suelen pasar por estas etapas:

-

API directas

-

Envoltorios locales

-

Abstracción centralizada

-

Estrategia de puerta de enlace explícita La transición no se trata sólo de escala.Se trata de costos de coordinación y tolerancia al riesgo.

Diferentes equipos se detienen en diferentes puntos, y eso es lo que se espera.

En la práctica: cómo se ve el “acceso al modelo a través de una abstracción”

En la práctica, la elección de la abstracción determina cómo el código de la aplicación hace referencia a los modelos:

-

ya sea vinculando directamente a identificadores específicos del proveedor, o

-

a través de una capa de nomenclatura interna estable (por ejemplo, LLM de propósito general, LLM de contexto largo), que se asigna a modelos concretos detrás de escena. Para ver un ejemplo concreto de cómo se ve una página de "referencia de modelo" en este patrón:

-

Ejemplo de referencia de modelo: GPT-5.2 página de modelo

Pensamiento final

No existe una estrategia de abstracción universalmente "correcta".

Cada opción representa un equilibrio entre control, velocidad y responsabilidad.El verdadero error es elegir basándose en las características de la superficie en lugar de comprender:

-

¿Qué complejidad estás asumiendo?

-

¿Qué garantías esperas?

-

¿Quién será dueño de las consecuencias? La intención clara importa más que la herramienta específica.

👉 Siguiente paso

Esta guía desglosa cuándo las API directas todavía funcionan y cuándo una puerta de enlace comienza a pagarse por sí sola.

→ API de Gateway vs Direct LLM: cuando cada una tiene sentido

Preguntas frecuentes

¿OpenRouter es una puerta de enlace o simplemente un enrutador?

Funciona como una capa de enrutamiento alojada, optimizada para el acceso y la amplitud en lugar de una gobernanza organizacional profunda.

¿Es liteLLM suficiente para la producción?

Puede serlo, dependiendo de cuánta infraestructura, observabilidad y disciplina operativa esté dispuesto a proporcionar un equipo.

¿Por qué no construir siempre internamente?

La construcción ofrece control, pero también genera costos de personal y mantenimiento a largo plazo que muchos equipos subestiman.

¿Cuándo tiene sentido una puerta de enlace administrada?

Cuando la abstracción se haya convertido en infraestructura, y la confiabilidad y la gobernanza superen el deseo de control total.