GPT-5.4 vs Claude Opus 4.6 vs Gemini 3.1 Pro: ¿Qué modelo insignia gana en 2026?

Última actualización: 6 de marzo de 2026 · Precios verificados en marzo de 2026

Claude Opus 4.6 lidera la calidad de código según resultados públicos de los proveedores, Gemini 3.1 Pro ofrece 1M de contexto a $2/1M de entrada (fuente: precios en ai.google.dev) y GPT-5.4 ya está listado en OpenRouter con $2.50/$20, 1M de contexto y 128K de salida máxima. Si debes elegir hoy, Gemini 3.1 Pro sigue siendo el mejor valor para la mayoría de cargas; Opus 4.6 sigue siendo fuerte para código complejo y agentes; GPT-5.4 conviene evaluarlo en paralelo por routing.

Aquí tienes el desglose completo.

TL;DR

- Gemini 3.1 Pro es el rey precio/rendimiento: $2.00/$12.00 por 1M tokens, 1M de contexto y 80.6% en SWE-bench.

- Claude Opus 4.6 gana en calidad de código: 80.8% SWE-bench (tabla single-attempt) y 81.42% con prompt modification, 128K de salida y Agent Teams; pero >200K tokens usan precio premium ($10/$37.50 por 1M).

- GPT-5.4 ya está listado en OpenRouter: $2.50/$20 por 1M tokens, $0.625 de entrada en caché, 1M de contexto y 128K de salida máxima. La cobertura de benchmarks independientes aún es limitada.

- Para equipos con presupuesto ajustado: GPT-5.2 sigue siendo fuerte con $1.75/$14 por 1M, 400K de contexto y 80.0% en SWE-bench.

- No bloquees entrega por GPT-5.4: construye con Gemini 3.1 Pro u Opus 4.6 y evalúa GPT-5.4 en paralelo.

Tabla rápida

Cada celda está trazada a una fuente primaria. Precios a marzo de 2026.

| Claude Opus 4.6 | Gemini 3.1 Pro | GPT-5.4 (OpenRouter) | GPT-5.2 | |

|---|---|---|---|---|

| Proveedor | Anthropic | Google DeepMind | OpenAI | OpenAI |

| Estado | ✅ Disponible | ✅ Disponible | ✅ Disponible vía OpenRouter | ✅ Disponible |

| Contexto | 200K (1M beta, tier 4/custom limits) | 1M | 1M | 400K |

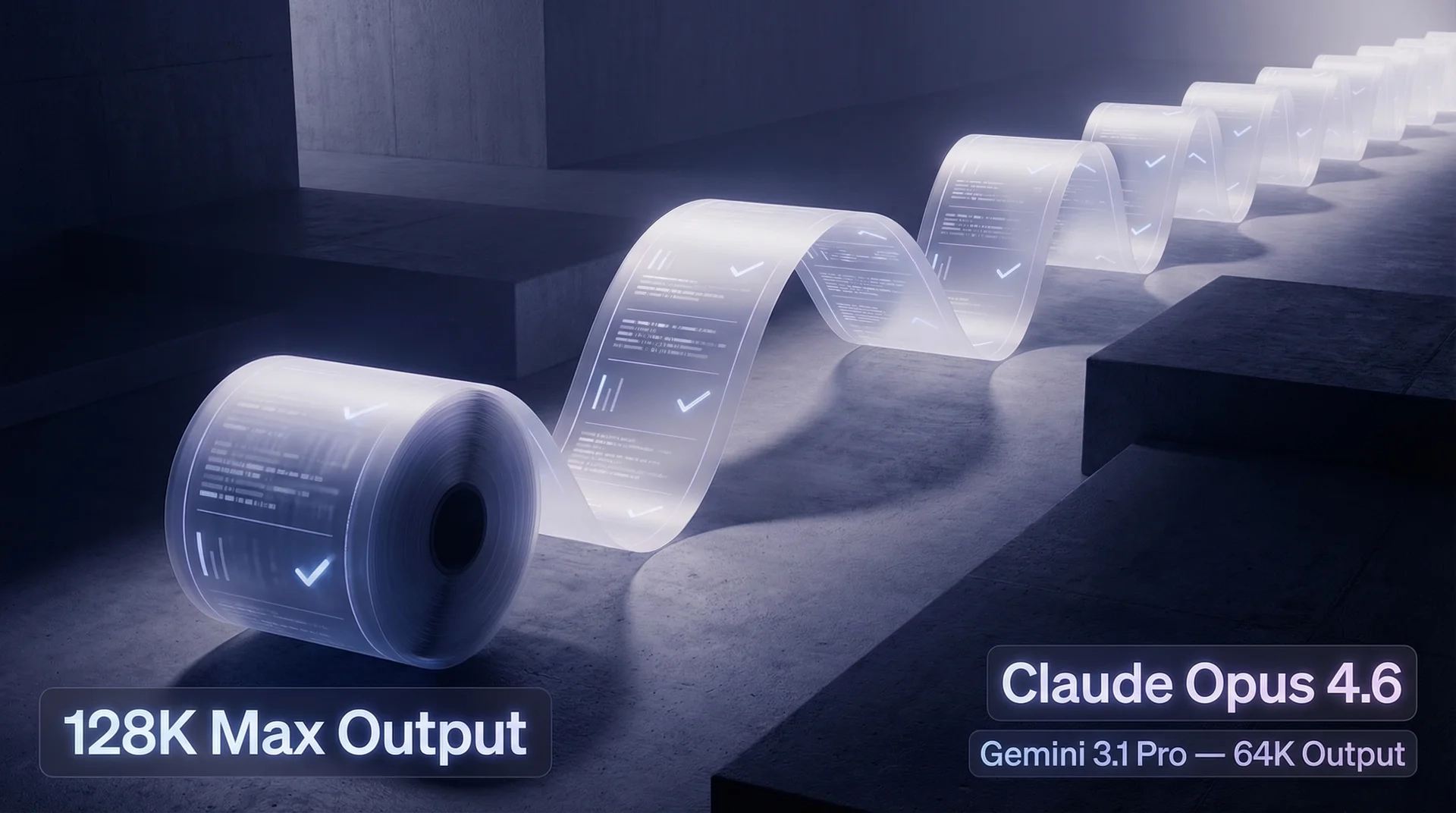

| Salida máxima | 128K tokens | 64K tokens | 128K tokens | 128K tokens |

| Entrada (/1M) | $5.00 (≤200K) / $10.00 (>200K) | $2.00 (≤200K) / $4.00 (>200K) | $2.50 (entrada en caché: $0.625) | $1.75 |

| Salida (/1M) | $25.00 (≤200K) / $37.50 (>200K) | $12.00 (≤200K) / $18.00 (>200K) | $20.00 | $14.00 |

| Razonamiento | Razonamiento extendido | Standard | El nombre público del modo aún es limitado | Estándar + razonamiento profundo |

| SWE-bench | 80.8% (single) / 81.42% (prompt mod.) | 80.6% (single) | Aún sin cifra pública ampliamente aceptada | 80.0% |

| Mejor para | Código complejo, orquestación de agentes | Contexto largo, multimodal, valor | Por definir | Código con presupuesto, uso general |

Fuentes: anthropic.com/pricing · anthropic.com/docs/models/claude-opus-4-6 · ai.google.dev pricing · deepmind.google model card · platform.openai.com/docs/models/gpt-5.2 · openrouter.ai/openai/gpt-5.4

Cuándo usar cada modelo

Elige Claude Opus 4.6 si necesitas la mejor calidad de código

En la tabla comparativa de DeepMind, Opus 4.6 aparece con 80.8% SWE-bench (single attempt). Anthropic reporta hasta 81.42% con prompt modification y promedia 25 pruebas (fuente: anthropic.com/news/claude-opus-4-6). El máximo de salida 128K es líder en su clase.

Agent Teams es muy útil para sistemas multi‑agente.

El coste es el trade‑off: ≤200K cuesta $5/$25 por 1M; >200K sube a $10/$37.50. La relación frente a Gemini se mantiene (2.5× entrada y ~2.08× salida).

Mejores escenarios: reparación estilo SWE‑bench, orquestación multi‑agente, generación larga (>64K) y aplicaciones críticas.

Elige Gemini 3.1 Pro si buscas el mejor valor

Gemini 3.1 Pro combina 1M de contexto nativo con benchmarks competitivos al precio más bajo. A $2.00/$12.00 (≤200K) cuesta menos de la mitad de Opus y solo cae 0.2 puntos en SWE‑bench.

Además de código, destaca en:

- GPQA Diamond: 94.3% — razonamiento científico

- ARC-AGI-2: 77.1%

- HLE: 44.4%

- Terminal-Bench 2.0: 68.5%

- Multimodal nativo: texto + imagen + audio + video

La limitación principal es el máximo de salida 64K frente a 128K de Opus.

Mejores escenarios: análisis de documentos largos, apps multimodales, APIs sensibles a coste, y codebases que caben en 1M de contexto.

GPT-5.4 ahora: evaluación en rollout controlado

Datos públicos actuales en OpenRouter:

- 1M de contexto

- 128K de salida máxima

- $2.50 / 1M entrada, $0.625 / 1M entrada en caché, $20.00 / 1M salida

Lo que aún falta: cobertura amplia de benchmarks independientes sobre cargas reales.

Enfoque pragmático: mantén Gemini/Opus en producción principal y enruta una parte limitada de tráfico a GPT-5.4 hasta pasar tus evaluaciones.

Análisis profundo: ventana de contexto

| Modelo | Ventana de contexto | Notas |

|---|---|---|

| Gemini 3.1 Pro | 1M tokens | Contexto 1M listo para producción |

| GPT-5.4 | 1M tokens | Listado en OpenRouter |

| GPT-5.2 | 400K tokens | Disponible ahora |

| Claude Opus 4.6 | 200K (1M beta) | 1M beta limitado a tier 4/custom limits |

Para grandes codebases o corpus legales, el 1M de contexto de Gemini es una ventaja. El 1M beta de Opus está limitado a usage tier 4 o límites personalizados.

Análisis profundo: capacidad de razonamiento

| Modelo | Modo de razonamiento | Fortalezas clave |

|---|---|---|

| Claude Opus 4.6 | Razonamiento extendido | Depuración en múltiples pasos, planificación arquitectónica |

| Gemini 3.1 Pro | Estándar (con soporte de pensamiento) | GPQA Diamond 94.3%, ARC-AGI-2 77.1% |

| GPT-5.4 | El nombre público del modo aún es limitado | Validar con tu propio suite de evaluación |

El extended thinking de Opus funciona mejor en razonamiento estructurado. Gemini destaca en GPQA Diamond.

Análisis profundo: precio y coste

Coste por tarea (estimado)

Estimaciones por tipo de tarea.

| Tarea | Tokens (entrada/salida) | GPT-5.2 | Gemini 3.1 Pro | Claude Opus 4.6 |

|---|---|---|---|---|

| Chat simple | 1K / 500 | $0.009 | $0.008 | $0.018 |

| Revisión de código (archivo único) | 5K / 2K | $0.037 | $0.034 | $0.075 |

| Análisis de documentos largos | 100K / 5K | $0.245 | $0.260 | $0.625 |

| Código completo (200K+ contexto) | 300K / 10K | $0.665 | $1.380* | $3.375** |

*Gemini 3.1 Pro >200K: $4.00/$18.00 por 1M tokens.

**Claude Opus 4.6 >200K: $10.00/$37.50 por 1M tokens.

En contextos altos (>200K), Gemini y Opus suben de precio, pero la relación se mantiene; la diferencia absoluta crece. El cambio de ranking ocurre frente a GPT‑5.2.

Con EvoLink (evolink.ai/models) puedes acceder con descuento a Opus 4.6 y Gemini 3.1 Pro usando un único endpoint compatible con OpenAI.

Análisis profundo: rendimiento en código

| Modelo | SWE-bench | Condiciones | Fuente |

|---|---|---|---|

| Claude Opus 4.6 | 80.8% (single) / 81.42% (prompt mod.) | Fuentes mixtas | deepmind.google model card / anthropic.com/news/claude-opus-4-6 |

| Gemini 3.1 Pro | 80.6% (single) | Evaluación de Google | deepmind.google model card |

| GPT-5.2 | 80.0% | Evaluación de OpenAI | platform.openai.com |

| GPT-5.4 | Aún sin cifra pública ampliamente aceptada | — | Disponible en OpenRouter |

Nota importante: distintos proveedores usan diferentes evaluaciones; las diferencias de 0.2% pueden no ser significativas.

Lo que sí importa en la práctica:

- Opus 4.6: salida máxima 128K.

- Gemini 3.1 Pro: 1M de contexto. Terminal‑Bench 2.0: 68.5%.

- GPT-5.2: el más barato a $1.75/1M con 80.0% SWE‑bench.

Marco de decisión

Según tu restricción principal:

¿Presupuesto?

→ GPT-5.2 ($1.75/$14) o Gemini 3.1 Pro ($2/$12)

¿Necesitas >200K de contexto?

→ Gemini 3.1 Pro (1M nativo) o pilotear GPT‑5.4 con tráfico enrutado

¿Máxima calidad de código y salida larga?

→ Claude Opus 4.6 (80.8% SWE‑bench, 128K salida)

¿Multimodal (video/audio)?

→ Gemini 3.1 Pro

¿Sistemas multi‑agente?

→ Claude Opus 4.6 (Agent Teams)

¿Razonamiento científico?

→ Gemini 3.1 Pro (GPQA Diamond 94.3%)

¿Un solo API para varios modelos?

→ EvoLink (evolink.ai)

¿Debo migrar ya a GPT‑5.4?

Respuesta corta: no hagas hard switch; usa rollout controlado.

GPT‑5.4 está disponible vía OpenRouter, pero antes de una migración completa debes validar calidad, latencia y coste en tus propios workloads.

Enfoque pragmático:

- Construye ahora con Gemini 3.1 Pro o Claude Opus 4.6

- Usa un gateway/API router para cambiar modelo por configuración

- Evalúa GPT‑5.4 de inmediato en tu suite de benchmarks

- Migra gradualmente solo si gana en tus métricas

También vale la pena vigilar DeepSeek V4.

FAQ

¿GPT‑5.4 será mejor que Claude Opus 4.6?

Depende de tus tareas. GPT‑5.4 está listado pero aún no hay consenso amplio de benchmarks independientes. Opus 4.6 sigue siendo una referencia sólida con 80.8% (single) y 81.42% (prompt mod.).

¿Cuál es más barato: Opus 4.6 o Gemini 3.1 Pro?

Gemini 3.1 Pro. ≤200K: $2.00/$12.00 vs Opus $5.00/$25.00. >200K: $4.00/$18.00 vs Opus $10.00/$37.50. La brecha relativa casi no cambia.

¿Qué ventana de contexto ofrece Gemini 3.1 Pro?

1M tokens en producción.

¿GPT‑5.4 está disponible ahora?

openai/gpt-5.4) con precios y límites publicados. La disponibilidad y facturación pueden variar según proveedor y contrato.¿Puedo usar 1M de contexto en Claude Opus 4.6?

El estándar es 200K; 1M beta está limitado a usage tier 4 o límites personalizados.

¿Cuál es el mejor modelo para código?

En la tabla single‑attempt: Opus 4.6 80.8%, Gemini 3.1 Pro 80.6%, GPT‑5.2 80.0%. Anthropic también reporta 81.42% con prompt modification.

¿Gemini 3.1 Pro es bueno para multimodal?

Sí. Es el único de estos con entrada nativa de texto, imagen, audio y video.

Esta página se actualizará con nueva información. Última revisión: 2026‑03‑06.

¿Quieres usar GPT‑5.4 el día del lanzamiento? Crea una cuenta en EvoLink (evolink.ai).