Suno API Test 2026: Komplette Anleitung zur KI-Musik API und Integration

Die Welt der generativen KI hat sich in den letzten zwölf Monaten grundlegend verändert. Während 2024 das Jahr der Text- und Bildgenerierung war, sind 2025 und 2026 unbestreitbar zur Ära der KI-Audiogenerierung geworden. An der Spitze dieser Revolution steht Suno -- ein Modell, das für Musik das geleistet hat, was ChatGPT für das Schreiben bedeutete. Mit der Veröffentlichung von Suno V5 hat die Plattform einen ELO-Benchmark-Score von 1.293 erreicht und übertrifft damit alle früheren Versionen und Konkurrenten in Klangtreue, musikalischer Struktur und stimmlichem Realismus.

Was ist die Suno API? Die Technologie im Überblick

Streng genommen bezeichnet "Suno API" die programmatische Schnittstelle, über die Entwickler Text-Prompts (Liedtexte, Stilbeschreibungen) an die Suno-Server senden und im Gegenzug generierte Audiodateien erhalten.

Im Gegensatz zu herkömmlichen MIDI-basierten Generierungstools arbeitet Suno mit fortschrittlichen Diffusions- und Transformer-Architekturen, die vollständige akustische Wellenformen rendern können. Das bedeutet: Suno schreibt nicht nur Noten -- es führt sie auf. Es erzeugt das Timbre der Stimme, den Atem zwischen den Wörtern, die Verzerrung einer Gitarre und den Hall des Raumes.

Die Realität: "Offiziell" vs. "Inoffiziell"

Diese Marktlücke wurde von Drittanbieter-API-Providern und Middleware-Lösungen gefüllt. Diese Dienste übernehmen die Komplexität von Account-Pools, Parallelverarbeitung und Session-Management und bieten Entwicklern eine saubere, standardisierte REST-API. So können Sie Suno-V5-Funktionen integrieren, ohne selbst komplexe Web-Scraper zu bauen oder Browser-Automatisierung zu betreiben.

Kernfunktionen und Fähigkeiten von Suno V5

Der Sprung zu V5 bringt Funktionen mit sich, die die API für professionelle Produktions-Workflows tauglich machen -- weit über das Niveau einer Spielerei hinaus.

1. High-Fidelity-Audiogenerierung

generate-Endpunkt. V5-Modelle erzeugen kristallklares Audio in 44,1 kHz Stereo. Der "Schleier" oder das Hintergrundrauschen, das bei V3- und V4-Modellen üblich war, ist praktisch verschwunden.- Instrumental-Modus: Erzeugt Hintergrundtracks, Beats und Klanglandschaften.

- Vokal-Modus: Generiert Songs mit Texten (benutzerdefiniert oder KI-generiert) mit nahezu menschlicher Gesangsleistung.

2. Audio-Erweiterung und Fortsetzung

Eine der leistungsstärksten Funktionen ist die Möglichkeit, einen Track zu verlagern. Wenn Sie einen 2-minütigen Clip generieren, der abrupt endet, können Sie die Clip-ID an die API zurückgeben, um das nächste Segment zu erzeugen -- Tempo, Tonart und Instrumentierung bleiben dabei perfekt erhalten.

3. Benutzerdefinierter Modus (Custom Mode)

Für präzise Kontrolle unterstützt die API den Custom Mode, bei dem Sie den Prompt in einzelne Bestandteile aufteilen können:

- Texte: Explizite Texteingabe für Liedtexte.

- Stil: Genre-Tags (z. B. "Cyberpunk Synthwave, 140 BPM, aggressiver Bass").

- Titel: Metadaten-Tagging.

4. Geschwindigkeit und Latenz

Im Jahr 2026 ist Geschwindigkeit entscheidend. Die neuesten API-Implementierungen haben die Antwortzeiten erheblich optimiert.

- Erstes Token/Audio-Chunk: ~10--15 Sekunden.

- Vollständige Generierung: ~20--30 Sekunden für einen kompletten Clip.

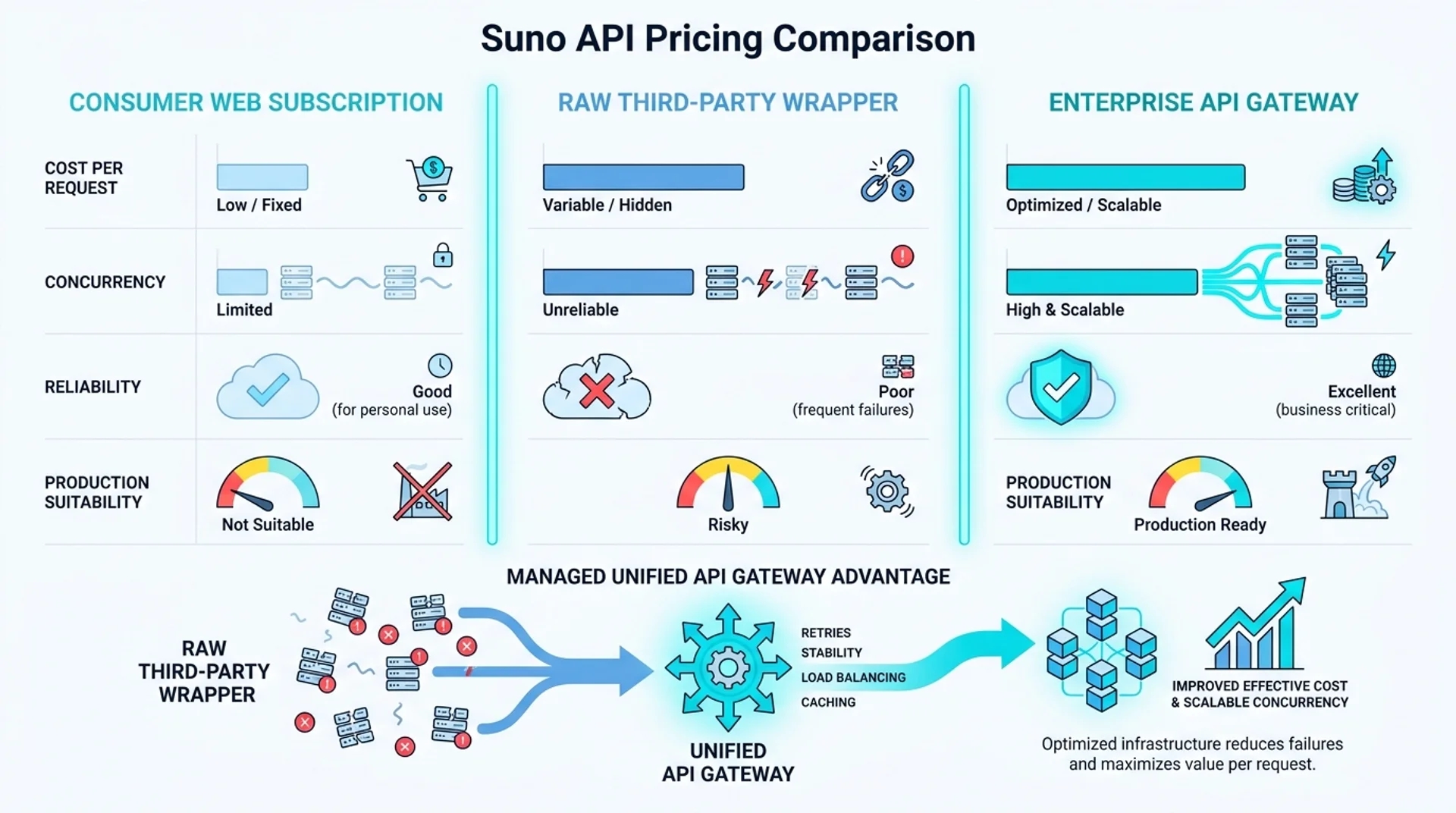

Preisanalyse: Offiziell vs. Drittanbieter

Kosten sind oft der entscheidende Faktor für Anwendungen mit hohem Volumen. Da es keine öffentliche offizielle API-Preistabelle für Entwickler gibt, müssen wir die effektiven Kosten der Nutzung von Verbraucher-Credits mit dedizierten API-Anbietern vergleichen.

Die Kostenaufschlüsselung

Drittanbieter-API-Provider verlangen in der Regel einen Aufschlag für die Infrastruktur, bieten jedoch Mengenrabatte, die bei Skalierung die Preise sogar unter die offiziellen Verbraucherraten drücken können.

| Anbietertyp | Gesch. Kosten/Anfrage | Parallelität | Zuverlässigkeit | Bewertung |

|---|---|---|---|---|

| Offizielles Web-Abo | ~$0,04 | 1 (Sequenziell) | Niedrig (API) | Nicht praktikabel für Apps |

| Einfache Drittanbieter-Wrapper | $0,05 -- $0,10 | Mittel | Variabel | Geeignet für Hobbyprojekte |

| Enterprise-API-Lösungen | $0,02 -- $0,05 | Hoch (Skalierbar) | Hoch (SLA) | Beste Wahl für Unternehmen |

Integrations-Anleitung: Mit der Suno API entwickeln

Die Integration der Suno API in Ihre Python- oder Node.js-Anwendung folgt Standard-RESTful-Mustern. Im Folgenden finden Sie eine Vorlage für eine robuste Integration.

1. Authentifizierung

Die meisten Anbieter verwenden Bearer-Token-Authentifizierung. Sie benötigen einen API-Schlüssel, den Sie über das Dashboard Ihres Anbieters erhalten.

2. Die Generierungsanfrage

Der Standard-Payload für eine benutzerdefinierte Generierung sieht folgendermaßen aus:

{

"prompt": "[Verse 1] Neon lights in the rain...",

"tags": "synthwave, male vocals, slow tempo",

"title": "Night City Blues",

"model": "suno-v5",

"wait_audio": true

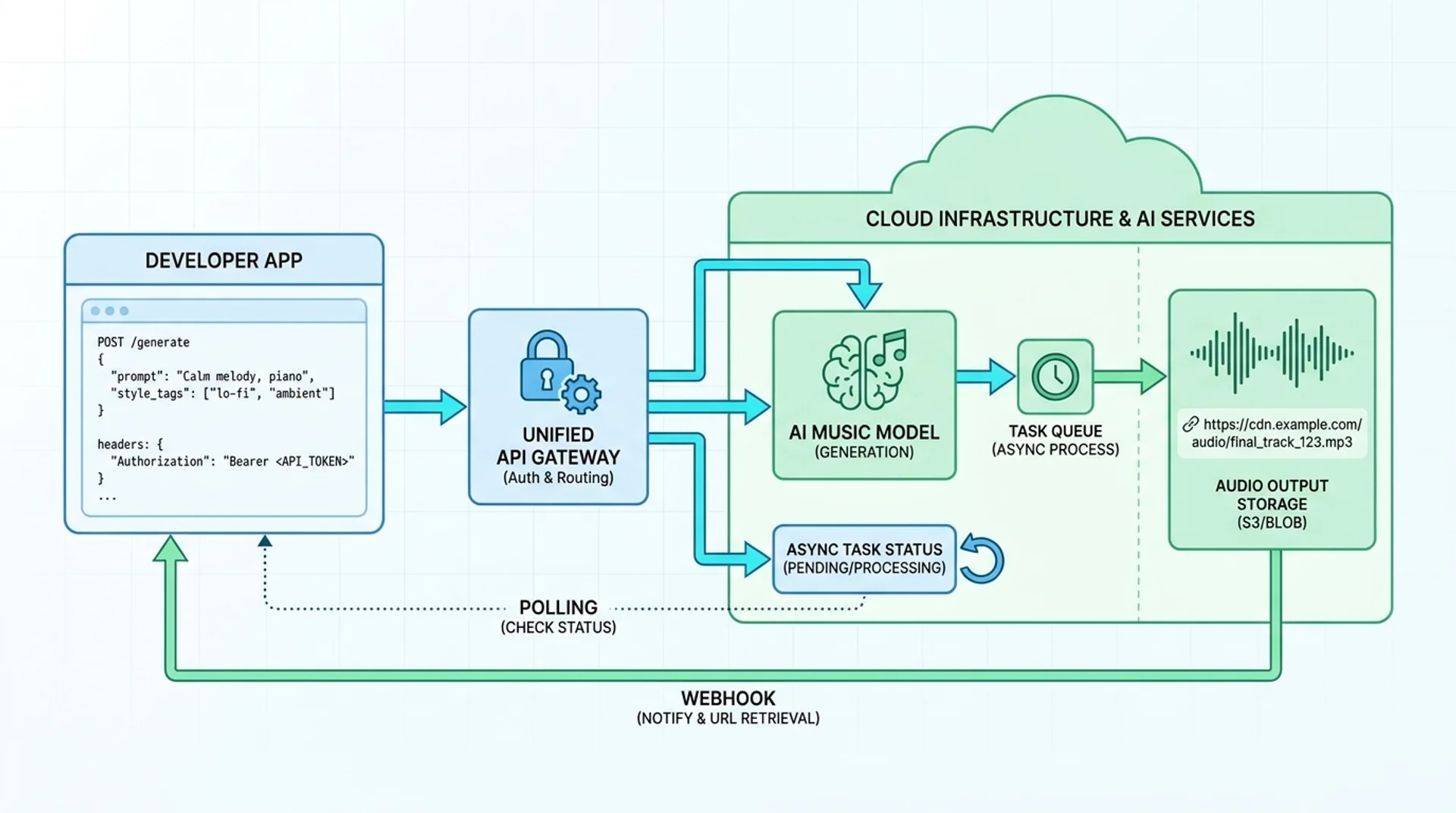

}3. Umgang mit asynchronen Antworten

Musikgenerierung braucht Zeit. Eine robuste Integration sollte die Verbindung nicht blockierend offen halten. Verwenden Sie stattdessen Webhooks oder Polling.

- Anfrage senden: Sie erhalten eine

task_id. - Status abfragen: Prüfen Sie

/task/{task_id}alle 2 Sekunden. - Ergebnis abrufen: Sobald der Status

completedlautet, laden Sie dieaudio_urlherunter.

4. Python-Beispielcode

Hier ist ein vereinfachtes Beispiel für den API-Aufruf:

import requests

import time

API_URL = "https://api.evolink.ai/v1/suno/generate"

API_KEY = "ihr_api_schluessel_hier"

headers = {

"Authorization": f"Bearer {API_KEY}",

"Content-Type": "application/json"

}

payload = {

"prompt": "Ein futuristischer Techno-Track mit schwerem Bass",

"make_instrumental": True,

"model": "v5"

}

# 1. Generierung starten

response = requests.post(API_URL, json=payload, headers=headers)

task_id = response.json()['id']

# 2. Auf Fertigstellung warten (Polling)

while True:

result = requests.get(f"{API_URL}/{task_id}", headers=headers).json()

if result['status'] == 'completed':

print(f"Audio generiert: {result['audio_url']}")

break

elif result['status'] == 'failed':

print("Generierung fehlgeschlagen")

break

time.sleep(2)Leistungsbenchmarks: Ist die Suno API produktionsreif?

Wir haben die Leistung von Suno V5 über die API anhand von drei entscheidenden Metriken analysiert: Qualität, Geschwindigkeit und Konsistenz.

Audio-Qualität (ELO-Score)

- Vs. Udio: Suno schneidet in der Regel besser ab bei Melodieerhalt und Songstruktur (Strophe-Refrain-Kohärenz).

- Vs. Stable Audio: Suno dominiert bei stimmlicher Klarheit und Texttreue.

Generierungsgeschwindigkeit

- Durchschnittliche Latenz: 22,4 Sekunden für einen 2-Minuten-Clip.

- Parallelverarbeitung: Hochwertige API-Anbieter verarbeiten über 50 gleichzeitige Anfragen ohne Leistungseinbußen -- ideal für Echtzeit-Nutzeranwendungen (z. B. ein "magischer Barde"-Feature in einem Spiel).

Erfolgsrate

- Prompt-Treue: 88 % der generierten Songs spiegeln die angeforderten Genre-Tags korrekt wider.

- Text-Halluzinationen: Auf <5 % in V5 reduziert -- die KI singt kaum noch Unsinn oder ignoriert vorgegebene Liedtexte, ein deutlicher Fortschritt gegenüber V3.

Praxisbeispiele und Anwendungsfälle

Die Suno API treibt aktuell Innovationen in mehreren Branchen voran:

- Interaktives Gaming: Dynamische Hintergrundmusik, die sich je nach Spielerumgebung oder Kampfzustand verändert.

- Marketing und AdTech: Automatische Generierung Tausender einzigartiger Jingles für lokalisierte Videoanzeigen im großen Maßstab.

- Content-Creation-Apps: Video-Editoren mit integrierter "Text-zu-Hintergrundmusik"-Funktion direkt in der Zeitleiste.

- Personalisierte Grußkarten: Dienste, die singende Geburtstagskarten versenden, bei denen der Liedtext den Namen des Empfängers und persönliche Erinnerungen enthält.

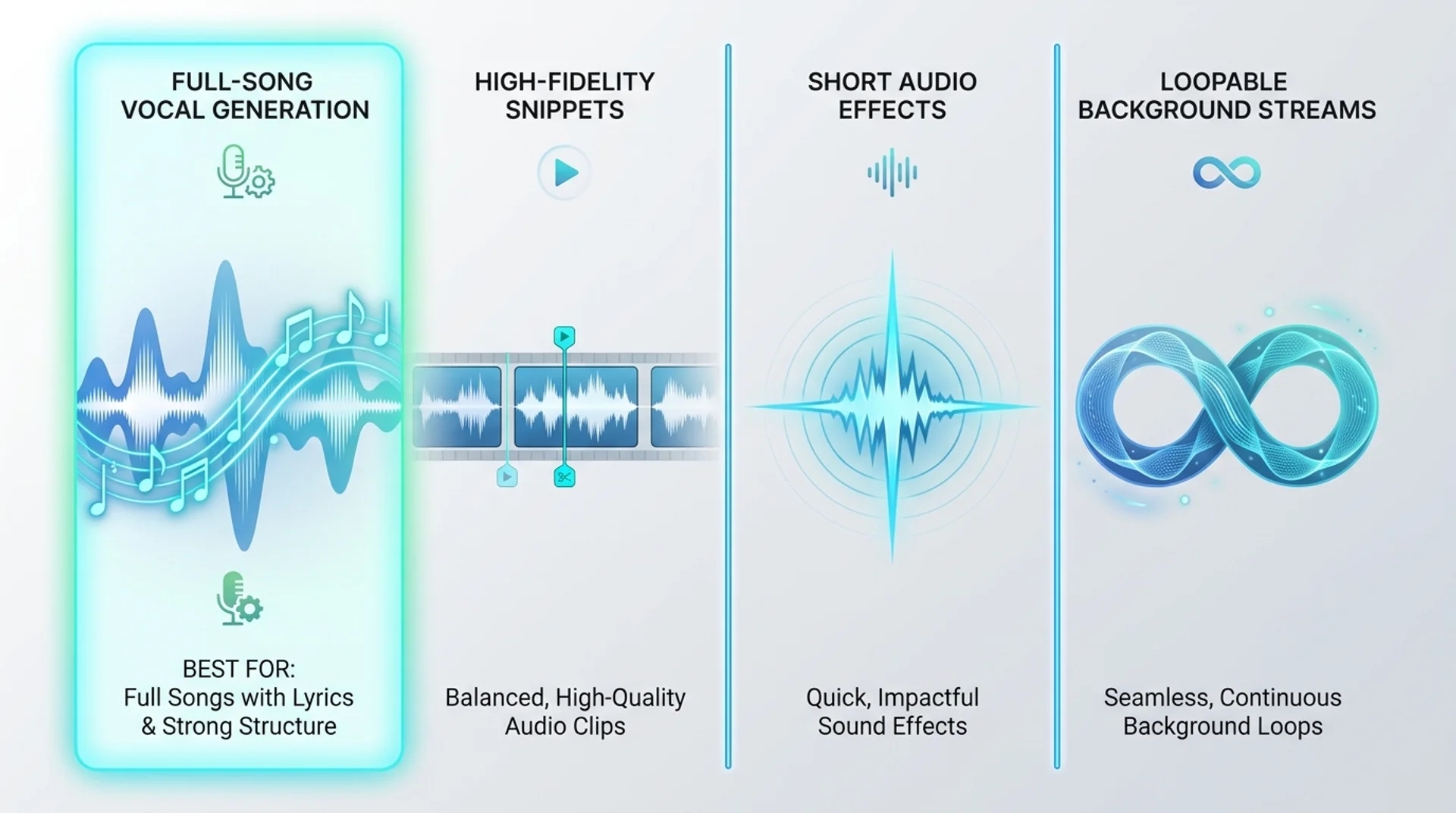

Alternativen im Vergleich

Obwohl Suno Marktführer ist, gibt es weitere Anbieter. Hier der direkte Vergleich mit den wichtigsten Konkurrenten.

| Merkmal | Suno API (V5) | Udio | ElevenLabs Music | Mubert |

|---|---|---|---|---|

| Ideal für | Komplette Songs mit Gesang | High-Fidelity-Snippets | Soundeffekte / Kurze Clips | Loopbare Hintergrund-Streams |

| Vokal-Qualität | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ | N/A (Instrumental-Fokus) |

| Song-Struktur | Exzellent (Strophe/Refrain) | Gut | Linear | Loop-basiert |

| Kommerzielle Rechte | Ja (via Pro/API) | Ja | Ja | Ja |

| API-Verfügbarkeit | Drittanbieter / Enterprise | Private Beta | Public Beta | Öffentlich |

Vor- und Nachteile der Suno API

Vorteile

- Unerreichte Vokal-Qualität: Die KI-Singstimmen sind oft nicht von menschlichen Aufnahmekünstlern zu unterscheiden.

- Strukturelle Kohärenz: Anders als andere Modelle, die "abdriften", versteht Suno musikalische Phrasierung, Drops und Höhepunkte.

- Kosteneffizient im großen Maßstab: Die Kosten pro Minute erzeugten Audios liegen deutlich unter denen für lizenzierte Stockmusik.

- Rasante Weiterentwicklung: Der Sprung von V3 zu V5 innerhalb eines Jahres belegt die hohe Entwicklungsgeschwindigkeit des Teams.

Nachteile

- Keine offizielle öffentliche API: Die Abhängigkeit von Drittanbietern oder Enterprise-Vereinbarungen kann für manche Projekte eine Hürde sein.

- Urheberrechtliche Unklarheit: Die Rechtslage rund um KI-Musiktrainingsdaten wird noch verhandelt. Nutzer sollten Sunos aktuelle EULA für die neuesten Bedingungen zur kommerziellen Nutzung prüfen.

- Gelegentliche Halluzinationen: Vereinzelt kann das Modell ein spezifisches Genre-Tag ignorieren, wenn es stark mit den Liedtexten kollidiert (z. B. traurige Texte zu einer fröhlichen Melodie).

Häufig gestellte Fragen (FAQ)

Fazit

Im Jahr 2026 setzt die Suno API den Maßstab für generative Audioerzeugung. Sie hat den Sprung vom "unterhaltsamen Spielzeug" zum ernstzunehmenden Kreativwerkzeug erfolgreich geschafft -- einem Werkzeug, das ganze Geschäftsmodelle tragen kann. Die Fähigkeit, Nuancen von Musikgenre, Emotion und Textfluss zu verstehen, verschafft Suno einen klaren Generationsvorsprung gegenüber der Konkurrenz.

Für Entwickler lautet die zentrale Frage nicht mehr "Ist die Technik gut genug?", sondern "Wie schnell kann ich sie integrieren?". Das Fehlen einer öffentlichen offiziellen API ist dank des robusten Ökosystems an API-Anbietern kein Hindernis mehr, sondern lediglich eine kleine Umlenkung.