Hugging Face 推論 API 開発者ガイド

Hugging Face 推論 API とは

その核心において、Hugging Face 推論 API は、Hugging Face Hub にホストされている機械学習モデルを直接的な API 呼び出しを通じて実行できるサービスです。GPU 管理、サーバー構成、スケーリングなどのモデル デプロイの複雑さを完全に抽象化します。独自のサーバーをプロビジョニングする代わりに、モデルのエンドポイントにデータを送信し、予測結果を受け取るだけです。

より明確なイメージを持っていただくために、この API が提供する主な機能を以下にまとめます。

Hugging Face 推論 API の概要

この表は、さまざまな開発ニーズに対して Hugging Face 推論 API を使用する際の主な機能と利点をまとめたものです。

| 機能 | 説明 | 主な利点 |

|---|---|---|

| サーバーレス推論 | サーバー、GPU、または基礎となるインフラを管理することなく、API 呼び出し経由でモデルを実行。 | インフラ オーバーヘッド・ゼロ: 機能の構築にエンジニアリング時間を集中させることができます。 |

| 膨大なモデル ハブへのアクセス | Hub 上の 1,000,000 以上 のモデルをさまざまなタスクに即座に使用可能。 | 比類のない柔軟性: 特定の用途に最適なモデルを簡単に見つけて切り替え可能。 |

| シンプルな HTTP インターフェース | 標準的で十分に文書化された HTTP リクエストを使用して、複雑な AI モデルと対話。 | 迅速なプロトタイピング: 数週間ではなく数分で AI 搭載のコンセプト実証を構築・テスト可能。 |

| 従量課金制の料金 | 使用した計算時間に対してのみ支払うため、実験や小規模な負荷に対して費用対効果が高い。 | コスト効率: 専用の ML インフラを維持するための高い固定費を回避。 |

最終的に、この API は最小限の摩擦でコンセプトから機能的な AI 実装へと導くように設計されています。

開発者にとっての主な利点

この API は明らかに開発効率を念頭に置いて構築されており、多くのプロジェクトで頼りになるいくつかの重要な利点を提供しています。

- インフラ管理ゼロ: GPU のプロビジョニング、CUDA ドライバーとの格闘、サーバーのスケーリングについて心配する必要はありません。API がすべてのバックエンドの重労働を処理します。

- 膨大なモデルの選択肢: Hub への直接アクセスにより、感情分析、テキスト生成、画像処理などのタスクに合わせて、API 呼び出しのパラメータを変更するだけで即座にモデルを切り替えられます。

- 高速プロトタイピング: その使いやすさにより、AI 機能のコンセプト実証を午後のひとときで構築できます。

認証と最初の API 呼び出し

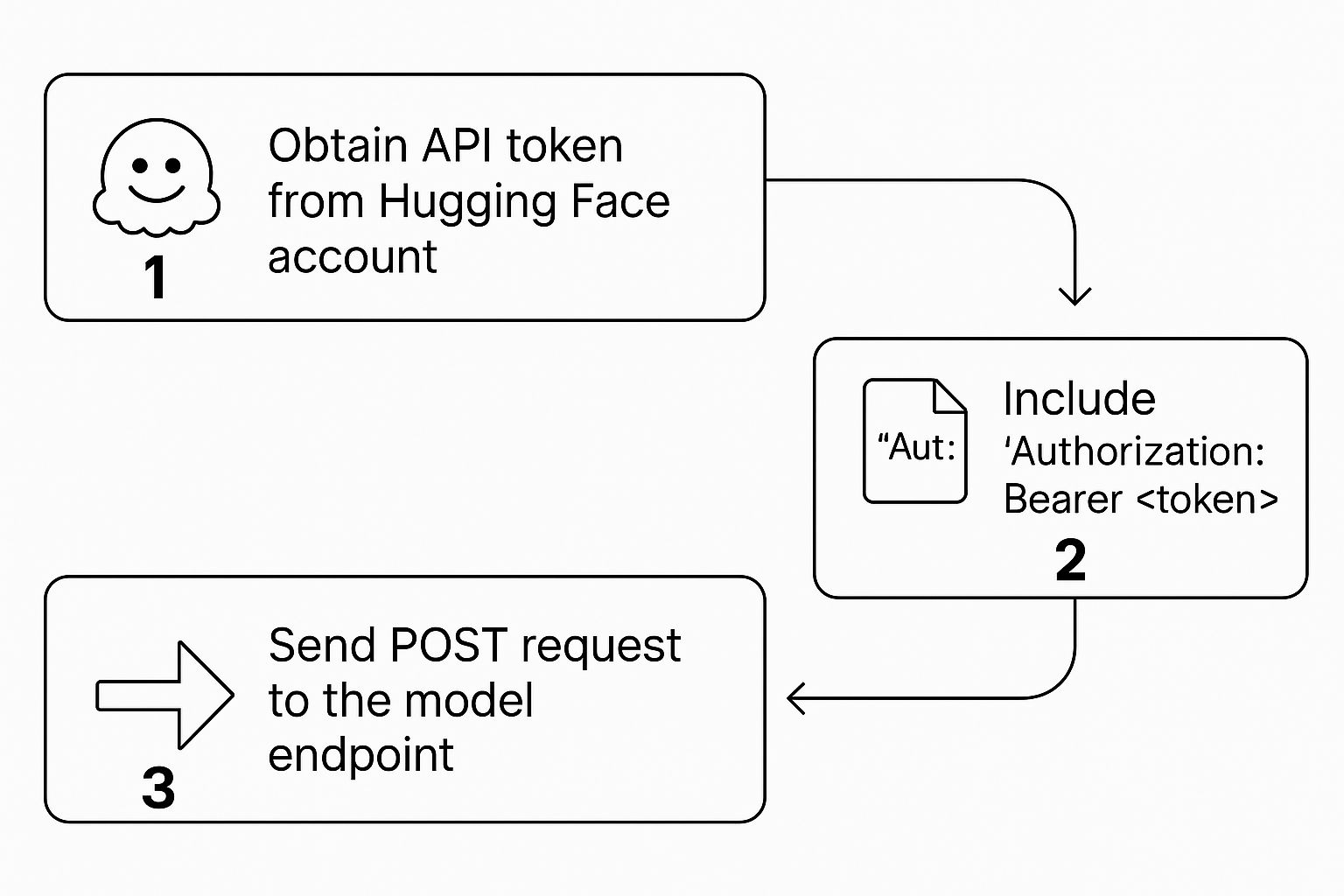

Authorization ヘッダーにそれを含める必要があります。これにより、呼び出しているモデルを実行する権限を持つ正当なユーザーであることが Hugging Face のサーバーに通知されます。プロセスは、トークンを取得し、ヘッダーに配置して、呼び出しを行うという単純ですが重要な3ステップです。

トークンを生成したら、あとはすべてがスムーズかつ安全に動作するようにリクエストを適切に構造化するだけです。

最初の Python API 呼び出し

requests ライブラリを使用してテキスト分類タスクを実行してみましょう。主な構成要素は、モデル固有の API URL と、入力テキストを含む正しくフォーマットされた JSON ペイロードです。Authorization ヘッダーは、現代の API で標準的な「Bearer」スキームを使用する必要があります。トークンの前に Bearer を付けるだけです(スペースを忘れずに)。"YOUR_API_TOKEN" を Hugging Face アカウントの実際のトークンに置き換えてください。import requests

import os

# ベストプラクティス:トークンを環境変数に保存する

# この例では直接定義しますが、本番環境では os.getenv("HF_API_TOKEN") を使用してください。

API_TOKEN = "YOUR_API_TOKEN"

API_URL = "https://api-inference.huggingface.co/models/distilbert/distilbert-base-uncased-finetuned-sst-2-english"

def query_model(payload):

headers = {"Authorization": f"Bearer {API_TOKEN}"}

response = requests.post(API_URL, headers=headers, json=payload)

response.raise_for_status() # 不正なステータスコードの場合に例外を発生させる

return response.json()

# 文章を分類してみましょう

data_payload = {

"inputs": "I love the new features in this software, it's amazing!"

}

try:

output = query_model(data_payload)

print(output)

# 期待される出力例: [[{'label': 'POSITIVE', 'score': 0.9998...}]]

except requests.exceptions.RequestException as e:

print(f"エラーが発生しました: {e}")POSITIVE か NEGATIVE かを示す JSON レスポンスを信頼スコアと共に返します。この基本的なパターンは、テキスト生成から画像分析まで、あらゆる種類のタスクに適用されます(ペイロードの構造が変わるだけです)。もちろん、動画生成器のようなより高度なモデルに進むと、この詳細な 2025年版 Sora 2 API ガイドで見られるように、API のやり取りはより複雑になる可能性があります。クイック テストのためにトークンをハードコーディングするのは問題ありませんが、実際のプロジェクトでは重大なセキュリティ リスクになります。API キーを Git リポジトリにコミットしないでください。単純なスクリプト以上のものについては、環境変数やシークレット管理ツールを使用して資格情報を安全に保管してください。

さまざまな AI タスクに推論 API を活用する

inputs をどのように構造化するかを知ることです。クリエイティブなテキストの生成

max_length のようなパラメータを追加して出力を制御することもできます。import requests

API_URL = "https://api-inference.huggingface.co/models/gpt2"

headers = {"Authorization": "Bearer YOUR_API_TOKEN"}

def query_text_generation(payload):

response = requests.post(API_URL, headers=headers, json=payload)

return response.json()

output = query_text_generation({

"inputs": "The future of AI in software development will be",

"parameters": {"max_length": 50, "temperature": 0.7}

})

print(output)

# 期待される出力: [{'generated_text': 'The future of AI in software development will be...'}]レスポンスは生成されたテキストを含む綺麗な JSON オブジェクトを返すため、解析してアプリケーションに統合するのも簡単です。

画像コンテンツの分類

'rb') で読み取り、そのデータをリクエストの data パラメータに渡します。import requests

API_URL = "https://api-inference.huggingface.co/models/google/vit-base-patch16-224"

headers = {"Authorization": "Bearer YOUR_API_TOKEN"}

def query_image_classification(filename):

with open(filename, "rb") as f:

data = f.read()

response = requests.post(API_URL, headers=headers, data=data)

return response.json()

# 同じディレクトリに画像ファイル(例:'cat.jpg')があることを確認してください

try:

output = query_image_classification("cat.jpg")

print(output)

# 期待される出力例: [{'score': 0.99..., 'label': 'Egyptian cat'}, {'score': 0.00..., 'label': 'tabby, tabby cat'}, ...]

except FileNotFoundError:

print("エラー: 'cat.jpg' が見つかりません。有効な画像ファイルのパスを指定してください。")ゼロショット テキスト分類

inputs(あなたのテキスト)と、candidate_labels のリストを含む parameters オブジェクトです。// fetch を使用した JavaScript の例

async function queryZeroShot(data) {

const response = await fetch(

"https://api-inference.huggingface.co/models/facebook/bart-large-mnli",

{

headers: { Authorization: "Bearer YOUR_API_TOKEN" },

method: "POST",

body: JSON.stringify(data),

}

);

const result = await response.json();

return result;

}

queryZeroShot({

"inputs": "Our new feature launch was a massive success!",

"parameters": {"candidate_labels": ["marketing", "customer feedback", "technical issue"]}

}).then((response) => {

console.log(JSON.stringify(response));

// 期待される出力: {"sequence": "...", "labels": ["customer feedback", ...], "scores": [0.98..., ...]}

});コストと使用層の理解

このシステムはユーザー階層(Free、Pro、Team、Enterprise)に基づいて構築されており、各階層には一定量の月間使用クレジットが付与されます。無料ユーザーは少量を、Pro および Team ユーザーはより多くを受け取ります。これらのクレジットを使い切ると、推論リクエストやモデルの実行時間に対して課金される従量課金モデルに移行します。これは開始するには最適ですが、複数のモデルやプロバイダーにわたって個別のコストを管理することは、すぐに大きな運用上の負担になる可能性があります。

コスト管理の簡素化

直接呼び出しからスマート ルーティングへ

本番環境のパフォーマンス最適化

単一のエンドポイントを超えたレジリエンスの構築

このアーキテクチャは、あらゆる本番システムに2つの重要な利点をもたらします。

- 自動フェイルオーバー: 主要なプロバイダーが遅かったり応答しなかったりした場合、EvoLink は即座にリクエストを正常な代替プロバイダーに再ルーティングし、アプリケーションの安定性を確保します。

- 負荷分散: トラフィックのスパイク時、リクエストは自動的に複数のプロバイダーに分散され、ボトルネックを防ぎ遅延を低く抑えます。

プロバイダーのインフラを抽象化することで、アプリケーションにレジリエンスを直接組み込むことができます。

直接呼び出しから統一ゲートウェイへ

Python での違いを具体的に見てみましょう。

# 変更前: Hugging Face への直接 API 呼び出し

# これは単一障害点(SPOF)を生み出します。

import requests

HF_API_URL = "https://api-inference.huggingface.co/models/gpt2"

HF_TOKEN = "YOUR_HF_TOKEN"

def direct_hf_call(payload):

headers = {"Authorization": f"Bearer {HF_TOKEN}"}

response = requests.post(HF_API_URL, headers=headers, json=payload)

return response.json()# 変更後: 統一された EvoLink API(OpenAI 互換)を使用

# アプリケーションは自動フェイルオーバーと負荷分散によりレジリエントになります。

import requests

# EvoLink の統一 API エンドポイント(OpenAI 互換)

EVOLINK_API_URL = "https://api.evolink.ai/v1"

EVOLINK_TOKEN = "YOUR_EVOLINK_TOKEN"

def evolink_image_generation(prompt):

"""

EvoLink のインテリジェント ルーティングを使用して画像を生成。

EvoLink は選択したモデルに対して最も安価なプロバイダーに自動的にルーティングします。

"""

headers = {"Authorization": f"Bearer {EVOLINK_TOKEN}"}

# 例: Seedream 4.0 を使用してストーリー主導の 4K 画像を生成

payload = {

'model': 'doubao-seedream-4.0', # または 'gpt-4o-image', 'nano-banana'

'prompt': prompt,

'size': '1024x1024'

}

response = requests.post(f"{EVOLINK_API_URL}/images/generations",

headers=headers, json=payload)

return response.json()

def evolink_video_generation(prompt):

"""

EvoLink の動画モデルを使用して動画を生成。

"""

headers = {"Authorization": f"Bearer {EVOLINK_TOKEN}"}

# 例: Sora 2 を使用して音声付きの 10 秒動画を生成

payload = {

'model': 'sora-2', # または 8秒動画用の 'veo3-fast'

'prompt': prompt,

'duration': 10

}

response = requests.post(f"{EVOLINK_API_URL}/videos/generations",

headers=headers, json=payload)

return response.json()この単純な変更により、アプリケーションをプロバイダー固有の問題から将来にわたって保護できるだけでなく、本番グレードの画像・動画生成機能へのアクセスも得られます。

よくある質問と実用的な回答

レート制限にはどのように対処すべきですか?

レート制限に達することはよくある問題です。制限はサブスクリプション階層に依存し、それを超えるとアプリケーションがエラーになります。

いくつかの戦略が役立ちます:

- リクエストのバッチ化: サポートされている場所では、数百件の個別のリクエストを送る代わりに、複数の入力を一つの API 呼び出しにまとめます。

- 指数バックオフの実装: レート制限によりリクエストが失敗した場合、試行の間に待機時間を段階的に長くする(例:1秒、2秒、4秒)再試行ロジックを構築します。これにより API へのスパム行為を防ぎ、回復までの時間を与えます。

推論 API でプライベート モデルを実行できますか?

Authorization ヘッダーに API トークンを渡します。重要な詳細は、トークンに関連付けられたアカウントが、そのプライベート モデル リポジトリにアクセスするための必要な権限を持っていることを確認することです。適切な権限がない場合、認証エラーが発生します。モデルのバージョン管理のベストプラクティスは何ですか?

gpt2)で呼び出すと、デフォルトで main ブランチの最新バージョンが使用されます。これはテストには適していますが、モデルの作成者がアップデートをプッシュした際、本番環境で破壊的変更が導入される可能性があります。プロのアプローチは、リクエストを特定のコミット ハッシュに固定することです。Hub 上のすべてのモデルには Git のようなコミット履歴があります。テスト済みの正確なバージョンを特定し、そのコミット ハッシュを取得して、API 呼び出しにそのリビジョンを含めます。これにより、常に同じバージョンのモデルを使用することが保証され、一貫性のある予測可能な結果が得られます。オープンソース モデルを超えて拡張する準備はできていますか?

Hugging Face API を使いこなすことは、あらゆる AI 開発者にとって貴重なスキルです。しかし、いつ、そしてどのようにして、より堅牢でスケーラブル、かつ費用対効果の高い本番環境へと進級すべきかを知っているかどうかが、成功するプロジェクトと停滞するプロジェクトの分かれ目となります。EvoLink のような統一ゲートウェイを通じて強力なクローズドソース モデルを活用することで、単により良いテクノロジーにアクセスするだけでなく、将来に向けたより賢く、よりレジリエントなインフラストラクチャを採用することになります。