Cómo usar GPT Image 2 con Seedance 2.0: Por qué los equipos los combinan para storyboards y videos cortos

Cómo usar GPT Image 2 con Seedance 2.0

gpt-image-2. ByteDance y BytePlus documentan públicamente Seedance 2.0 como un modelo de video multimodal que admite entradas de texto, imagen, audio y video. Esto hace que la combinación sea fácil de entender: gpt-image-2 es ideal para la estructura visual en preproducción, mientras que Seedance 2.0 se adapta mejor al movimiento, la temporización y la ejecución audiovisual.Resumen rápido

- Usa

gpt-image-2cuando necesites hojas de personajes, cuadrículas de storyboard, keyframes, tarjetas de título, pósteres u otros recursos visuales estructurados. - Usa Seedance 2.0 cuando ya sepas cómo debe verse la escena y necesites movimiento, comportamiento de cámara y producción de video corto.

- La combinación suele ser más efectiva que forzar a un solo modelo a hacerlo todo en un único prompt.

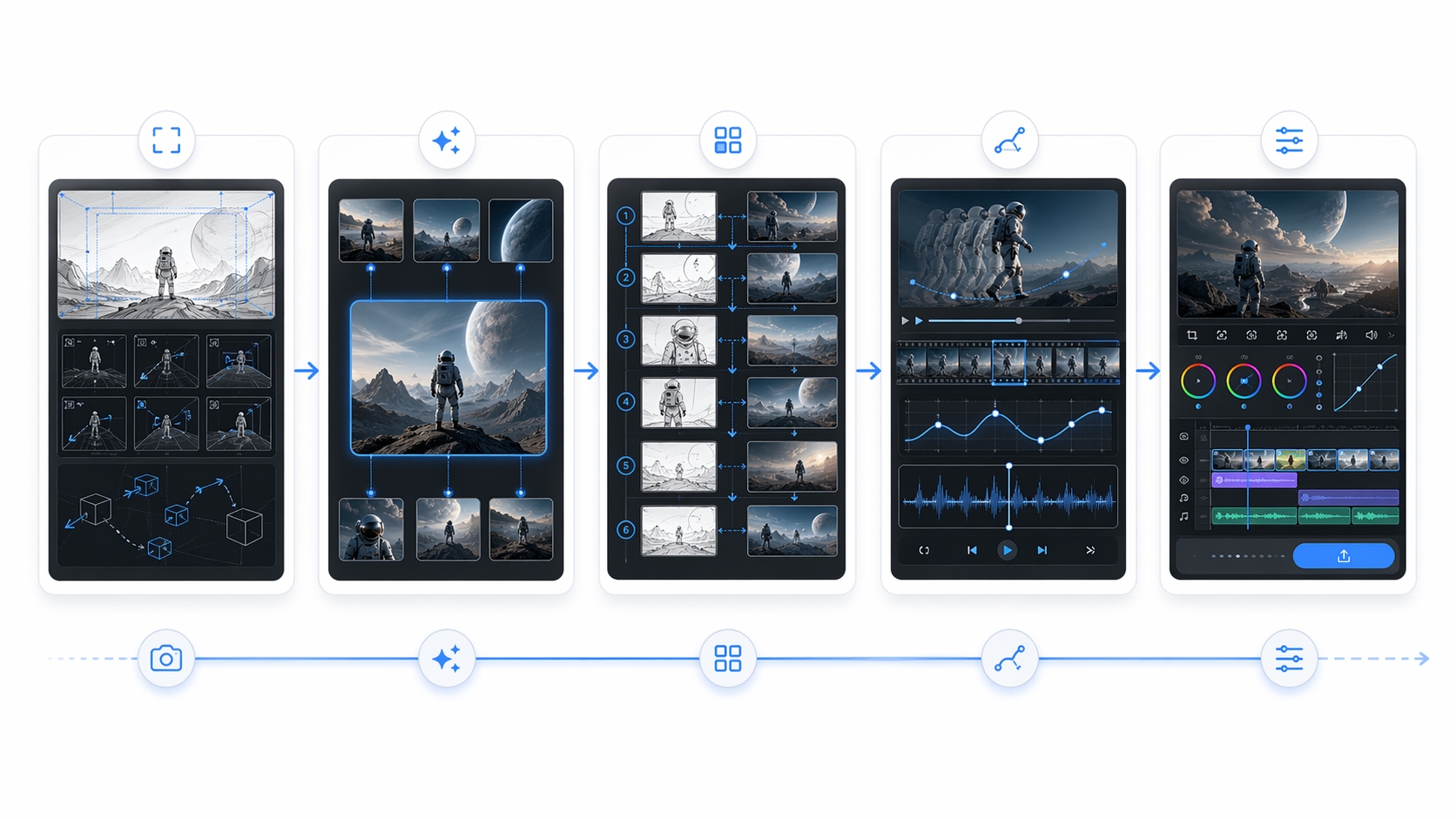

- El flujo de trabajo más común es simple: definir planos -> generar anclas visuales -> construir storyboard o keyframes -> animar en Seedance 2.0 -> finalizar títulos y ritmo en edición.

- Esta combinación funciona mejor para tráilers, teasers, narrativas visuales, videos de producto y clips para redes sociales que para tareas de una sola imagen o videos de tipo talking-head.

En qué destaca realmente cada modelo

La forma más clara de pensar en esta combinación es por etapa de producción, no por tendencia del momento.

| Etapa | GPT Image 2 (gpt-image-2) | Seedance 2.0 |

|---|---|---|

| Rol principal | Diseño visual de preproducción | Movimiento y generación de video corto |

| Mejores entradas | Texto más referencias de imagen opcionales | Entradas de texto, imagen, audio y video |

| Mejores salidas | Hojas de personajes, páginas de storyboard, paneles estilo cómic, pósteres, keyframes, tarjetas de título | Image-to-video, reference-to-video multimodal, flujos de edición de video |

| Mejor uso | Definir la estructura visual y la consistencia | Añadir temporización, movimiento, dirección de cámara y atmósfera audiovisual |

| Fortalezas documentadas oficialmente | Generación y edición de imágenes rápida y de alta calidad | Generación de video multimodal con referencias de imagen, audio y video |

Si la pregunta abierta es:

- cómo debe verse el personaje

- qué debe contener el plano

- qué tan densa debe ser la información visual

- cómo debe organizarse una secuencia antes de animarla

entonces GPT Image 2 suele ser el mejor punto de partida.

Si la pregunta abierta es:

- cómo debe moverse la escena

- cómo debe comportarse la cámara

- cómo debe progresar el clip de un momento a otro

- cómo debe sentirse la secuencia a lo largo del tiempo

entonces Seedance 2.0 suele ser la mejor herramienta.

Por qué los equipos los combinan en lugar de forzar un solo modelo a hacerlo todo

1. La consistencia visual se decide antes

El text-to-video directo puede funcionar bien para experimentos cortos, pero también tiene que resolver demasiadas cosas a la vez: diseño de personajes, composición, movimiento, lógica de escena, ritmo y a veces incluso audio. Cuando los equipos trasladan esas decisiones visuales tempranas a GPT Image 2 primero, la etapa de video posterior tiene menos margen para desviarse.

Esto importa más cuando el resultado no es solo "un clip bonito", sino algo con estructura repetible:

- un tráiler

- un teaser

- un anuncio para redes sociales

- una secuencia corta con personajes recurrentes

- una narrativa visual estilizada

2. El ritmo narrativo se controla más fácilmente

En lugar de pedirle al modelo de video que invente toda la secuencia, el flujo de trabajo pasa a ser:

- decidir los planos

- mostrar los planos visualmente

- animar los planos

Eso suele ser más fácil de depurar que un único prompt gigante.

3. Los elementos visuales con texto y diseño elaborado sobreviven mejor

OpenAI posiciona a GPT Image 2 como un modelo potente de generación y edición de imágenes, y los materiales de lanzamiento de ChatGPT Images 2.0 enfatizan mucho los diseños estructurados, el renderizado de texto multilingüe, páginas de cómic, hojas de referencia y composiciones editoriales. Eso lo convierte en una mejor opción para recursos como:

- tarjetas de título

- diseños tipo póster

- páginas estilo cómic o manga

- elementos visuales tipo interfaz

- composiciones con marca o alta densidad de información

Estos son exactamente el tipo de recursos que suelen romperse cuando intentas generarlos directamente dentro del paso de movimiento.

El flujo de trabajo más habitual

La combinación suele seguir uno de dos patrones.

| Flujo de trabajo | Empezar en GPT Image 2 | Terminar en Seedance 2.0 | Mejor para |

|---|---|---|---|

| Storyboard primero | Cuadrícula de storyboard 3x3 o página multipanel | Animar desde el storyboard como image-to-video o video basado en referencias | Tráilers, teasers, clips narrativos cortos |

| Keyframes primero | Hoja de personaje, ancla de estilo, 4-6 keyframes, tarjetas de título | Animar cada visual como un clip o secuencia individual | Videos de producto, PVs de personajes, ediciones para redes, anuncios estilizados |

Un proceso práctico y ligero

No necesitas un pipeline enorme para sacarle provecho a esto. Para la mayoría de los equipos, un flujo de trabajo en cinco pasos es suficiente.

1. Define primero la intención de cada plano

Antes de hacer prompts a cualquiera de los dos modelos, escribe una lista breve de planos:

Objetivo: teaser de 15 segundos

Plano 1: establecer el sujeto y el ambiente

Plano 2: detalle en primer plano que introduce tensión

Plano 3: se amplía el contexto del mundo o producto

Plano 4: aparece movimiento o conflicto

Plano 5: revelación final o título fijoCon eso es suficiente. El objetivo no es escribir poesía en el prompt. El objetivo es decidir qué necesita comunicar el clip.

2. Usa GPT Image 2 para fijar anclas de personaje y estilo

Crea una o dos anclas visuales antes de intentar una secuencia:

- una hoja de personaje o ancla visual de producto

- un ancla de estilo para color, iluminación y materiales

Si estas no son estables, la etapa de movimiento posterior generalmente empeora, no mejora.

3. Construye una cuadrícula de storyboard o un set de keyframes

Elige la estructura más ligera que se adapte a tu carga de trabajo:

- cuadrícula de storyboard si quieres una sola imagen que contenga toda la secuencia

- set de keyframes si quieres más control a nivel de plano

4. Pasa a Seedance 2.0 para el movimiento

480p y 720p, y duraciones de 4 a 15 segundos. Eso lo convierte en una buena herramienta de segunda etapa cuando el diseño visual ya está decidido.En esta etapa, escribe los prompts más como notas de dirección que como etiquetas de imagen. Concéntrate en:

- qué se mueve

- cómo se mueve la cámara

- cuándo cambia el ritmo

- cómo debería sentirse la atmósfera sonora

5. Finaliza títulos y ritmo fuera del paso de movimiento

Incluso cuando el modelo de video es potente, generalmente es más seguro finalizar:

- tratamiento del título

- subtítulos

- ajustes de ritmo

- tarjetas finales

- empaquetado final

en edición, en lugar de pedirle al paso de generación que haga todos los trabajos a la vez.

Errores frecuentes

La cuadrícula de storyboard aparece como el primer fotograma literal

Este es un efecto secundario común de los flujos storyboard primero. La solución más fácil es recortar el primer segundo en edición o hacer que los paneles iniciales sean visualmente más similares entre sí para que la transición se sienta menos abrupta.

La deriva de personajes comienza antes de la etapa de video

Esto suele parecer un problema de Seedance, pero la causa raíz generalmente está antes. Si la hoja de personaje o el set de keyframes no es estable, el paso de movimiento hereda esa inestabilidad. La solución suele ser fortalecer las anclas de imagen, no repetir el paso de video infinitamente.

Títulos y logos se rompen en el movimiento

El texto sigue siendo una parte frágil de la generación de video. Si un título o logo importa, genéralo por separado como recurso estático primero, y luego anímalo ligeramente o colócalo en edición.

Cuándo funciona mejor esta combinación

Este flujo de trabajo no es universal. Funciona mejor cuando tienes una etapa real de preproducción, aunque sea ligera.

| Buen encaje | Mal encaje |

|---|---|

| Tráilers y teasers | Tareas de una sola imagen |

| Narrativas visuales cortas | Generación pura de tipo talking-head |

| Anuncios sociales con estructura de planos | Experimentos rápidos con un solo prompt |

| Videos de producto que necesitan planificación de diseño | Cargas de trabajo sin necesidad de consistencia visual |

| Cortos con foco en personajes o estilo | Casos donde el text-to-video directo ya resuelve el problema sin complicaciones |

Si tu trabajo principal es "generar una imagen", simplemente usa GPT Image 2.

Si tu trabajo principal es "generar un clip de video rápido a partir de un prompt", quizás no necesites la estructura adicional.

Qué significa esto en EvoLink

Lo interesante de EvoLink no es que la plataforma haya inventado este flujo de trabajo. Es que el flujo se vuelve más fácil de operar cuando las rutas de imagen y video pueden convivir en la misma superficie de trabajo.

- mantener la etapa de imagen y la etapa de video en el mismo flujo de modelos

- comparar el comportamiento de las rutas sin reconstruir tu stack

- decidir cuándo quedarte en una familia de modelos y cuándo pasar a otra

Preguntas frecuentes

¿ChatGPT Images 2.0 es lo mismo que gpt-image-2?

gpt-image-2 es el nombre documentado del modelo en la API.¿Por qué no generar el video completo directamente?

Puedes hacerlo, y a veces es la opción más rápida. El flujo de trabajo combinado se vuelve útil cuando tu equipo necesita más control sobre la consistencia de personajes, el orden de los planos o la planificación visual estructurada.

¿Debería empezar con cuadrículas de storyboard o con keyframes?

¿Cuál es el rol principal de GPT Image 2 en este flujo de trabajo?

Su rol principal es crear recursos visuales de preproducción utilizables: hojas de personajes, anclas visuales, páginas de storyboard, keyframes, tarjetas de título y otros recursos de imagen estructurados.

¿Cuál es el rol principal de Seedance 2.0 en este flujo de trabajo?

Su rol principal es convertir esos recursos visuales en salidas orientadas al movimiento a través de flujos image-to-video o de referencia multimodal, con un control de cámara y temporización más preciso que el que puede ofrecer un modelo puramente de imagen estática.

¿Debería generar títulos y logos dentro del paso de video?

Generalmente no. Si la legibilidad importa, es más seguro crear esos recursos por separado y añadirlos o animarlos después.

¿Cuándo encaja mal esta combinación?

Suele ser excesivo para imágenes estáticas individuales, prompts de video directos y simples, o cargas de trabajo donde la consistencia entre planos no importa demasiado.

Fuentes

- OpenAI, "Introducing ChatGPT Images 2.0" (April 21, 2026): https://openai.com/index/introducing-chatgpt-images-2-0/

- OpenAI API model page for

gpt-image-2: https://developers.openai.com/api/docs/models/gpt-image-2 - ByteDance Seedance 2.0 official page: https://seed.bytedance.com/en/seedance2_0

- BytePlus ModelArk Seedance 2.0 series tutorial: https://docs.byteplus.com/api/docs/ModelArk/2291680