Análisis de la API de DeepSeek V4 en 2026: Flash vs Pro, guía de migración y checklist de producción

deepseek-v4-flash y deepseek-v4-pro, publica precios oficiales para ambos, y documenta 1M de contexto más 384K de salida máxima. Reuters reportó en la misma fecha que V4 se lanzó en preview, lo que significa que los equipos pueden evaluarlo ahora, pero deben seguir tratando su comportamiento como sujeto a cambios antes de la versión final. DeepSeek API Docs DeepSeek Models & Pricing Reuters via Investing.comEsto cambia la decisión práctica:

- DeepSeek V4 Flash es ahora una opción real de enrutamiento de bajo coste para producción

- DeepSeek V4 Pro es ahora una ruta premium de DeepSeek que merece evaluarse con benchmarks

- Claude Opus 4.7 es ahora el modelo insignia actual de Anthropic, no Opus 4.6

- GPT-5.4 sigue siendo el modelo insignia de OpenAI más claramente documentado para trabajo profesional y de programación

Para quién es esta guía

Este artículo es más útil si te identificas con alguno de estos perfiles:

- un líder de ingeniería decidiendo si añadir DeepSeek V4 a su stack de enrutamiento

- un equipo de plataforma migrando desde

deepseek-chatydeepseek-reasoner - un equipo de producto intentando reducir costes de modelos de programación sin perder demasiada calidad

- un equipo de IA decidiendo cuándo enrutar a Flash, cuándo escalar a Pro y cuándo mantener GPT-5.4 o Claude Opus 4.7

Resumen rápido

- Usa DeepSeek V4 Flash primero si tu objetivo principal es programación coste-eficiente, enrutamiento de contexto largo y cargas de trabajo de agentes con alto rendimiento. Su precio oficial es $0.14 input / $0.28 output por 1M de tokens, con 1M de contexto y 384K de salida máxima. DeepSeek Models & Pricing

- Usa DeepSeek V4 Pro si tus tareas son más intensivas en razonamiento o programación y quieres un nivel superior a Flash sin pagar precios de Claude. El precio oficial es $1.74 input / $3.48 output por 1M de tokens. DeepSeek Models & Pricing

- Usa Claude Opus 4.7 cuando quieras el mejor modelo generalmente disponible de Anthropic para programación y agentes, y puedas tolerar precios premium de $5 / $25 por 1M de tokens. Anthropic Claude Opus 4.7

- Usa GPT-5.4 cuando quieras la ruta insignia oficial de OpenAI, 1,050,000 de contexto, 128,000 de salida máxima, y soporte completo de la plataforma OpenAI a $2.50 / $15.00. OpenAI Pricing OpenAI GPT-5.4 Model

- No migres a ciegas en un solo paso. DeepSeek V4 está documentado públicamente y se puede usar en preview, pero preview sigue significando que deberías evaluarlo con cargas de trabajo reales, mantener rutas de rollback y separar Flash de Pro en la lógica de enrutamiento. Reuters via Investing.com

Qué es DeepSeek V4 ahora mismo

La conversación sobre DeepSeek V4 es mucho más sencilla de lo que era a principios de abril.

- IDs de modelo en la API pública:

deepseek-v4-flash,deepseek-v4-pro - longitud de contexto:

1M - salida máxima:

384K - modo de razonamiento (thinking): soportado

- llamadas a herramientas (tool calls): soportadas

deepseek-chatydeepseek-reasonersiguen disponibles por compatibilidad, pero están marcados para deprecación el 24 de julio de 2026

DeepSeek V4 Flash vs Pro: cómo elegir

Esta es la decisión más importante de todo el despliegue de DeepSeek V4.

| Pregunta | DeepSeek V4 Flash | DeepSeek V4 Pro |

|---|---|---|

| Precio oficial de input | $0.14 / 1M cache miss | $1.74 / 1M cache miss |

| Precio oficial de output | $0.28 / 1M | $3.48 / 1M |

| Contexto | 1M | 1M |

| Salida máxima | 384K | 384K |

| Mejor rol | Ruta por defecto de uso general | Ruta premium de mayor inteligencia |

| Mejor primera prueba | Programación de alto volumen, enrutamiento, análisis de repositorios | Tareas más difíciles de programación y razonamiento |

| Compensación principal | Techo más bajo que los modelos premium | Mayor coste que Flash |

Elige Flash si tu pregunta principal es "¿podemos hacer esto barato a escala?"

Flash es la primera ruta que deberías probar cuando quieres:

- un modelo de programación de bajo coste por defecto

- una ruta barata de contexto largo

- un modelo para sistemas de agentes donde el coste de output importa

- un modelo que puedas exponer ampliamente a todos los equipos sin que el gasto se dispare

Si tu equipo está usando actualmente un modelo frontier más caro para programación simple, resúmenes, lectura de repositorios o flujos de trabajo moderados con agentes, Flash es el candidato de sustitución más evidente.

Elige Pro si tu pregunta principal es "¿dónde necesitamos más inteligencia?"

Pro es la mejor ruta cuando quieres:

- mayor calidad de programación o razonamiento que tu ruta económica

- análisis más difíciles con múltiples pasos

- salidas estructuradas más extensas

- una ruta premium que sigue costando menos que Claude Opus 4.7 en output

El modelo mental más sencillo es:

- Flash = ruta por defecto

- Pro = ruta de escalamiento

Este enfoque suele funcionar mejor en producción que intentar forzar un solo modelo caro en todas las cargas de trabajo.

¿Vale la pena DeepSeek V4 para equipos de programación?

Para muchos equipos de programación, sí, pero no como un reemplazo total a ciegas.

DeepSeek V4 merece una evaluación seria si:

- haces mucha generación de código, revisión de código, lectura de repositorios o trabajo de programación con contexto largo

- tu factura actual de tokens de output es dolorosa

- quieres una ruta por defecto más barata para agentes y asistentes de programación

- estás dispuesto a hacer un despliegue por fases en vez de una migración de golpe

Es menos claramente valioso si:

- tus flujos de trabajo más difíciles ya justifican precios premium de modelos cerrados

- tu equipo depende más de las funcionalidades de la plataforma de un proveedor que de la economía del modelo

- aún no tienes un conjunto de evaluación ni una ruta de rollback

Cómo se compara DeepSeek V4 con GPT-5.4 y Claude Opus 4.7

Si tu equipo está decidiendo entre familias de modelos, la referencia más útil ya no es Claude Opus 4.6. La referencia práctica actual es:

- DeepSeek V4 Flash

- DeepSeek V4 Pro

- GPT-5.4

- Claude Opus 4.7

| Modelo | Input | Output | Contexto | Salida máxima | Mejor uso |

|---|---|---|---|---|---|

| DeepSeek V4 Flash | $0.14 | $0.28 | 1M | 384K | Ruta de producción de contexto largo más barata |

| DeepSeek V4 Pro | $1.74 | $3.48 | 1M | 384K | Ruta premium de DeepSeek |

| GPT-5.4 | $2.50 | $15.00 | 1,050,000 | 128K | Modelo insignia oficial de OpenAI |

| Claude Opus 4.7 | $5.00 | $25.00 | 1M | 128K | La ruta más potente de Anthropic en GA para programación y agentes |

Dónde DeepSeek V4 es más fuerte

Según el conjunto de funcionalidades documentado oficialmente y la estructura de precios, DeepSeek V4 es más fuerte cuando se cumplen estas condiciones:

- el contexto largo importa

- el coste de output importa

- las cargas de trabajo de programación y agentes dominan

- quieres separar una ruta por defecto barata de una ruta premium más potente

Esa combinación es poco habitual. Y es también la razón por la que DeepSeek V4 importa mucho más que un lanzamiento de modelo cualquiera.

Dónde GPT-5.4 sigue teniendo sentido

GPT-5.4 sigue teniendo sentido cuando:

- quieres soporte oficial de la plataforma OpenAI de extremo a extremo

- tu equipo ya depende de las herramientas e integraciones de OpenAI

- quieres la ruta insignia oficial de OpenAI para trabajo profesional y de programación

- te importa más la consistencia de la plataforma que el coste bruto de output

Dónde Claude Opus 4.7 sigue teniendo sentido

Claude Opus 4.7 es la referencia adecuada cuando:

- quieres la ruta de programación generalmente disponible más potente de Anthropic

- tus flujos de trabajo dependen de trabajo agéntico sostenido

- quieres la superficie de control en evolución de Claude para esfuerzo y tareas de larga duración

- tu equipo se siente cómodo pagando un premium por calidad y fiabilidad

Cuánto cuesta realmente DeepSeek V4 con cargas de trabajo reales

Los precios oficiales por millón de tokens son útiles, pero los equipos no compran "un millón de tokens." Compran resultados.

A continuación hay ejemplos más sencillos basados en formas de carga de trabajo con precios públicos oficiales, usando volúmenes de tokens aproximados únicamente para mostrar la estructura de costes.

Escenario 1: Análisis de repositorio

Supongamos:

- 250K tokens de input

- 20K tokens de output

Gasto estimado en API:

- DeepSeek V4 Flash: aproximadamente $0.04 input + $0.01 output

- DeepSeek V4 Pro: aproximadamente $0.44 input + $0.07 output

- GPT-5.4: aproximadamente $0.63 input + $0.30 output

- Claude Opus 4.7: aproximadamente $1.25 input + $0.50 output

Por eso Flash es una primera prueba tan obvia para lectura de bases de código, auditorías de dependencias y resúmenes de repositorios.

Escenario 2: Tarea de agente de programación multi-turno

Supongamos:

- 120K tokens de input

- 80K tokens de output

Gasto estimado en API:

- DeepSeek V4 Flash: aproximadamente $0.02 input + $0.02 output

- DeepSeek V4 Pro: aproximadamente $0.21 input + $0.28 output

- GPT-5.4: aproximadamente $0.30 input + $1.20 output

- Claude Opus 4.7: aproximadamente $0.60 input + $2.00 output

La lección principal no es que los modelos premium sean "malos." La lección es que las cargas de trabajo con mucho output penalizan los precios de output caros.

Escenario 3: Revisión de documentos largos o revisión legal

Supongamos:

- 400K tokens de input

- 25K tokens de output

Qué significan estos ejemplos

Si tu producto hace principalmente:

- generación de código

- revisión de código

- lectura de repositorios extensos

- revisión de PDFs o documentos normativos largos

- bucles de agentes con múltiples pasos

Dónde DeepSeek V4 aún tiene limitaciones

Un artículo de análisis útil no debería fingir que todas las fortalezas son universales.

1. El estado de preview sigue importando

2. Sigues necesitando tu propio conjunto de evaluación

- bucles de agentes

- precisión en revisión de código

- calidad de diffs

- tareas de larga duración

- fiabilidad de esquemas

3. Los modelos cerrados premium pueden seguir ganando en tus tareas más difíciles

Claude Opus 4.7 y GPT-5.4 siguen siendo importantes porque algunas cargas de trabajo justifican pagar más:

- cambios de código de mayor riesgo

- las tareas agénticas más difíciles

- flujos de trabajo empresariales donde el coste de los fallos es alto

- entornos donde las herramientas de la plataforma importan tanto como el precio del modelo

La comparación correcta no es "qué modelo gana en internet." Es "qué modelo es el más barato para las tareas que podemos enrutarle de forma segura."

¿Cuándo deberías seguir usando Claude Opus 4.7 o GPT-5.4?

Mantén Claude Opus 4.7 en el stack si:

- tu equipo maneja las tareas de programación y revisión más difíciles

- necesitas el modelo generalmente disponible más potente de Anthropic

- la fiabilidad del agente importa más que el coste por token

Mantén GPT-5.4 en el stack si:

- tu equipo ya está muy invertido en la plataforma OpenAI

- quieres la ruta insignia oficial de OpenAI para trabajo profesional y de programación

- tu flujo de trabajo depende tanto de las herramientas OpenAI como del modelo en sí

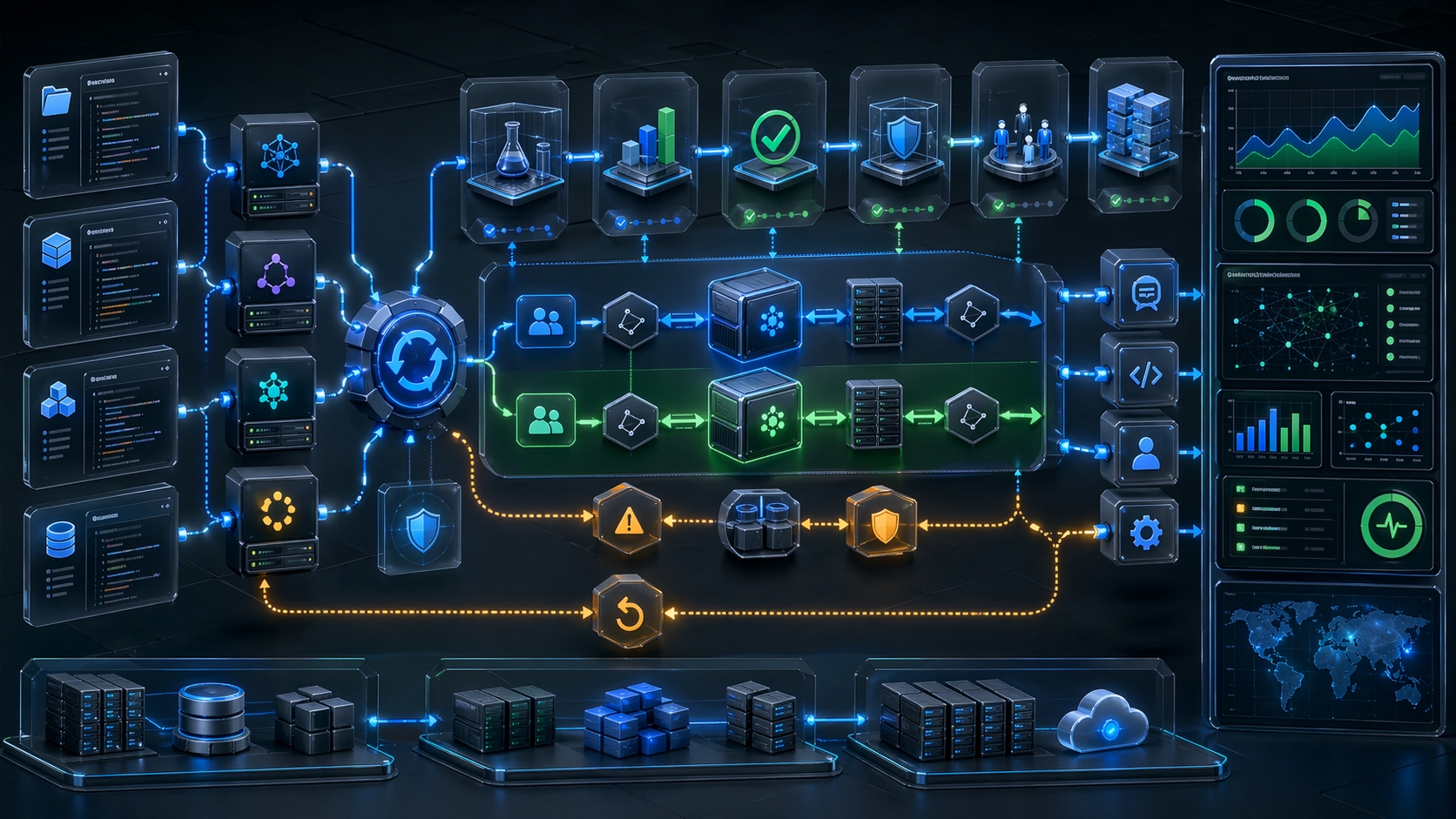

La configuración más práctica para muchos equipos

Para muchos stacks de producción reales, la mejor respuesta no es "reemplazar todo." Es:

- DeepSeek V4 Flash para enrutamiento por defecto económico

- DeepSeek V4 Pro para cargas de trabajo más exigentes apropiadas para DeepSeek

- Claude Opus 4.7 o GPT-5.4 como rutas de fallback y escalamiento premium

Eso suele ser una mejor arquitectura que intentar coronar un ganador universal.

Cómo migrar desde deepseek-chat y deepseek-reasoner

Esta es una de las razones más prácticas para publicar esta guía ahora.

La documentación oficial de DeepSeek indica:

deepseek-chattiene deprecación programada para el 24 de julio de 2026deepseek-reasonertiene deprecación programada para el 24 de julio de 2026- por compatibilidad, se mapean a los modos sin razonamiento y con razonamiento de

deepseek-v4-flash

Ruta de migración recomendada

- Inventaría cada ruta actual de DeepSeek en producción

Busca dónde tu aplicación aún referencia:

deepseek-chatdeepseek-reasoner- lógica de prompts hardcodeada vinculada al comportamiento de output antiguo

- Prueba

deepseek-v4-flashprimero

Dado que los alias de compatibilidad apuntan al comportamiento de Flash, Flash suele ser el primer objetivo de migración con menor riesgo.

- Promociona solo cargas de trabajo específicas a Pro

No cambies todo a Pro por defecto. Dale a Pro un trabajo concreto primero:

- tareas de programación difíciles

- análisis más profundos

- rutas de escalamiento de alto valor

- Mantén las rutas de rollback activas

Preview significa que deberías poder revertir o re-enrutar rápidamente si:

- la calidad baja

- la latencia se dispara

- la fiabilidad de esquemas cambia

- el uso de herramientas se comporta de forma diferente

Tabla de migración

| Ruta antigua | Reemplazo a corto plazo | Recomendación a largo plazo |

|---|---|---|

deepseek-chat | deepseek-v4-flash sin razonamiento | Mantener Flash como tu ruta por defecto de bajo coste |

deepseek-reasoner | deepseek-v4-flash con razonamiento | Probar si Pro es mejor para tus tareas más difíciles |

Checklist de despliegue de DeepSeek V4 en producción

Si estás evaluando DeepSeek V4 para uso real, utiliza un checklist de despliegue como este:

- define de 20 a 50 tareas reales de tu propia carga de trabajo

- separa las tareas simples de ruta por defecto de las tareas de ruta premium

- haz benchmark de Flash y Pro de forma independiente

- compara la calidad del output, no solo los titulares de benchmarks

- mide el coste por tarea exitosa, no solo el coste por token

- mantén rutas de rollback para GPT-5.4 o Claude Opus 4.7

- versiona los prompts y los harnesses de evaluación

- registra los fallos de llamadas a herramientas y fallos de esquema por separado

- vigila la latencia y los patrones de reintentos durante el preview

- decide de antemano qué cuenta como "suficientemente bueno para promover"

Esta es la parte que muchos artículos de lanzamiento se saltan, y es la parte que realmente determina si un modelo ahorra dinero o crea coste operativo oculto.

Recomendación de decisión por tipo de equipo

Equipo A: Plataforma de programación sensible al coste

Equipo B: Aplicación empresarial con outputs de alto riesgo

Equipo C: Producto de contexto largo

DeepSeek V4 es especialmente atractivo porque combina:

- 1M de contexto oficial

- 384K de output muy amplio

- precios de output inusualmente bajos

Equipo D: Router de modelos mixto

El stack más limpio para muchos equipos ahora puede ser:

- DeepSeek V4 Flash para enrutamiento por defecto económico

- DeepSeek V4 Pro para razonamiento y programación más exigentes

- Claude Opus 4.7 o GPT-5.4 para escalamiento premium

Veredicto final

DeepSeek V4 importa porque cambia la economía del enrutamiento, no porque reemplace mágicamente cada modelo cerrado premium.

La conclusión más sólida ahora mismo es:

- Flash es un candidato serio como ruta por defecto

- Pro es una ruta premium seria de DeepSeek

- GPT-5.4 y Claude Opus 4.7 siguen importando para cargas de trabajo premium y de alto riesgo

- el mejor despliegue es por fases, no todo de golpe

Si tu equipo quiere un solo consejo en una frase, es este:

FAQ

¿Está DeepSeek V4 oficialmente disponible ahora?

deepseek-v4-flash y deepseek-v4-pro, y Reuters reportó el 24 de abril de 2026 que DeepSeek lanzó versiones preview de V4. DeepSeek API Docs Reuters via Investing.com¿Cuál debería probar primero: Flash o Pro?

¿Vale la pena DeepSeek V4 para equipos de programación?

Normalmente sí, si tu equipo es sensible al coste, genera mucho output, o hace trabajo de programación con contexto largo. Lo mejor es una evaluación por fases, no un reemplazo total inmediato.

¿Es DeepSeek V4 open-weight?

¿Es DeepSeek V4 más barato que GPT-5.4 y Claude Opus 4.7?

¿Debería usar DeepSeek V4 Flash o Pro para trabajo de programación a escala de repositorio?

¿Debería reemplazar Claude Opus 4.7 o GPT-5.4 de inmediato?

Normalmente no. Lo más seguro es el enrutamiento por fases: prueba Flash primero, evalúa Pro después, y mantén fallbacks premium hasta que confíes en V4 con tus cargas de trabajo reales.

¿Qué pasa con deepseek-chat y deepseek-reasoner?

deepseek-v4-flash. DeepSeek API Docs¿Dónde puedo encontrar los detalles oficiales de la ruta API de DeepSeek V4?

Fuentes

- DeepSeek API Docs

- DeepSeek Models & Pricing

- DeepSeek V4 Pro LICENSE on Hugging Face

- OpenAI API Pricing

- OpenAI GPT-5.4 Model

- Anthropic Claude Opus 4.7

- China's AI darling DeepSeek previews new model | Reuters via Investing.com

¿Listo para probar DeepSeek V4?

Lecturas relacionadas:

- DeepSeek V4 Is Live in Preview: Official API Models, Pricing, and What Changed

- DeepSeek V4 Flash & Pro vs GPT-5.4 vs Claude Opus 4.6: Official Pricing and Capability Comparison (referencia histórica — benchmark contra Opus 4.6)

- Mejor LLM para agentes de código: costo API, uso de herramientas y fiabilidad comparados — vea cómo se compara DeepSeek V4 para cargas de trabajo de agentes de código