DeepSeek V4 Flash/Pro vs GPT-5.4 vs Claude Opus 4.6: Precios oficiales y comparación de capacidades

Este artículo se publicó antes de que DeepSeek V4 estuviera documentado oficialmente. Se ha revisado por completo para reflejar el lanzamiento oficial en preview de DeepSeek V4, incluyendo IDs de modelo públicos, precios, contexto de 1M y la división entre Flash y Pro.

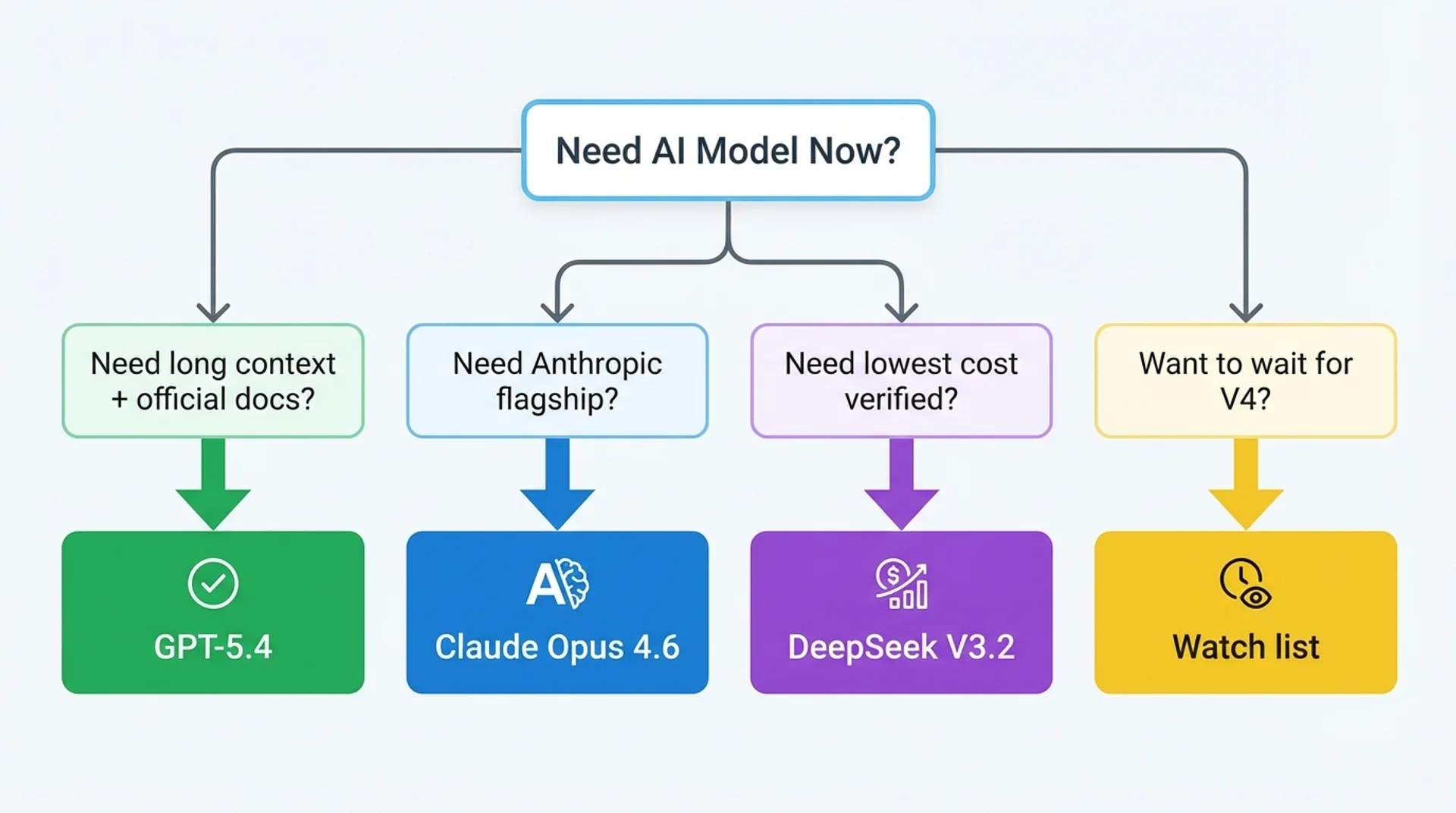

4.6. Considéralo como una línea base comparativa histórica que sigue siendo útil, no como la última palabra sobre la versión más reciente de Claude.deepseek-v4-flash y deepseek-v4-pro, y la página de precios publica precios, contexto de 1M y salida máxima de 384K. DeepSeek API Docs DeepSeek Models & PricingLa comparación ha pasado de "¿podemos verificar DeepSeek V4?" a una decisión más útil:

- ¿Cuándo es DeepSeek V4 Flash la mejor opción?

- ¿Cuándo vale la pena pagar por DeepSeek V4 Pro?

- ¿Cuándo deberían los equipos elegir GPT-5.4 o Claude Opus 4.6?

Resumen rápido

- DeepSeek V4 Flash — la opción oficialmente documentada más barata de este grupo: $0,14 input / $0,28 output por 1M tokens, 1M contexto, 384K salida máxima. El candidato más fuerte para coding masivo, routing de agentes y cargas de trabajo largas sensibles al coste. DeepSeek Models & Pricing

- DeepSeek V4 Pro — la ruta V4 de mayor inteligencia: $1,74 input / $3,48 output por 1M tokens. Mucho más barato que Claude Opus 4.6, output más económico que GPT-5.4. Mismo 1M contexto y 384K salida máxima. DeepSeek Models & Pricing

- GPT-5.4 — el buque insignia oficial de OpenAI para trabajo profesional complejo: 1.050.000 contexto, 128.000 salida máxima, $2,50 / $15,00. OpenAI Pricing OpenAI GPT-5.4 Model

- Claude Opus 4.6 — elección de primer nivel para coding y tareas de agentes: $5 / $25 por 1M tokens, 128K salida, 1M contexto en beta en la plataforma Claude. Anthropic Claude Opus 4.6

Información oficialmente verificable ahora

La tabla usa exclusivamente información oficial documentada por cada proveedor.

| Tema | DeepSeek V4 Flash | DeepSeek V4 Pro | GPT-5.4 | Claude Opus 4.6 |

|---|---|---|---|---|

| Proveedor | DeepSeek | DeepSeek | OpenAI | Anthropic |

| Estado | Preview API pública documentada | Preview API pública documentada | Documentado y disponible | Documentado y disponible |

| Precio input | $0,14 / 1M (cache miss) | $1,74 / 1M (cache miss) | $2,50 / 1M | $5,00 / 1M |

| Precio input cacheado | $0,028 / 1M | $0,145 / 1M | $0,25 / 1M | Variable según tier de caché/contexto largo |

| Precio output | $0,28 / 1M | $3,48 / 1M | $15,00 / 1M | $25,00 / 1M |

| Contexto | 1M | 1M | 1.050.000 | 1M (beta) |

| Salida máxima | 384K | 384K | 128K | 128K |

| Modo de razonamiento | Soportado | Soportado | Vía reasoning effort | Vía adaptive/extended thinking |

| Llamadas a herramientas | Soportadas | Soportadas | Soportadas | Soportadas |

| Posicionamiento | Ruta V4 de bajo coste | Ruta V4 de mayor inteligencia | Buque insignia OpenAI | Buque insignia Anthropic |

Los precios en la práctica

Los tres proveedores publican cifras oficiales, así que la comparación es directa.

| Modelo | Input | Input cacheado | Output | Conclusión práctica |

|---|---|---|---|---|

| DeepSeek V4 Flash | $0,14 | $0,028 | $0,28 | La ruta oficial más barata con diferencia |

| DeepSeek V4 Pro | $1,74 | $0,145 | $3,48 | Mucho más barato que Claude Opus 4.6, output bajo GPT-5.4 |

| GPT-5.4 | $2,50 | $0,25 | $15,00 | Ruta premium OpenAI para trabajo profesional complejo |

| Claude Opus 4.6 | $5,00 | Según tier | $25,00 | La más cara, pero modelo top de coding y agentes |

Dos conclusiones inmediatas:

- DeepSeek V4 Flash es el líder en costes con gran diferencia.

- DeepSeek V4 Pro ha pasado de "lista de observación sin verificar" a una opción premium real con buena relación coste-rendimiento.

Si el coste por token de salida importa en tu caso:

- V4 Flash output es mucho más barato que GPT-5.4 y Claude Opus 4.6

- V4 Pro output sigue siendo claramente inferior a GPT-5.4 y Claude Opus 4.6

El mayor cambio práctico: DeepSeek V4 ahora es Flash vs Pro

Los artículos anteriores trataban V4 como un único modelo hipotético. Eso ya no es preciso para la toma de decisiones.

El enfoque más útil hoy:

- Elegir Flash — cuando coste, throughput y despliegue amplio son lo primero

- Elegir Pro — cuando necesitas mayor calidad de razonamiento pero quieres evitar precios de modelos cerrados

DeepSeek V4 no es tanto un competidor único de GPT-5.4 u Opus 4.6 como una familia de dos niveles.

Qué modelo encaja en cada flujo de trabajo

DeepSeek V4 Flash: la mejor relación coste-rendimiento

Flash es ideal cuando necesitas:

- Asistencia de coding en gran volumen

- Pipelines de agentes sensibles al coste

- Procesamiento de documentos o repositorios con contexto largo

- Defaults de routing que deben mantenerse baratos

DeepSeek V4 Pro: ruta premium V4 sin precios de modelo cerrado

Pro encaja mejor cuando necesitas:

- Razonamiento más profundo que una ruta de bajo coste

- Tareas de coding y análisis más difíciles

- Salida estructurada de formato largo

- Un paso arriba de Flash sin saltar a precios de Claude Opus 4.6

Para muchos equipos, Pro no es un sustituto universal de GPT-5.4 u Opus 4.6, sino una opción premium de menor coste que merece evaluarse en paralelo.

GPT-5.4: el buque insignia oficial de OpenAI

GPT-5.4 sigue siendo atractivo cuando quieres:

- Soporte oficial de la plataforma OpenAI

- Ventana de contexto documentada de 1.050.000

- 128.000 de salida máxima

- Flujo de trabajo familiar de desarrollador OpenAI

Claude Opus 4.6: prioridad en coding y agentes de Anthropic

Claude Opus 4.6 destaca cuando quieres:

- El modelo de coding insignia de Anthropic

- Controles de extended y adaptive thinking

- Flujos de trabajo de agentes de larga ejecución

- Funciones de la plataforma Claude como compactación de contexto y 1M contexto beta

Contexto y límites de salida importan más que antes

La actualización de DeepSeek V4 también cambia la conversación sobre contexto largo.

Antes, una razón práctica para elegir GPT-5.4 o Claude Opus 4.6 era que DeepSeek V4 no estaba documentado públicamente. Ahora que Flash y Pro ofrecen:

- 1M contexto

- 384K salida máxima

DeepSeek entra oficialmente en la misma conversación de planificación. Esto importa para:

- Comprensión de código a escala de repositorio

- Documentos legales o de investigación extensos

- Bucles largos de agentes multietapa

- Tareas que necesitan salidas individuales muy grandes

En margen de salida máxima pura, DeepSeek V4 supera claramente a GPT-5.4 y Claude Opus 4.6 según la documentación oficial actual.

Recomendación por caso de uso

| Caso de uso | Mejor opción | Por qué |

|---|---|---|

| Ruta oficial de contexto largo más barata | DeepSeek V4 Flash | Precio oficial más bajo con 1M contexto y 384K salida |

| Ruta premium DeepSeek más potente | DeepSeek V4 Pro | Opción V4 de gama alta sin precios GPT/Claude |

| Buque insignia oficial OpenAI | GPT-5.4 | Flagship documentado con 1.050.000 contexto y 128K salida |

| Modelo top de coding y agentes de Anthropic | Claude Opus 4.6 | Flagship Anthropic con 1M beta y 128K salida |

| Evaluar un modelo para routing amplio de producción | Flash → Pro | Flash para routing sensible al coste; Pro para cargas más difíciles |

Qué cambió respecto a la conclusión de marzo 2026

Conclusión anterior:

- DeepSeek V4 estaba en lista de observación

- V3.2 era la baseline oficial práctica de DeepSeek

- Los equipos no debían presupuestar con V4

Eso ya no es correcto.

- DeepSeek V4 está oficialmente documentado y disponible en preview

- Flash y Pro deben evaluarse directamente

- V3.2 ya no es la baseline correcta para comparaciones centradas en V4

FAQ

1. ¿DeepSeek V4 está oficialmente disponible?

deepseek-v4-flash y deepseek-v4-pro, y Reuters informó del lanzamiento preview el 24 de abril de 2026. DeepSeek API Docs Reuters via Investing.com2. ¿Puedo comparar precios de DeepSeek V4 con GPT-5.4 y Claude Opus 4.6 de forma responsable?

3. ¿Cuál probar primero: Flash o Pro?

Para la mayoría de equipos, Flash. Es dramáticamente más barato manteniendo 1M contexto y 384K salida máxima. Si tus cargas requieren razonamiento o coding más difícil, prueba Pro después.

4. ¿GPT-5.4 sigue teniendo ventajas?

5. ¿Claude Opus 4.6 sigue teniendo ventajas?

6. ¿Cuál es la opción oficial más barata de esta comparación?

7. ¿Debería seguir usando DeepSeek-V3.2 como baseline de presupuesto?

No para planificación V4. V4 Flash y V4 Pro son la baseline correcta actual.

8. ¿Dónde encuentro detalles de routing e implementación?

Fuentes

- DeepSeek API Docs

- DeepSeek Models & Pricing

- OpenAI API Pricing

- OpenAI GPT-5.4 Model

- Anthropic Claude Opus 4.6

- Anthropic Claude Opus 4.7

- China's AI darling DeepSeek previews new model | Reuters via Investing.com