Was Chinas Frühlingsfest-Gala 2026 über ByteDances KI-Video-Stack verriet

Die Gala zeigte, wie ByteDance mehrere KI-Schichten zusammen positioniert:

- Videogenerierung

- Sprache und Interaktion

- Live-Produktionsinfrastruktur

Warum die Gala wichtig war

| Signal | Warum es wichtig war |

|---|---|

| KI war in einer nationalen Mainstream-Sendung sichtbar | Es verlagerte die Diskussion über Lab-Demos hinaus |

| Mehrere ByteDance-KI-Oberflächen traten gemeinsam auf | Es deutete auf einen koordinierten Produkt-Stack hin, nicht auf isolierte Experimente |

| Der Kontext war live, unter hohem Druck und öffentlich | Es implizierte Vertrauen in produktionsreife Bereitstellung |

| Massive verifizierte Reichweite | CMG meldete 677 Millionen All-Media-Live-Reichweite; die Spitzenzuschauerzahl überstieg 400 Millionen |

Seedance 2.0: Was es repräsentierte

Der interessanteste Seedance-Aspekt war nicht nur, dass KI-generierte Visuals in einer großen Sendung erschienen.

Das ist wichtig, weil Seedance 2.0 leichter zu verstehen ist, wenn man aufhört, es als Neuheitsgenerator zu betrachten und stattdessen als Werkzeug für:

- visuelle Regie

- strukturierte Bewegung

- Szenengestaltung

- stilisiertes Spektakel im großen Maßstab

Der Gala-Kontext verstärkte genau diese Positionierung.

Der herausragende KI-Moment war He Hua Shen (《贺花神》, „Ode an die Blumengötter"), eine Tanzperformance, bei der KI-generierte Visuals von blühenden Blumen, fließendem Wasser und jahreszeitlichen Übergängen nahtlos mit Live-Künstlern integriert wurden. Was dies technisch bedeutsam machte:

- Nahaufnahmen erforderten pixelgenaue Generierung — jedes Zittern oder jede Verzerrung wäre für Hunderte Millionen Zuschauer sichtbar gewesen

- Mikroveränderungen wie das langsame Aufblühen einer Blume erforderten präzise zeitliche Kontrolle über Textur, Ebenen, Licht und Schatten

- ByteDance beschrieb dies als einen Wandel von „KI-generierten Inhalten" zu „KI-gesteuerten Inhalten"

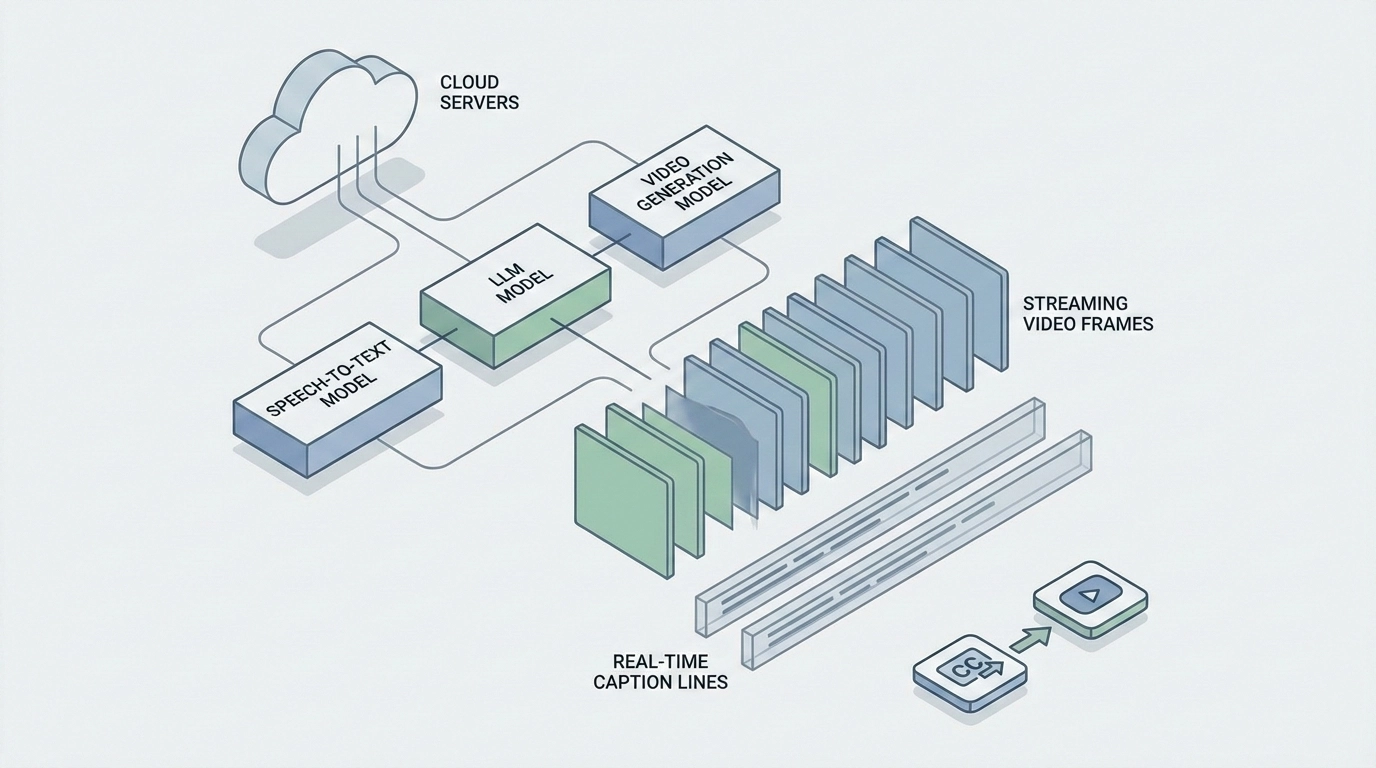

Doubao und der breitere ByteDance-Stack

Seedance war nur eine Schicht.

| Schicht | Was die Gala nahelegte |

|---|---|

| Videogenerierung | Seedance-artige visuelle Erstellung und Szenenunterstützung |

| Sprache / Interaktion | Doubao-artige Reasoning- und Kommunikationsoberflächen |

| Infrastruktur | Eine Cloud- und Produktionsschicht, die ein öffentliches Großereignis unterstützen kann |

Der Umfang der Bereitstellung war beachtlich:

- Über 800 Milliarden Tokens tägliche Verarbeitung auf der Volcengine-Plattform

- Über 1 Million Unternehmen nutzen Volcengine-KI-Dienste in über 100 Branchen

Diese Kombination ist strategisch wichtig. Sie deutet darauf hin, dass ByteDance nicht nur isolierte Modellqualität anstrebt. Es baut ein Ökosystem auf, in dem verschiedene KI-Komponenten sich gegenseitig verstärken.

Warum dies größer war als eine einzelne Performance

Ereignisse wie die Frühlingsfest-Gala sind wichtig, weil sie die Wahrnehmung verändern.

Vor einer öffentlichen Sendung wie dieser leben viele Modelldiskussionen in:

- Benchmarks

- Social-Media-Demos

- Entwicklerkreisen

Nach einer solchen Sendung wird die Diskussion zu:

- Können diese Systeme echte Produktion unterstützen?

- Können sie Druck und Skalierung bewältigen?

- Können KI-generierte Medien Teil kreativer Mainstream-Pipelines werden?

Das ist die Verschiebung, die diese Gala darstellte.

Die sichtbare Schicht: Robotik

Die Roboter waren die sichtbare Schicht eines tieferen KI-Stacks. Vier Robotik-Unternehmen lieferten Performances:

- Unitree G1-Roboter führten Kung-Fu-Rückwärtssaltos vor

- Noetix Bumi-Roboter spielten einen Comedy-Sketch mit der erfahrenen Schauspielerin Cai Ming, komplett mit einem lebensechten bionischen Roboter-Doppelgänger mit 32 Gesichtsmotoren

- MagicLab-Roboter tanzten zu „We Are Made in China"

- Galbot lieferte weitere Roboterperformances

Ohne Doubaos Sprachmodelle konnten die Roboter nicht mit menschlichen Darstellern interagieren. Ohne Seedance hätten die visuellen Spektakel nicht existiert. Ohne Volcengines Infrastruktur wären die Echtzeit-Interaktionen unter der Last zusammengebrochen.

Was die Gala über ByteDances Strategie aussagte

Die klarste strategische Lesart ist, dass ByteDance in mehr als einer KI-Kategorie ernst genommen werden will.

Das Ereignis deutete auf eine Produktgeschichte hin, die aufgebaut ist um:

- Mediengenerierung

- Assistenten-artige Intelligenz

- Infrastrukturunterstützung

- hohe Sichtbarkeit bei Verbrauchern und Unternehmen

Das ist ein deutlich größerer Anspruch als „wir haben ein gutes Videomodell."

Warum Entwickler und Produktteams sich dafür interessieren sollten

Selbst wenn Sie nie für ein Gala-großes Ereignis bauen, ist dies relevant, weil es andeutet, wie ByteDance seinen KI-Stack auf dem breiteren Markt positionieren will.

Für Entwickler und Produktteams ist die Erkenntnis nicht „kopiert die Gala."

Sondern:

ByteDance versucht, seine KI-Produkte als Teile eines Stacks zu positionieren, nicht als losgelöste Einzelwerkzeuge.

Das beeinflusst, wie Teams zukünftige Modell-Launches, Ökosystemänderungen und Plattformentscheidungen des Unternehmens interpretieren sollten.

Chinesische KI-Modelle über API verfügbar

Viele der Modelle, die die Gala-Technologie antrieben oder damit in Verbindung stehen, sind über eine API zugänglich:

| Modell | Typ | Gala-Verbindung |

|---|---|---|

| Seedance | Video Generation | Trieb die visuellen Effekte der Frühlingsfest-Gala an |

| Seedream | Image Generation | ByteDances Bildmodell (aktualisiert zusammen mit Seedance 2.0) |

| Kling | Video Generation | Kuaishous führendes Text-zu-Video-System |

| Wan 2.6 | Video Generation | Alibabas Videogenerierungsmodell |

| DeepSeek | Language Model | Chinas führendes Open-Source-Reasoning-Modell |

| Doubao | Language Model | Das Gehirn hinter den KI-Interaktionen der Gala |

Warum das bei EvoLink wichtig ist

Für EvoLink ist der Wert einer solchen Geschichte nicht, dass sie für ByteDance wirbt.

Sondern dass sie Teams einen Grund gibt, Modellfamilien von einem Ort aus zu vergleichen und zu routen:

- ByteDance-Familien-Video-Routen

- andere chinesische Videomodelle

- Nicht-ByteDance-Alternativen

Abschließende Einschätzung

Die Frühlingsfest-Gala 2026 war nicht nur ein kulturelles Ereignis mit KI-Dekoration.

Es war eine öffentlichkeitswirksame Demonstration, wie ByteDance seinen KI-Stack rahmen will:

- Seedance für visuelle Generierung

- Doubao für Intelligenz und Interaktion

- eine breitere Infrastrukturschicht für Bereitstellung in öffentlichem Maßstab

Deshalb war die Gala wichtig. Sie verwandelte ByteDances KI-Geschichte von einer Sammlung von Produktseiten in eine sichtbare Ökosystem-Erzählung.

FAQ

Warum war Seedance 2.0 für die Gala-Geschichte relevant?

Weil das Ereignis KI-generiertes visuelles Spektakel hervorhob, was zu Seedance 2.0s breiterer Positionierung als Videogenerierungsschicht innerhalb von ByteDances Stack passt.

War die Gala hauptsächlich eine Roboter-Geschichte?

Nein. Die wichtigere Lesart ist, dass sie einen breiteren KI-Stack über Medien, Interaktion und Produktionsinfrastruktur hinweg präsentierte.

Warum ist Doubao in diesem Kontext wichtig?

Weil es die Sprach- und Interaktionsschicht in ByteDances breiterer KI-Strategie repräsentiert.

Was legte die Gala über ByteDances KI-Richtung nahe?

Sie deutete darauf hin, dass ByteDance als Erbauer eines integrierten KI-Ökosystems wahrgenommen werden will, nicht als Anbieter isolierter Einzelmodelle.

Warum sollten sich Entwickler für ein Fernsehereignis wie dieses interessieren?

Weil große öffentliche Ereignisse Produktambitionen, Positionierung und Vertrauen in Produktionsbereitschaft in einem Maßstab offenlegen können, den normale Demos nicht erreichen.

Sollte dieser Artikel den API-Zugang erklären?

Nein. Dieser Artikel befasst sich mit der Marktbedeutung des Ereignisses, nicht mit Zugang oder Preisen.