Alibaba enthüllt Qwen3-Max-Thinking: Ein Billionen-Parameter-Gigant kommt bald zu evolink.ai

Wichtigste Erkenntnis: Alibaba Clouds Qwen-Team hat Qwen3-Max-Thinking veröffentlicht, ein Billionen-Parameter-Flaggschiffmodell, das direkt mit GPT-5.2 und Claude Opus 4.5 konkurriert. evolink.ai wird bald stabilen, kostengünstigen offiziellen API-Zugang bieten.

Qwen3-Max-Thinking auf einen Blick

Technische Daten

- Gesamtparameter: Über 1 Billion (1T)

- Pre-Training-Daten: 36T Tokens

- Modellvarianten: Base, Instruct und Thinking Editionen

- Globales Standing: Unter den weltweit größten KI-Modellen

- Zugangsoptionen: Qwen App (Desktop/Web) + API-Aufrufe

- Offizielle Website: https://chat.qwen.ai/

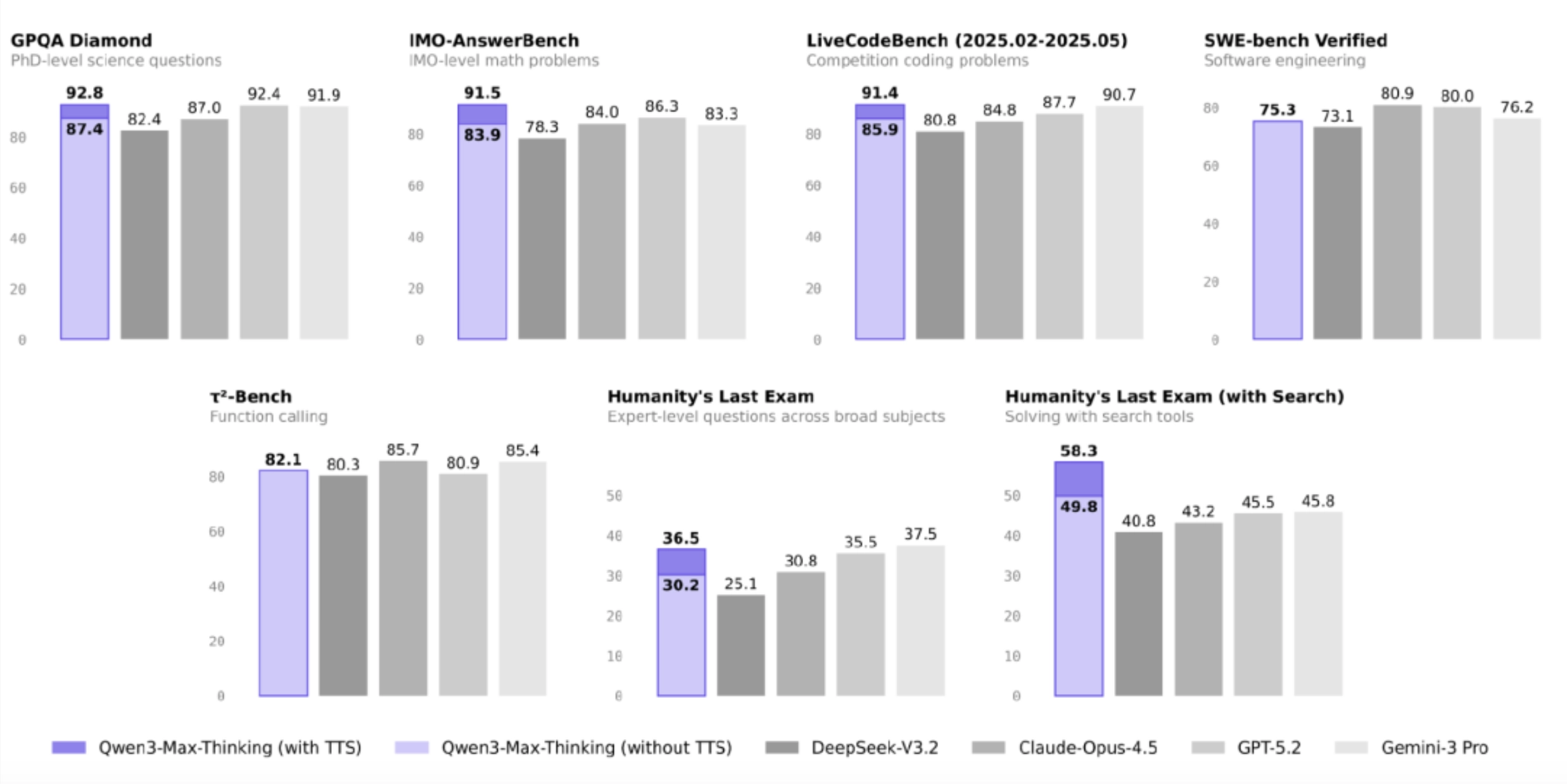

Benchmark-Leistungsduell

Qwen3-Max-Thinking erreicht oder übertrifft führende Closed-Source-Modelle (GPT-5.2-Thinking, Claude-Opus-4.5, Gemini-3 Pro) in wichtigen KI-Benchmarks:

| Benchmark | Qwen3-Max-Thinking | Im Vergleich zu | Bereich |

|---|---|---|---|

| GPQA Diamond | SOTA-Level | GPT-5.2 / Claude | Wissenschaftliche F&A |

| IMO Math Test | 91,5 | Gemini-3 Pro | Mathematisches Denken |

| LiveCodeBench v6 | 91,4 | Claude Opus 4.5 | Codegenerierung |

| HLE (mit Tools) | 58,3 | GPT-5.2 | Erweitertes Denken + Tool-Nutzung |

Programmier-Kraftpaket

Wenn es um Codegenerierung und Programmieraufgaben geht, glänzt Qwen3-Max-Thinking wirklich. Sein Score von 91,4 im LiveCodeBench bringt es in die gleiche Liga wie Gemini und Claude – ein Game-Changer für Entwickler.

Zwei bahnbrechende Innovationen

1. Adaptiver Tool-Aufruf (Adaptive Tool Calling)

| Traditioneller Ansatz | Qwen3-Max-Thinking |

|---|---|

| Benutzer wählen Tools manuell aus | Modell entscheidet und ruft autonom auf |

| Ausführung einer einzelnen Funktion | Suche + Speicher + Code-Interpreter synchron |

| Anfällig für Halluzinationen | Echtzeit-Verifizierung reduziert Fehler |

- ✅ Intelligente Suche: Ruft automatisch aktuelle Informationen ab

- ✅ Speichersystem: Personalisiertes Kontextverständnis

- ✅ Code-Interpreter: Führt Code-Snippets spontan aus

- ✅ Halluzinationsminderung: Mehrquellen-Validierung für Genauigkeit

2. Skalierung zur Testzeit (Test-Time Scaling)

- GPQA: 90,3 → 92,8 (+2,5)

- HLE: 34,1 → 36,5 (+2,4)

- LiveCodeBench v6: 88,0 → 91,4 (+3,4)

- IMO-AnswerBench: 89,5 → 91,5 (+2,0)

- HLE (mit Tools): 55,8 → 58,3 (+2,5)

Bei gleichem Token-Budget übertrifft dieser Ansatz konsistent das Standard-Parallel-Sampling und steigert die Leistung bei komplexen Aufgaben dramatisch.

Warum evolink.ai wählen

Ihr Tor zu Qwen3-Max-Thinking

🏆 Zuverlässigkeit auf Unternehmensniveau

- 99,9% Uptime-Garantie: Felsenfeste 24/7-Verfügbarkeit

- Intelligentes Load Balancing: Keine Aussetzer während der Spitzenzeiten

- Disaster Recovery: Multi-Node-Bereitstellung mit automatischem Failover

💰 Unschlagbare Preise

-

Pay-As-You-Go: Zahlen Sie nur für die Tokens, die Sie tatsächlich nutzen

-

Kristallklare Abrechnung: Echtzeit-Nutzungs

-

und Kostenverfolgung

-

Mengenrabatte: Gestaffelte Preise für Unternehmenskunden

🤝 Offizielle Partnerschaft

-

Direkte Alibaba Cloud Verbindung: First-Party API-Ressourcen

-

SLA-gestützte Qualität: Service-Level-Agreements, auf die Sie sich verlassen können

-

Early Access: Erhalten Sie neue Funktionen als Erste

-

Dedizierter Support: Technische Unterstützung rund um die Uhr

🚀 Für wen es ist

| Benutzertyp | Empfohlener Plan | Hauptvorteile |

|---|---|---|

| Individuelle Entwickler | Pay-As-You-Go | Risikoarmes Experimentieren, flexible Nutzung |

| Startups | Standardpaket | Vorhersehbare Kosten, schnelle Integration |

Was Sie bekommen

-

✅ Billionen-Parameter-Denken

-

Bewältigen Sie komplexe Geschäftslogik und mehrstufige Workflows

-

✅ Erstklassige Codegenerierung

-

Unterstützung für 50+ Programmiersprachen, 3-facher Produktivitätsschub

-

✅ **Mathe

-

& Logik-Meisterschaft**

-

Lösen Sie Finanzmodellierung, wissenschaftliches Rechnen und mehr

-

✅ Adaptive Tool-Auswahl

-

Wählt automatisch die optimale Toolchain für jede Aufgabe

-

✅ Echtzeit-Informationen

-

Web-Suchintegration hält Antworten frisch und genau

Ein Meilenstein für chinesische KI

Beitritt zur globalen Elite

-

Parameterskala: Billionen-Level, auf Augenhöhe mit GPT-5

-

Leistung in der realen Welt: Schlägt internationale Marktführer in mehreren Benchmarks

-

Technische Innovation: Pionierarbeit bei adaptivem Tool-Aufruf und Testzeit-Skalierung

-

Iterationsgeschwindigkeit: Internationale Entwickler bemerken, "sie liefern schneller als OpenAI"

Was Entwickler sagen

"Qwen übertrifft die Konkurrenz konsequent." — Internationaler Entwickler

"Das ist genau das Qwen-Release, auf das ich gewartet habe." — Harriett Solid

"Qwens Update-Kadenz und Fähigkeitsoffenlegungen haben OpenAI übertroffen." — Tech-Community-Mitglied

FAQ

F1: Wann wird Qwen3-Max-Thinking auf evolink.ai verfügbar sein?

F2: Sind Ihre Preise besser als die offizielle API?

-

Mengenrabatte beim Kauf

-

Null versteckte Gebühren

-

Besseres Preis-Leistungs-Verhältnis als direkte API-Aufrufe

F3: Welche Integrationsmethoden unterstützen Sie?

-

RESTful API

-

Python SDK

-

JavaScript SDK

-

Webbasierte Schnittstelle

F4: Wie gehen Sie mit Datensicherheit um?

-

Bei Übertragung: TLS 1.3 Verschlüsselung

-

Im Ruhezustand: Wir speichern keine Konversationsdaten

-

Compliance: DSGVO-konform, China Level 3 zertifiziert

-

Datenschutz: Strenge Einhaltung der Datenschutzbestimmungen

F5: Wie fange ich an?

-

Registrieren Sie sich auf evolink.ai

-

Holen Sie sich Ihren API-Schlüssel

-

Folgen Sie unserer Dokumentation – Sie sind in 5 Minuten einsatzbereit

Testen Sie Qwen3-Max-Thinking noch heute

Offizielle Kanäle

- Qwen App: https://chat.qwen.ai/

- API-Dokumentation: https://qwen.ai/blog?id=qwen3-max-thinking

Über evolink.ai

evolink.ai ist eine führende KI-Integrationsplattform, die Entwickler und Unternehmen unterstützt mit:

- 🌐 Multi-Modell-Zugang: GPT, Claude, Gemini, Qwen und mehr

- 💼 Unternehmensbereit: Stabil, sicher und konform

- 💰 Bester Wert seiner Klasse: Offizielle Kanäle, transparente Preise

- 🛠️ Entwickler zuerst: Umfassende Dokumentation, schnelle Integration

- Alibaba Qwen Offizieller Blog: https://qwen.ai/blog?id=qwen3-max-thinking

- Qwen Chat: https://chat.qwen.ai/

- AI Frontier: Alibaba durchbricht die Billionen-Parameter-Grenze mit Qwen3-Max-Thinking