OpenRouter vs liteLLM vs Eigenentwicklung vs Managed: Wahl einer LLM-Abstraktionsstrategie

OpenRouter vs liteLLM vs Eigenentwicklung vs Managed

Da die LLM-Nutzung wächst, erreichen viele Teams denselben Wendepunkt:

"Direkte APIs reichen nicht mehr – aber was soll dazwischen stehen?"

In diesem Stadium ist die Frage selten, ob eine Abstraktionsschicht eingeführt werden soll. Die eigentliche Frage ist, welche Abstraktionsstrategie zu Ihren Einschränkungen passt.

Dieser Artikel vergleicht vier gängige Ansätze:

- OpenRouter

- liteLLM

- Bau eines internen Gateways (Eigenentwicklung)

- Verwendung eines Managed Gateway

Das Ziel ist nicht, Tools zu bewerten, sondern Grenzen, Kompromisse und Entscheidungskriterien zu klären.

Die vier Ansätze, klar definiert

Vor dem Vergleich hilft es zu definieren, was jede Option tatsächlich darstellt.

OpenRouter

Eine gehostete Routing-Schicht, die den Zugriff auf viele LLM-Anbieter hinter einer einheitlichen API-Oberfläche aggregiert.

Teams nutzen es typischerweise, um:

- Schnell auf mehrere Modelle zuzugreifen

- Die Verwaltung einzelner Anbieterverträge zu vermeiden

- Mit minimalem Aufwand über Anbieter hinweg zu experimentieren

liteLLM

Ein Open-Source-Proxy, den Teams selbst bereitstellen und betreiben.

Es wird oft verwendet, um:

- API-Schemata zu normalisieren

- Grundlegendes Routing oder Fallback zu implementieren

- Die Kontrolle über Infrastruktur und Datenpfade zu behalten

Eigenentwicklung (Internes Gateway)

Eine benutzerdefinierte Abstraktionsschicht, die vom Team entworfen, besessen und betrieben wird.

Häufige Motivationen sind:

-

Volle Kontrolle über Verhalten und Verträge

-

Tiefe Integration in interne Systeme

-

Benutzerdefinierte Zuverlässigkeits-, Richtlinien

-

oder Kostenlogik

Managed Gateway

Eine gehostete Abstraktionsschicht, die von einem Dritten betrieben wird.

Teams wählen dies typischerweise, wenn:

-

Infrastruktureigentum keine Kernkompetenz ist

-

Zuverlässigkeit, Observability und Governance wichtig sind

-

Time-to-Production kritisch ist

Worauf diese Optionen optimieren

Jeder Ansatz optimiert für unterschiedliche Einschränkungen, nicht für unterschiedliche Niveaus von "Qualität".

-

Zugriffsgeschwindigkeit auf viele Modelle

-

Geringen operativen Aufwand

-

Experimentieren und Breite

-

Kontrolle über das Deployment

-

Open-Source-Flexibilität

-

DIY-Infrastruktur-Workflows

-

Maximale Anpassung

-

Enge Integration mit internen Systemen

-

Explizite Kontrolle über Verträge und Verhalten

-

Reduzierte operative Belastung

-

Zuverlässigkeit und Observability auf Produktionsniveau

-

Klare Abstraktionsgrenzen

Zu verstehen, wofür jede Option optimiert, ist wichtiger als Funktionschecklisten.

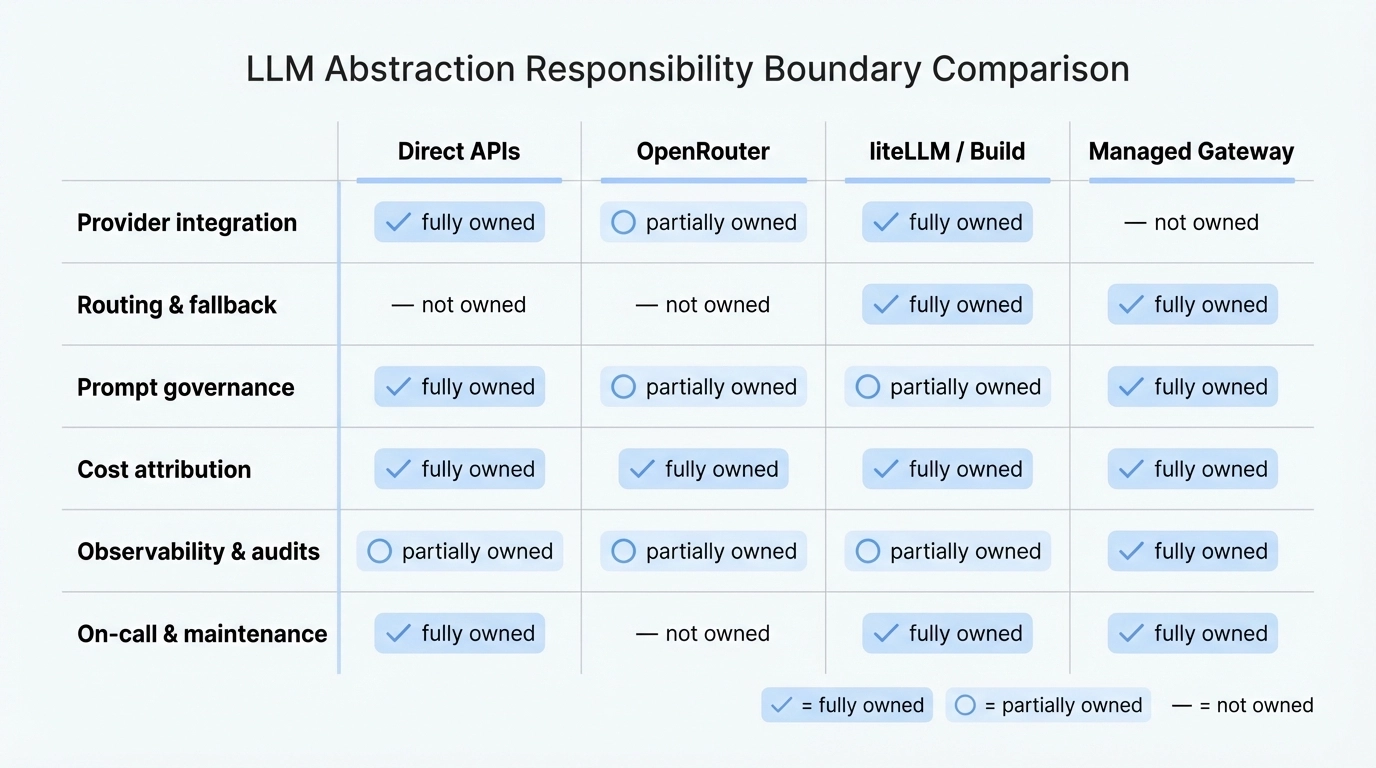

Ein praktischer Vergleich

| Dimension | OpenRouter | liteLLM | Eigenentwicklung | Managed |

|---|---|---|---|---|

| Einrichtungsgeschwindigkeit | Sehr schnell | Moderat | Langsam | Schnell |

| Operatives Eigentum | Extern | Intern | Intern | Extern |

| Benutzerdefiniertes Verhalten | Begrenzt | Moderat | Voll | Moderat–Hoch |

| Observability & Audits | Plattformdefiniert | DIY | DIY | Integriert |

| Skalierung über Teams hinweg | Moderat | Schwierig | Schwierig | Einfacher |

| Langfristige Wartung | Gering | Laufend | Hoch | Gering–Moderat |

Diese Tabelle ist keine Empfehlung. Sie hebt hervor, wo sich Kosten und Komplexität ansammeln.

Wann jede Option tendenziell Sinn macht

OpenRouter ist oft gut geeignet, wenn:

-

Sie schnell breiten Modellzugang benötigen

-

Sie Infrastrukturinvestitionen minimieren wollen

-

Die Nutzung explorativ oder nicht kritisch ist

-

Anbieterwechsel erwartet wird

liteLLM wird oft gewählt, wenn:

-

Sie Open-Source-Kontrolle wollen

-

Sie sich wohl dabei fühlen, Infrastruktur zu betreiben

-

Die Anforderungen sich noch entwickeln

-

Governance und Observability zweitrangig sind

Eigenentwicklung macht Sinn, wenn:

-

LLMs Kern Ihres Produkts sind

-

Verträge, Richtlinien und SLAs nicht verhandelbar sind

-

Sie über Infrastrukturexpertise und lange Zeithorizonte verfügen

-

Die Abstraktion selbst ein Wettbewerbsvorteil ist

Managed Gateways funktionieren tendenziell, wenn:

-

Zuverlässigkeit und Überprüfbarkeit wichtig sind

-

Mehrere Teams von LLMs abhängen

-

Sie klare operative Garantien wünschen

-

Sie Infrastruktur lieber einkaufen als dafür Personal bereitzustellen

Die versteckten Kosten, die Teams oft übersehen

Die meisten Teams konzentrieren sich auf API-Kompatibilität. Sie unterschätzen organisatorische und operative Kosten.

Häufig übersehene Faktoren sind:

-

On-Call-Verantwortung für die Abstraktionsschicht

-

Debugging von anbieterübergreifenden Fehlern

-

Pflege von Evaluierungs-Baselines für Routing-Entscheidungen

-

Abstimmung von Richtlinienänderungen über Teams hinweg

-

Genauigkeit der Kostenzuordnung im Zeitverlauf

Diese Kosten tauchen meist auf, nachdem die Abstraktion eingeführt wurde, nicht vorher.

Eine Entscheidungs-Checkliste

Wenn Sie mehrere der folgenden Fragen mit "Ja" beantworten, ist Ihre Wahl wichtiger als das Tool selbst:

-

Hängen mehrere Teams von der Abstraktionsschicht ab?

-

Werden Zuverlässigkeitsgarantien explizit?

-

Erfordern Richtlinien

-

oder Prompt-Änderungen Koordination?

-

Ist eine Kostenzuordnung über die Gesamtausgaben hinaus erforderlich?

-

Würden Ausfälle kritische Benutzerflüsse beeinträchtigen?

Wenn nicht, können leichtere Optionen ausreichend bleiben.

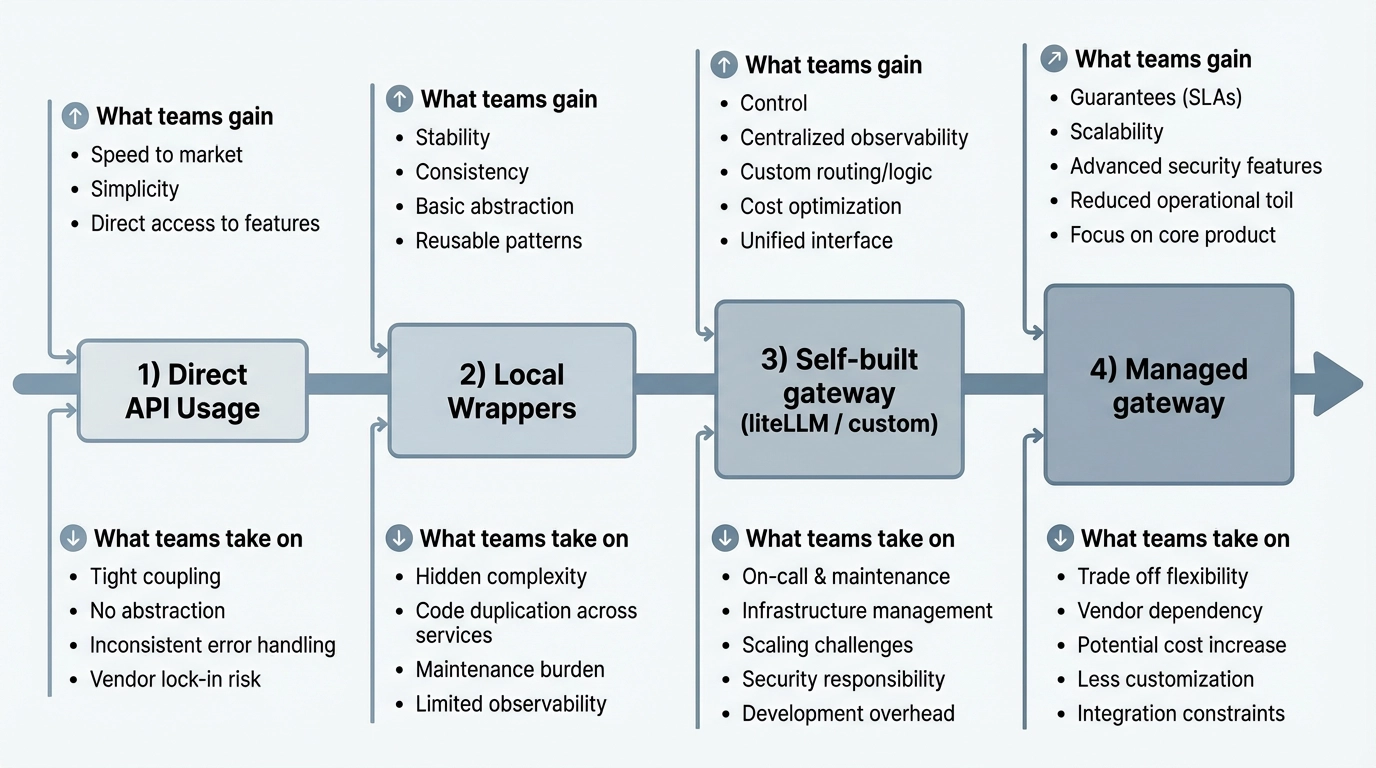

Wie dies in den breiteren Architekturpfad passt

In der Praxis durchlaufen Teams oft diese Phasen:

-

Direkte APIs

-

Lokale Wrapper

-

Zentralisierte Abstraktion

-

Explizite Gateway-Strategie

Der Übergang dreht sich nicht nur um Skalierung. Es geht um Koordinationskosten und Risikotoleranz.

Verschiedene Teams stoppen an verschiedenen Punkten – und das wird erwartet.

In der Praxis: Wie "Modellzugang durch eine Abstraktion" aussieht

In der Praxis bestimmt die Abstraktionswahl, wie Anwendungscode auf Modelle verweist:

-

entweder durch direkte Bindung an anbieterspezifische Bezeichner oder

-

durch eine stabile interne Benennungsschicht (z.

Für ein konkretes Beispiel, wie eine "Modellreferenz"-Seite in diesem Muster aussieht:

- Beispiel für Modellreferenz: GPT-5.2 Modellseite

Schlussgedanke

Es gibt keine universell "richtige" Abstraktionsstrategie. Jede Option stellt einen Kompromiss zwischen Kontrolle, Geschwindigkeit und Verantwortung dar. Der wirkliche Fehler ist, basierend auf Oberflächenmerkmalen zu wählen, anstatt zu verstehen:

-

Welche Komplexität Sie auf sich nehmen

-

Welche Garantien Sie erwarten

-

Wer die Konsequenzen tragen wird

Klare Absicht ist wichtiger als das spezifische Tool.

👉 Nächster Schritt

schlüsselt dieser Leitfaden auf, wann direkte APIs noch funktionieren – und wann sich ein Gateway bezahlt macht.

FAQ

Ist OpenRouter ein Gateway oder nur ein Router?

Es fungiert als gehostete Routing-Schicht, optimiert für Zugang und Breite statt für tiefe organisatorische Governance.

Ist liteLLM genug für die Produktion?

Das kann es sein, abhängig davon, wie viel Infrastruktur, Observability und operative Disziplin ein Team bereit ist, bereitzustellen.

Warum nicht immer intern entwickeln?

Eigenentwicklung bietet Kontrolle, verursacht aber auch langfristige Wartungs- und Personalkosten, die viele Teams unterschätzen.