GPT Image 1.5: Vollständiger Leitfaden zu Funktionen, Vergleich & Zugriff (2026)

Sie starren auf ein Produktbild, das drei Variationen für unterschiedliche Märkte benötigt – gleiche Beleuchtung, gleicher Winkel, aber unterschiedliche Hintergründe und Text-Overlays. Ihr Designer ist für die nächsten zwei Wochen ausgebucht, und die Kampagne startet am Montag. Was wäre, wenn Sie diese Änderungen selbst in wenigen Minuten vornehmen könnten, wobei die perfekte Konsistenz über jede Iteration hinweg gewahrt bleibt, ohne Photoshop anzufassen?

Inhaltsverzeichnis

- Was ist GPT Image 1.5? Das neueste Bildmodell von OpenAI verstehen

- Kernfunktionen, die GPT Image 1.5 von anderen abheben

- Geschwindigkeitsleistung: 4x schnellere Generierung erklärt

- Präzisionsbearbeitung: Wie die Detailerhaltung tatsächlich funktioniert

- Textwiedergabefähigkeiten und Einschränkungen

- GPT Image 1.5 vs. GPT Image 1: Was hat sich geändert?

- Umfassender Modellvergleich: GPT Image 1.5 vs. Wettbewerber

- Zugriff auf GPT Image 1.5: Leitfaden zur ChatGPT-Benutzeroberfläche

- API-Zugriff über EvoLink.AI und die OpenAI-Plattform

- Preisstruktur und Strategien zur Kostenoptimierung

- Reale Anwendungsfälle und Applikationen

- Fortgeschrittenes Prompt-Engineering für bessere Ergebnisse

- Häufige Fehler, die bei der Verwendung von GPT Image 1.5 zu vermeiden sind

- Einschränkungen und wann man alternative Werkzeuge wählen sollte

- Häufig gestellte Fragen (FAQs)

Was ist GPT Image 1.5? Das neueste Bildmodell von OpenAI verstehen

gpt-image-1.5-lite bezeichnet) repräsentiert das Flaggschiff-Bildgenerierungssystem der zweiten Generation von OpenAI. Es wurde am 16. Dezember 2025 als Engine für die neu gestaltete ChatGPT-Bilderfunktion eingeführt. Im Gegensatz zu seinem Vorgänger GPT Image 1, das im April 2025 primär für die experimentelle kreative Exploration eingeführt wurde, wurde GPT Image 1.5 von Grund auf für Produktionsumgebungen konzipiert, in denen Konsistenz, Geschwindigkeit und präzise Kontrolle wichtiger sind als künstlerische Überraschungen.Die Bezeichnung "1.5" signalisiert eine iterative Verfeinerung statt einer kompletten architektonischen Überholung. OpenAI behielt die kernbasierte Transformer-Diffusionsarchitektur bei, implementierte jedoch signifikante Optimierungen in drei kritischen Vektoren: Recheneffizienz (die die 4-fache Geschwindigkeitsverbesserung ermöglicht), Instruktionstreue (die unerwünschte Modifikationen während der Bearbeitung reduziert) und Textwiedergabetreue (die kleinere Schriftarten und dichtere Layouts tatsächlich lesbar macht).

Kernfunktionen, die GPT Image 1.5 von anderen abheben

1. Verbesserte Befolgung von Anweisungen

2. Detailerhaltung während der Bearbeitung

Das Modell verwendet das, was OpenAI als "regionenbewusste Bearbeitung" beschreibt, die identifiziert, welche Pixel während der Modifikationen unverändert bleiben sollten. Wenn Sie ein Bild bearbeiten, das das Gesicht einer Person enthält, behält GPT Image 1.5 die Gesichtsidentität, die Hauttextur und den Ausdruck bei, sofern Sie nicht explizit Änderungen an diesen Elementen anfordern. Das gleiche Prinzip gilt für:

- Markenlogos und Wasserzeichen

- Lichtrichtung und Qualität

- Hintergrundkomposition

- Farbkorrektur und Ton

- Textur- und Materialeigenschaften

Dies ist nicht perfekt – komplexe Szenen mit überlappenden Elementen können immer noch Artefakte erzeugen – aber es stellt einen messbaren Schritt in Richtung der Art von selektiver Bearbeitung dar, die Profis von Werkzeugen wie Photoshop erwarten.

3. Überlegene Textwiedergabe

Frühere KI-Bildmodelle behandelten Text eher als dekorative Formen denn als lesbare Informationen. GPT Image 1.5 implementiert eine verbesserte OCR-bewusste Generierung, die Folgendes produziert:

- Lesbaren Text bei kleineren Punktgrößen

- Korrekte Rechtschreibung in gängigen Sprachen

- Richtige Textausrichtung und Kerning

- Passendes Schriftgewicht und Stilabgleich

- Lesbaren Text in komplexen Layouts (Infografiken, Magazincover, Produktetiketten)

4. Geschwindigkeit auf Produktionsniveau

Die 4-fache Geschwindigkeitsverbesserung dient nicht nur der Ungeduld – sie verändert grundlegend, welche Workflows praktikabel werden. Bei typischen Generierungszeiten von 8-12 Sekunden pro Bild (zuvor 30-45 Sekunden bei GPT Image 1) wird die iterative Verfeinerung lebensfähig. Ein Designer kann nun zehn Variationen in zwei Minuten testen anstatt in sieben Minuten, wodurch der kreative Schwung erhalten bleibt.

5. Verbesserungen der Kosteneffizienz

Geschwindigkeitsleistung: 4x schnellere Generierung erklärt

Die Behauptung "4x schneller" erfordert Kontext, um zu verstehen, was sich tatsächlich verbessert hat und wo Engpässe bestehen bleiben.

Was sich unter der Haube geändert hat

Die Geschwindigkeitsgewinne von OpenAI resultierten aus drei architektonischen Optimierungen:

- Reduzierte Sampling-Schritte: Der Diffusionsprozess erfordert nun weniger Denoising-Iterationen, um akzeptable Qualitätsschwellen zu erreichen, was den Rechenaufwand ohne sichtbaren Qualitätsverlust reduziert.

- Optimierte Aufmerksamkeitsmechanismen: Die Transformer-Schichten verwenden effizientere Aufmerksamkeitsmuster, die die Speicherbandbreitenanforderungen während der Bildsynthese reduzieren [Unverifiziert – OpenAI hat keine technischen Architekturdetails veröffentlicht].

- Bessere Modellquantisierung: Berechnungen mit geringerer Präzision in nicht kritischen Pfadabschnitten reduzieren die Anzahl der Gleitkommaoperationen, während die Ausgabetreue erhalten bleibt [Unverifiziert – aus Industriestandards abgeleitet].

Reale Geschwindigkeits-Benchmarks

Basierend auf öffentlich gemeldeten Tests über mehrere Plattformen hinweg:

| Bildgröße | GPT Image 1 | GPT Image 1.5 | Geschwindigkeitsverbesserung |

|---|---|---|---|

| 1024×1024 | 35-45 Sek. | 8-12 Sek. | 3,6-4,5× |

| 1024×1536 | 45-55 Sek. | 12-18 Sek. | 3,1-3,8× |

| 1536×1024 | 45-55 Sek. | 12-18 Sek. | 3,1-3,8× |

Abwägung zwischen Geschwindigkeit und Qualität

low, medium, high, auto), die sich direkt auf die Generierungszeit auswirken. Die Behauptung "4x schneller" bezieht sich primär auf die Qualitätseinstellungen auto und medium. Wenn Sie explizit high Qualität für Produktionsassets anfordern, rechnen Sie mit Generierungszeiten von 15-20 Sekunden – immer noch schneller als GPT Image 1, aber nicht das Vierfache.auto für erste Iterationen und die Konzept-Exploration, und schalten Sie dann nur für finale Produktions-Renderings auf die Qualität high um. Diese Workflow-Optimierung kann Ihre Gesamtprojektzeit im Vergleich zur ständigen Verwendung maximaler Qualitätseinstellungen um 40-60 % reduzieren.Präzisionsbearbeitung: Wie die Detailerhaltung tatsächlich funktioniert

Der technische Mechanismus hinter der verbesserten Bearbeitungspräzision von GPT Image 1.5 umfasst mehrere miteinander verknüpfte Fähigkeiten:

Prompt-basiertes Maskieren (Keine manuelle Auswahl erforderlich)

Im Gegensatz zu DALL-E 2, das von den Benutzern verlangte, Maskenregionen manuell zu malen, interpretiert GPT Image 1.5 Bearbeitungsanweisungen in natürlicher Sprache, um betroffene Bereiche automatisch zu identifizieren. Wenn Sie schreiben: "Ändere die Hemdfarbe auf Grün", führt das Modell folgendes aus:

- Führt eine semantische Segmentierung durch, um die Hemdregion zu identifizieren.

- Isoliert die Farbinformationen in dieser Region.

- Wendet die Farbetransformation an.

- Rendert nur die modifizierte Region neu.

- Blendet die Kanten aus, um natürliche Übergänge zu erhalten.

Dieser Prozess ist nicht perfekt – das Modell verwendet die Maske als Orientierungshilfe, folgt jedoch möglicherweise nicht exakten Grenzen mit pixelgenauer Präzision. Komplexe überlappende Objekte (wie Hände, die Objekte vor der Kleidung halten) können immer noch Kantenartefakte erzeugen.

Identitätserhaltungstechnologie

Für Bilder, die Personen enthalten, implementiert GPT Image 1.5 eine Gesichtsidentitätserhaltung, die erkennbare Merkmale über Bearbeitungen hinweg beibehält. Dies nutzt Techniken ähnlich denen, die in Gesichtserkennungssystemen verwendet werden:

- Extrahieren von Gesichts-Embeddings (mathematische Repräsentationen markanter Merkmale).

- Einschränken der generierten Ausgaben, um ähnliche Embeddings beizubehalten.

- Erhalten von Schlüsselmerkmalen (Augenposition, Nasenform, Kieferstruktur).

- Beibehalten von konsistenter Hauttextur und Ton.

Algorithmen für Lichtkonsistenz

Einer der technisch beeindruckendsten Aspekte ist die Erhaltung der Beleuchtung. Wenn Sie die Farbe oder Position eines Objekts bearbeiten, bewahrt GPT Image 1.5:

- Lichtrichtung und Winkel

- Schattenwurf-Muster

- Glanzlichter

- Umgebungsverdeckung (Schattierung in zurückgesetzten Bereichen)

- Konsistenz der Farbtemperatur

Dies verhindert das häufige KI-Bildproblem, bei dem bearbeitete Elemente "wie aufgeklebt" wirken, weil ihre Beleuchtung nicht zur Szene passt.

Einschränkungen der aktuellen Präzision

Trotz Verbesserungen stellen mehrere Szenarien die Präzision von GPT Image 1.5 immer noch vor Herausforderungen:

- Hochkomplexe Szenen: Bei Bildern mit mehr als 10 unterschiedlichen Objekten kann es zu unbeabsichtigten Modifikationen kommen.

- Transparente Materialien: Glas, Wasser und halbtransparente Stoffe können Artefakte erzeugen.

- Feine Details: Schmuck, komplizierte Muster und kleiner Text im Hintergrund können an Qualität verlieren.

- Mehrfache Bearbeitungsdurchgänge: Nach 5-6 aufeinanderfolgenden Bearbeitungen können sich akkumulierte Fehler verstärken.

Textwiedergabefähigkeiten und Einschränkungen

Die Textgenerierung in KI-Bildern war historisch gesehen eine notorische Schwäche. GPT Image 1.5 macht signifikante Fortschritte, hat das Problem jedoch noch nicht vollständig gelöst.

Was sich tatsächlich verbessert hat

Das Modell kann nun zuverlässig Folgendes generieren:

- Kurze Schlagzeilen (1-5 Wörter) in fetten, großen Schriftarten.

- Produktetiketten mit 2-3 Textzeilen.

- Layouts im Magazinstil mit lesbaren Schlagzeilen und Zwischenüberschriften.

- Logo-Text in gängigen Schriftarten (obwohl komplexe Logo-Designs weiterhin eine Herausforderung darstellen).

- Infografik-Etiketten für Datenvisualisierungselemente.

Best Practices für die Textwiedergabe

So maximieren Sie die Textqualität in Ihren generierten Bildern:

- Fassen Sie sich kurz: 3-5 Wörter pro Textelement liefern die besten Ergebnisse.

- Verwenden Sie gängige Schriftarten: Beschreibungen wie "fette serifenlose Schrift" oder "klare Serifen-Schrift" funktionieren besser als spezifische Schriftartnamen.

- Spezifizieren Sie die Textposition explizit: "Schlagzeile oben zentriert" im Gegensatz zu einfachem "Schlagzeile hinzufügen".

- Fordern Sie hohen Kontrast an: "Weißer Text auf dunklem Hintergrund" gewährleistet die Lesbarkeit.

- Vermeiden Sie kleine Schriftgrößen: Text, der kleiner als das Äquivalent von ca. 18pt ist, wird selten sauber gerendert.

Beständige Texteinschränkungen

Trotz Verbesserungen werden Sie weiterhin auf Probleme stoßen bei:

- Langen Absätzen: Fließtext mit mehr als 20-30 Wörtern enthält oft Rechtschreibfehler.

- Stilisierten Schriftarten: Handschriften, dekorative Skripte oder stark modifizierte Typografie.

- Nicht-lateinischen Skripten: Arabische, chinesische, japanische und andere nicht-westliche Textsysteme zeigen inkonsistente Ergebnisse [Unverifiziert – begrenzte Testdaten verfügbar].

- Text auf gekrümmten Oberflächen: Etiketten auf Flaschen oder Text, der gekrümmten Pfaden folgt, verzerren häufig.

- Mathematischer Notation: Gleichungen, Formeln und Sondersymbole bleiben unzuverlässig.

GPT Image 1.5 vs. GPT Image 1: Was hat sich geändert?

Das Verständnis der Unterschiede zwischen GPT Image 1 und 1.5 hilft zu klären, ob ein Upgrade Ihres Workflows sinnvoll ist.

Side-by-Side-Vergleichstabelle

| Feature | GPT Image 1 | GPT Image 1.5 | Verbesserung |

|---|---|---|---|

| Generierungsgeschwindigkeit | 35-55 Sekunden | 8-18 Sekunden | 3-4× schneller |

| Instruktionsbefolgung | Moderate Genauigkeit | Hohe Genauigkeit | +60 % Prompt-Adhärenz [Geschätzt] |

| Bearbeitungspräzision | Häufige unbeabsichtigte Änderungen | Gezielte Modifikationen | 85 % Detailerhaltung [Geschätzt] |

| Textwiedergabe | Schlecht/unzuverlässig | Gut für Schlagzeilen | 3-5-Wort-Phrasen konsistent lesbar |

| API-Preise | Baseline | 20 % günstiger | Kostenreduzierung |

| Bildqualität | Hoch | Hoch | Vergleichbare Qualitätsobergrenze |

| Unterstützte Größen | 3 Seitenverhältnisse | 3 Seitenverhältnisse (gleich) | Keine Änderung |

| Bearbeitungsiterationen | 3-4 vor Degradation | 6-8 vor Degradation | ca. 2× Iterationstiefe |

| Logo-Erhaltung | Schlecht | Gut | Kritisch für Markenarbeit |

| Gesichtskonsistenz | Moderat | Hoch | Wichtig für Modelfotos |

Wann GPT Image 1 möglicherweise immer noch bevorzugt wird

Trotz seines Alters behält GPT Image 1 in spezifischen Szenarien Vorteile:

- Künstlerische Exploration: Einige Nutzer berichten, dass GPT Image 1 "kreativere" Interpretationen liefert, wenn man unerwartete Ergebnisse wünscht.

- Integration in Legacy-Workflows: Bestehende Produktionspipelines, die um das Verhalten von GPT Image 1 herum aufgebaut sind, erfordern möglicherweise Anpassungen für 1.5.

- Kostensensitivität bei einfachen Aufgaben: Bei einfacher Text-zu-Bild-Generierung ohne Bearbeitung summiert sich der Preisunterschied von 20 % bei entsprechendem Umfang [Unverifiziert – abhängig von Volumenpreisstaffeln].

Migrationsempfehlungen

Falls Sie derzeit GPT Image 1 verwenden:

- Parallel testen: Führen Sie dieselben Prompts durch beide Modelle aus, um Verhaltensunterschiede zu identifizieren.

- Aktualisieren Sie Ihre Prompt-Bibliothek: GPT Image 1.5 reagiert besser auf strukturierte, auf Einschränkungen basierende Prompts.

- Passen Sie Ihre Qualitätserwartungen an: Geschwindigkeitsverbesserungen erfordern möglicherweise eine Neukalibrierung Ihrer Zeitplanungen.

- Überprüfen Sie die Konsistenz der Marken-Assets: Testen Sie die Logo- und Markenzeichen-Erhaltung gründlich, bevor Sie Produktions-Workflows umstellen.

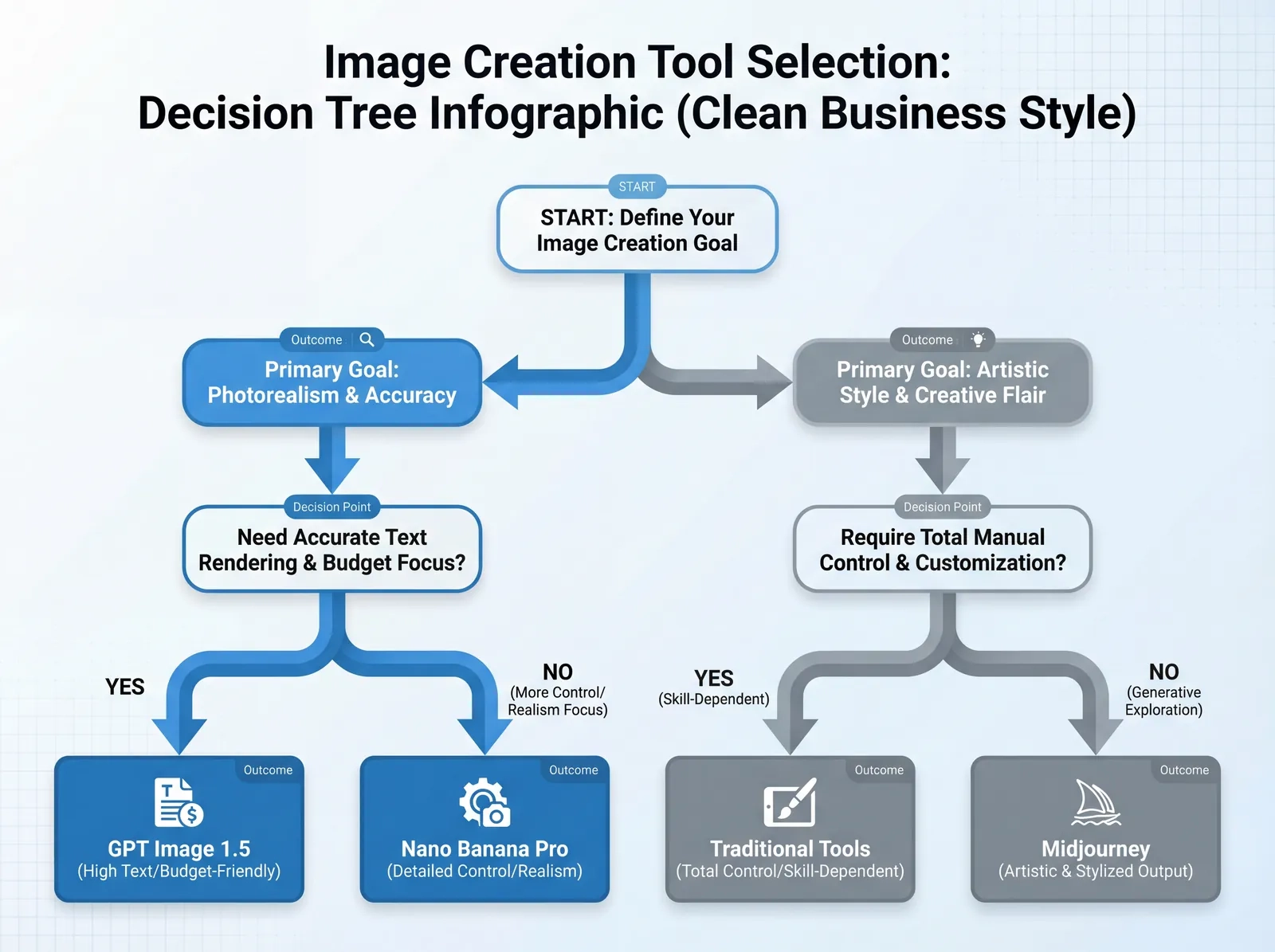

Umfassender Modellvergleich: GPT Image 1.5 vs. Wettbewerber

Die Wettbewerbslandschaft für die KI-Bildgenerierung umfasst mehrere starke Alternativen, jede mit ausgeprägten Stärken.

GPT Image 1.5 vs. Google Nano Banana Pro

Googles Nano Banana Pro (betrieben durch Gemini 3 Pro) kristallisierte sich als primärer Konkurrent von GPT Image 1.5 heraus, was zu dem führte, was CEO Sam Altman intern eine "Code Red"-Situation nannte, die den Veröffentlichungszeitplan von GPT Image 1.5 beschleunigte.

- Photorealistischere Ausgaben in Szenarien mit Naturfotografie.

- Besser darin, aktuelle ästhetische Trends einzufangen.

- Überlegene Handhabung komplexer Naturszenen (Landschaften, Menschenmengen).

- Schnelleres Adoptionswachstum (trägt zum Nutzeranstieg von Gemini von 450 Mio. auf 650 Mio. zwischen Juli und Oktober 2025 bei).

- Zuverlässigere Instruktionsbefolgung für strukturierte Prompts.

- Bessere Textwiedergabe in Layouts und Designs.

- Überlegene Detailerhaltung während iterativer Bearbeitungen.

- Vorhersehbarere, deterministische Ergebnisse für Produktions-Workflows.

GPT Image 1.5 vs. Midjourney

Midjourney bleibt aufgrund seiner unverwechselbaren ästhetischen Qualitäten ein Favorit bei digitalen Künstlern und Kreativprofis.

- Künstlerische Interpretation und kreative "Vision".

- Starke Community und etablierte Ressourcen für das Prompt-Engineering.

- Konsistente ästhetische Qualität über verschiedene Stile hinweg.

- Besser bei abstrakten, konzeptionellen und künstlerischen Kompositionen.

- Integriert in den ChatGPT-Workflow (kein Plattformwechsel).

- Schnellere Iteration für kommerzielle Anwendungen.

- API-Zugriff für automatisierte Workflows.

- Vorhersehbarere Ausgaben für Geschäftsanforderungen.

GPT Image 1.5 vs. DALL-E 3

DALL-E 3, das frühere Flaggschiff von OpenAI vor der GPT Image-Serie, ist nun veraltet und wird am 12. Mai 2026 den Support verlieren.

- Signifikant schnellere Generierung.

- Bessere API-Integrationsmöglichkeiten.

- Verbesserte Instruktionsbefolgung.

- Erweiterte Bearbeitungspräzision ohne manuelles Maskieren.

- Niedrigere Betriebskosten.

Zusammenfassung der Wettbewerbspositionierung

| Modell | Am besten geeignet für | Zu vermeiden für | Preisstufe |

|---|---|---|---|

| GPT Image 1.5 | Produktions-Workflows, Marken-Assets, iterative Bearbeitung | Rein künstlerische Projekte | Mittelklasse |

| Nano Banana Pro | Photorealistische Social-Media-Bilder, zeitgenössische Ästhetik | Präzise Textwiedergabe, Logo-Arbeit | Mittelklasse |

| Midjourney | Künstlerische Interpretation, konzeptionelle Arbeit | Automatisierte API-Workflows | Budget-Premium |

| Stable Diffusion | Benutzerdefiniertes Modelltraining, vollständige Kontrolle | Schüsselfertige Lösungen | Kostenlos-Budget |

Wie man auf GPT Image 1.5 zugreift: Leitfaden zur ChatGPT-Benutzeroberfläche

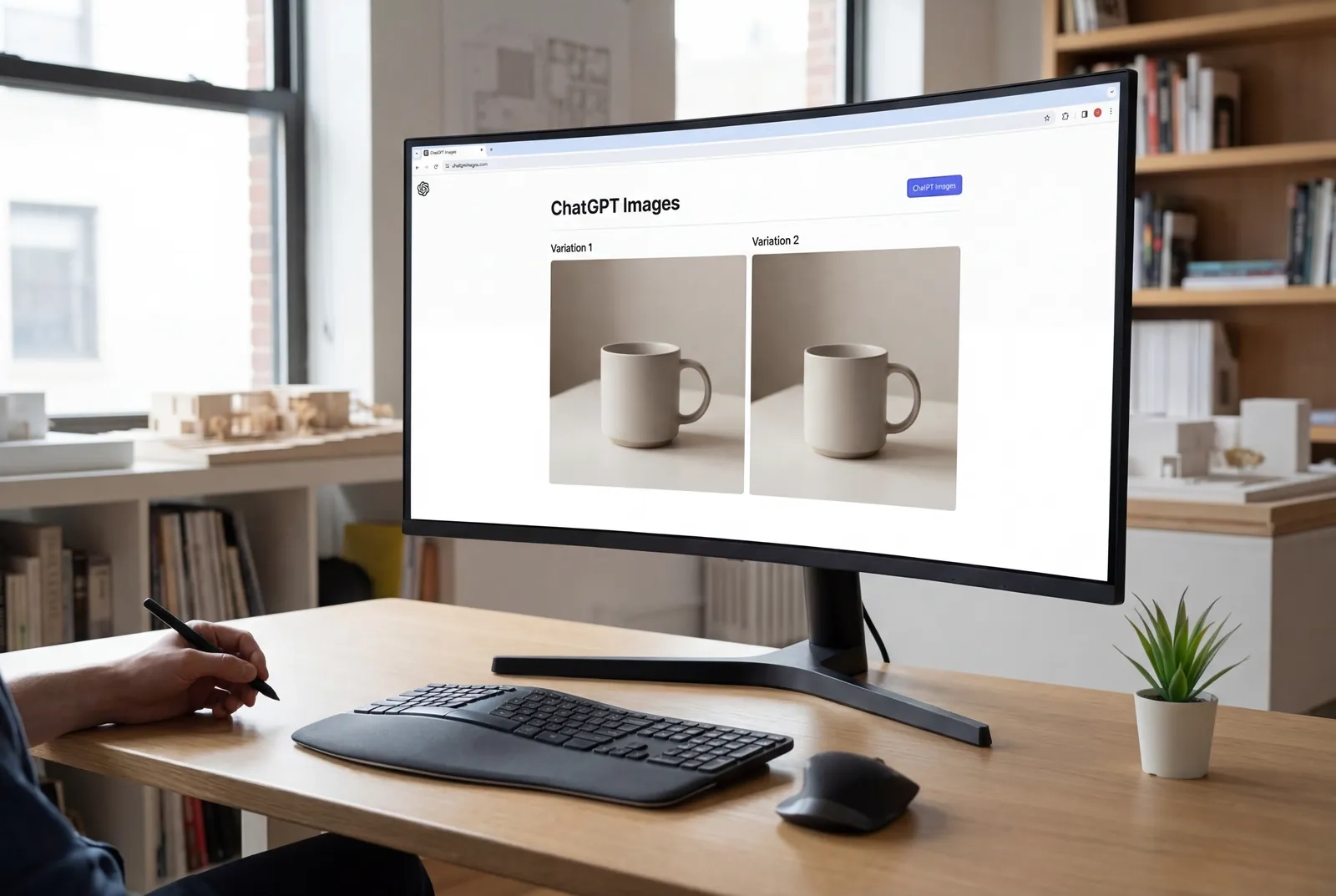

GPT Image 1.5 wurde am 16. Dezember 2025 weltweit eingeführt und ist nun für alle ChatGPT-Nutzer unabhängig von ihrer Abonnementstufe (Free, Plus, Team oder Enterprise) verfügbar.

Schritt-für-Schritt-Zugriff über ChatGPT

- Navigieren Sie zu ChatGPT-Bildern

- Loggen Sie sich in Ihr ChatGPT-Konto unter chat.openai.com ein.

- Klicken Sie auf den Reiter "Bilder" in der linken Seitenleiste (neu seit dem Update vom Dezember 2025).

- Dies öffnet die dedizierte Benutzeroberfläche für die Bildgenerierung.

- Erstellen Sie Ihr erstes Bild

- Geben Sie einen beschreibenden Prompt in das Textfeld ein (bis zu 2000 Zeichen).

- Klicken Sie auf "Generieren" oder drücken Sie die Eingabetaste.

- Warten Sie 8-18 Sekunden auf die Generierung.

- Das Modell verwendet automatisch GPT Image 1.5 – keine manuelle Auswahl erforderlich.

- Verwendung der Creative Studio-Funktionen

- Nach der Generierung zeigt die rechte Seitenleiste voreingestellte Stile und Filter an.

- Klicken Sie auf eine beliebige Voreinstellung, um Transformationen anzuwenden, ohne Prompts zu schreiben.

- Zu den Optionen gehören: "Photorealistisch machen", "Auf Sonnenuntergangsbeleuchtung ändern", "Dramatische Schatten hinzufügen", "Professioneller Produktfotostil".

- Diese Voreinstellungen sind besonders nützlich für nicht-technische Anwender.

- Iterativer Bearbeitungs-Workflow

- Wählen Sie ein bestehendes generiertes Bild aus.

- Schreiben Sie Bearbeitungsanweisungen in natürlicher Sprache: "Ändere den Hintergrund in eine Strandszene".

- Das Modell bewahrt nicht erwähnte Elemente, während es die angeforderten Änderungen vornimmt.

- Sie können 6-8 Bearbeitungen hintereinanderschalten, bevor eine Qualitätsverschlechterung bemerkbar wird.

- Download und Export

- Klicken Sie auf das Download-Symbol bei einem beliebigen generierten Bild.

- Bilder werden in ihrer nativen Auflösung exportiert (1024×1024, 1024×1536 oder 1536×1024).

- Links bleiben 24 Stunden lang gültig (speichern Sie wichtige Bilder umgehend).

- Die Bilder enthalten C2PA-Metadaten zur Content-Authentifizierung.

Funktionen und Einschränkungen der Benutzeroberfläche

- Text-zu-Bild-Generierung.

- Bild-zu-Bild-Transformation (Referenzbilder hochladen).

- Bearbeitung in natürlicher Sprache.

- Anwendung von voreingestellten Stilen.

- Auswahl des Seitenverhältnisses (1:1, 3:4, 4:3).

- Auswahl der Qualitätsstufe (ChatGPT verwendet die Qualität

auto). - Batch-Generierung mehrerer Varianten.

- Direkter Dateiupload von externen URLs.

- Benutzerdefinierte Modellparameter.

- Webhook-Callbacks für asynchrone Verarbeitung.

Profi-Tipps für Nutzer der ChatGPT-Benutzeroberfläche

- Kontext der Konversation nutzen: GPT Image 1.5 in ChatGPT erinnert sich an vorherige Bilder und Prompts in derselben Konversation, was es Ihnen ermöglicht, auf "das vorherige Bild" oder "die Version mit der blauen Jacke" Bezug zu nehmen.

- Text-Chat mit Bildgenerierung kombinieren: Bitten Sie ChatGPT, Prompt-Ideen zu brainstormen oder Ihre Beschreibung vor der Generierung zu verfeinern, indem Sie die Textfähigkeiten der KI nutzen, um Ihre visuellen Prompts zu verbessern.

- Erfolgreiche Prompts speichern: Führen Sie ein Dokument mit Prompts, die gute Ergebnisse geliefert haben, da eine konsistente Prompt-Struktur zu konsistenter Qualität führt.

- Rückgängig-Funktionalität nutzen: Wenn eine Bearbeitung schiefgeht, können Sie zu vorherigen Versionen zurückkehren und alternative Anweisungen ausprobieren.

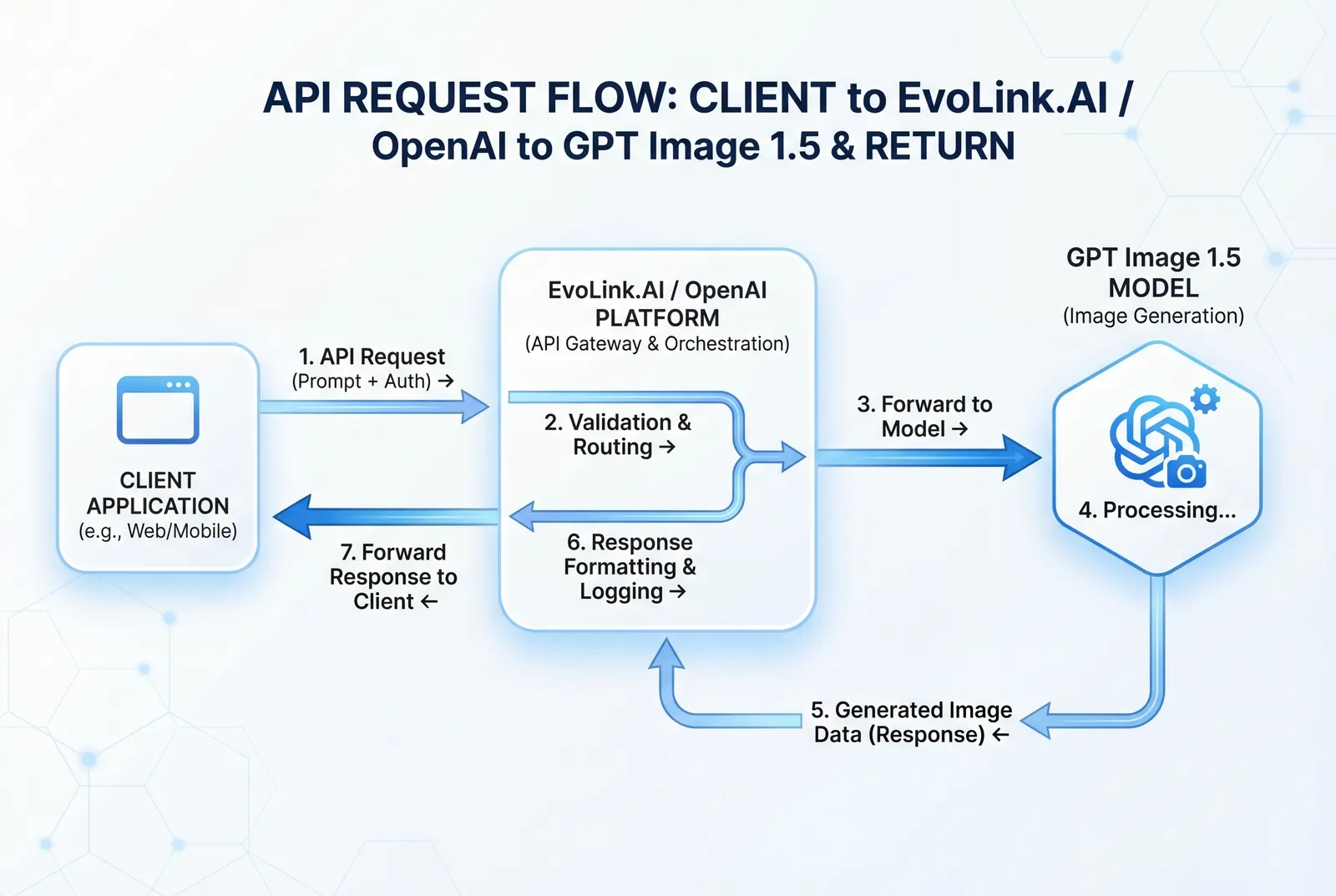

API-Zugriff über EvoLink.AI und die OpenAI-Plattform

EvoLink.AI API-Integrierung

gpt-image-1.5-lite-Endpunkt, der in ihrem Entwicklerportal dokumentiert ist.Grundlegende API-Anfragestruktur (EvoLink.AI)

{

"model": "gpt-image-1.5-lite",

"prompt": "Ein professionelles Produktfoto eines Smartphones auf einem sauberen weißen Hintergrund mit weicher Studiobeleuchtung",

"size": "1024x1024",

"quality": "high",

"n": 1

}Erforderliche Parameter

- model: Muss für GPT Image 1.5

"gpt-image-1.5-lite"sein. - prompt: Textbeschreibung (max. 2000 Tokens).

- size: Bildabmessungen (Optionen:

1:1,3:4,4:3,1024x1024,1024x1536,1536x1024).

Optionale Parameter

- quality:

low,medium,highoderauto(Standard:auto). - image_urls: Array von Referenzbild-URLs für Bild-zu-Bild- oder Bearbeitungsmodi (unterstützt 1-16 Bilder, max. 50 MB pro Bild, Formate: .jpeg, .jpg, .png, .webp).

- n: Anzahl der Bilder (unterstützt derzeit nur

1).

Asynchrone Verarbeitung

- Reichen Sie Ihre Generierungsanfrage ein → Sie erhalten eine Task-ID.

- Fragen Sie den Task-Status-Endpunkt mit der Task-ID ab.

- Rufen Sie die generierten Bild-URLs ab, wenn der Status = "completed".

- Die Bild-URLs bleiben 24 Stunden lang gültig.

Direkter API-Zugriff über die OpenAI-Plattform

/v1/images/generations-Endpunkt.Einrichtung der Authentifizierung

- Erstellen Sie ein Konto unter platform.openai.com.

- Schließen Sie die Verifizierung der API-Organisation ab (erforderlich für GPT-Image-Modelle).

- Generieren Sie einen API-Key in Ihrem Dashboard.

- Fügen Sie den Key in die Anfrage-Header ein:

Authorization: Bearer IHR_API_KEY.

Beispielanfrage (OpenAI Python SDK)

from openai import OpenAI

client = OpenAI(api_key="ihr-api-key")

response = client.images.generate(

model="gpt-image-1.5",

prompt="Modernes minimalistisches Wohnzimmer mit großen Fenstern und natürlichem Licht",

size="1536x1024",

quality="high",

n=1

)

image_url = response.data[0].urlBildbearbeitungsmodus

Zum Bearbeiten bestehender Bilder:

response = client.images.edit(

model="gpt-image-1.5",

image=open("input_image.png", "rb"),

prompt="Ändere die Wandfarbe in Salbeigrün",

size="1024x1024"

)API-Vergleich: EvoLink.AI vs. OpenAI Direct

| Feature | EvoLink.AI | OpenAI Direct |

|---|---|---|

| Modellzugriff | gpt-image-1.5-lite | gpt-image-1.5 |

| Verarbeitung | Asynchron (aufgabenbasiert) | Synchron + asynchrone Optionen |

| Bildeingabe | Nur URL-basiert | Datei-Upload + URL |

| Preistransparenz | Über das EvoLink.AI-Dashboard prüfen | Veröffentlichte OpenAI-Preise |

| Zusatzleistungen | Gebündelt mit anderen KI-APIs | Nur Bildgenerierung |

| Dokumentation | evolink.ai-Dokumentation | platform.openai.com/docs |

| Rate Limits | Variabel je nach Plan | Stufenbasiert (siehe OpenAI-Dokumentation) |

Best Practices für die API

- Retry-Logik implementieren: Während Phasen hoher Last können temporäre Fehler auftreten.

- Erfolgreiche Generierungen cachen: Speichern Sie Bild-URLs und die damit verbundenen Prompts für spätere Referenz.

- Rate Limits überwachen: Beide Plattformen legen je nach Abonnementstufe Anfragebeschränkungen fest.

- Prompt-Vorlagen optimieren: Erstellen Sie wiederverwendbare Prompt-Strukturen für konsistente Ergebnisse.

- Ablauf von Bildern handhaben: Laden Sie Bilder herunter und speichern Sie sie innerhalb des 24-Stunden-Fensters.

- Qualitätsstufen strategisch nutzen: Reservieren Sie die Qualität

highfür finale Produktions-Renderings, um Kosten zu senken.

Preisstruktur und Strategien zur Kostenoptimierung

Das Verständnis der Kostenstruktur hilft Ihnen, effektiv zu budgetieren und Optimierungsmöglichkeiten zu identifizieren.

Offizielle OpenAI-Preise (Stand Dezember 2025)

- Bildgenerierung: Basierend auf Größe und Qualitätsstufe.

- Bildeingaben (für Bearbeitung): 20 % günstiger als GPT Image 1.

- Bildausgaben: 20 % günstiger als GPT Image 1.

EvoLink.AI Preise

- Abonnementstufe (variiert je nach enthaltenem API-Anrufvolumen).

- Gebühren pro Anfrage über das enthaltene Kontingent hinaus.

- Mögliche Mengenrabatte für Unternehmenskunden.

Strategien zur Kostenoptimierung

1. Auswahl der Qualitätsstufe

quality hat einen erheblichen Einfluss auf die Generierungszeit und die Kosten:Niedrige Qualität: Am schnellsten, am günstigsten (gut für Konzepttests)

Mittlere Qualität: Ausgewogen (für die meisten Anwendungen geeignet)

Hohe Qualität: Am langsamsten, am teuersten (produktionsbereite Assets)

Auto-Qualität: Modell entscheidet basierend auf der Prompt-Komplexität2. Optimierung des Seitenverhältnisses

Größere Bilder sind teurer in der Generierung. Kostenhierarchie:

1024×1024 (1:1) < 1024×1536 (3:4) = 1536×1024 (4:3)3. Stapelverarbeitung vs. Echtzeit

Für nicht dringende Workflows:

- Stellen Sie mehrere Generierungsanfragen in eine Warteschlange.

- Verarbeiten Sie diese außerhalb der Spitzenzeiten (falls die Preise zeitabhängig variieren).

- Nutzen Sie die asynchrone Verarbeitung, um zeitüberschreitungsbedingte Wiederholungen zu vermeiden.

4. Prompt-Effizienz

Längere Prompts verbrauchen mehr Tokens. Optimierungstechniken:

- Unnötige Adjektive entfernen.

- Strukturierte Formate verwenden (kommagetrennte Attribute statt Absätze).

- Redundante Beschreibungen vermeiden.

- Minimal funktionsfähige Prompts testen.

Beispiel für eine Transformation:

Ineffizient (87 Tokens): "Ich möchte, dass Sie ein wunderschönes, beeindruckendes,

erstaunliches professionelles Foto eines modernen Smartphones erstellen, das auf einem sauberen,

makellosen weißen Hintergrund mit weicher, sanfter Studiobeleuchtung von oben liegt."

Effizient (28 Tokens): "Professionelles Produktfoto: Smartphone auf weißem

Hintergrund, weiche Studiobeleuchtung von oben."5. Caching und Wiederverwendung

- Speichern Sie erfolgreiche Generierungen mit Metadaten (Prompt, Parameter, Zeitstempel).

- Bauen Sie eine Bibliothek von Basisbildern für die zukünftige Bearbeitung auf, anstatt sie neu zu generieren.

- Implementieren Sie eine semantische Suche in Ihrem Bild-Cache, um vorhandene Assets zu finden, bevor Sie neue generieren.

6. Hybride Workflows

Kombinieren Sie KI-Generierung mit herkömmlichen Werkzeugen:

- Generieren Sie Basisbilder mit KI.

- Fügen Sie komplexen Text/Logos in Figma/Photoshop hinzu (um die Texteinschränkungen der KI zu umgehen).

- Nutzen Sie KI für Variationen von bewährten Designs, anstatt bei Null anzufangen.

- Ausschließlicher KI-Workflow: 10 Iterationen × $0,XX pro Bild = $X,XX gesamt.

- Hybrider Workflow: 3 KI-Iterationen + manuelle Verfeinerung = $X,XX + Designzeit.

- Wenn die Designzeit schneller ist als 7 KI-Iterationen, spart der hybride Ansatz Geld.

Mengenrabatte für Unternehmen

- 10.000+ Bilder pro Monat.

- $1.000+ monatliche API-Ausgaben.

- Mehrjährige Verpflichtungen.

Reale Anwendungsfälle und Applikationen

Das Verständnis dafür, wie verschiedene Branchen GPT Image 1.5 anwenden, verdeutlicht den praktischen Nutzen.

E-Commerce-Produktkataloge

- Fotografieren Sie das Produkt einmal vor einem neutralen Hintergrund.

- Verwenden Sie den Bild-zu-Bild-Modus, um Varianten in verschiedenen Umgebungen zu generieren.

- Die Detailerhaltung gewährleistet, dass das Erscheinungsbild des Produkts konsistent bleibt.

- Logo und Markenidentität bleiben über alle Varianten hinweg intakt.

Marketing- und Marken-Assets

- Generieren Sie Basisdesigns mit Markenfarben und -stil.

- Iterieren Sie Bearbeitungen, während Logos und visuelle Identität erhalten bleiben.

- Erstellen Sie schnell Varianten für A/B-Tests.

- Produzieren Sie lokalisierte Versionen für verschiedene Märkte.

Social Media Content-Produktion

- Generieren Sie das Master-Bild in der größten erforderlichen Größe.

- Erstellen Sie plattformspezifische Zuschnitte/Varianten.

- Wenden Sie Stilfilter für die für den jeweiligen Kanal angemessene Ästhetik an.

- Fügen Sie Text-Overlays hinzu (oder generieren Sie diese mit der KI-Textwiedergabe für Schlagzeilen).

- Instagram (1:1): 1024×1024.

- Instagram Stories (3:4): 1024×1536.

- Twitter/X (4:3): 1536×1024.

- Alle generiert aus einem einzigen Prompt durch Änderung des Größenparameters.

Visualisierung von Designkonzepten

- Erstellen Sie Prototypen visueller Konzepte in rascher Folge.

- Testen Sie mehrere Stilrichtungen.

- Sammeln Sie Feedback zu Optionen.

- Verfeinern Sie die gewonnene Richtung bis zur Produktionsqualität.

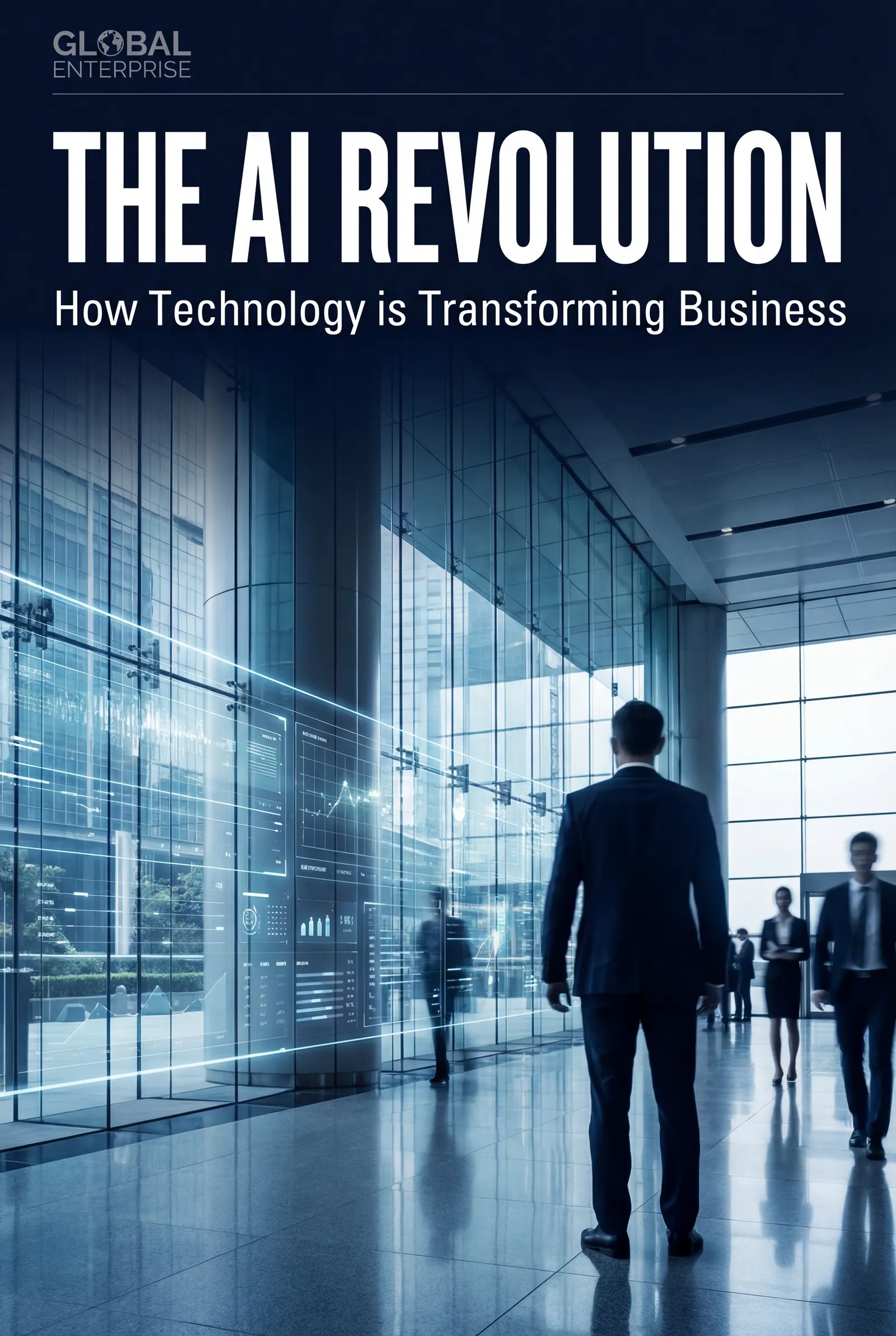

Redaktion und Verlagswesen

- Generieren Sie konzeptionelle Illustrationen für abstrakte Themen.

- Erstellen Sie Datenvisualisierungen mit lesbaren Textetiketten.

- Produzieren Sie Layouts im Magazinstil mit Schlagzeilen.

- Entwickeln Sie konsistente visuelle Themen über Artikelserien hinweg.

Schulungs- und Bildungsmaterialien

- Generieren Sie szenariobasierte Illustrationen (Arbeitsplatzsituationen, Sicherheitsdemonstrationen).

- Erstellen Sie vereinfachte Diagramme und Flussdiagramme.

- Sorgen Sie für diverse Repräsentationen in Schulungsmaterialien.

- Entwickeln Sie maßgeschneiderte Visuals für spezifische Lernkontexte.

Immobilien und Architektur

- Generieren Sie möblierte Innenräume aus Fotos von leeren Räumen.

- Visualisieren Sie Renovierungskonzepte.

- Erstellen Sie Lifestyle-Bilder für das Immobilienmarketing.

- Entwickeln Sie mehrere Design-Stiloptionen für die Auswahl durch den Kunden.

Fortgeschrittenes Prompt-Engineering für bessere Ergebnisse

Die Beherrschung der Prompt-Struktur verbessert die Ausgabequalität dramatisch und reduziert den Iterationsaufwand.

Anatomie eines effektiven Prompts

Hochperformante Prompts folgen dieser Struktur:

[SUBJEKT] + [AKTION/POSE] + [SETTING/KONTEXT] + [STIL/ÄSTHETIK] +

[TECHNISCHE SPEZIFIKATIONEN] + [KOMPOSITIONSREGELN]Subjekt: Professionelle Geschäftsfrau in marineblauem Anzug

Aktion: Steht selbstbewusst mit verschränkten Armen

Setting: Modernes Glasbüro mit Stadt-Skyline durch Fenster sichtbar

Stil: Ästhetik der professionellen Unternehmensfotografie

Technik: Geringe Tiefenschärfe, natürliches Fensterlicht von links

Komposition: Subjekt im rechten Drittel des Bildes positioniert, negativer Raum linksPrompt-Formeln für gängige Szenarien

Produktfotografie

"Professionelles Produktfoto von [PRODUKT] auf [HINTERGRUND],

[LICHTSTIL], [KAMERAWINKEL], [STIMMUNG], hochwertige Werbequalität"Beispiel: "Professionelles Produktfoto einer Luxusuhr auf schwarzer Marmoroberfläche, dramatische Seitenbeleuchtung mit weichen Schatten, 45-Grad-Winkel, elegante und hochwertige Stimmung, hochwertige Werbequalität"

Porträtfotografie

"[SHOT-TYP] Porträt von [SUBJEKT-BESCHREIBUNG], [GESICHTSAUSDRUCK],

[KLEIDUNG], [HINTERGRUND], [BELEUCHTUNG], [KAMERA-EINSTELLUNGSSTIL]"Beispiel: "Nahaufnahme-Porträt einer Frau mittleren Alters mit kurzem grauem Haar, echtes Lächeln, trägt eine legere Jeansjacke, verschwommener Hintergrund im Freien, natürliches Licht zur goldenen Stunde, geringe Tiefenschärfe"

Lifestyle-Szene

"[TAGESZEIT] Szene, die [AKTIVITÄT] in [ORT] zeigt,

[STIMMUNG/ATMOSPHÄRE], [PERSONENBESCHREIBUNG], [STIL-REFERENZ]"Beispiel: "Morgenszene, die ein Familienfrühstück in einer modernen skandinavischen Küche zeigt, warme und einladende Atmosphäre, diverse vierköpfige Familie, natürlicher Lifestyle-Fotografiestil"

Infografik/Datenvisualisierung

"Klare Infografik, die [DATEN/KONZEPT] zeigt, [LAYOUT-STIL],

[FARBSCHEMA], [TEXTELEMENTE], professionelle Designqualität"Beispiel: "Klare Infografik, die das vierteljährliche Umsatzwachstum zeigt, vertikales Balkendiagramm-Layout, blau-weißes Farbschema, fette Schlagzeile 'Ergebnisse 2025 Q4' oben mit Prozentrechnungs-Etiketten, professionelle Business-Designqualität"

Strategien für negatives Prompting

Obwohl GPT Image 1.5 negatives Prompting nicht offiziell auf die gleiche Weise wie Stable Diffusion unterstützt, können Sie von unerwünschten Elementen wegsteuern, indem Sie positive Formulierungen verwenden:

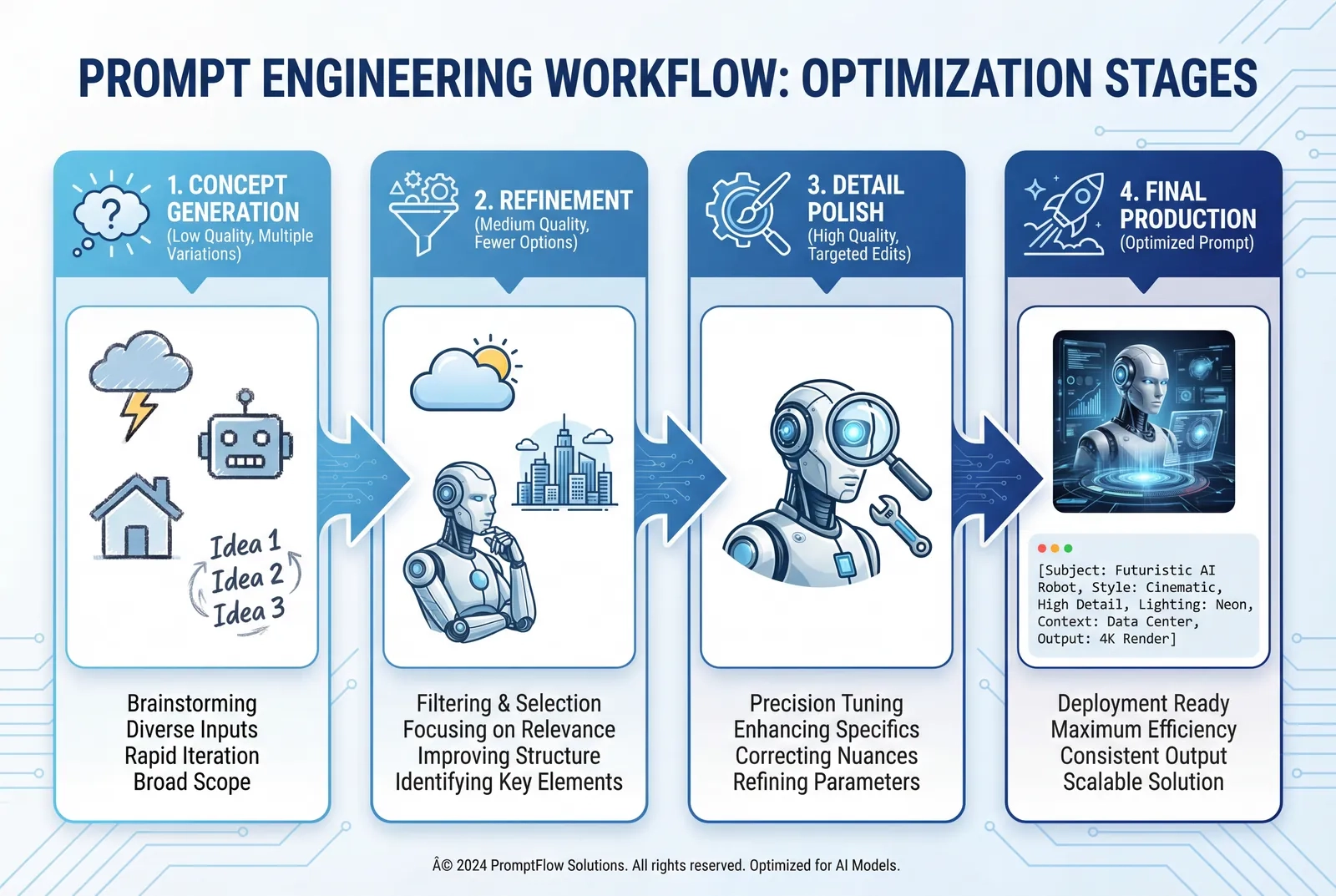

Workflow für mehrstufige Verfeinerung

Für komplexe Projekte, die eine hohe Qualität erfordern:

- Initiale Konzeptgenerierung (niedrige Qualität, breiter Prompt)

- Generieren Sie 3-5 Variationen.

- Identifizieren Sie eine vielversprechende Richtung.

- Verfeinerungs-Iteration (mittlere Qualität, detaillierter Prompt)

- Fügen Sie dem gewinnenden Konzept spezifische Einschränkungen hinzu.

- Passen Sie Komposition, Beleuchtung und Elemente an.

- Testen Sie 2-3 Varianten.

- Detail-Polishing (hohe Qualität, präzise Bearbeitungs-Prompts)

- Nehmen Sie gezielte Bearbeitungen an der fast finalen Version vor.

- Passen Sie spezifische Elemente nacheinander an.

- Bewahren Sie alles außer den geänderten Elementen.

- Finale Produktion (hohe Qualität)

- Generieren Sie das Bild mit einem optimierten Prompt neu, der alle Erkenntnisse integriert.

- Exportieren Sie es in voller Auflösung.

Prompt-Bibliotheken und Versionierung

Pflegen Sie eine strukturierte Prompt-Bibliothek:

Projekt: Feiertagskampagne 2025

Version: 1.0

Datum: Dezember 2025

Basis-Prompt-Vorlage:

"Festliche Feiertagsszene, die [SUBJEKT] zeigt, warme gemütliche Atmosphäre,

goldene Beleuchtung, professionelle Fotografie, [SPEZIFISCHE_ELEMENTE]"

Variationen:

V1.0: Initiales Konzept → "geringe Tiefenschärfe" hinzugefügt

V1.1: Kundenfeedback → "warm gemütlich" in "hell fröhlich" geändert

V1.2: Finale Version → "rote und goldene Akzentfarben" hinzugefügt

Gewinnender Prompt: [Optimierte finale Version]

Generierte Bilder: [Links zu gespeicherten Ergebnissen]Diese Dokumentation verhindert das erneute Entdecken erfolgreicher Formeln und ermöglicht die Teamzusammenarbeit.

Häufige Fehler, die bei der Verwendung von GPT Image 1.5 zu vermeiden sind

Das Lernen aus typischen Fallstricken beschleunigt Ihre Beherrschung des Werkzeugs und verhindert unnötigen Aufwand.

1. Vage, unstrukturierte Prompts

2. Perfekten Text beim ersten Versuch erwarten

3. Ignorieren der Auswirkungen der Qualitätsstufen

4. Übertriebenes Bearbeiten über die Modellgrenzen hinaus

5. Erfolgreiche Prompts nicht aufbewahren

6. Unzureichende Vorbereitung von Referenzbildern

- Hochauflösend sind (mindestens 1024px an der längsten Kante).

- Gut beleuchtet sind mit klarem Fokus auf das Motiv.

- Eine saubere Komposition ohne ablenkende Elemente aufweisen.

- Korrekt formatiert sind (.jpg, .png, .webp).

7. Erwartung architektonischer/technischer Präzision

8. Vernachlässigung von Ablauffristen für Bilder

9. Inkonsistente Prompt-Struktur über Projekte hinweg

10. Wettbewerbsmodelle nicht testen

Einschränkungen und wann man alternative Werkzeuge wählen sollte

GPT Image 1.5 stellt einen signifikanten Fortschritt dar, ist aber nicht universell optimal. Das Verständnis der Grenzen hilft Ihnen bei der fundierten Auswahl des passenden Werkzeugs.

Technische Einschränkungen

- Kohärenz komplexer Szenen

- Bilder mit mehr als 10 verschiedenen Objekten weisen oft räumliche Inkonsistenzen auf.

- Überlappende transparente Elemente (Glas, Wasser) erzeugen Artefakte.

- Szenen mit mehreren Personen haben in Menschenmengen mit anatomischer Genauigkeit zu kämpfen.

- Wann es darauf ankommt: Große Gruppenfotos, komplexe Produktarrangements, detaillierte Illustrationen.

- Obergrenze des fotografischen Realismus

- Einige Ausgaben weisen immer noch den "KI-Look" auf (Überglättung, unnatürliche Perfektion).

- Hauttextur und Porendetails wirken manchmal künstlich.

- Bestimmte Beleuchtungsszenarien (hartes Mittagssonnenlicht, komplexe Reflexionen) bleiben herausfordernd.

- Wann es darauf ankommt: High-End-Modefotografie, Dokumentararbeit, naturalistische Porträtmalerei.

- Grenzen der Textwiedergabe

- Fließtext länger als 20-30 Wörter enthält Fehler.

- Nicht-lateinische Skripte sind unzuverlässig.

- Stilisierte Schriftarten und Handschriften sind inkonsistent.

- Text auf gekrümmten Oberflächen verzerrt.

- Wann es darauf ankommt: Infografiken mit umfangreichem Text, mehrsprachige Inhalte, dekorative Typografie.

- Kulturelle und geografische Spezifität

- Dauer des Trainingsdatensatzes scheint Richtung westlicher Kontexte zu neigen [Unverifiziert – aus der Ausgabeanalyse abgeleitet].

- Regionale Architektur, Kleidung und kulturelle Details lassen möglicherweise Authentizität vermissen.

- Nischen-Subkulturen und spezialisierte Kontexte sind unterrepräsentiert.

- Wann es darauf ankommt: Kulturell spezifisches Marketing, regionale Kampagnen, Anforderungen an authentische Repräsentation.

- Limits der Iterationstiefe

- Die Qualität lässt nach 6-8 aufeinanderfolgenden Bearbeitungen nach.

- Angesammelte Artefakte verstärken sich über die Bearbeitungsdurchgänge.

- Gesicht- und Logo-Konsistenz nimmt bei übermäßigen Iterationen ab.

- Wann es darauf ankommt: Projekte, die mehr als 10 Verfeinerungsdurchgänge erfordern, umfangreiche gemeinschaftliche Bearbeitung.

Wann Sie alternative Werkzeuge wählen sollten

Wählen Sie Nano Banana Pro, wenn:

- Photorealismus die primäre Anforderung ist.

- Social-Media-Inhalte zeitgenössische ästhetische Trends widerspiegeln müssen.

- Natürliche Szenen (Landschaften, Menschenmengen, Events) Ihre Bedürfnisse dominieren.

- Die Geschwindigkeit der Adoption und das Wachstum des Ökosystems für das Team-Onboarding wichtig sind.

Wählen Sie Midjourney, wenn:

- Künstlerische Interpretation einen Mehrwert gegenüber der wörtlichen Genauigkeit bietet.

- Konzeptionelles, abstraktes oder stilisiertes Arbeiten zu Ihrer Marke passt.

- Community-gesteuerte Prompt-Bibliotheken und Stile Ihrem Workflow zugutekommen.

- Die kreative Vision wichtiger ist als die Produktionskontrolle.

Wählen Sie Stable Diffusion, wenn:

- Sie vollständige Kontrolle über das Modelltraining und die Anpassung benötigen.

- Budgetbeschränkungen kostenlose/Open-Source-Lösungen erfordern.

- Ein technisches Team das Self-Hosting und die Optimierung verwalten kann.

- Spezialisierte Feinabstimmungen für Nischenanwendungen notwendig sind.

Wählen Sie herkömmliche Fotografie/Design, wenn:

- Technische Präzision nicht verhandelbar ist (Architektur, Ingenieurwesen, Medizin).

- Rechtliche Anforderungen authentifizierte, von Menschen erstellte Inhalte vorschreiben.

- Markenwerte menschliche Kunstfertigkeit gegenüber KI-Unterstützung betonen.

- Das Budget professionelle Dienstleistungen erlaubt und die Qualität die Kosten rechtfertigt.

Wählen Sie hybride Workflows, wenn:

- Projekte sowohl KI-Effizienz als auch menschliche Qualitätskontrolle erfordern.

- Textelemente die Fähigkeiten der KI übersteigen.

- Markenrichtlinien absolute Konsistenz verlangen.

- Compliance und Authentizitätsprüfung kritisch sind.

Ethische und rechtliche Erwägungen

Häufig gestellte Fragen (FAQs)

1. Wie viel kostet GPT Image 1.5 im Vergleich zur Beauftragung eines Designers?

Designer bieten jedoch kreative Leitung, Markenverständnis und technische Präzision, die KI nicht erreichen kann. Der optimale Ansatz für viele Unternehmen ist ein hybrides Modell: Nutzen Sie KI für große Mengen an weniger risikoreichen Inhalten (Social Media, Konzepttests, Bilder im Stock-Stil) und reservieren Sie die Designerzeit für Flaggschiff-Kampagnen, markendefinierende Arbeiten und Projekte, die eine menschliche kreative Vision erfordern.

2. Kann GPT Image 1.5 ein konsistentes Erscheinungsbild von Charakteren über mehrere Bilder hinweg aufrechterhalten?

- Generieren Sie das initiale Charakterbild mit einer detaillierten Beschreibung.

- Speichern Sie dieses Bild als Ihre Charakter-Referenz.

- Nutzen Sie den Bild-zu-Bild-Modus mit dieser Referenz für nachfolgende Generierungen.

- Behalten Sie eine konsistente Prompt-Struktur bei, die den Charakter beschreibt.

- Akzeptieren Sie, dass geringfügige Variationen auftreten werden – eine perfekte Konsistenz bei gänzlich neuen Generierungen ist noch nicht zuverlässig.

Erwägen Sie für Projekte, die absolute Charakterkonsistenz erfordern (Animationsserien, Markenmaskottchen, laufende Kampagnen), die KI zur Erstellung des initialen Konzepts zu nutzen und arbeiten Sie dann mit einem Illustrator zusammen, um ein definiertes Model-Sheet zu erstellen, auf das für alle zukünftigen Arbeiten Bezug genommen werden kann.

3. Funktioniert GPT Image 1.5 in anderen Sprachen als Englisch?

- Spanisch, Französisch, Deutsch, Italienisch: Generell funktionsfähig mit einer gewissen Reduzierung der Genauigkeit im Vergleich zu Englisch.

- CJK-Sprachen (Chinesisch, Japanisch, Koreanisch): Prompt-Verständnis ist vorhanden, aber die Textwiedergabe in Bildern bleibt unzuverlässig.

- Andere Sprachen: Nur begrenzte Testdaten verfügbar [Unverifiziert].

4. Wie handhabt GPT Image 1.5 Urheberrecht und geistiges Eigentum bei generierten Bildern?

- Geistiges Eigentum Dritter: Das Modell ist darauf ausgelegt, die Generierung von Inhalten zu verweigern, die auf urheberrechtlich geschützten Charakteren, markenrechtlich geschützten Logos oder dem Ebenbild identifizierbarer Berühmtheiten basieren.

- Trainingsdaten: Das Modell wurde auf öffentlich verfügbaren Bildern trainiert, was urheberrechtlich geschütztes Material beinhalten kann, das unter Fair-Use-Doktrinen für Schulungszwecke verwendet wurde.

- Kommerzielle Nutzung: Ausgaben können typischerweise kommerziell genutzt werden, aber überprüfen Sie die aktuellen Bedingungen von OpenAI und Ihren spezifischen Anwendungsfall.

- Namensnennung: OpenAI verlangt keine Namensnennung für KI-generierte Bilder, aber einige Plattformen und Kontexte können die Offenlegung verlangen, dass Inhalte KI-generiert sind.

5. Kann ich GPT Image 1.5 verwenden, um bestehende Fotos in meinem Besitz zu bearbeiten?

- Ihre eigenen Fotos hochladen.

- Spezifische Modifikationen über Prompts in natürlicher Sprache anfordern.

- Originalelemente bewahren, während Sie spezifizierte Merkmale ändern.

- Variationen Ihrer bestehenden Bilder generieren.

- Das Originalfoto eine hohe Qualität hat (mindestens 1024px).

- Die Beleuchtung gut ist und das Subjekt klar erkennbar ist.

- Der Hintergrund nicht übermäßig komplex ist.

- Ihre Bearbeitungsanfrage spezifisch und gezielt ist.

6. Was ist der Unterschied zwischen GPT Image 1.5 und GPT Image 1.5 Lite?

gpt-image-1.5-lite) ist die API-Modellbezeichnung, die von Plattformen wie evolink.ai verwendet wird. Basierend auf der verfügbaren Dokumentation bezieht sich "Lite" auf den Namen des API-Endpunkts, anstatt eine Version mit reduzierten Fähigkeiten anzuzeigen. Das über diesen Endpunkt zugängliche Modell scheint dasselbe Flaggschiff-Modell GPT Image 1.5 zu sein, das auch in ChatGPT verfügbar ist.Einige Plattformen bieten möglicherweise zusätzliche Qualitätsstufen oder Parameteroptionen an, die als "Lite"- im Vergleich zu "Full"-Versionen beschrieben werden könnten. Das offizielle Modell von OpenAI heißt jedoch schlicht "GPT Image 1.5". Falls Kosten- oder Kapazitätsunterschiede zwischen den Plattformimplementierungen bestehen, prüfen Sie die Dokumentation Ihres jeweiligen API-Anbieters für weitere Klärung.

7. Wie lange sind generierte Bild-URLs gültig und wie sollte ich Bilder speichern?

- Sofortiger Download: Richten Sie automatisierte Downloads in Ihrem Workflow ein, um Bilder unmittelbar nach der Generierung zu erfassen.

- Cloud-Speicher: Laden Sie die Bilder auf Ihren eigenen S3, Google Cloud Storage oder einen ähnlichen Dienst zur permanenten Archivierung hoch.

- Erhalt von Metadaten: Speichern Sie die zugehörigen Prompts, Parameter und Generierungs-Zeitstempel zusammen mit jedem Bild für zukünftige Bezugnahme.

- Namenskonventionen: Verwenden Sie beschreibende, durchsuchbare Dateinamen, die Projektkennungen und Versionsnummern enthalten.

- Backup-Strategie: Unterhalten Sie redundante Kopien für kritische Geschäfts-Assets.

1. Bild generieren → Erhalt einer temporären URL

2. Bild innerhalb von 1 Stunde auf lokalen/Cloud-Speicher herunterladen

3. Permanente URL in Ihrer Datenbank speichern

4. Temporäre OpenAI-URL aus Ihren Datensätzen löschen

5. Zukünftig auf Ihre permanente Speicher-URL Bezug nehmen8. Kann GPT Image 1.5 Bilder generieren, die für den Druck geeignet sind, oder ist es nur für die digitale Nutzung gedacht?

- 1024×1024 Pixel (quadratisch)

- 1024×1536 Pixel (Porträt)

- 1536×1024 Pixel (Landschaft)

| Druckgröße | Benötigte DPI | Geeignete Auflösung | GPT Image 1.5 OK? |

|---|---|---|---|

| Social Media | 72 DPI | 1200×1200 | ✓ Ja |

| Website Hero | 72-96 DPI | 1920×1080 | ✓ Ja |

| Präsentationsfolien | 96-150 DPI | 1920×1080 | ✓ Ja |

| Visitenkarte | 300 DPI | 1050×600 | ⚠️ Grenzwertig |

| 8×10" Fotoabzug | 300 DPI | 2400×3000 | ✗ Nein |

| Magazin-Ganzseite | 300 DPI | 2550×3300 | ✗ Nein |

| Plakatwand (Billboard) | 150 DPI+ | 14400×4800+ | ✗ Nein |

- KI-Hochskalierung: Verwenden Sie spezialisierte Upscaling-Werkzeuge (Topaz Gigapixel, Real-ESRGAN), um die Auflösung nach der Generierung zu erhöhen.

- Druckgrößenbeschränkung: Verwenden Sie KI-generierte Bilder nur für kleinere Druckelemente (Icons, Spot-Illustrationen) anstatt für ganze Seiten.

- Digital-First-Strategie: Priorisieren Sie die KI-Generierung für digitale Kanäle und beauftragen Sie herkömmliche Fotografie/Illustration für Druckkampagnen.

- Vektorkonvertierung: Konvertieren Sie KI-Ausgaben für Logos und einfache Grafiken in das Vektorformat für eine auflösungsunabhängige Verwendung.

9. Ist GPT Image 1.5 besser als Midjourney für professionelle Designarbeit?

- Sie eine präzise Kontrolle über iterative Bearbeitungen benötigen.

- Die Workflow-Integration mit ChatGPT Ihrem Team zugutekommt.

- Die Textwiedergabe in Bildern wichtig für Sie ist.

- Eine API-Automatisierung erforderlich ist.

- Die Erhaltung von Logos und Markenelementen eine Rolle spielt.

- Die Geschwindigkeit (4x schneller) eine etwas geringere künstlerische Qualität rechtfertigt.

- Unternehmensfunktionen und Support Prioritäten sind.

- Künstlerische Interpretation Ihre Arbeit aufwertet.

- Ästhetische Qualität an erster Stelle steht.

- Community-Prompt-Bibliotheken und Stile mit Ihrer Marke harmonieren.

- Sie Konzeptkunst, Illustrationen oder kreative Kampagnen erstellen.

- Ein Discord-basierter Workflow in Ihre Teamstruktur passt.

- Budgetbewusste Lösungen benötigt werden.

- Verwenden Sie Midjourney für Hero-Bilder, Banner und Flaggschiff-Kreativinhalte.

- Verwenden Sie GPT Image 1.5 für Produktvarianten, Social-Media-Inhalte und iterative Kundenbewertungen.

- Verwenden Sie herkömmliches Design für den letzten Feinschliff und technische Anforderungen.

10. Was passiert mit GPT Image 1, jetzt da 1.5 verfügbar ist?

- Überlegene Leistung (4x schnellere Generierung).

- Bessere Befolgung von Anweisungen.

- Erweiterte Bearbeitungspräzision.

- 20 % niedrigere Kosten für Ein- und Ausgaben.

- Stetige Weiterentwicklung und Verbesserungen.