GPT Image 1.5 API Produktionsleitfaden: Preise, Latenzmuster und Skalierungsarchitektur

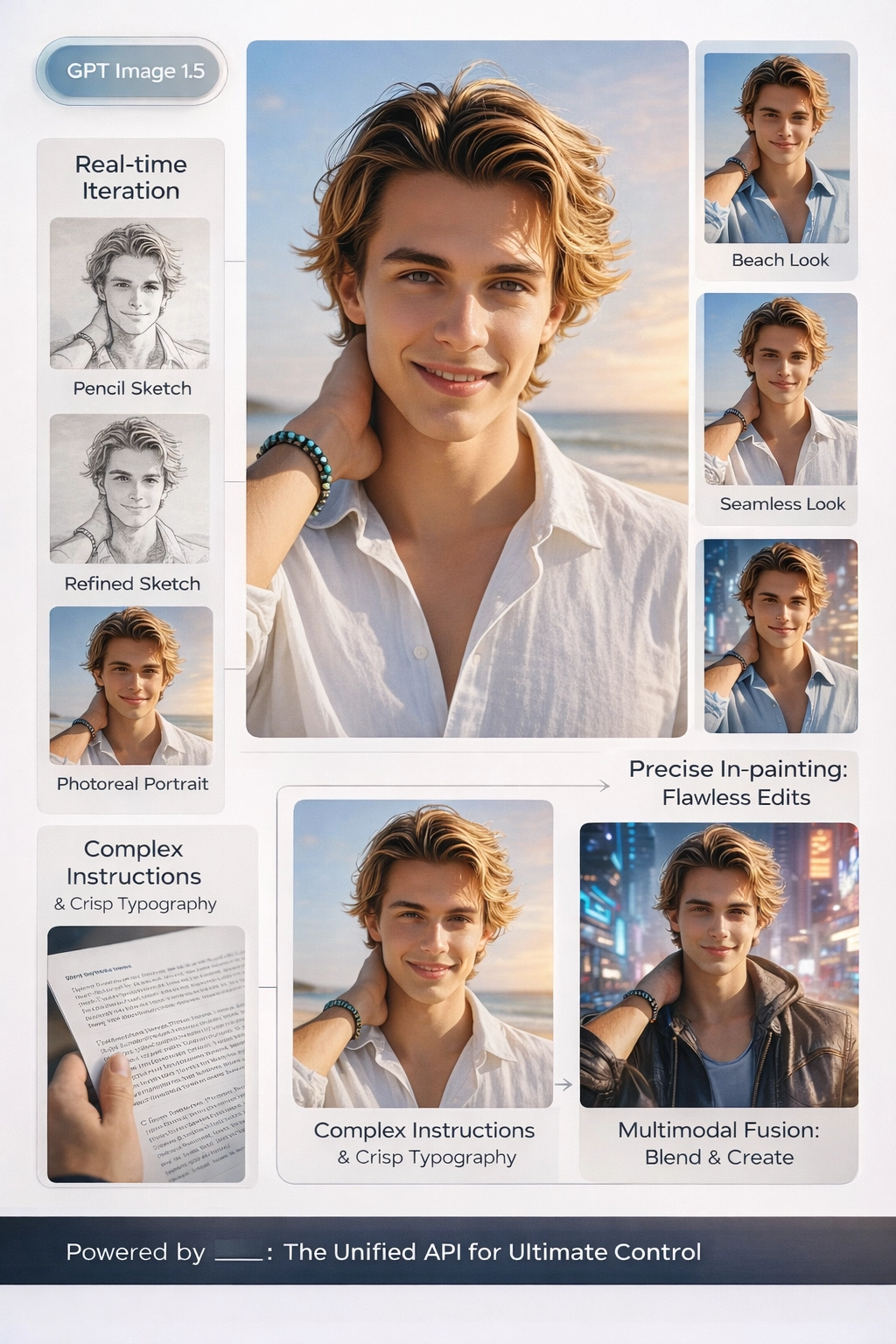

gpt-image-1.5) verfügbar gemacht. Das Release besticht durch eine stärkere Befolgung von Anweisungen, präzisere Bearbeitungsmöglichkeiten, eine verbesserte Darstellung von dichtem Text und Bildgenerierungsgeschwindigkeiten, die bis zu 4-mal schneller sind als bei früheren Versionen.Executive Summary: Was GPT Image 1.5 in der Produktion ändert

GPT Image 1.5 positioniert sich zum Start als das leistungsfähigste Allround-Text-zu-Bild-Modell von OpenAI, mit Schwerpunkt auf:

- Befolgung von Anweisungen: Zuverlässigere Änderungen „bis ins kleinste Detail“.

- Bearbeitung & Bewahrung: Bessere Anwendung von Bearbeitungen, während Schlüsselelemente konsistent bleiben (einschließlich Gesichtsähnlichkeit und Branding-Visuals über Bearbeitungsschritte hinweg).

- Textdarstellung: Verbesserte Fähigkeit, dichten Text innerhalb von Bildern zu rendern.

- Geschwindigkeit: Generierungsgeschwindigkeiten bis zu 4-mal schneller (laut OpenAI).

Wettbewerbslandschaft: GPT Image 1.5 vs. Nano Banana Pro vs. FLUX

| Kategorie | GPT Image 1.5 (OpenAI) | Nano Banana Pro (Google DeepMind) | FLUX Familie (Black Forest Labs) |

|---|---|---|---|

| Positionierung | Allzweck-Bildgenerierung + starke Bearbeitung & Thermentreue | Basiert auf Gemini 3; Fokus auf „Präzision/Kontrolle in Studioqualität“ und klarem Text | Text-zu-Bild + Bearbeitungsvarianten (z. B. Kontext / Fill); Optionen für API-Nutzung und Self-Hosting |

| Text in Bildern | Verbesserte Darstellung von dichtem Text | „Klaren Text generieren“ für Poster/Diagramme | Variiert je nach Modell und Workflow; starkes bearbeitungsorientiertes Portfolio |

| Bearbeitung & Bewahrung | Schwerpunkt auf präzisen Bearbeitungen, die wichtige Details über Schritte hinweg bewahren | Schwerpunkt auf Präzision/Kontrolle bei Bearbeitungen | Starker Bearbeitungskatalog (Kontext / Fill etc.) |

Produktionsleistung: Latenzmuster und Zuverlässigkeit

Häufige Latenztreiber bei Bildmodellen:

- Auflösung & Seitenverhältnis (größere Ausgaben dauern länger)

- Prompt-Komplexität und iterative Bearbeitungen

- Traffic-Spitzen / Warteschlangen

- Retry-Schleifen nach Sicherheitsablehnungen oder temporären Fehlern

- Verwenden Sie Timeouts + Idempotenz-Keys (oder Ihre eigenen Request-IDs)

- Nutzen Sie asynchrone Job-Warteschlangen für lang laufende Generierungen

- Implementieren Sie Graceful Fallbacks (geringere Qualität, kleinere Größe oder alternatives Modell)

Sicherheitsfilter: Planen Sie Ablehnungen als reguläres Ergebnis ein

Die Bild-APIs von OpenAI erzwingen Sicherheitsrichtlinien; Prompts oder Bearbeitungen können abgelehnt werden. In der Produktion sollten Sie „Abgelehnt“ als reguläres Ergebnis behandeln:

- Zeigen Sie den Benutzern aussagekräftiges UI-Feedback

- Protokollieren Sie Ablehnungskategorien (falls verfügbar)

- Bieten Sie Vorschläge für sichere Prompts an

- Vermeiden Sie Retry-Stürme (Rate-Limiting für Re-tries)

Preise: Offizielle GPT Image 1.5 Kosten (Pro Bild + Token)

OpenAI veröffentlicht beides:

- Preise pro Bild nach Qualität und Größe

- Preise für Bild-Token (für Bild-Inputs/Outputs in der Token-Abrechnung)

Preise pro Bild (offiziell)

| Qualität | 1024×1024 | 1024×1536 | 1536×1024 |

|---|---|---|---|

| Niedrig | $0.009 | $0.013 | $0.013 |

| Mittel | $0.034 | $0.05 | $0.05 |

| Hoch | $0.133 | $0.2 | $0.2 |

Preise für Bild-Token (offiziell)

gpt-image-1.5: Bild-Token Input $8 / Output $32 pro 1 Mio. Tokengpt-image-1: Bild-Token Input $10 / Output $40 pro 1 Mio. Token

Developer Experience: Worauf Sie Ihre Architektur ausrichten sollten

Auch wenn das Modell leistungsstark ist, erfordert ein zuverlässiges Produkt ein Engineering für:

- Rate-Limits & Backpressure (Einplanung von 429-Fehlern und Warteschlangen-Requests)

- Schema-Drift zwischen Anbietern (unterschiedliche Parameter, Fehlercodes, Antwortformate)

- Observability (Kosten pro Request, Latenzperzentile, Fehlergründe, Fallback-Raten)

Die EvoLink-Perspektive: Einheitliche API-Muster

Ein einheitlicher Gateway-Ansatz kann den betrieblichen Aufwand reduzieren durch:

- Standardisierung von Request/Response-Formaten über verschiedene Anbieter hinweg

- Hinzufügen von Routing-Regeln (z. B. GPT Image 1.5 für textlastige Poster wählen; ein anderes Modell für fotorealistische Szenen wählen, falls akzeptabel)

- Implementierung von Fallback-Strategien, wenn ein Anbieter ablehnt oder einen Fehler liefert

- Bereitstellung zentraler Nutzungsanalysen zur Kosten- und Leistungsüberwachung

Quick-Start: GPT Image 1.5 über EvoLink

EvoLink bietet einen einheitlichen Endpunkt für GPT Image 1.5, der Text-zu-Bild, Bild-zu-Bild und Bildbearbeitungsmodi mit asynchroner Verarbeitung unterstützt.

POST https://api.evolink.ai/v1/images/generations| Parameter | Typ | Erforderlich | Beschreibung |

|---|---|---|---|

| model | string | Ja | Nutzen Sie gpt-image-1.5-lite |

| prompt | string | Ja | Bildbeschreibung, max. 2000 Token |

| size | enum | Nein | 1:1, 3:4, 4:3, 1024x1024, 1024x1536, 1536x1024 |

| quality | enum | Nein | low, medium, high, auto (Standard) |

| image_urls | array | Nein | 1-16 Referenzbilder zur Bearbeitung, max. je 50MB |

| n | integer | Nein | Anzahl der Bilder (aktuell wird 1 unterstützt) |

Beispiel: Text-zu-Bild

curl --request POST \

--url https://api.evolink.ai/v1/images/generations \

--header 'Authorization: Bearer IHR_API_KEY' \

--header 'Content-Type: application/json' \

--data '{

"model": "gpt-image-1.5-lite",

"prompt": "A professional product photo of a sleek smartwatch on a marble surface, soft studio lighting, 4K quality",

"size": "1024x1024",

"quality": "high"

}'Beispiel: Bildbearbeitung

curl --request POST \

--url https://api.evolink.ai/v1/images/generations \

--header 'Authorization: Bearer IHR_API_KEY' \

--header 'Content-Type: application/json' \

--data '{

"model": "gpt-image-1.5-lite",

"prompt": "Change the background to a sunset beach scene, keep the product unchanged",

"image_urls": ["https://ihr-cdn.beispiel.de/produktfoto.jpg"],

"size": "1024x1024",

"quality": "high"

}'Antwortformat

Die API gibt einen asynchronen Task zurück. Fragen Sie den Task-Status über die zurückgegebene ID ab:

{

"created": 1757156493,

"id": "task-unified-1757156493-imcg5zqt",

"model": "gpt-image-1.5-lite",

"status": "pending",

"progress": 0,

"task_info": {

"can_cancel": true,

"estimated_time": 100

},

"usage": {

"credits_reserved": 2.5

}

}Hinweis: Generierte Bilder laufen nach 24 Stunden ab. Laden Sie diese umgehend herunter.

Fazit

gpt-image-1.5) ist ein wichtiger Schritt für produktionsreife Bild-Workflows im Jahr 2025. OpenAI legt expliziten Wert auf eine bessere Befolgung von Anweisungen, präzisere Bearbeitungen unter Beibehaltung wichtiger Details, eine verbesserte Textdarstellung und eine bis zu 4-mal schnellere Generierung.Um zuverlässig im großen Stil zu liefern, behandeln Sie Bilder als Infrastruktur-Problem: Messen Sie Latenzverteilungen, budgetieren Sie mit offiziellen Preisen, gehen Sie souverän mit Sicherheitsablehnungen um und entwerfen Sie Routing/Fallback-Muster, die sowohl das Benutzererlebnis als auch die Wirtschaftlichkeit schützen.