GPT-5.4 vs Claude Opus 4.6 vs Gemini 3.1 Pro: Welches Flaggschiff‑Modell gewinnt 2026?

Letztes Update: 6. März 2026 · Preise verifiziert im März 2026

Claude Opus 4.6 führt bei der Code‑Qualität in den veröffentlichten Herstellerwerten, Gemini 3.1 Pro bietet 1M Kontext zu $2/1M Input (Quelle: ai.google.dev Pricing), und GPT‑5.4 ist jetzt via OpenRouter gelistet ($2.50/$20, 1M Kontext, 128K Max Output). Wenn du heute entscheiden musst, ist Gemini 3.1 Pro weiterhin das beste Preis‑Leistungs‑Verhältnis; Opus 4.6 bleibt am stärksten für komplexes Coding und Agent‑Workflows; GPT‑5.4 solltest du parallel per Routing evaluieren.

Hier ist der vollständige Überblick.

TL;DR

- Gemini 3.1 Pro ist Preis/Leistungs‑König: $2.00/$12.00 pro 1M Tokens, 1M Kontext, 80,6% SWE‑bench.

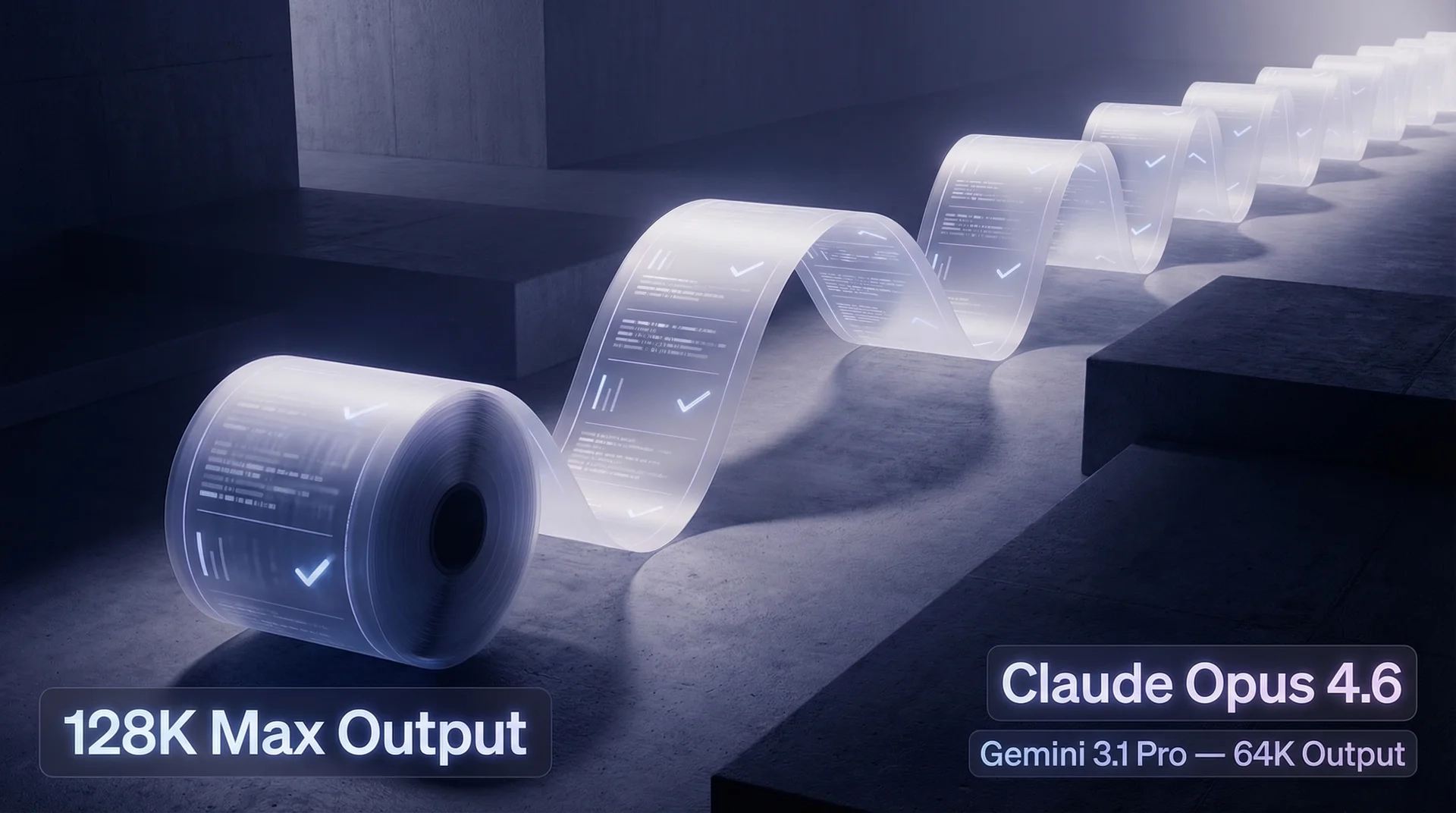

- Claude Opus 4.6 gewinnt bei Code‑Qualität: 80,8% SWE‑bench (single attempt) und 81,42% mit Prompt‑Modifikation, 128K Max Output, Agent Teams; >200K Tokens kosten Premium ($10/$37.50 pro 1M).

- GPT‑5.4 ist auf OpenRouter gelistet: $2.50/$20 pro 1M Tokens, $0.625 cached input, 1M Kontext, 128K Max Output. Breite unabhängige Benchmarks sind noch begrenzt.

- Budget‑Teams: GPT‑5.2 bleibt stark mit $1.75/$14 pro 1M, 400K Kontext, 80,0% SWE‑bench.

- Nicht auf GPT‑5.4 blockieren: Baue mit Gemini 3.1 Pro oder Opus 4.6 und teste GPT‑5.4 parallel im Eval‑Pfad.

Schnellvergleich

Jede Zelle ist auf Primärquellen zurückgeführt. Preise Stand März 2026.

| Claude Opus 4.6 | Gemini 3.1 Pro | GPT-5.4 (OpenRouter) | GPT-5.2 | |

|---|---|---|---|---|

| Anbieter | Anthropic | Google DeepMind | OpenAI | OpenAI |

| Status | ✅ Verfügbar | ✅ Verfügbar | ✅ Verfügbar via OpenRouter | ✅ Verfügbar |

| Kontext | 200K (1M beta, tier 4/custom limits) | 1M | 1M | 400K |

| Max. Ausgabe | 128K tokens | 64K tokens | 128K tokens | 128K tokens |

| Eingabe (/1M) | $5.00 (≤200K) / $10.00 (>200K) | $2.00 (≤200K) / $4.00 (>200K) | $2.50 (cached input: $0.625) | $1.75 |

| Ausgabe (/1M) | $25.00 (≤200K) / $37.50 (>200K) | $12.00 (≤200K) / $18.00 (>200K) | $20.00 | $14.00 |

| Denkmodus | Erweitertes Denken | Standard | Öffentliche Modus-Namen noch begrenzt | Standard + tiefes Denken |

| SWE-bench | 80.8% (single) / 81.42% (prompt mod.) | 80.6% (single) | Noch keine breit akzeptierte öffentliche Zahl | 80.0% |

| Am besten für | Komplexes Coding, Agent-Orchestrierung | Langer Kontext, multimodal, hoher Gegenwert | Offen | Budget-Coding, allgemein |

Quellen: anthropic.com/pricing · anthropic.com/docs/models/claude-opus-4-6 · ai.google.dev pricing · deepmind.google model card · platform.openai.com/docs/models/gpt-5.2 · openrouter.ai/openai/gpt-5.4

Wann welches Modell?

Claude Opus 4.6, wenn du maximale Code‑Qualität willst

In der DeepMind‑Tabelle liegt Opus 4.6 bei 80,8% SWE‑bench (single attempt). Anthropic meldet bis 81,42% mit Prompt‑Modifikation und 25‑Trial‑Averaging (Quelle: anthropic.com/news/claude-opus-4-6). 128K Max Output ist Klassenbestwert.

Agent Teams ist besonders für Multi‑Agent‑Systeme nützlich.

Trade‑off sind die Kosten: ≤200K $5/$25 pro 1M, >200K $10/$37.50. Das Verhältnis zu Gemini bleibt stabil (2,5× Input, ~2,08× Output).

Best cases: SWE‑bench‑artige Reparaturen, Multi‑Agent‑Pipelines, lange Outputs (>64K), sicherheitskritische Anwendungen.

Gemini 3.1 Pro, wenn du den besten Wert willst

Gemini 3.1 Pro kombiniert 1M nativen Kontext mit starken Benchmarks zum niedrigsten Preis. Bei $2.00/$12.00 (≤200K) kostet es weniger als die Hälfte von Opus und liegt nur 0,2 Punkte zurück.

Zusätzliche Stärken:

- GPQA Diamond: 94,3%

- ARC‑AGI‑2: 77,1%

- HLE: 44,4%

- Terminal‑Bench 2.0: 68,5%

- Native Multimodalität: Text + Bild + Audio + Video

Hauptlimit: 64K Max Output.

Best cases: Lange Dokumente, multimodale Apps, kosten‑sensitive APIs, Codebases in 1M Kontext.

GPT‑5.4 jetzt im kontrollierten Rollout evaluieren

Aktuelle öffentliche OpenRouter-Daten:

- 1M Kontext

- 128K Max Output

- $2.50 / 1M Input, $0.625 / 1M cached input, $20.00 / 1M Output

Was weiterhin fehlt: breite, unabhängige Benchmark-Abdeckung über reale Produktions-Workloads.

Pragmatisch: Gemini/Opus im Hauptpfad lassen, GPT‑5.4 mit kleinem Traffic-Anteil testen und erst nach bestandenen Evals hochfahren.

Deep Dive: Kontextfenster

| Modell | Kontextfenster | Hinweise |

|---|---|---|

| Gemini 3.1 Pro | 1M tokens | Produktionsreifer 1M-Kontext |

| GPT-5.4 | 1M tokens | Auf OpenRouter gelistet |

| GPT-5.2 | 400K tokens | Jetzt verfügbar |

| Claude Opus 4.6 | 200K (1M beta) | 1M beta nur mit Tier 4/custom limits |

Für große Codebases ist 1M Kontext bei Gemini klarer Vorteil. Opus 1M beta ist auf usage tier 4/custom limits begrenzt.

Deep Dive: Reasoning

| Modell | Denkmodus | Kernstärke |

|---|---|---|

| Claude Opus 4.6 | Erweitertes Denken | Mehrstufiges Debugging, Architekturplanung |

| Gemini 3.1 Pro | Standard (mit Denkunterstützung) | GPQA Diamond 94.3%, ARC-AGI-2 77.1% |

| GPT-5.4 | Öffentliche Modus-Namen noch begrenzt | Mit eigener Eval-Suite validieren |

Opus eignet sich für strukturiertes Multi‑Step‑Reasoning; Gemini glänzt in GPQA.

Deep Dive: Pricing & Kosten

Kosten pro Aufgabe (geschätzt)

Schätzungen pro Task.

| Aufgabe | Tokens (Ein/Aus) | GPT-5.2 | Gemini 3.1 Pro | Claude Opus 4.6 |

|---|---|---|---|---|

| Einfacher Chat | 1K / 500 | $0.009 | $0.008 | $0.018 |

| Code-Review (eine Datei) | 5K / 2K | $0.037 | $0.034 | $0.075 |

| Lange Dokumentanalyse | 100K / 5K | $0.245 | $0.260 | $0.625 |

| Komplette Codebase (200K+ Kontext) | 300K / 10K | $0.665 | $1.380* | $3.375** |

*Gemini 3.1 Pro >200K: $4.00/$18.00 pro 1M Tokens.

**Claude Opus 4.6 >200K: $10.00/$37.50 pro 1M Tokens.

Bei hohem Kontext steigen Gemini und Opus, das Verhältnis bleibt stabil; absolute Differenz wächst. Ranking‑Shift betrifft vor allem GPT‑5.2.

Über EvoLink (evolink.ai/models) kannst du Opus 4.6 und Gemini 3.1 Pro vergünstigt via OpenAI‑kompatiblem Endpoint nutzen.

Deep Dive: Coding‑Performance

| Modell | SWE-bench | Bedingungen | Quelle |

|---|---|---|---|

| Claude Opus 4.6 | 80.8% (single) / 81.42% (prompt mod.) | Gemischte Quellen | deepmind.google model card / anthropic.com/news/claude-opus-4-6 |

| Gemini 3.1 Pro | 80.6% (single) | Google-Evaluierung | deepmind.google model card |

| GPT-5.2 | 80.0% | OpenAI-Evaluierung | platform.openai.com |

| GPT-5.4 | Noch keine breit akzeptierte öffentliche Zahl | — | Auf OpenRouter verfügbar |

Wichtiger Hinweis: Methodiken unterscheiden sich; 0,2% sind oft im Rauschen.

Praktische Unterschiede:

- Opus 4.6: 128K Max Output.

- Gemini 3.1 Pro: 1M Kontext. Terminal‑Bench 2.0: 68,5%.

- GPT‑5.2: am günstigsten mit $1.75/1M Input.

Entscheidungsrahmen

Nach deiner Haupt‑Constraint:

Budget?

→ GPT‑5.2 ($1.75/$14) oder Gemini 3.1 Pro ($2/$12)

Mehr als 200K Kontext in Produktion?

→ Gemini 3.1 Pro (1M nativ) oder GPT‑5.4 in geroutetem Traffic pilotieren

Maximale Code‑Qualität & lange Outputs?

→ Claude Opus 4.6 (80,8% SWE‑bench, 128K Output)

Multimodal (Video/Audio)?

→ Gemini 3.1 Pro

Multi‑Agent‑Systeme?

→ Claude Opus 4.6 (Agent Teams)

Wissenschaftliches Reasoning?

→ Gemini 3.1 Pro (GPQA Diamond 94,3%)

Ein API für mehrere Modelle?

→ EvoLink (evolink.ai)

Soll ich jetzt auf GPT‑5.4 umstellen?

Kurz: nicht als Hard-Switch, sondern als kontrollierten Rollout.

GPT‑5.4 ist auf OpenRouter verfügbar, aber du solltest Qualität, Latenz und Kosten auf deinen eigenen Workloads verifizieren, bevor du breit migrierst.

Pragmatisch:

- Jetzt mit Gemini 3.1 Pro oder Claude Opus 4.6 liefern

- API-Routing nutzen, um Modelle per Konfiguration zu wechseln

- GPT‑5.4 direkt im eigenen Benchmark-Set evaluieren

- Nur bei klaren Gewinnen schrittweise migrieren

FAQ

Ist GPT‑5.4 besser als Claude Opus 4.6?

Kommt auf deine Aufgaben an. GPT‑5.4 ist gelistet, aber es gibt noch keine breite unabhängige Benchmark-Konsenslage. Opus 4.6 bleibt mit 80,8% (single) und 81,42% (prompt mod.) ein starker Referenzpunkt.

Was ist günstiger: Opus 4.6 oder Gemini 3.1 Pro?

Gemini 3.1 Pro. ≤200K: $2.00/$12.00 vs Opus $5.00/$25.00. >200K: $4.00/$18.00 vs Opus $10.00/$37.50.

Wie groß ist der Kontext von Gemini 3.1 Pro?

1M Tokens in Produktion.

Ist GPT‑5.4 jetzt verfügbar?

openai/gpt-5.4) mit veröffentlichten Tokenpreisen und Limits. Verfügbarkeit und Billing können je nach Kanal und Vertrag variieren.Kann ich 1M Kontext mit Opus 4.6 nutzen?

Standard ist 200K; 1M beta erfordert usage tier 4 oder custom limits.

Welches Modell ist am besten für Code?

Single‑attempt‑Tabelle: Opus 80,8%, Gemini 80,6%, GPT‑5.2 80,0%. Anthropic berichtet 81,42% mit Prompt‑Modifikation.

Ist Gemini 3.1 Pro gut für Multimodal?

Ja, es unterstützt Text, Bild, Audio und Video nativ.

Seite wird aktualisiert. Letzter Check: 2026‑03‑06.

GPT‑5.4 zum Launch nutzen? EvoLink‑Account erstellen (evolink.ai).