Ein Entwickler-Leitfaden zum Load Balancer Router

Anstatt zuzulassen, dass ein Server überlastet wird, verteilt der Router eingehende Anfragen intelligent über einen Pool von Servern oder, im Kontext moderner KI-Anwendungen, über verschiedene KI-Modelle. Das Ergebnis ist eine hochverfügbare, leistungsstarke Anwendung, die Ihren Benutzern ein nahtloses Erlebnis bietet.

Wie funktioniert ein Load Balancer Router?

Im Kern ist ein Load Balancer Router darauf ausgelegt, Single Points of Failure zu eliminieren. In einer typischen Single-Server-Architektur kommt Ihre gesamte Anwendung zum Stillstand, wenn dieser Server überlastet ist oder offline geht.

Ein Load Balancer Router sitzt zwischen Ihren Benutzern und Ihrem Server-Pool, fängt jede eingehende Anfrage ab und entscheidet, welche Downstream-Ressource in diesem Moment am besten geeignet ist, sie zu bearbeiten. Dieses Konzept hat sich von frühen Hardware-Appliances erheblich zu der hochentwickelten Softwareschicht entwickelt, die modernen, verteilten Systemen zugrunde liegt. Das Verständnis dieses Prinzips ist der erste Schritt zum Aufbau resilienter Systeme, insbesondere wenn man es mit der unvorhersehbaren Natur des API-Verkehrs zu tun hat.

Warum jede moderne Anwendung einen benötigt

Für Entwickler bietet ein gut implementierter Load Balancer entscheidende Vorteile:

- Hohe Verfügbarkeit: Wenn ein Server oder API-Endpunkt ausfällt oder nicht mehr reagiert, entfernt der Router ihn automatisch aus dem Pool und leitet den Verkehr an gesunde Instanzen um. Ihre Anwendung bleibt online.

- Skalierbarkeit: Um eine erhöhte Last zu bewältigen, fügen Sie einfach weitere Server zum Pool hinzu. Der Load Balancer beginnt sofort damit, den Verkehr zu ihnen zu leiten, was eine horizontale Skalierung ohne Ausfallzeiten ermöglicht.

- Verbesserte Leistung: Durch die Verteilung der Arbeitslast stellen Sie sicher, dass Benutzeranfragen immer von einem reaktionsschnellen Server bearbeitet werden, was die Latenz verringert und das gesamte Benutzererlebnis verbessert.

Betrachten Sie einen Load Balancer Router als die erste Verteidigungslinie Ihrer Anwendung gegen Ausfälle. Er verwandelt eine Sammlung unabhängiger Server in ein einziges, leistungsstarkes und resilientes System.

Das Meistern dieses Konzepts ermöglicht es Ihnen, von Grund auf auf Resilienz auszulegen, anstatt sie als nachträglichen Gedanken zu behandeln.

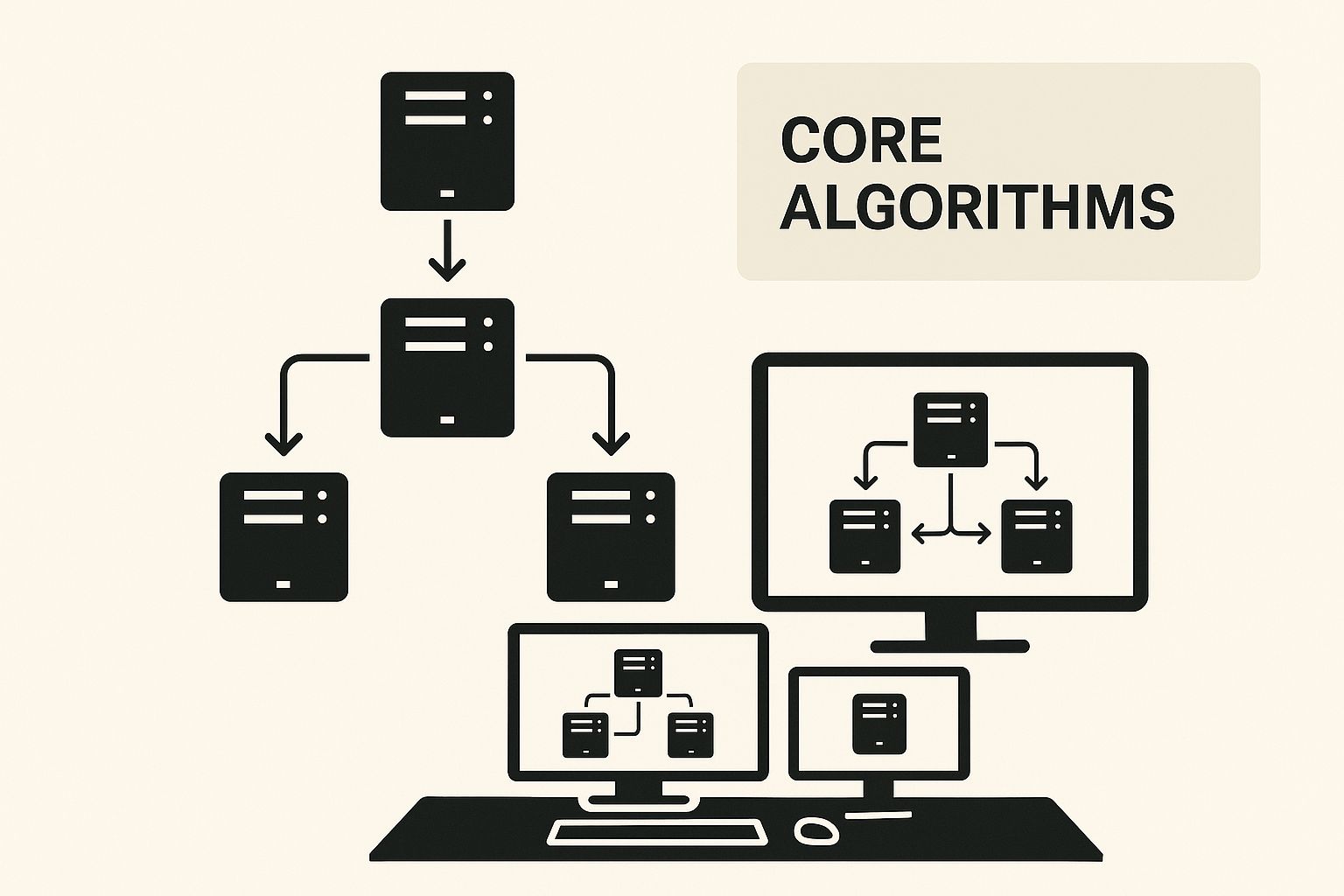

Grundlegende Load-Balancing-Algorithmen verstehen

Diese Algorithmen liefern die Logik für die Verteilung der Arbeitslast. Die folgende Infografik veranschaulicht, wie verschiedene Strategien zusammenarbeiten, um den Netzwerkverkehr effektiv zu verwalten.

Wie Sie sehen können, sind diese grundlegenden Methoden die Bausteine für anspruchsvollere Routing-Entscheidungen. Das Ziel ist es zu verhindern, dass ein einzelner Server überlastet wird und einen systemweiten Ausfall verursacht.

Gängige Verteilungsmethoden

Wie entscheidet ein Load Balancer also, wohin der Verkehr gesendet werden soll? In der Regel verwendet er einen von mehreren Standardalgorithmen.

-

Round Robin: Dies ist die einfachste und gängigste Methode. Der Load Balancer durchläuft eine Liste von Servern und sendet jede neue Anfrage an den nächsten Server in der Reihenfolge. Es ist vorhersehbar, setzt aber voraus, dass alle Server die gleiche Kapazität haben und alle Anfragen ähnliche Verarbeitungskosten verursachen.

-

Wenigste Verbindungen (Least Connections): Dies ist eine dynamischere Strategie. Der Algorithmus leitet neue Anfragen an den Server mit den wenigsten aktiven Verbindungen weiter. Dies ist besonders effektiv in Umgebungen, in denen die Verbindungsdauer variiert, und verhindert, dass ein Server mit lang laufenden Aufgaben belegt ist, während andere untätig sind.

-

IP-Hash: Diese Methode verwendet einen Hash der IP-Adresse des Clients, um diesen Client konsistent demselben Server zuzuordnen. Der Hauptvorteil ist die Sitzungspersistenz (oder „Stickiness“), die für zustandsbehaftete Anwendungen wie E-Commerce-Warenkörbe entscheidend ist, bei denen Benutzersitzungsdaten auf einem bestimmten Server erhalten bleiben müssen.

Vergleich gängiger Load-Balancing-Algorithmen

Die Wahl des richtigen Algorithmus hängt von den spezifischen Anforderungen Ihrer Anwendung ab. Diese Tabelle schlüsselt die gängigsten Methoden auf, um Ihnen den Vergleich zu erleichtern.

| Algorithmus | Funktionsweise | Bestens geeignet für | Potenzieller Nachteil |

|---|---|---|---|

| Round Robin | Verteilt Anfragen sequenziell an jeden Server in einer Liste. | Umgebungen, in denen Server identisch und Anfragen einheitlich sind. | Berücksichtigt weder Serverlast noch unterschiedliche Verarbeitungszeiten. |

| Least Connections | Sendet neue Anfragen an den Server mit den wenigsten aktiven Verbindungen. | Situationen mit langlebigen Verbindungen oder ungleichmäßiger Anfragelast. | Die Verfolgung von Verbindungen kann rechenintensiver sein. |

| IP-Hash | Weist eine Anfrage einem bestimmten Server basierend auf der Quell-IP-Adresse zu. | Anwendungen, die Sitzungspersistenz erfordern (z. B. Warenkörbe). | Kann zu ungleichmäßiger Verteilung führen, wenn bestimmte IP-Adressen viele Anfragen senden. |

| Weighted Round Robin | Eine Variation von Round Robin, bei der Servern basierend auf ihrer Kapazität ein „Gewicht“ zugewiesen wird. | Umgebungen mit Servern unterschiedlicher Verarbeitungskapazitäten. | Erfordert manuelle Konfiguration von Gewichten und Anpassungen im Laufe der Zeit. |

Letztendlich gibt es keinen einzigen „besten“ Algorithmus. Das Ziel ist es, die Verteilungslogik an das Verhalten Ihrer Anwendung und die Architektur Ihrer Infrastruktur anzupassen.

Gewichtetes und intelligentes Routing

Während diese klassischen Algorithmen für herkömmlichen Webverkehr effektiv sind, greifen sie zu kurz, wenn es darum geht, KI-Anfragen über mehrere Anbieter zu routen. Ein einfacher Round-Robin-Algorithmus hat kein Konzept von Kosten oder Verfügbarkeit; er könnte Ihre Anfrage blind an einen teuren oder nicht verfügbaren Anbieter senden. Dies ist genau das Problem, das ein fortschrittlicher Load Balancer Router wie EvoLink löst, indem er Ihr gewähltes Modell in Echtzeit intelligent zum kostengünstigsten und zuverlässigsten Anbieter routet.

Die moderne Herausforderung des KI-Modell-Routings

Traditionelles Load Balancing geht davon aus, dass Sie den Verkehr über eine Flotte identischer Server verteilen. Dieses Modell funktioniert gut für zustandslose Webanfragen, bricht aber völlig zusammen, wenn es auf das vielfältige Ökosystem von KI-Modellen angewendet wird.

Modelle wie GPT-4, Llama 3 und Claude Haiku sind nicht austauschbar. Sie unterscheiden sich erheblich in ihren Argumentationsfähigkeiten, ihrer Antwortlatenz und vor allem in ihren Kosten pro Token. Dies verwandelt das Problem von einer einfachen Verkehrsverteilung in ein komplexes Optimierungsrätsel mit mehreren Zielen.

Die Verwendung eines einfachen Round-Robin-Ansatzes ist hier ineffizient und kostspielig. Sie könnten eine einfache Zusammenfassungsaufgabe an Ihr leistungsstärkstes (und teuerstes) Modell routen, während eine komplexe analytische Abfrage an ein schnelleres, aber weniger fähiges Modell gesendet werden könnte, was zu einer suboptimalen Antwort führt.

Von einheitlichen Servern zu mehreren KI-Anbietern

Sobald Sie Ihr gewünschtes KI-Modell ausgewählt haben, muss ein KI-nativer Router für jede Anfrage mehrere Faktoren bewerten:

- Anbieterkosten: Dasselbe GPT-4-Modell kann bei einem Anbieter zehnmal mehr kosten als bei einem anderen. Das Finden des günstigsten verfügbaren Anbieters für Ihr gewähltes Modell bringt sofortige Einsparungen.

- Anbieterverfügbarkeit: Ist der Anbieter derzeit online und reaktionsschnell? Echtzeit-Zustandsprüfungen stellen sicher, dass Ihre Anfragen immer einen funktionierenden Endpunkt erreichen.

- Anbieterlatenz: Welcher Anbieter bietet in diesem Moment die schnellste Antwortzeit? Dynamisches Leistungsmonitoring routet in diesem Augenblick zum reaktionsschnellsten Anbieter.

Ein intelligenter KI-Router gleicht nicht nur Lasten aus; er optimiert die Geschäftsergebnisse. Für Ihr ausgewähltes Modell trifft er bei jedem API-Aufruf eine dynamische, fundierte Entscheidung, um durch die Wahl des optimalen Anbieters die beste Leistung zu den niedrigstmöglichen Kosten zu erzielen.

Ein Code-Beispiel für intelligentes Anbieter-Routing

Diese konzeptionelle JavaScript-Funktion demonstriert die Logik für die Auswahl des optimalen Anbieters für ein gewähltes Modell. Sie prüft Anbieterverfügbarkeit und Kosten, um zum besten Endpunkt zu routen.

// Eine konzeptionelle Funktion zur Auswahl des besten Anbieters für ein gewähltes Modell

async function routeToProvider(selectedModel) {

// Der Benutzer hat bereits GPT-4 als sein Modell ausgewählt

const providers = [

{ name: 'OpenAI', endpoint: 'https://api.openai.com/v1/chat/completions', cost: 0.03, available: true },

{ name: 'Azure', endpoint: 'https://azure.openai.com/v1/chat/completions', cost: 0.035, available: true },

{ name: 'Provider-A', endpoint: 'https://api.provider-a.com/v1/gpt-4', cost: 0.015, available: true },

{ name: 'Provider-B', endpoint: 'https://api.provider-b.com/v1/gpt-4', cost: 0.012, available: false }

];

// Filtern auf verfügbare Anbieter

const availableProviders = providers.filter(p => p.available);

// Nach Kosten sortieren, die günstigsten zuerst

availableProviders.sort((a, b) => a.cost - b.cost);

// Den günstigsten verfügbaren Anbieter auswählen

const selectedProvider = availableProviders[0];

console.log(`Route ${selectedModel} zu ${selectedProvider.name} zu $${selectedProvider.cost} pro Anfrage`);

// In einer realen Anwendung würden Sie den API-Aufruf hier tätigen

// const response = await fetch(selectedProvider.endpoint, { ... });

// return response.json();

return {

model: selectedModel,

provider: selectedProvider.name,

endpoint: selectedProvider.endpoint,

cost: selectedProvider.cost

};

}

// Beispielnutzung - Benutzer hat GPT-4 ausgewählt

routeToProvider('GPT-4').then(result => console.log(result));Während dieser Code das Kernkonzept veranschaulicht, beinhaltet der Aufbau eines produktionsreifen Systems viel mehr: die Verwaltung von API-Schlüsseln für Dutzende von Anbietern, die Verfolgung von Preisen und Verfügbarkeit in Echtzeit, die Implementierung eines automatischen Failovers bei Ausfall von Anbietern und die kontinuierliche Überwachung der Leistung.

Fortgeschrittenes KI-Routing mit EvoLink in die Tat umsetzen

Der Aufbau eines intelligenten KI-Routers von Grund auf ist eine bedeutende technische Herausforderung. Er erfordert die Verwaltung mehrerer API-Schlüssel, die Überwachung der Modellleistung in Echtzeit, die Codierung einer robusten Failover-Logik und die kontinuierliche Aktualisierung des Systems, wenn neue Modelle veröffentlicht werden. Aus diesem Grund ist eine verwaltete Lösung wie EvoLink ein Game-Changer für Entwicklungsteams.

Dieser einheitliche Ansatz reduziert den betrieblichen Aufwand drastisch und macht Ihr Engineering-Team frei, sich auf Ihr Kernprodukt zu konzentrieren, anstatt die KI-Infrastruktur zu verwalten.

Wie intelligentes Routing in der Praxis funktioniert

So bieten die Kernfunktionen von EvoLink greifbare Vorteile:

- Automatisches Modell-Failover: Wenn bei einem primären Anbieter wie OpenAI ein Ausfall oder eine Leistungsverschlechterung auftritt, leitet EvoLink API-Aufrufe automatisch zu einem gesunden Alternativanbieter um, der dasselbe Modell anbietet. Ihre Anwendung funktioniert nahtlos weiter.

- Dynamisches Leistungs-Routing: Das System überwacht kontinuierlich die Latenz und den Durchsatz aller verfügbaren Anbieter für Ihr gewähltes Modell und sendet jede Anfrage an den Anbieter, der in diesem Moment die schnellste Antwort liefern kann.

- Intelligente Kostenoptimierung: EvoLink leitet Ihre Anfrage automatisch zum kostengünstigsten Anbieter für Ihr gewähltes Modell weiter und vergleicht ständig die Preise bei Dutzenden von Anbietern, um sicherzustellen, dass Sie immer den besten Tarif erhalten.

Durch die intelligente Steuerung des Verkehrs erzielen Entwickler, die EvoLink nutzen, oft Kosteneinsparungen zwischen 20 und 70 %. Dabei geht es nicht nur darum, den günstigsten Anbieter auszuwählen, sondern darum, für jede Anfrage die klügste Anbieterwahl zu treffen, um Leistung und Budget in Einklang zu bringen, während Sie Ihre bevorzugten Modelle verwenden.

Ein praktisches Code-Beispiel mit EvoLink

Betrachten Sie dieses Python-Beispiel. Sie geben eine priorisierte Liste von Modellen an, und EvoLink verwaltet das gesamte Routing, die Optimierung und das Failover automatisch.

import os

import requests

# Setzen Sie Ihren EvoLink-API-Schlüssel aus den Umgebungsvariablen

api_key = os.getenv("EVOLINK_API_KEY")

api_url = "https://api.evolink.ai/v1/chat/completions"

headers = {

"Authorization": f"Bearer {api_key}",

"Content-Type": "application/json"

}

# Definieren Sie Ihr bevorzugtes Modell mit Fallback-Optionen

# EvoLink routet jedes Modell zum günstigsten verfügbaren Anbieter

# Wenn Ihre erste Wahl nicht verfügbar ist, erfolgt ein Failover auf das nächste Modell in Ihrer Liste

payload = {

"model": ["openai/gpt-4o", "anthropic/claude-3.5-sonnet", "google/gemini-1.5-pro"],

"messages": [

{"role": "user", "content": "Analyze the sentiment of this customer review: 'The product is good, but the shipping was slow.'"}

]

}

try:

response = requests.post(api_url, headers=headers, json=payload)

response.raise_for_status() # Löst einen HTTPError bei schlechten Antworten aus (4xx oder 5xx)

print(response.json())

except requests.exceptions.RequestException as e:

print(f"Ein API-Fehler ist aufgetreten: {e}")Dieses Snippet demonstriert die Macht der Abstraktion. Ihr Anwendungscode bleibt sauber und auf die Geschäftslogik konzentriert, während ein leistungsstarker Load Balancer Router im Hintergrund arbeitet, um Ihre Anwendung resilienter und kostengünstiger zu machen.

EvoLink macht den Aufbau und die Wartung eines komplexen hausinternen Systems überflüssig und bietet eine produktionsreife Lösung, die sofortige Ergebnisse liefert. Dies ermöglicht es Ihrem Team, erstklassige KI-Fähigkeiten schneller und effizienter zu integrieren.

Praktische Routing-Strategien, die Sie implementieren können

Lassen Sie uns vier praktische Strategien untersuchen, die Sie implementieren können.

Kostenbasiertes Routing

Diese Strategie priorisiert Ihr Budget. Kostenbasiertes Routing sendet Ihre Anfrage automatisch zum günstigsten Anbieter für Ihr gewähltes Modell.

Latenzbasiertes Routing

Wenn das Benutzererlebnis an erster Stelle steht, ist latenzbasiertes Routing die optimale Wahl. Es ist unerlässlich für Echtzeitanwendungen wie Kundenservice-Chatbots oder interaktive KI-Tools, bei denen jede Millisekunde zählt.

Der Router überwacht kontinuierlich die Echtzeit-Leistung aller verfügbaren Anbieter für Ihr gewähltes Modell. Wenn eine Anfrage eingeht, wird sie sofort an den Anbieter mit der aktuell niedrigsten Antwortzeit weitergeleitet, um sicherzustellen, dass Ihre Benutzer die schnellstmögliche Antwort erhalten, ohne das verwendete Modell zu ändern.

Failover-Routing

Failover-Routing ist das Sicherheitsnetz Ihrer Anwendung. Unweigerlich kommt es bei API-Anbietern zu Ausfällen oder Leistungsverschlechterungen. In diesem Fall leitet der Router Anfragen automatisch an das nächste gesunde Modell in einer vordefinierten Prioritätsliste um.

Diese Strategie ist grundlegend für den Aufbau von Hochverfügbarkeitssystemen, die Anbieterfehler reibungslos verarbeiten können, ohne dass dies Auswirkungen auf das Endbenutzererlebnis hat.

Häufig gestellte Fragen

Was ist der Unterschied zwischen einem Load Balancer und einem Router?

Obwohl sie oft zusammen verwendet werden, erfüllen diese Komponenten unterschiedliche Funktionen in einem Netzwerk.

Kann ich meinen eigenen Load Balancer für KI-Modelle bauen?

Technisch gesehen, ja, Sie können eine maßgeschneiderte Lösung bauen. Die Komplexität eines produktionsreifen KI-Routers ist jedoch beträchtlich.

Eine robuste Lösung erfordert mehr als nur eine einfache Anfrageverteilung. Sie wären dafür verantwortlich, Dutzende von API-Schlüsseln sicher zu verwalten, Kosten und Latenz für jedes Modell in Echtzeit zu verfolgen, zuverlässige Zustandsprüfungen zu implementieren und eine effektive Failover-Logik zu entwickeln. Darüber hinaus würde dieses System eine ständige Wartung erfordern, um neue Modelle aufzunehmen und sich an API-Änderungen anzupassen.

Hier bietet eine verwaltete Lösung wie EvoLink erheblichen Mehrwert. Wir haben bereits ein produktionserprobtes System entwickelt, das all diese Komplexität bewältigt. Sie erhalten eine einzige, einheitliche API mit integriertem intelligentem Routing, sodass sich Ihr Team auf Ihr Kernprodukt anstatt auf die Infrastruktur konzentrieren kann. Dieser Ansatz kann sofortige Kosteneinsparungen von 20 bis 70 % bringen und hohe Zuverlässigkeit vom ersten Tag an gewährleisten.

Wie macht ein Load Balancer Router meine App eigentlich zuverlässiger?

Zuverlässigkeit wird durch zwei primäre Mechanismen erreicht: Redundanz und automatisierte Zustandsprüfungen.

Durch die Verteilung von Anfragen auf mehrere Modelle oder Server eliminiert ein Load Balancer Single Points of Failure. Wenn eine Modell-API nicht verfügbar ist oder ein Server abstürzt, bleibt die Anwendung betriebsbereit, da der Verkehr automatisch auf die gesunden Alternativen geleitet wird.

Das System führt außerdem kontinuierliche Zustandsprüfungen an jedem Endpunkt durch, ähnlich der Überwachung von Vitalfunktionen. Es sendet regelmäßig Anfragen, um sicherzustellen, dass jeder Endpunkt reaktionsfähig ist. Wenn ein Endpunkt bei diesen Prüfungen durchfällt oder Fehler zurückgibt, entfernt der Router ihn sofort aus dem aktiven Pool und leitet neue Anfragen nahtlos an die verbleibenden gesunden Endpunkte um. Dieses automatische Failover stellt die hohe Verfügbarkeit sicher, selbst bei teilweisen Systemausfällen.