Hugging Face Inference API 开发指南

什么是 Hugging Face Inference API

从本质上讲,Hugging Face Inference API 是一项服务,让您通过简单的 API 调用即可运行托管在 Hugging Face Hub 上的机器学习模型。它完全抽象了模型部署的复杂性,如 GPU 管理、服务器配置和扩展。您无需配置自己的服务器,只需将数据发送到模型的端点并获取预测结果即可。

为了让您有更清晰的了解,这里简要细分了该 API 提供的主要功能。

Hugging Face Inference API 一览

下表总结了针对各种开发需求使用 Hugging Face Inference API 的关键功能和优势。

| 功能 | 描述 | 主要优势 |

|---|---|---|

| 无服务器推理 | 通过 API 调用运行模型,无需管理任何服务器、GPU 或底层基础设施。 | 零基础设施开销: 释放工程时间以专注于构建功能。 |

| 海量模型库访问 | 立即使用 Hub 上提供的 1,000,000 多个 模型来完成各种任务。 | 无与伦比的灵活性: 轻松更换模型,找到最适合您特定用例的模型。 |

| 简单的 HTTP 接口 | 使用标准的、文档齐全的 HTTP 请求与复杂的 AI 模型进行交互。 | 快速原型设计: 在几分钟而非几周内构建并测试 AI 驱动的概念验证。 |

| 按需付费定价 | 您只需为您使用的计算时间付费,这对于实验和较小的负载非常具有成本效益。 | 成本效率: 避免了维护专用机器学习基础设施的高昂固定成本。 |

最终,该 API 旨在以尽可能小的阻力让您从概念升级到实用的 AI 功能。

开发人员的核心优势

该 API 显然是在考虑开发人员效率的情况下构建的,它提供了一些关键优势,使其成为许多项目的首选。

- 零基础设施管理: 无需配置 GPU、处理 CUDA 驱动程序或担心服务器扩展。该 API 处理所有后台繁重的工作。

- 庞大的模型选择: 通过直接访问 Hub,您只需更改 API 调用中的参数,即可立即在情感分析、文本生成或图像处理等任务的模型之间切换。

- 快速原型设计: 极高的易用性让您在一个下午内就能构建 AI 功能的概念验证。

身份验证并进行您的第一次 API 调用

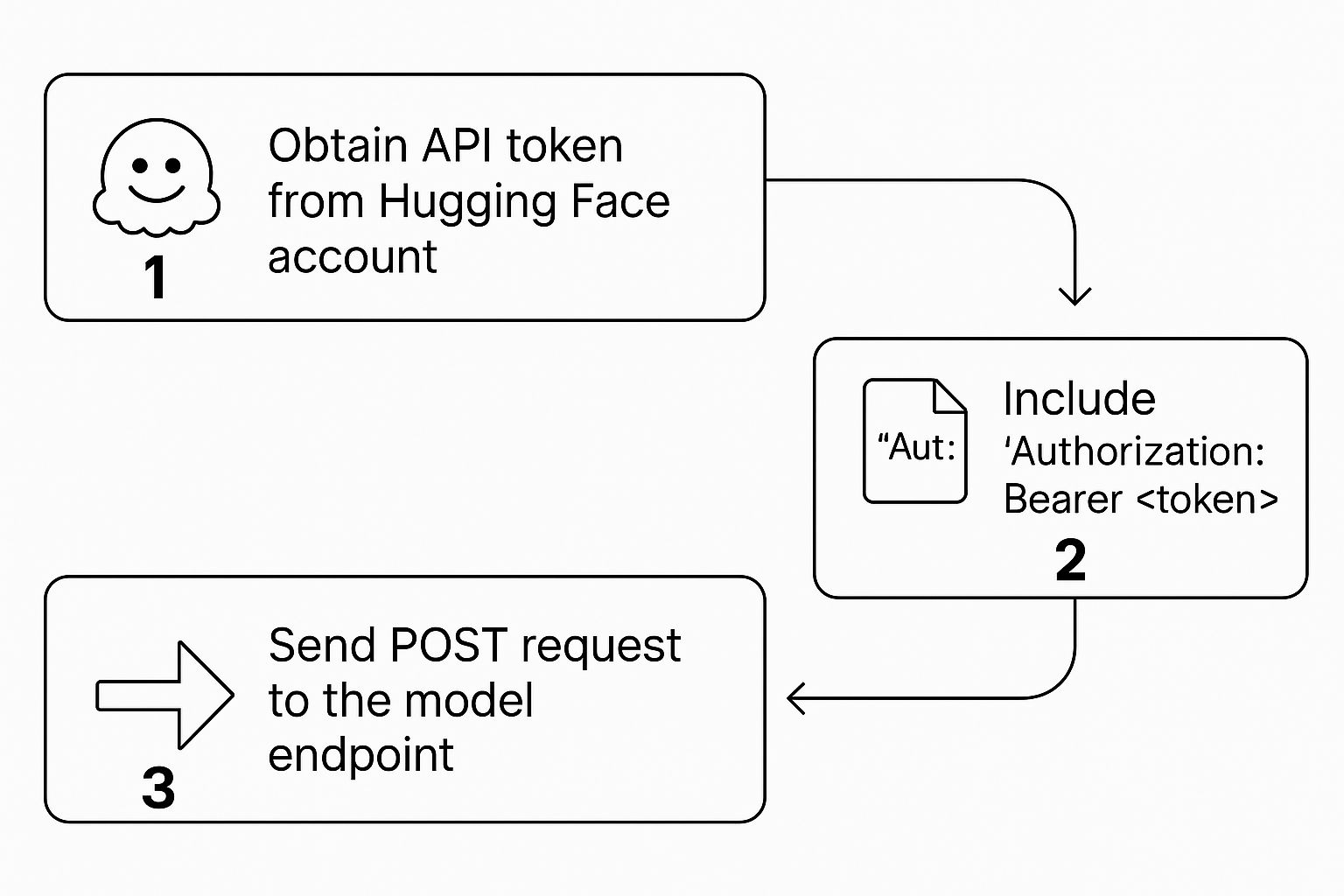

Authorization 标头中。这告诉 Hugging Face 的服务器您是合法用户,拥有运行所调用模型的权限。这个过程是一个简单但至关重要的三步舞曲:获取令牌,将其放入标头,然后发起调用。

生成令牌后,关键在于正确构建请求,以确保一切顺利安全地运行。

您的第一次 Python API 调用

requests 库执行文本分类任务。关键组件是模型的特定 API URL 以及包含输入文本的格式正确的 JSON 负载。Authorization 标头必须使用“Bearer”方案,这是现代 API 的标准。只需在令牌前加上 Bearer ——别忘了空格。"YOUR_API_TOKEN" 替换为您 Hugging Face 帐户中的实际令牌即可。import requests

import os

# 最佳实践:将您的令牌存储在环境变量中

# 在本示例中,我们直接定义它,但在生产环境请使用 os.getenv("HF_API_TOKEN")。

API_TOKEN = "YOUR_API_TOKEN"

API_URL = "https://api-inference.huggingface.co/models/distilbert/distilbert-base-uncased-finetuned-sst-2-english"

def query_model(payload):

headers = {"Authorization": f"Bearer {API_TOKEN}"}

response = requests.post(API_URL, headers=headers, json=payload)

response.raise_for_status() # 为错误的响应代码引发异常

return response.json()

# 让我们对一个句子进行分类

data_payload = {

"inputs": "I love the new features in this software, it's amazing!"

}

try:

output = query_model(data_payload)

print(output)

# 预期输出可能如下所示: [[{'label': 'POSITIVE', 'score': 0.9998...}]]

except requests.exceptions.RequestException as e:

print(f"发生错误: {e}")POSITIVE 还是 NEGATIVE,以及置信度得分。这种基本模式适用于各种任务,从生成文本到分析图像;只有负载结构会发生变化。当然,当您接触到更高级的模型(如视频生成器)时,API 交互可能会变得更加复杂,正如您在这份详细的 2025 年 Sora 2 API 指南中看到的那样。硬编码您的令牌进行快速测试是可以的,但在实际项目中这存在显著的安全风险。切勿将 API 密钥提交到 Git 存储库。对于简单的脚本之外的任何内容,请使用环境变量或秘密管理工具来确保您的凭据安全。

将 Inference API 应用于不同的 AI 任务

inputs。生成创意文本

max_length 等参数来控制输出。import requests

API_URL = "https://api-inference.huggingface.co/models/gpt2"

headers = {"Authorization": "Bearer YOUR_API_TOKEN"}

def query_text_generation(payload):

response = requests.post(API_URL, headers=headers, json=payload)

return response.json()

output = query_text_generation({

"inputs": "The future of AI in software development will be",

"parameters": {"max_length": 50, "temperature": 0.7}

})

print(output)

# 预期输出: [{'generated_text': 'The future of AI in software development will be...'}]响应返回一个带有生成的文本的干净 JSON 对象,使其易于解析并集成到您的应用程序中。

对图像内容进行分类

'rb') 读取图像文件,并在请求的 data 参数中传递该数据。import requests

API_URL = "https://api-inference.huggingface.co/models/google/vit-base-patch16-224"

headers = {"Authorization": "Bearer YOUR_API_TOKEN"}

def query_image_classification(filename):

with open(filename, "rb") as f:

data = f.read()

response = requests.post(API_URL, headers=headers, data=data)

return response.json()

# 请确保在同一目录下有一个图像文件(例如 'cat.jpg')

try:

output = query_image_classification("cat.jpg")

print(output)

# 预期输出: [{'score': 0.99..., 'label': 'Egyptian cat'}, {'score': 0.00..., 'label': 'tabby, tabby cat'}, ...]

except FileNotFoundError:

print("错误: 'cat.jpg' 未找到。请提供有效的图像文件路径。")零样本 (Zero-Shot) 文本分类

inputs (您的文本)和包含 candidate_labels 列表的 parameters 对象。// 使用 fetch 的 JavaScript 示例

async function queryZeroShot(data) {

const response = await fetch(

"https://api-inference.huggingface.co/models/facebook/bart-large-mnli",

{

headers: { Authorization: "Bearer YOUR_API_TOKEN" },

method: "POST",

body: JSON.stringify(data),

}

);

const result = await response.json();

return result;

}

queryZeroShot({

"inputs": "Our new feature launch was a massive success!",

"parameters": {"candidate_labels": ["marketing", "customer feedback", "technical issue"]}

}).then((response) => {

console.log(JSON.stringify(response));

// 预期输出: {"sequence": "...", "labels": ["customer feedback", ...], "scores": [0.98..., ...]}

});了解成本和使用层级

该系统围绕用户层级(Free、Pro、Team、Enterprise)构建,每层都有一定的每月使用信用额度。免费用户会收到少量信用额度,而 Pro 和 Team 用户会收到更多。一旦这些额度用完,您将过渡到按需付费模式,按推理请求和模型运行时间计费。虽然这对于入门非常有用,但管理不同模型和提供商之间的单独成本很快就会成了一项重大的运营负担。

简化您的成本管理

从直接调用到智能路由

优化生产性能

构建超越单一端点的弹性

这种架构为任何生产系统提供了两个关键优势:

- 自动故障转移: 如果主要提供商速度慢或无响应,EvoLink 会立即将请求重新路由到健康的替代方案,确保应用程序的稳定性。

- 负载均衡: 在流量高峰期,请求会自动分布到多个提供商,防止出现瓶颈并保持低延迟。

通过抽象化提供商基础设施,您可以直接在应用程序中构建弹性。

从直接调用到统一网关

下面是使用 Python 进行比较的实际操作:

# 之前: 直接 API 调用 Hugging Face

# 这会创建单点故障。

import requests

HF_API_URL = "https://api-inference.huggingface.co/models/gpt2"

HF_TOKEN = "YOUR_HF_TOKEN"

def direct_hf_call(payload):

headers = {"Authorization": f"Bearer {HF_TOKEN}"}

response = requests.post(HF_API_URL, headers=headers, json=payload)

return response.json()# 之后: 调用统一的 EvoLink API (兼容 OpenAI)

# 您的应用程序现在通过自动故障转移和负载均衡具备了弹性。

import requests

# EvoLink 统一 API 端点 (兼容 OpenAI)

EVOLINK_API_URL = "https://api.evolink.ai/v1"

EVOLINK_TOKEN = "YOUR_EVOLINK_TOKEN"

def evolink_image_generation(prompt):

"""

使用 EvoLink 的智能路由生成图像。

EvoLink 自动路由到为您选择的模型提供服务的成本最低的提供商。

"""

headers = {"Authorization": f"Bearer {EVOLINK_TOKEN}"}

# 典型示例: 使用 Seedream 4.0 生成故事驱动的 4K 图像

payload = {

'model': 'doubao-seedream-4.0', # 或 'gpt-4o-image', 'nano-banana'

'prompt': prompt,

'size': '1024x1024'

}

response = requests.post(f"{EVOLINK_API_URL}/images/generations",

headers=headers, json=payload)

return response.json()

def evolink_video_generation(prompt):

"""

使用 EvoLink 的视频模型生成视频。

"""

headers = {"Authorization": f"Bearer {EVOLINK_TOKEN}"}

# 典型示例: 使用 Sora 2 生成带音频的 10 秒视频

payload = {

'model': 'sora-2', # 或 'veo3-fast' 生成 8 秒视频

'prompt': prompt,

'duration': 10

}

response = requests.post(f"{EVOLINK_API_URL}/videos/generations",

headers=headers, json=payload)

return response.json()通过这个简单的改变,您有效地保护了您的应用程序免受特定提供商问题的影响,同时获得了访问生产级图像和视频生成功能的能力。

常见问题及实用解答

我该如何处理速率限制 (Rate Limits)?

触及速率限制是一个常见问题。您的限制取决于您的订阅层级,超过该限制将导致您的应用程序失败。

有几种策略可以提供帮助:

- 批量处理请求: 在支持的情况下,将多个输入打包到一个 API 调用中,而不是发送数百个单独的请求。

- 实施指数退避 (Exponential Backoff): 当请求由于速率限制而失败时,构建一个重试逻辑,逐步延长尝试之间的时间(例如 1s、2s、4s)。这可以防止对 API 进行垃圾邮件攻击,并赋予其恢复时间。

我可以在 Inference API 上运行我的私人模型吗?

Authorization 标头中传递您的 API 令牌。关键细节是确保与令牌关联的帐户具有访问私人模型库的必要权限。没有适当的权限,您将收到身份验证错误。管理模型版本的最佳实践是什么?

gpt2)默认使用 main 分支上的最新版本。这对于测试没问题,但当模型作者推送更新时,可能会在生产环境中引入重大更改。专业的方法是将您的请求固定到特定的提交哈希 (commit hash)。Hub 上的每个模型都有一个类似 Git 的提交历史。确定您测试过的确切版本,获取其提交哈希,并在 API 调用中包含该修订版本。这可以确保您始终使用相同的模型版本,从而获得一致且可预测的结果。