GPT Image 2 と Seedance 2.0 の連携活用法:ストーリーボードからショート動画までのワークフロー

GPT Image 2 と Seedance 2.0 の連携活用法

gpt-image-2 と文書化されています。ByteDance および BytePlus は Seedance 2.0 を、テキスト・画像・音声・動画のマルチモーダル入力に対応した動画生成モデルとして公開しています。つまり、この組み合わせの理解は明快です。gpt-image-2 はプリプロダクションのビジュアル設計に向いており、Seedance 2.0 はモーション・タイミング・映像演出の実行に向いています。まとめ

gpt-image-2は、キャラクターシート、ストーリーボードグリッド、キーフレーム、タイトルカード、ポスターなど、構造的なビジュアルアセットの作成に使います。- Seedance 2.0 は、シーンの見た目が決まった後に、モーション、カメラワーク、ショート動画の出力が必要な場面で使います。

- 1つのモデルですべてを処理させるよりも、この組み合わせの方が通常は強力です。

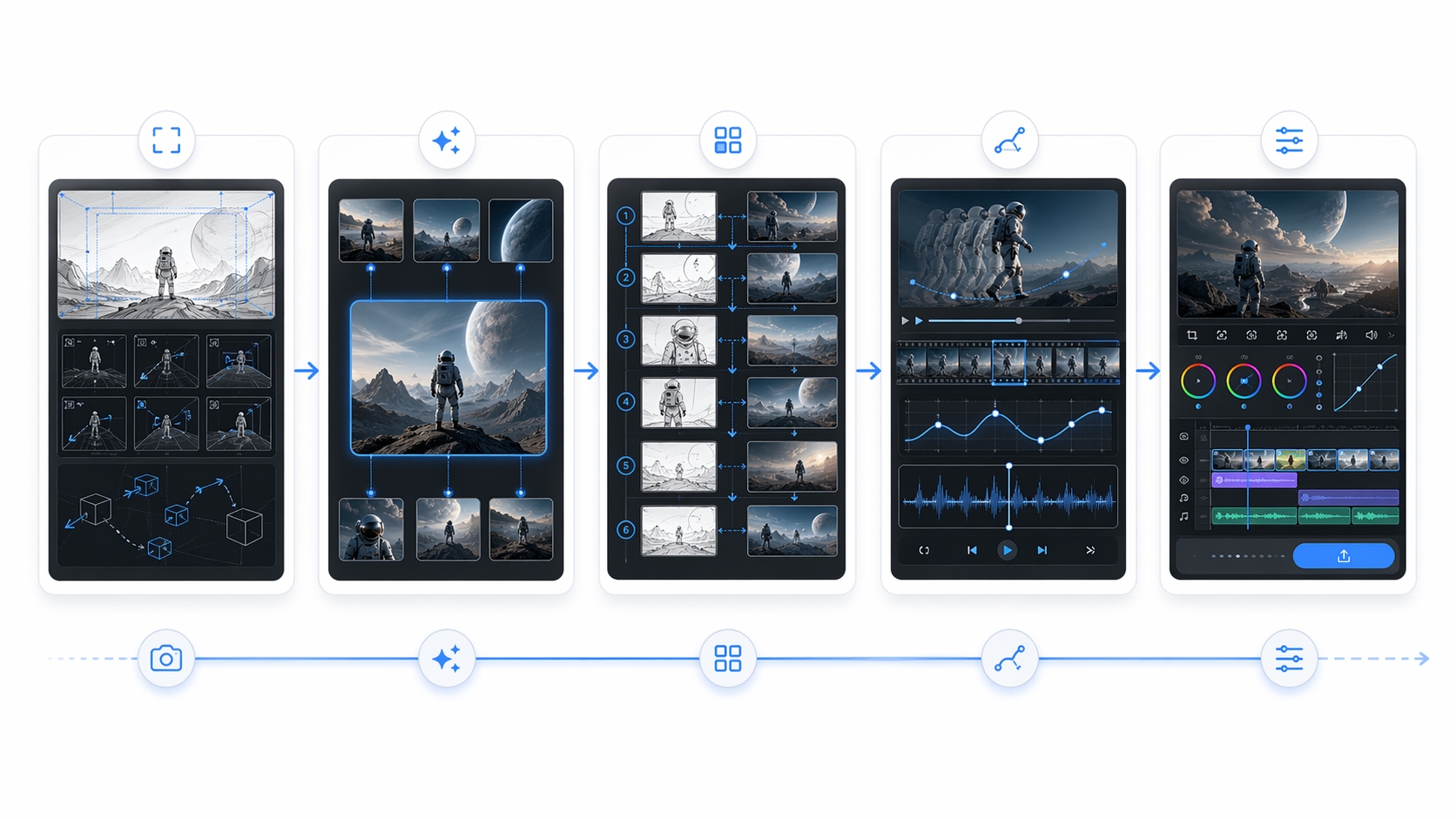

- 最も一般的なワークフローはシンプルです。ショットを定義 → ビジュアルアンカーを作成 → ストーリーボードまたはキーフレームを構築 → Seedance 2.0 でアニメーション化 → 編集でタイトルとペーシングを仕上げる。

- この組み合わせは、トレーラー、ティザー、ビジュアルナラティブ、プロダクトショート、SNS向けクリップに適しており、トーキングヘッドや単体画像のタスクにはあまり向いていません。

各モデルの実際の得意分野

この組み合わせを理解する最も明快な方法は、話題性ではなく制作ステージで考えることです。

| ステージ | GPT Image 2(gpt-image-2) | Seedance 2.0 |

|---|---|---|

| 主な役割 | プリプロダクションのビジュアルデザイン | モーションおよびショート動画の生成 |

| 得意な入力 | テキスト+任意の画像リファレンス | テキスト、画像、音声、動画の入力 |

| 得意な出力 | キャラクターシート、ストーリーボード、コミック風パネル、ポスター、キーフレーム、タイトルカード | image-to-video、マルチモーダル reference-to-video、編集指向の動画ワークフロー |

| 最適な用途 | ビジュアルの構造と一貫性の確定 | タイミング、モーション、カメラディレクション、映像の雰囲気の付与 |

| 公式に文書化された強み | 高速・高品質な画像生成と編集 | 画像・音声・動画リファレンスを活用したマルチモーダル動画生成 |

次のような問いが残っている場合は:

- キャラクターの見た目をどうするか

- フレームに何を含めるか

- ビジュアル情報の密度をどの程度にするか

- アニメーション前にシーケンスをどう構成するか

GPT Image 2 から始める方が通常は適切です。

一方、次のような問いが残っている場合は:

- シーンをどう動かすか

- カメラをどう動かすか

- クリップをビートごとにどう進行させるか

- シーケンス全体の時間的な質感をどうするか

Seedance 2.0 の方が通常は適したツールです。

なぜチームは1つのモデルに全部任せず、2つを組み合わせるのか

1. ビジュアルの一貫性を早い段階で確定できる

text-to-video の直接生成は短い実験には有効ですが、同時に多くの要素を解決しなければなりません。キャラクターデザイン、構図、モーション、シーンの論理、ペーシング、場合によっては音声まで。こうした初期のビジュアル判断を先に GPT Image 2 で行っておけば、後続の動画生成段階でのブレが少なくなります。

これは、出力が単に「いいクリップ」ではなく、再現可能な構造を持つものである場合に特に重要です。

- トレーラー

- ティザー

- SNS広告

- 同じキャラクターが繰り返し登場するショートシーケンス

- スタイライズされたビジュアルナラティブ

2. ストーリーのペーシングをコントロールしやすくなる

動画モデルにシーケンス全体を一から考えさせるのではなく、ワークフローは次のようになります。

- ショットを決める

- ショットをビジュアルで見せる

- ショットをアニメーション化する

これは、1つの巨大なプロンプトに全てを任せるよりも、通常はデバッグしやすいです。

3. テキストやレイアウト重視のビジュアルがよりうまく生成できる

OpenAI は GPT Image 2 を強力な画像生成・編集モデルとして位置づけており、ChatGPT Images 2.0 のローンチ資料では、構造化レイアウト、多言語テキストレンダリング、コミックページ、リファレンスシート、エディトリアル構成が大きく強調されています。そのため、以下のようなアセットに適しています。

- タイトルカード

- ポスター風レイアウト

- コミック・マンガ風のページ

- インターフェース風のビジュアル

- ブランド素材や情報密度の高い構成

これらはまさに、モーション生成の段階で直接作ろうとすると崩れがちなアセットです。

最も多く見られるワークフロー

この組み合わせは、通常2つのパターンに分かれます。

| ワークフロー | GPT Image 2 で開始 | Seedance 2.0 で仕上げ | 適した用途 |

|---|---|---|---|

| ストーリーボード起点 | 3×3 のストーリーボードグリッドまたはマルチパネルのストーリーページ | ストーリーボードを元に image-to-video または reference-driven video でアニメーション化 | トレーラー、ティザー、ショートナラティブ |

| キーフレーム起点 | キャラクターシート、スタイルアンカー、4〜6枚のキーフレーム、タイトルカード | 各ビジュアルを1クリップまたはシーケンスとしてアニメーション化 | プロダクトショート、キャラクターPV、SNS向け編集、スタイライズ広告 |

実践的な軽量プロセス

大掛かりなパイプラインは必要ありません。ほとんどのチームにとって、5ステップのワークフローで十分です。

1. まずショットの意図を定義する

どちらのモデルにプロンプトを投げる前に、簡単なショットリストを書きます。

Goal: 15-second teaser

Shot 1: establish subject and mood

Shot 2: close-up detail introduces tension

Shot 3: world or product context expands

Shot 4: movement or conflict appears

Shot 5: final reveal or title holdこれで十分です。目的はプロンプトの詩的表現ではなく、クリップが何を伝えるべきかを決めることです。

2. GPT Image 2 でキャラクターとスタイルアンカーを確定する

シーケンスに取りかかる前に、1〜2枚のビジュアルアンカーを作成します。

- キャラクターシートまたはプロダクトのビジュアルアンカー

- 色彩、ライティング、マテリアルのスタイルアンカー

これらが不安定だと、後続のモーション段階の品質は良くなるどころか、むしろ悪化する傾向があります。

3. ストーリーボードグリッドまたはキーフレームセットを作成する

ワークロードに応じて、より軽い構造を選びます。

- シーケンス全体を1枚の画像で表現したい場合はストーリーボードグリッド

- ショットレベルでのコントロールが必要な場合はキーフレームセット

4. Seedance 2.0 でモーションを付与する

480p と 720p の出力、4 秒から 15 秒の尺に対応しています。ビジュアルデザインが決まった後のセカンドステージツールとして最適です。この段階では、画像タグのようなプロンプトではなく、演出メモのようにプロンプトを書きましょう。以下に注力します。

- 何が動くか

- カメラがどう動くか

- ビートがいつ切り替わるか

- 音響の雰囲気をどうするか

5. タイトルとペーシングはモーション段階の外で仕上げる

動画モデルが優秀であっても、以下の要素は通常、編集ソフトで仕上げる方が安全です。

- タイトル処理

- 字幕

- ペーシングの調整

- エンドカード

- 最終パッケージング

生成ステップにすべてを一度に任せるよりも、こちらの方が確実です。

よくある失敗パターン

ストーリーボードグリッドがそのまま冒頭フレームに表示される

ストーリーボード起点のワークフローでよくある副作用です。最も簡単な対処法は、編集で冒頭の1秒をトリミングするか、冒頭パネルのビジュアルを近づけてトランジションの違和感を軽減することです。

キャラクターのブレが動画段階より前に発生している

一見 Seedance の問題に見えますが、根本原因は通常それ以前にあります。キャラクターシートやキーフレームセットが安定していなければ、モーション段階がその不安定さを引き継ぎます。対策は動画ステップを何度もリロールすることではなく、画像アンカーを強化することです。

タイトルやロゴがモーション中に崩れる

テキストは動画生成においてまだ脆弱な部分です。タイトルやロゴの可読性が重要な場合は、先に静的アセットとして別途生成し、軽くアニメーションを加えるか、編集ソフトで配置するのが安全です。

この組み合わせが最も効果を発揮するケース

このワークフローは万能ではありません。たとえ軽量であっても、実際のプリプロダクション段階がある場合に最も効果を発揮します。

| 向いているケース | 向いていないケース |

|---|---|

| トレーラー・ティザー | 単体の画像生成タスク |

| ショート形式のビジュアルナラティブ | トーキングヘッド動画の生成 |

| ショット構成のあるSNS広告 | 一発のプロンプト実験 |

| レイアウト設計が必要なプロダクト動画 | ショット間の一貫性が不要なワークロード |

| キャラクター主導・スタイル主導のショート | text-to-video の直接生成で十分解決できるケース |

メインの仕事が「1枚の画像を生成する」なら、GPT Image 2 だけで十分です。

メインの仕事が「1つのプロンプトから手軽に動画クリップを生成する」なら、この追加構造は不要かもしれません。

EvoLink での活用

ここでの EvoLink の価値は、このワークフローを発明したことではありません。画像と動画のルートを同じ作業環境内に統合することで、このワークフローの運用が容易になる点です。

- 画像生成ステージと動画生成ステージを同じモデルワークフロー内に維持できる

- スタックを再構築せずにルートの挙動を比較できる

- 1つのモデルファミリーに留まるか、別のモデルに切り替えるかを柔軟に判断できる

FAQ

ChatGPT Images 2.0 と gpt-image-2 は同じものですか?

gpt-image-2 は API で使用する公式モデル名です。動画全体を直接生成すればよいのでは?

もちろんそれも可能で、場合によってはその方が速いこともあります。ただし、キャラクターの一貫性、ショットの順序、構造化されたビジュアルプランニングをより細かくコントロールしたい場合には、この2段階ワークフローが有効です。

ストーリーボードグリッドとキーフレーム、どちらから始めるべきですか?

このワークフローにおける GPT Image 2 の主な役割は?

プリプロダクション用のビジュアルアセットの作成です。キャラクターシート、ビジュアルアンカー、ストーリーボードページ、キーフレーム、タイトルカードなど、構造化された画像アセットを生成します。

このワークフローにおける Seedance 2.0 の主な役割は?

これらのビジュアルアセットを、image-to-video やマルチモーダル reference ワークフローを通じて、モーション付きの出力に変換することです。静止画モデルだけでは実現しにくい、カメラワークやタイミングのコントロールが可能になります。

タイトルやロゴは動画生成の段階で入れるべきですか?

通常はおすすめしません。可読性が重要な場合は、それらのアセットを別途作成し、後から追加またはアニメーション化する方が安全です。

この組み合わせが向いていないのはどんな場合ですか?

単体の静止画生成、シンプルなダイレクト動画プロンプト、ショット間の一貫性が重要でないワークロードには、通常オーバースペックです。

ソース

- OpenAI, "Introducing ChatGPT Images 2.0" (April 21, 2026): https://openai.com/index/introducing-chatgpt-images-2-0/

- OpenAI API model page for

gpt-image-2: https://developers.openai.com/api/docs/models/gpt-image-2 - ByteDance Seedance 2.0 official page: https://seed.bytedance.com/en/seedance2_0

- BytePlus ModelArk Seedance 2.0 series tutorial: https://docs.byteplus.com/api/docs/ModelArk/2291680