GPT Image 2 mit Seedance 2.0 kombinieren: Warum Teams sie gemeinsam für Storyboards und Kurzvideos einsetzen

GPT Image 2 mit Seedance 2.0 kombinieren

gpt-image-2 lautet. ByteDance und BytePlus dokumentieren Seedance 2.0 als multimodales Videomodell, das Text-, Bild-, Audio- und Videoeingaben unterstützt. Die Kombination ist damit leicht nachvollziehbar: gpt-image-2 eignet sich besonders gut für die visuelle Vorproduktion, während Seedance 2.0 seine Stärken bei Bewegung, Timing und audiovisueller Umsetzung ausspielt.Zusammenfassung

- Verwenden Sie

gpt-image-2, wenn Sie Charakterbögen, Storyboard-Raster, Keyframes, Titelkarten, Poster oder andere strukturierte visuelle Assets benötigen. - Verwenden Sie Seedance 2.0, wenn Sie bereits wissen, wie die Szene aussehen soll, und nun Bewegung, Kameraverhalten und Kurzvideo-Ausgabe benötigen.

- Die Kombination ist in der Regel stärker, als ein einzelnes Modell dazu zu zwingen, alles in einem einzigen Prompt zu erledigen.

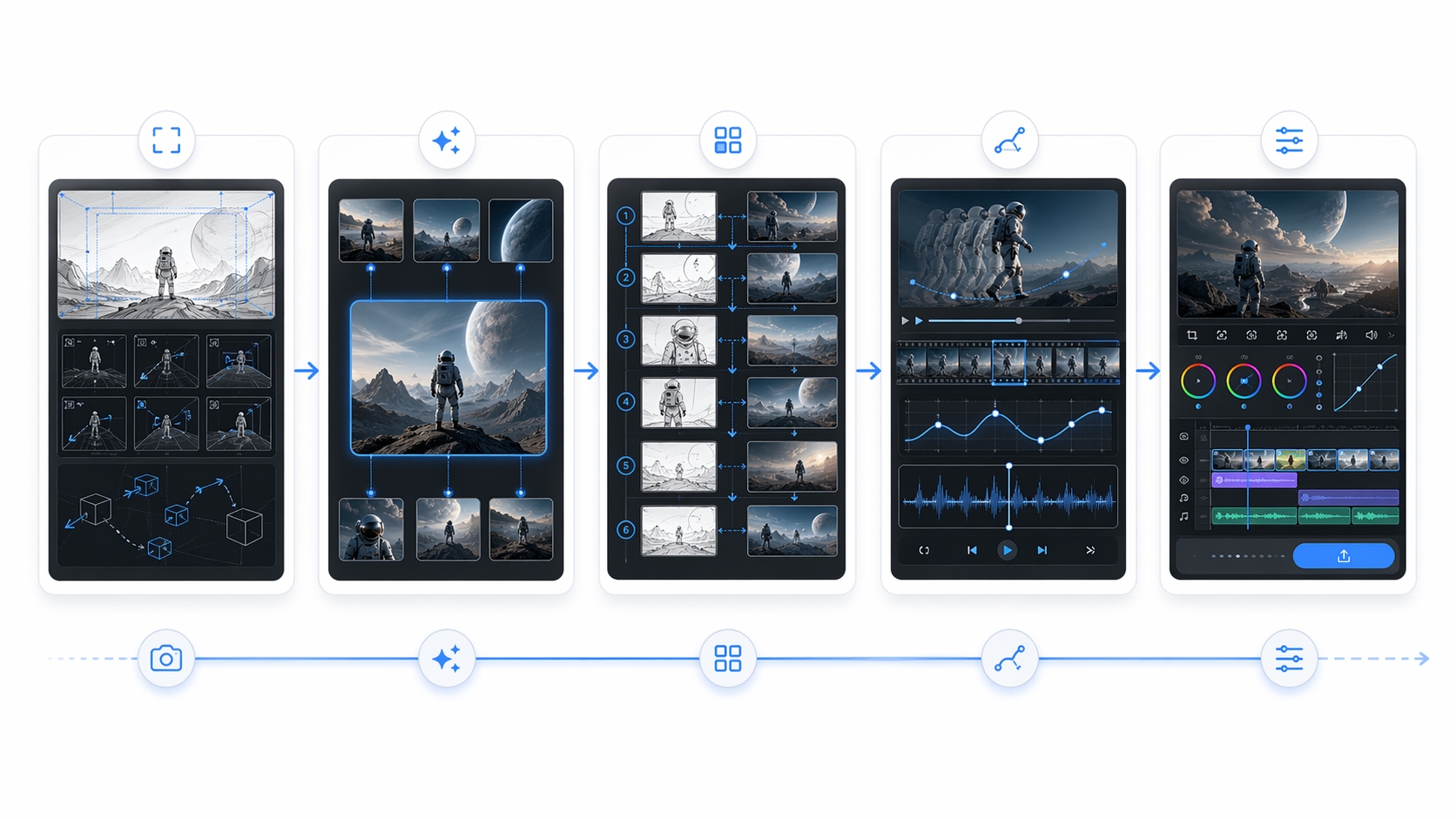

- Der häufigste Workflow ist einfach: Einstellungen festlegen -> visuelle Anker generieren -> Storyboard oder Keyframes erstellen -> in Seedance 2.0 animieren -> Titel und Pacing im Schnitt finalisieren.

- Diese Kombination eignet sich besonders gut für Trailer, Teaser, visuelle Erzählungen, Produktkurzvideos und Social-Media-Clips — weniger für reine Talking-Head-Videos oder einzelne Bildaufgaben.

Was jedes Modell wirklich gut kann

Der klarste Ansatz für diese Kombination orientiert sich an der Produktionsphase, nicht am Hype.

| Phase | GPT Image 2 (gpt-image-2) | Seedance 2.0 |

|---|---|---|

| Hauptrolle | Visuelle Vorproduktion | Bewegung und Kurzvideoerstellung |

| Beste Eingaben | Text plus optionale Bildreferenzen | Text-, Bild-, Audio- und Videoeingaben |

| Beste Ausgaben | Charakterbögen, Storyboard-Seiten, Comic-Panels, Poster, Keyframes, Titelkarten | Image-to-video, multimodale reference-to-video, bearbeitungsorientierte Video-Workflows |

| Bester Einsatz | Visuelle Struktur und Konsistenz festlegen | Timing, Bewegung, Kameraführung und audiovisuelle Stimmung hinzufügen |

| Offiziell dokumentierte Stärken | Schnelle, hochwertige Bildgenerierung und -bearbeitung | Multimodale Videogenerierung mit Bild-, Audio- und Videoreferenzen |

Wenn die offene Frage lautet:

- Wie soll der Charakter aussehen?

- Was soll das Bild enthalten?

- Wie dicht soll die visuelle Information sein?

- Wie soll eine Sequenz aufgebaut werden, bevor sie animiert wird?

dann ist GPT Image 2 in der Regel der bessere Ausgangspunkt.

Wenn die offene Frage lautet:

- Wie soll sich die Szene bewegen?

- Wie soll sich die Kamera verhalten?

- Wie soll der Clip von Beat zu Beat fortschreiten?

- Wie soll sich die Sequenz über die Zeit anfühlen?

dann ist Seedance 2.0 in der Regel das bessere Werkzeug.

Warum Teams sie kombinieren, statt alles mit einem Modell zu lösen

1. Visuelle Konsistenz wird früher festgelegt

Direkte text-to-video Generierung kann bei kurzen Experimenten gut funktionieren, muss aber zu viele Dinge gleichzeitig lösen: Charakterdesign, Komposition, Bewegung, Szenenlogik, Pacing und manchmal sogar Audio. Wenn Teams diese frühen visuellen Entscheidungen zuerst in GPT Image 2 treffen, hat die spätere Videophase weniger Spielraum für Abweichungen.

Das ist besonders wichtig, wenn das Ergebnis nicht nur „ein hübscher Clip" sein soll, sondern etwas mit wiederholbarer Struktur:

- ein Trailer

- ein Teaser

- eine Social-Media-Anzeige

- eine kurze Sequenz mit wiederkehrenden Charakteren

- eine stilisierte visuelle Erzählung

2. Story-Pacing wird leichter kontrollierbar

Statt ein Videomodell die gesamte Sequenz erfinden zu lassen, wird der Workflow zu:

- Einstellungen festlegen

- Einstellungen visuell zeigen

- Einstellungen animieren

Das ist in der Regel einfacher zu debuggen als ein einziger riesiger Prompt.

3. Text- und layoutlastige Visuals bleiben besser erhalten

OpenAI positioniert GPT Image 2 als leistungsstarkes Modell für Bildgenerierung und -bearbeitung. Die Einführungsmaterialien zu ChatGPT Images 2.0 betonen stark strukturierte Layouts, mehrsprachiges Text-Rendering, Comic-Seiten, Referenzbögen und redaktionelle Kompositionen. Damit eignet es sich besonders gut für Assets wie:

- Titelkarten

- Poster-Layouts

- Comic- oder Manga-Seiten

- Interface-artige Visuals

- gebrandete oder informationsdichte Kompositionen

Genau diese Art von Assets geht häufig kaputt, wenn Sie versuchen, sie direkt im Animations-Schritt zu generieren.

Der häufigste Workflow in der Praxis

Die Kombination folgt in der Regel einem von zwei Mustern.

| Workflow | Start in GPT Image 2 | Abschluss in Seedance 2.0 | Bester Einsatz |

|---|---|---|---|

| Storyboard-first | 3x3-Storyboard-Raster oder mehrteilige Story-Seite | Animation als image-to-video oder referenzgesteuerte Videogenerierung | Trailer, Teaser, kurze narrative Clips |

| Keyframe-first | Charakterbogen, Stil-Anker, 4–6 Keyframes, Titelkarten | Jedes Visual als einzelnen Clip oder Sequenz animieren | Produktkurzvideos, Charakter-PVs, Social-Media-Edits, stilisierte Ads |

Ein schlanker Praxis-Workflow

Sie brauchen keine aufwändige Pipeline, um davon zu profitieren. Für die meisten Teams reicht ein Fünf-Schritte-Workflow.

1. Zuerst die Einstellungs-Intention festlegen

Bevor Sie eines der Modelle prompten, schreiben Sie eine kurze Einstellungsliste:

Ziel: 15-Sekunden-Teaser

Einstellung 1: Subjekt und Stimmung etablieren

Einstellung 2: Nahaufnahme-Detail erzeugt Spannung

Einstellung 3: Welt- oder Produktkontext wird erweitert

Einstellung 4: Bewegung oder Konflikt tritt auf

Einstellung 5: Finaler Reveal oder TitelhalteDas genügt. Ziel ist nicht promptpoetische Perfektion. Ziel ist es, festzulegen, was der Clip aussagen soll.

2. GPT Image 2 für Charakter- und Stil-Anker nutzen

Erstellen Sie ein oder zwei visuelle Anker, bevor Sie eine Sequenz angehen:

- einen Charakterbogen oder visuellen Produktanker

- einen Stil-Anker für Farbe, Beleuchtung und Materialien

Wenn diese instabil sind, wird die spätere Animationsphase in der Regel schlechter, nicht besser.

3. Storyboard-Raster oder Keyframe-Set erstellen

Wählen Sie die leichtere Struktur, die zu Ihrem Arbeitsaufwand passt:

- Storyboard-Raster, wenn ein einzelnes Bild die gesamte Sequenz transportieren soll

- Keyframe-Set, wenn Sie mehr Kontrolle auf Einstellungsebene wünschen

4. In Seedance 2.0 für die Bewegung wechseln

480p und 720p sowie Dauern von 4 bis 15 Sekunden. Das macht es zu einem guten Werkzeug für die zweite Phase, wenn das visuelle Design bereits feststeht.In dieser Phase formulieren Sie Prompts eher wie Regie-Anweisungen statt wie Image-Tags. Konzentrieren Sie sich auf:

- was sich bewegt

- wie sich die Kamera bewegt

- wann der Beat wechselt

- wie die Audio-Atmosphäre sich anfühlen soll

5. Titel und Pacing außerhalb der Animationsphase finalisieren

Auch wenn das Videomodell leistungsfähig ist, ist es in der Regel sicherer, Folgendes im Schnitt zu finalisieren:

- Titelgestaltung

- Untertitel

- Pacing-Anpassungen

- Endkarten

- finale Verpackung

statt den Generierungsschritt alles auf einmal erledigen zu lassen.

Häufige Fehlerquellen

Das Storyboard-Raster erscheint als erstes Bild im Video

Das ist ein häufiger Nebeneffekt bei Storyboard-first-Workflows. Die einfachste Lösung ist, entweder die erste Sekunde im Schnitt zu trimmen oder die Eröffnungspanels visuell näher zusammenzurücken, damit der Übergang weniger abrupt wirkt.

Charakter-Drift beginnt schon vor der Videophase

Das sieht oft nach einem Seedance-Problem aus, aber die eigentliche Ursache liegt meist früher. Wenn der Charakterbogen oder das Keyframe-Set nicht stabil ist, erbt die Animationsphase diese Instabilität. Die Lösung besteht in der Regel darin, die Bild-Anker zu stärken — nicht darin, den Videoschritt endlos neu zu generieren.

Titel und Logos gehen in der Animation kaputt

Text ist nach wie vor ein fragiler Bestandteil der Videogenerierung. Wenn ein Titel oder Logo wichtig ist, generieren Sie ihn zunächst separat als statisches Asset und animieren Sie ihn dann dezent oder platzieren Sie ihn im Schnitt.

Wann diese Kombination am besten passt

Dieser Workflow ist nicht universell einsetzbar. Er funktioniert am besten, wenn Sie eine echte Vorproduktionsphase haben — selbst wenn diese schlank ausfällt.

| Gute Passung | Weniger geeignet |

|---|---|

| Trailer und Teaser | Einzelbild-Aufgaben |

| Kurze visuelle Erzählungen | Reine Talking-Head-Generierung |

| Social-Media-Anzeigen mit Einstellungsstruktur | Schnelle Einmal-Prompt-Experimente |

| Produktvideos mit Layoutplanung | Workflows ohne Bedarf an visueller Konsistenz |

| Charakter- oder stilgeführte Kurzfilme | Fälle, in denen direkte text-to-video Generierung das Problem bereits sauber löst |

Wenn Ihre Hauptaufgabe lautet „ein einzelnes Bild generieren", nutzen Sie einfach GPT Image 2.

Wenn Ihre Hauptaufgabe lautet „schnell einen einzelnen Videoclip aus einem Prompt generieren", brauchen Sie die zusätzliche Struktur möglicherweise nicht.

Was das für EvoLink bedeutet

Der EvoLink-Aspekt hier ist nicht, dass die Plattform diesen Workflow erfunden hätte. Es geht darum, dass der Workflow einfacher umzusetzen ist, wenn Bild- und Video-Routen auf derselben Arbeitsfläche verfügbar sind.

- die Bild- und Videophase im selben Modell-Workflow zu halten

- Routenverhalten vergleichen zu können, ohne den Tech-Stack neu aufbauen zu müssen

- entscheiden zu können, wann Sie in einer Modellfamilie bleiben und wann Sie an eine andere übergeben

FAQ

Ist ChatGPT Images 2.0 dasselbe wie gpt-image-2?

gpt-image-2 der dokumentierte API-Modellname ist.Warum nicht einfach das gesamte Video direkt generieren?

Das ist möglich, und manchmal ist es die schnellere Wahl. Der kombinierte Workflow wird dann nützlich, wenn Ihr Team mehr Kontrolle über Charakterkonsistenz, Einstellungsreihenfolge oder strukturierte visuelle Planung benötigt.

Sollte ich mit Storyboard-Rastern oder mit Keyframes beginnen?

Was ist die Hauptaufgabe von GPT Image 2 in diesem Workflow?

Seine Hauptaufgabe ist die Erstellung verwendbarer Vorproduktions-Visuals: Charakterbögen, visuelle Anker, Storyboard-Seiten, Keyframes, Titelkarten und andere strukturierte Bild-Assets.

Was ist die Hauptaufgabe von Seedance 2.0 in diesem Workflow?

Seine Hauptaufgabe ist es, diese visuellen Assets über image-to-video oder multimodale Referenz-Workflows in bewegungsorientierte Ausgaben umzuwandeln — mit präziserer Kamera- und Timing-Steuerung, als ein reines Standbildmodell bieten kann.

Sollte ich Titel und Logos im Videoschritt generieren?

In der Regel nicht. Wenn Lesbarkeit wichtig ist, erstellen Sie diese Assets besser separat und fügen Sie sie nachträglich hinzu oder animieren Sie sie anschließend.

Wann passt diese Kombination schlecht?

Sie ist in der Regel überdimensioniert für einzelne Standbilder, einfache direkte Video-Prompts oder Workflows, bei denen Konsistenz zwischen den Einstellungen keine große Rolle spielt.

Quellen

- OpenAI, "Introducing ChatGPT Images 2.0" (21. April 2026): https://openai.com/index/introducing-chatgpt-images-2-0/

- OpenAI API-Modellseite für

gpt-image-2: https://developers.openai.com/api/docs/models/gpt-image-2 - ByteDance Seedance 2.0 offizielle Seite: https://seed.bytedance.com/en/seedance2_0

- BytePlus ModelArk Seedance 2.0 Series Tutorial: https://docs.byteplus.com/api/docs/ModelArk/2291680