DeepSeek V4 API im Test 2026: Flash vs Pro, Migrationsanleitung und Produktions-Checkliste

deepseek-v4-flash und deepseek-v4-pro, veröffentlichen offizielle Preise für beide Varianten und dokumentieren 1M Kontext sowie 384K maximale Ausgabe. Reuters berichtete am selben Tag, dass V4 als Preview gestartet ist -- Teams können es also bereits evaluieren, sollten aber damit rechnen, dass sich Verhalten vor der Finalisierung noch ändern kann. DeepSeek API Docs DeepSeek Models & Pricing Reuters via Investing.comDas verändert die praktische Entscheidung:

- DeepSeek V4 Flash ist jetzt eine echte kostengünstige Routing-Option für den Produktionseinsatz

- DeepSeek V4 Pro ist jetzt eine echte Premium-DeepSeek-Route, die einen Benchmark verdient

- Claude Opus 4.7 ist die aktuelle Anthropic-Flaggschiff-Baseline, nicht mehr Opus 4.6

- GPT-5.4 bleibt das am klarsten dokumentierte OpenAI-Flaggschiff für professionelle Arbeit und Coding

Für wen dieser Guide gedacht ist

Dieser Artikel ist besonders nützlich, wenn Sie in eine der folgenden Rollen fallen:

- Engineering Lead, der entscheidet, ob DeepSeek V4 in den Routing-Stack aufgenommen wird

- Plattform-Team, das von

deepseek-chatunddeepseek-reasonermigriert - Produkt-Team, das Coding-Modell-Kosten senken will, ohne zu viel Qualität einzubüßen

- AI-Team, das entscheiden muss, wann zu Flash geroutet, wann zu Pro eskaliert und wann GPT-5.4 oder Claude Opus 4.7 beibehalten werden soll

Zusammenfassung

- Nutzen Sie DeepSeek V4 Flash zuerst, wenn Ihr Hauptziel kosteneffizientes Coding, Long-Context-Routing und Agenten-Workloads mit hohem Durchsatz sind. Der offizielle Preis liegt bei $0,14 Input / $0,28 Output pro 1M Token, mit 1M Kontext und 384K maximaler Ausgabe. DeepSeek Models & Pricing

- Nutzen Sie DeepSeek V4 Pro, wenn Ihre Aufgaben stärker reasoning- oder coding-lastig sind und Sie eine Stufe über Flash wollen, ohne Claude-Preise zu bezahlen. Offizieller Preis: $1,74 Input / $3,48 Output pro 1M Token. DeepSeek Models & Pricing

- Nutzen Sie Claude Opus 4.7, wenn Sie Anthropics aktuell bestes allgemein verfügbares Coding- und Agenten-Modell wollen und Premium-Preise von $5 / $25 pro 1M Token akzeptieren können. Anthropic Claude Opus 4.7

- Nutzen Sie GPT-5.4, wenn Sie die offizielle OpenAI-Flaggschiff-Route wollen, 1.050.000 Kontext, 128.000 maximale Ausgabe und volle OpenAI-Plattformunterstützung zu $2,50 / $15,00. OpenAI Pricing OpenAI GPT-5.4 Model

- Migrieren Sie nicht blind in einem Schritt. DeepSeek V4 ist öffentlich dokumentiert und als Preview nutzbar, aber Preview bedeutet nach wie vor: Evaluieren Sie mit echten Workloads, halten Sie Rollback-Pfade bereit und trennen Sie Flash von Pro in der Routing-Logik. Reuters via Investing.com

Was DeepSeek V4 jetzt ist

Die DeepSeek-V4-Diskussion ist deutlich einfacher geworden als noch Anfang April.

- öffentliche API-Modell-IDs:

deepseek-v4-flash,deepseek-v4-pro - Kontextlänge:

1M - maximale Ausgabe:

384K - Thinking-Modus: unterstützt

- Tool Calls: unterstützt

deepseek-chatunddeepseek-reasonerbleiben aus Kompatibilitätsgründen verfügbar, sind aber für die Abschaltung am 24. Juli 2026 vorgesehen

DeepSeek V4 Flash vs Pro: So wählen Sie richtig

Das ist die wichtigste Entscheidung im gesamten DeepSeek-V4-Rollout.

| Frage | DeepSeek V4 Flash | DeepSeek V4 Pro |

|---|---|---|

| Offizieller Input-Preis | $0,14 / 1M Cache Miss | $1,74 / 1M Cache Miss |

| Offizieller Output-Preis | $0,28 / 1M | $3,48 / 1M |

| Kontext | 1M | 1M |

| Maximale Ausgabe | 384K | 384K |

| Beste Rolle | Breite Standard-Route | Premium-Route mit höherer Intelligenz |

| Bester erster Test | High-Volume-Coding, Routing, Repo-Analyse | Schwierigere Coding- und Reasoning-Aufgaben |

| Hauptkompromiss | Niedrigere Obergrenze als Premium-Modelle | Höhere Kosten als Flash |

Wählen Sie Flash, wenn Ihre Kernfrage lautet: „Können wir das kostengünstig in großem Maßstab machen?"

Flash ist die richtige erste Route zum Testen, wenn Sie Folgendes brauchen:

- ein kostengünstiges Standard-Coding-Modell

- eine günstige Long-Context-Route

- ein Modell für Agentensysteme, bei denen die Output-Kosten entscheidend sind

- ein Modell, das Sie teamübergreifend einsetzen können, ohne unkontrollierte Kosten

Wenn Ihr Team derzeit ein teureres Frontier-Modell für einfaches Coding, Zusammenfassungen, Repo-Lektüre oder moderate Agenten-Workflows nutzt, ist Flash der naheliegendste Ersatzkandidat.

Wählen Sie Pro, wenn Ihre Kernfrage lautet: „Wo brauchen wir mehr Intelligenz?"

Pro ist die bessere Route, wenn Sie brauchen:

- stärkere Coding- oder Reasoning-Qualität als Ihre Budget-Route

- anspruchsvollere mehrstufige Analysen

- längere strukturierte Ausgaben

- eine Premium-Route, die beim Output trotzdem weniger kostet als Claude Opus 4.7

Das einfachste Denkmodell ist:

- Flash = Standard-Route

- Pro = Eskalations-Route

In der Produktion funktioniert dieses Framing in der Regel besser, als ein einziges teures Modell auf alle Workloads zu zwingen.

Lohnt sich DeepSeek V4 für Coding-Teams?

Für viele Coding-Teams: ja, aber nicht als blinder Komplettersatz.

DeepSeek V4 verdient eine ernsthafte Evaluierung, wenn:

- Sie viel Code-Generierung, Code-Review, Repo-Lektüre oder Long-Context-Coding-Arbeit machen

- Ihre aktuelle Output-Token-Rechnung schmerzhaft ist

- Sie eine günstigere Standard-Route für Agenten und Coding-Assistenten wollen

- Sie bereit sind, einen gestuften Rollout durchzuführen statt einer Einmal-Migration

Weniger eindeutig lohnenswert ist es, wenn:

- Ihre anspruchsvollsten Workflows bereits Premium-Preise für Closed-Modelle rechtfertigen

- Ihr Team stärker von den Plattform-Features eines Anbieters abhängt als von Modell-Ökonomie

- Sie noch kein Eval-Set und keinen Rollback-Pfad haben

Wie sich DeepSeek V4 mit GPT-5.4 und Claude Opus 4.7 vergleicht

Wenn Ihr Team modellübergreifend entscheidet, ist die nützlichste Baseline nicht mehr Claude Opus 4.6. Die aktuelle praktische Baseline ist:

- DeepSeek V4 Flash

- DeepSeek V4 Pro

- GPT-5.4

- Claude Opus 4.7

| Modell | Input | Output | Kontext | Max. Ausgabe | Beste Eignung |

|---|---|---|---|---|---|

| DeepSeek V4 Flash | $0,14 | $0,28 | 1M | 384K | Günstigste Long-Context-Produktionsroute |

| DeepSeek V4 Pro | $1,74 | $3,48 | 1M | 384K | Premium-DeepSeek-Route |

| GPT-5.4 | $2,50 | $15,00 | 1.050.000 | 128K | Offizielles OpenAI-Flaggschiff |

| Claude Opus 4.7 | $5,00 | $25,00 | 1M | 128K | Anthropics stärkste GA-Route für Coding und Agenten |

Wo DeepSeek V4 am stärksten ist

Basierend auf dem offiziell dokumentierten Feature-Set und der Preisstruktur ist DeepSeek V4 dort am stärksten, wo folgende Bedingungen zutreffen:

- langer Kontext ist wichtig

- Output-Kosten sind entscheidend

- Coding- und Agenten-Workloads dominieren

- Sie eine günstige Standard-Route von einer stärkeren Premium-Route trennen möchten

Diese Kombination ist selten. Genau deshalb ist DeepSeek V4 deutlich relevanter als ein normaler Modell-Launch.

Wo GPT-5.4 weiterhin sinnvoll ist

GPT-5.4 bleibt sinnvoll, wenn:

- Sie offizielle OpenAI-Plattformunterstützung end-to-end wollen

- Ihr Team bereits stark auf OpenAI-Tools und -Integrationen setzt

- Sie die offizielle OpenAI-Flaggschiff-Route für Coding und professionelle Arbeit wollen

- Plattformkonsistenz Ihnen wichtiger ist als reine Output-Kosten

Wo Claude Opus 4.7 weiterhin sinnvoll ist

Claude Opus 4.7 ist die richtige Baseline, wenn:

- Sie Anthropics stärkste allgemein verfügbare Coding-Route wollen

- Ihre Workflows auf langfristige agentische Arbeit angewiesen sind

- Sie Claudes wachsende Steuerungsmöglichkeiten für Aufwand und lang laufende Tasks nutzen möchten

- Ihr Team bereit ist, für Qualität und Zuverlässigkeit einen Aufpreis zu zahlen

Was DeepSeek V4 in realen Workloads tatsächlich kostet

Die offiziellen Preise pro Million Token sind hilfreich, aber Teams kaufen keine „eine Million Token". Sie kaufen Ergebnisse.

Nachfolgend finden Sie einfachere, workload-orientierte Beispiele auf Basis der offiziellen öffentlichen Preise, mit groben Token-Mengen, die lediglich die Kostenstruktur verdeutlichen sollen.

Szenario 1: Repository-Analyse

Annahmen:

- 250K Input-Token

- 20K Output-Token

Geschätzte API-Kosten:

- DeepSeek V4 Flash: ca. $0,04 Input + $0,01 Output

- DeepSeek V4 Pro: ca. $0,44 Input + $0,07 Output

- GPT-5.4: ca. $0,63 Input + $0,30 Output

- Claude Opus 4.7: ca. $1,25 Input + $0,50 Output

Deshalb ist Flash ein so offensichtlicher erster Test für Codebase-Lektüre, Dependency-Audits und Repo-Zusammenfassungen.

Szenario 2: Multi-Turn Coding-Agenten-Aufgabe

Annahmen:

- 120K Input-Token

- 80K Output-Token

Geschätzte API-Kosten:

- DeepSeek V4 Flash: ca. $0,02 Input + $0,02 Output

- DeepSeek V4 Pro: ca. $0,21 Input + $0,28 Output

- GPT-5.4: ca. $0,30 Input + $1,20 Output

- Claude Opus 4.7: ca. $0,60 Input + $2,00 Output

Die Lektion ist nicht, dass Premium-Modelle „schlecht" wären. Die Lektion ist, dass output-intensive Workloads bei teuren Output-Preisen besonders stark ins Geld gehen.

Szenario 3: Langes Dokument oder rechtliche Prüfung

Annahmen:

- 400K Input-Token

- 25K Output-Token

Was diese Beispiele bedeuten

Wenn Ihr Produkt hauptsächlich Folgendes tut:

- Code-Generierung

- Code-Review

- lange Repo-Lektüre

- langes PDF- oder Policy-Review

- mehrstufige Agenten-Schleifen

Wo DeepSeek V4 noch Grenzen hat

Ein nützlicher Review-Artikel sollte nicht so tun, als seien alle Stärken universell.

1. Der Preview-Status ist relevant

2. Sie brauchen ein eigenes Eval-Set

- Agenten-Schleifen

- Code-Review-Präzision

- Diff-Qualität

- lang laufende Aufgaben

- Schema-Zuverlässigkeit

3. Premium-Closed-Modelle können bei Ihren schwierigsten Aufgaben weiterhin gewinnen

Claude Opus 4.7 und GPT-5.4 bleiben relevant, weil manche Workloads höhere Ausgaben rechtfertigen:

- Code-Änderungen mit dem höchsten Risiko

- die schwierigsten agentischen Aufgaben

- Enterprise-Workflows, bei denen Fehlerkosten hoch sind

- Umgebungen, in denen Plattform-Tooling genauso wichtig ist wie der Modellpreis

Der richtige Vergleich lautet nicht „welches Modell gewinnt im Internet". Er lautet: „Welches Modell ist am günstigsten für die Aufgaben, die wir ihm sicher zuweisen können?"

Wann sollten Sie weiterhin Claude Opus 4.7 oder GPT-5.4 einsetzen?

Behalten Sie Claude Opus 4.7 im Stack, wenn:

- Ihr Team die schwierigsten Coding- und Review-Aufgaben bearbeitet

- Sie Anthropics stärkstes allgemein verfügbares Modell benötigen

- Agenten-Zuverlässigkeit wichtiger ist als Token-Kosten

Behalten Sie GPT-5.4 im Stack, wenn:

- Ihr Team bereits stark in die OpenAI-Plattform investiert hat

- Sie die offizielle OpenAI-Flaggschiff-Route für professionelle Arbeit und Coding wollen

- Ihr Workflow genauso von den umgebenden OpenAI-Tools abhängt wie vom Modell selbst

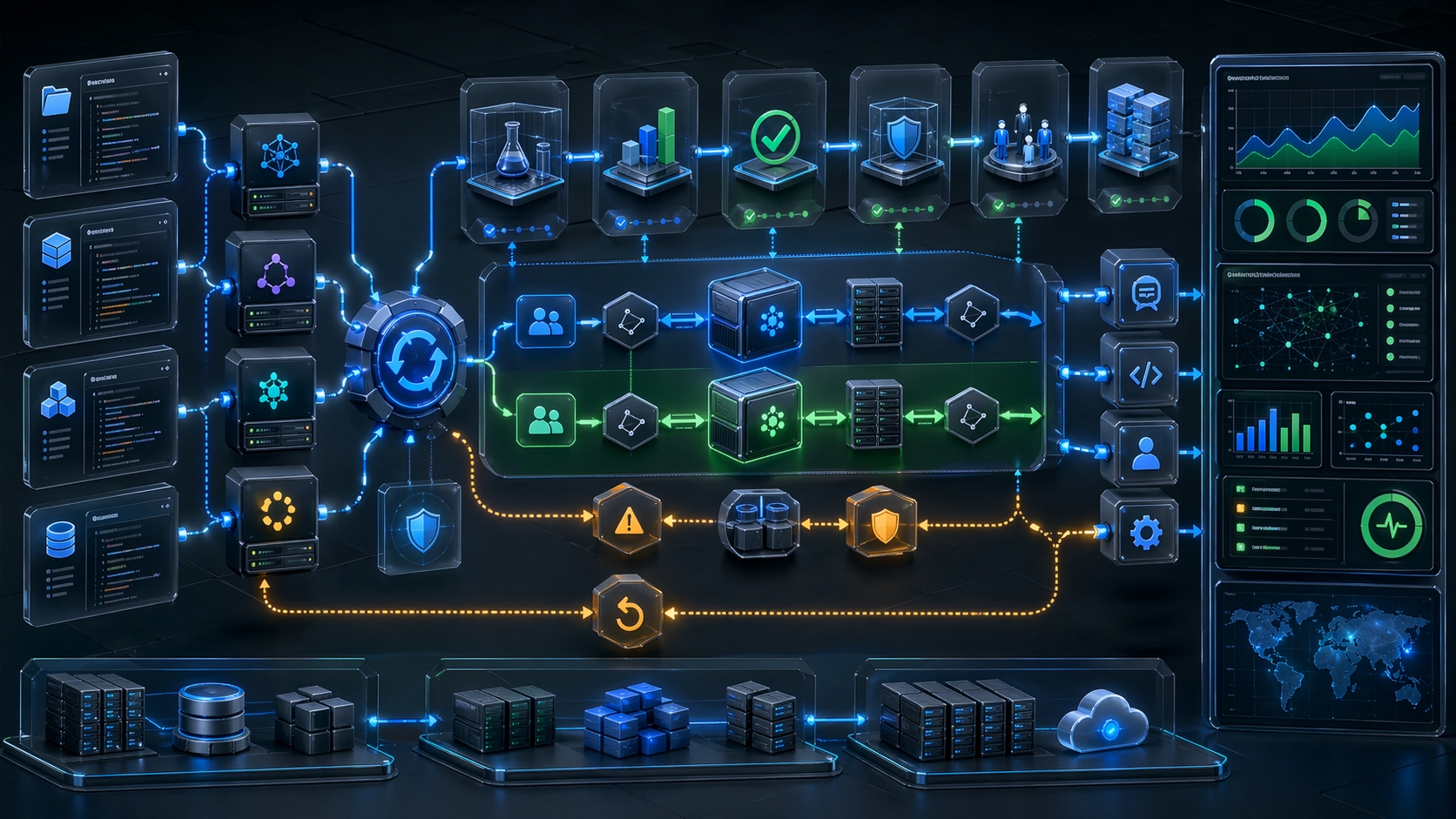

Das praktischste Setup für viele Teams

Für viele reale Produktions-Stacks lautet die beste Antwort nicht „alles ersetzen". Sondern:

- DeepSeek V4 Flash für günstiges Standard-Routing

- DeepSeek V4 Pro für schwierigere DeepSeek-geeignete Workloads

- Claude Opus 4.7 oder GPT-5.4 als Premium-Fallback- und Eskalations-Routen

Das ist in der Regel eine bessere Architektur, als einen universellen Gewinner küren zu wollen.

So migrieren Sie von deepseek-chat und deepseek-reasoner

Das ist einer der praktischsten Gründe, diesen Guide jetzt zu veröffentlichen.

Die offiziellen DeepSeek-Docs besagen:

deepseek-chatist für die Abschaltung am 24. Juli 2026 vorgesehendeepseek-reasonerist für die Abschaltung am 24. Juli 2026 vorgesehen- aus Kompatibilitätsgründen werden sie auf den Non-Thinking- bzw. Thinking-Modus von

deepseek-v4-flashgemappt

Empfohlener Migrationspfad

- Inventarisieren Sie alle aktuellen DeepSeek-Routen in der Produktion

Finden Sie heraus, wo Ihre Anwendung noch auf Folgendes verweist:

deepseek-chatdeepseek-reasoner- hardcodierte Prompt-Logik, die an altes Output-Verhalten gebunden ist

- Testen Sie zuerst

deepseek-v4-flash

Da die Kompatibilitäts-Aliase auf Flash-Verhalten zeigen, ist Flash in der Regel das risikoärmste erste Migrationsziel.

- Stufen Sie nur bestimmte Workloads auf Pro hoch

Wechseln Sie nicht pauschal alles auf Pro. Geben Sie Pro zunächst eine eng definierte Aufgabe:

- schwierige Coding-Aufgaben

- tiefere Analysen

- hochwertige Eskalationspfade

- Halten Sie Rollback-Routen aktiv

Preview bedeutet, dass Sie schnell zurücksetzen oder umrouten können sollten, wenn:

- die Qualität nachlässt

- die Latenz ansteigt

- sich die Schema-Zuverlässigkeit ändert

- Tool Use sich anders verhält

Migrationstabelle

| Alte Route | Kurzfristiger Ersatz | Langfristige Empfehlung |

|---|---|---|

deepseek-chat | deepseek-v4-flash Non-Thinking | Behalten Sie Flash als Ihre kostengünstige Standard-Route |

deepseek-reasoner | deepseek-v4-flash Thinking | Testen Sie, ob Pro für Ihre schwierigsten Aufgaben besser ist |

DeepSeek V4 Produktions-Rollout-Checkliste

Wenn Sie DeepSeek V4 für den Echtbetrieb evaluieren, nutzen Sie eine Rollout-Checkliste wie diese:

- Definieren Sie 20 bis 50 echte Aufgaben aus Ihrem eigenen Workload

- Trennen Sie einfache Standard-Route-Aufgaben von Premium-Route-Aufgaben

- Benchmarken Sie Flash und Pro unabhängig voneinander

- Vergleichen Sie die Output-Qualität, nicht nur Benchmark-Schlagzeilen

- Messen Sie Kosten pro erfolgreicher Aufgabe, nicht nur Kosten pro Token

- Halten Sie Rollback-Routen für GPT-5.4 oder Claude Opus 4.7 bereit

- Versionieren Sie Prompts und Evaluierungs-Harnesses

- Loggen Sie Tool-Call-Fehler und Schema-Fehler separat

- Beobachten Sie Latenz- und Retry-Muster während der Preview-Phase

- Legen Sie im Voraus fest, was als „gut genug zum Hochstufen" gilt

Das ist der Teil, den viele Launch-Artikel auslassen -- und es ist der Teil, der tatsächlich darüber entscheidet, ob ein Modell Geld spart oder versteckte Betriebskosten erzeugt.

Empfehlung nach Team-Typ

Team A: Kostensensitive Coding-Plattform

Team B: Enterprise-App mit hochkritischen Ausgaben

Team C: Long-Context-Produkt

DeepSeek V4 ist hier ungewöhnlich attraktiv, weil es kombiniert:

- offiziell 1M Kontext

- sehr große 384K Ausgabe

- ungewöhnlich niedrige Output-Preise

Team D: Mixed-Model-Router

Der sauberste Stack für viele Teams sieht jetzt vermutlich so aus:

- DeepSeek V4 Flash für günstiges Standard-Routing

- DeepSeek V4 Pro für schwierigeres Reasoning und Coding

- Claude Opus 4.7 oder GPT-5.4 für Premium-Eskalation

Fazit

DeepSeek V4 ist relevant, weil es die Routing-Ökonomie verändert -- nicht weil es auf magische Weise jedes Premium-Closed-Modell ersetzt.

Die stärkste Schlussfolgerung zum jetzigen Zeitpunkt ist:

- Flash ist ein ernsthafter Kandidat als Standard-Route

- Pro ist eine ernstzunehmende Premium-DeepSeek-Route

- GPT-5.4 und Claude Opus 4.7 bleiben für Premium- und hochkritische Workloads relevant

- der beste Rollout ist gestuft, nicht alles auf einmal

Wenn Ihr Team einen einzigen Ratschlag braucht, dann diesen:

FAQ

Ist DeepSeek V4 jetzt offiziell verfügbar?

deepseek-v4-flash und deepseek-v4-pro, und Reuters berichtete am 24. April 2026, dass DeepSeek Preview-Versionen von V4 gelauncht hat. DeepSeek API Docs Reuters via Investing.comWas sollte ich zuerst testen: Flash oder Pro?

Lohnt sich DeepSeek V4 für Coding-Teams?

In der Regel ja, wenn Ihr Team kostensensitiv ist, output-intensive Workloads hat oder Long-Context-Coding-Arbeit macht. Am besten eignet sich eine gestufte Evaluierung, kein sofortiger Komplettersatz.

Ist DeepSeek V4 Open-Weight?

Ist DeepSeek V4 günstiger als GPT-5.4 und Claude Opus 4.7?

Sollte ich DeepSeek V4 Flash oder Pro für Repository-weites Coding verwenden?

Sollte ich Claude Opus 4.7 oder GPT-5.4 sofort ersetzen?

In der Regel nein. Der sicherere Weg ist gestuftes Routing: Testen Sie Flash zuerst, evaluieren Sie Pro als Nächstes, und behalten Sie Premium-Fallbacks bei, bis Sie V4 mit Ihren realen Workloads vertrauen.

Was passiert mit deepseek-chat und deepseek-reasoner?

deepseek-v4-flash-Kompatibilitätsverhalten entsprechen. DeepSeek API DocsWo finde ich die offiziellen DeepSeek V4 API-Routendetails?

Quellen

- DeepSeek API Docs

- DeepSeek Models & Pricing

- DeepSeek V4 Pro LICENSE auf Hugging Face

- OpenAI API Pricing

- OpenAI GPT-5.4 Model

- Anthropic Claude Opus 4.7

- China's AI darling DeepSeek previews new model | Reuters via Investing.com

Bereit, DeepSeek V4 zu testen?

Weiterführende Artikel:

- DeepSeek V4 Is Live in Preview: Official API Models, Pricing, and What Changed

- DeepSeek V4 Flash & Pro vs GPT-5.4 vs Claude Opus 4.6: Official Pricing and Capability Comparison (historische Referenz — Benchmark gegen Opus 4.6)

- Bestes LLM für Coding Agents: API-Kosten, Tool-Nutzung und Zuverlässigkeit im Vergleich — Sehen Sie, wie DeepSeek V4 für Coding-Agent-Workloads abschneidet