DeepSeek V4 Flash/Pro vs GPT-5.4 vs Claude Opus 4.6: Offizielle Preise und Leistungsvergleich

Dieser Artikel wurde veröffentlicht, bevor DeepSeek V4 offiziell dokumentiert war. Er wurde vollständig überarbeitet und spiegelt nun den offiziellen Preview-Launch von DeepSeek V4 wider – einschließlich öffentlicher Modell-IDs, Preise, 1M-Kontext und der Aufteilung in Flash und Pro.

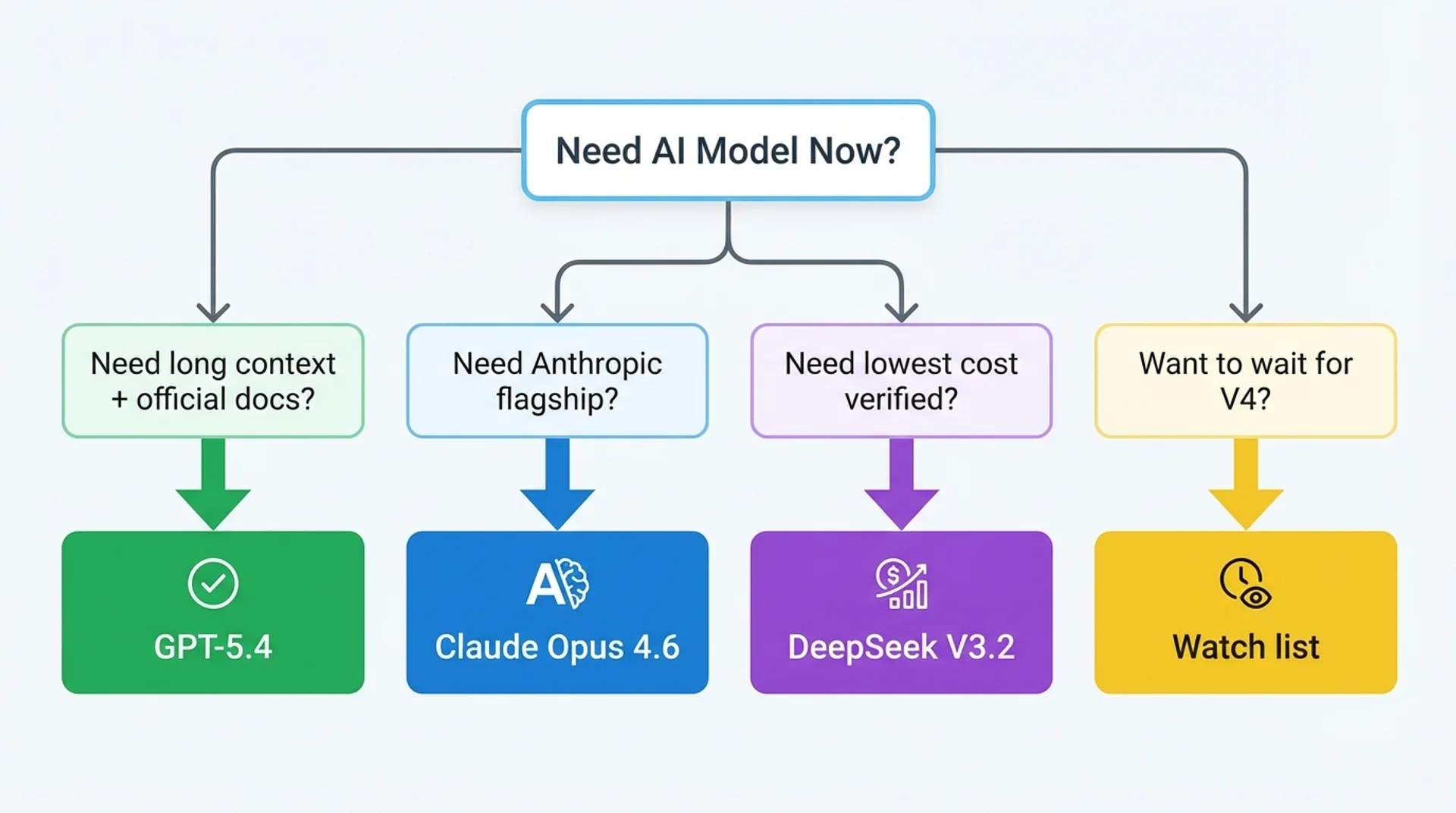

4.6-Vergleichsset abzielen. Betrachten Sie diese Seite als historisch fundierte und weiterhin nützliche Vergleichsbasis – nicht als abschließendes Urteil über das neueste Claude-Release.deepseek-v4-flash und deepseek-v4-pro, und die offizielle Preisseite dokumentiert Preise, 1M Kontext und 384K maximale Ausgabe. DeepSeek API Docs DeepSeek Models & PricingDer Vergleich hat sich verschoben – von „Lässt sich DeepSeek V4 überhaupt verifizieren?" zu einer nützlicheren Entscheidung:

- Wann ist DeepSeek V4 Flash die bessere Wahl?

- Wann lohnt sich der Aufpreis für DeepSeek V4 Pro?

- Wann sollten Teams weiterhin GPT-5.4 oder Claude Opus 4.6 wählen?

Kurzfassung

- DeepSeek V4 Flash — günstigste offiziell dokumentierte Option in diesem Vergleich: $0,14 Input / $0,28 Output pro 1M Token, 1M Kontext, 384K max. Ausgabe. Stärkster Kandidat für Großvolumen-Coding, Agent-Routing und kostenempfindliche Long-Context-Workloads. DeepSeek Models & Pricing

- DeepSeek V4 Pro — intelligentere V4-Route: $1,74 Input / $3,48 Output pro 1M Token. Deutlich günstiger als Claude Opus 4.6, Output günstiger als GPT-5.4. Gleicher 1M Kontext und 384K max. Ausgabe. DeepSeek Models & Pricing

- GPT-5.4 — OpenAIs offizielles Flaggschiff für komplexe professionelle Arbeit: 1.050.000 Kontext, 128.000 max. Ausgabe, $2,50 / $15,00. OpenAI Pricing OpenAI GPT-5.4 Model

- Claude Opus 4.6 — Top-Wahl für Coding und Agent-Aufgaben: $5 / $25 pro 1M Token, 128K Ausgabe, 1M Kontext in Beta auf der Claude Developer Platform. Anthropic Claude Opus 4.6

Aktuell offiziell verifizierbar

Die folgende Tabelle verwendet ausschließlich offiziell dokumentierte Herstellerinformationen.

| Thema | DeepSeek V4 Flash | DeepSeek V4 Pro | GPT-5.4 | Claude Opus 4.6 |

|---|---|---|---|---|

| Anbieter | DeepSeek | DeepSeek | OpenAI | Anthropic |

| Status | Öffentliche API-Preview dokumentiert | Öffentliche API-Preview dokumentiert | Offiziell dokumentiert und verfügbar | Offiziell dokumentiert und verfügbar |

| Input-Preis | $0,14 / 1M (Cache-Miss) | $1,74 / 1M (Cache-Miss) | $2,50 / 1M | $5,00 / 1M |

| Cache-Input-Preis | $0,028 / 1M | $0,145 / 1M | $0,25 / 1M | Abhängig von Cache- und Long-Context-Tier |

| Output-Preis | $0,28 / 1M | $3,48 / 1M | $15,00 / 1M | $25,00 / 1M |

| Kontext | 1M | 1M | 1.050.000 | 1M (Beta) |

| Max. Ausgabe | 384K | 384K | 128K | 128K |

| Denkmodus | Unterstützt | Unterstützt | Über Reasoning Effort | Über Adaptive/Extended Thinking |

| Tool-Aufrufe | Unterstützt | Unterstützt | Unterstützt | Unterstützt |

| Positionierung | V4-Niedrigkosten-Route | V4-Höhere-Intelligenz-Route | OpenAI-Flaggschiff | Anthropic-Flaggschiff |

Preise im Realitätscheck

Alle drei Anbieter veröffentlichen nutzbare offizielle Zahlen – der Vergleich ist unkompliziert.

| Modell | Input | Cache-Input | Output | Praxisbewertung |

|---|---|---|---|---|

| DeepSeek V4 Flash | $0,14 | $0,028 | $0,28 | Mit Abstand günstigste offizielle Route |

| DeepSeek V4 Pro | $1,74 | $0,145 | $3,48 | Deutlich günstiger als Claude Opus 4.6, Output unter GPT-5.4 |

| GPT-5.4 | $2,50 | $0,25 | $15,00 | Premium-OpenAI-Route für komplexe Arbeit |

| Claude Opus 4.6 | $5,00 | Tier-abhängig | $25,00 | Teuerste Route, aber Top-Coding- und Agent-Modell |

Zwei Punkte stechen sofort hervor:

- DeepSeek V4 Flash ist mit großem Abstand der Kostenführer.

- DeepSeek V4 Pro hat sich von „unverifizierten Watchlist" zur echten Premium-aber-kosteneffizienten Option entwickelt.

Wenn der Output-Token-Preis für Ihre Workloads wichtig ist, fällt der Unterschied besonders ins Gewicht:

- V4 Flash Output ist deutlich günstiger als GPT-5.4 und Claude Opus 4.6

- V4 Pro Output liegt ebenfalls klar unter GPT-5.4 und Claude Opus 4.6

Die größte praktische Änderung: DeepSeek V4 ist jetzt Flash vs Pro

Frühere V4-Artikel behandelten V4 als ein einzelnes hypothetisches Modell. Für Entscheidungen ist das nicht mehr korrekt.

Das nützlichere Framing heute:

- Flash wählen — wenn Kosten, Durchsatz und breite Bereitstellung am wichtigsten sind

- Pro wählen — wenn stärkere Reasoning-Qualität nötig ist, aber Closed-Model-Preise vermieden werden sollen

DeepSeek V4 ist weniger ein einzelner Konkurrent zu GPT-5.4 oder Opus 4.6 und eher eine zweistufige Produktfamilie.

Welches Modell passt zu welchem Workflow

DeepSeek V4 Flash: Bestes Preis-Leistungs-Verhältnis

Flash ist optimal für:

- Großvolumen-Coding-Unterstützung

- Kostenempfindliche Agent-Pipelines

- Große Kontextverarbeitung von Dokumenten oder Repositories

- Routing-Defaults, die günstig bleiben müssen

DeepSeek V4 Pro: Premium-V4 ohne Closed-Model-Preise

Pro ist die bessere Wahl für:

- Tieferes Reasoning als bei Budget-Routen

- Anspruchsvollere Coding- und Analyseaufgaben

- Längere strukturierte Ausgaben

- Upgrade von Flash, ohne gleich Claude Opus 4.6 Preise zu zahlen

Für viele Teams ist Pro kein universeller Ersatz für GPT-5.4 oder Opus 4.6, sondern eine günstigere Premium-Option, die sich lohnt, parallel zu evaluieren.

GPT-5.4: OpenAIs offizielles Flaggschiff

GPT-5.4 bleibt attraktiv für:

- Offiziellen OpenAI-Plattform-Support

- Dokumentiertes 1.050.000 Kontextfenster

- 128.000 maximale Ausgabe

- Vertraute OpenAI-Entwickler-Workflows

Claude Opus 4.6: Top-Priorität Anthropic-Coding und Agent-Arbeit

Claude Opus 4.6 bleibt stark für:

- Anthropics Flaggschiff-Coding-Modell

- Extended und Adaptive Thinking Steuerung

- Lang laufende Agent-Workflows

- Claude-Plattformfunktionen wie Kontextkomprimierung und 1M-Kontext-Beta

Kontext- und Ausgabelimits sind wichtiger als zuvor

Das DeepSeek V4 Update verändert auch die Long-Context-Diskussion.

Früher war ein praktischer Grund für GPT-5.4 oder Claude Opus 4.6, dass DeepSeek V4 nicht offiziell dokumentiert war. Jetzt ist DeepSeek offiziell in derselben Planungsdiskussion, da beide Varianten bieten:

- 1M Kontext

- 384K max. Ausgabe

Relevant für:

- Repository-weites Code-Verständnis

- Lange juristische oder wissenschaftliche Dokumente

- Mehrstufige Agent-Langschleifen

- Aufgaben mit großem Single-Response-Output

Beim reinen maximalen Output-Headroom übertrifft DeepSeek V4 laut aktueller offizieller Dokumentation GPT-5.4 und Claude Opus 4.6 deutlich.

Empfohlene Entscheidung nach Anwendungsfall

| Anwendungsfall | Beste Wahl | Warum |

|---|---|---|

| Günstigste offizielle Long-Context-Route | DeepSeek V4 Flash | Niedrigster Preis mit 1M Kontext und 384K Ausgabe |

| Stärkere Premium-DeepSeek-Route | DeepSeek V4 Pro | V4-High-End ohne GPT/Claude-Preise |

| Offizielles OpenAI-Flaggschiff | GPT-5.4 | OpenAI-Flaggschiff mit 1.050.000 Kontext und 128K Ausgabe |

| Anthropics Top-Coding- und Agent-Modell | Claude Opus 4.6 | Anthropic-Flaggschiff mit 1M Beta und 128K Ausgabe |

| Ein Modell für breites Produktions-Routing zuerst evaluieren | Flash → Pro | Flash für kostenempfindliches Routing, Pro für schwierigere Workloads |

Was sich gegenüber der alten März-2026-Schlussfolgerung geändert hat

Alte Schlussfolgerung:

- DeepSeek V4 war ein Watchlist-Element

- V3.2 war die praktische offizielle DeepSeek-Baseline

- Teams sollten noch kein Budget auf V4 aufbauen

Das ist nicht mehr korrekt.

- DeepSeek V4 ist offiziell dokumentiert und im Preview nutzbar

- DeepSeek V4 Flash und Pro sollten direkt evaluiert werden

- V3.2 ist nicht mehr die richtige Planungsbaseline für V4-Vergleiche

FAQ

1. Ist DeepSeek V4 jetzt offiziell verfügbar?

deepseek-v4-flash und deepseek-v4-pro in der offiziellen API-Dokumentation, und Reuters berichtete am 24. April 2026 über den Preview-Launch. DeepSeek API Docs Reuters via Investing.com2. Kann ich DeepSeek V4 jetzt verantwortungsvoll mit GPT-5.4 und Claude Opus 4.6 vergleichen?

3. Welche V4-Variante zuerst testen: Flash oder Pro?

Für die meisten Teams ist Flash der bessere erste Test – deutlich günstiger bei gleichem 1M Kontext und 384K max. Ausgabe. Bei anspruchsvolleren Reasoning- oder Coding-Aufgaben danach Pro testen.

4. Hat GPT-5.4 noch Vorteile?

5. Hat Claude Opus 4.6 noch Vorteile?

6. Was ist die günstigste offizielle Option in diesem Vergleich?

7. Sollte ich DeepSeek-V3.2 noch als Budget-Baseline verwenden?

Nicht für V4-Planung. V4 Flash und V4 Pro sind die aktuell richtige Baseline.

8. Wo finde ich Routing-Details und Implementierungshinweise?

Quellen

- DeepSeek API Docs

- DeepSeek Models & Pricing

- OpenAI API Pricing

- OpenAI GPT-5.4 Model

- Anthropic Claude Opus 4.6

- Anthropic Claude Opus 4.7

- China's AI darling DeepSeek previews new model | Reuters via Investing.com